阿饭手记

126 posts

阿饭手记

@AfanNote

绿老头|8年内容运营|AI实战 分享内容增长、AI体验和变现思路 三省吾身:先做起来,在实战里把路走清楚

انضم Nisan 2026

177 يتبع205 المتابعون

تغريدة مثبتة

看到火山哥说“请问ChatGPT的设计师到底是哪路神仙天才??? 每次总是:“如果你愿意,我下一步可以帮你干一件更狠的!” 结果: 把我改得面目全非,灵魂都没边了! 一点哥的骚味儿都不剩,纯纯的干饭! 你踏马是在抢劫? 还是在集体轮奸我的灵魂??? 这就是所谓的“去中心化”灵魂设计?”

如何避免呢?

1. 让AI优化只做诊断,而不是直接去改。

可以说:你是xx的内容编辑,来诊断一下这篇内容有哪些需要提升的点。

2. 根据AI给的建议,告诉它只做最小必要修改,让文本保留我的原始人格、语气、节奏等。

3. 让AI总结自己文章的调性,然后禁止AI修改这些调性,如“禁止把原文改得过度礼貌”。

4. 减少或禁止AI输出如果你愿意,我还可以xxx。这是面向新手的提示。

中文

我终于明白为啥最近很多人都在说,GPT和Claude突然变笨了,

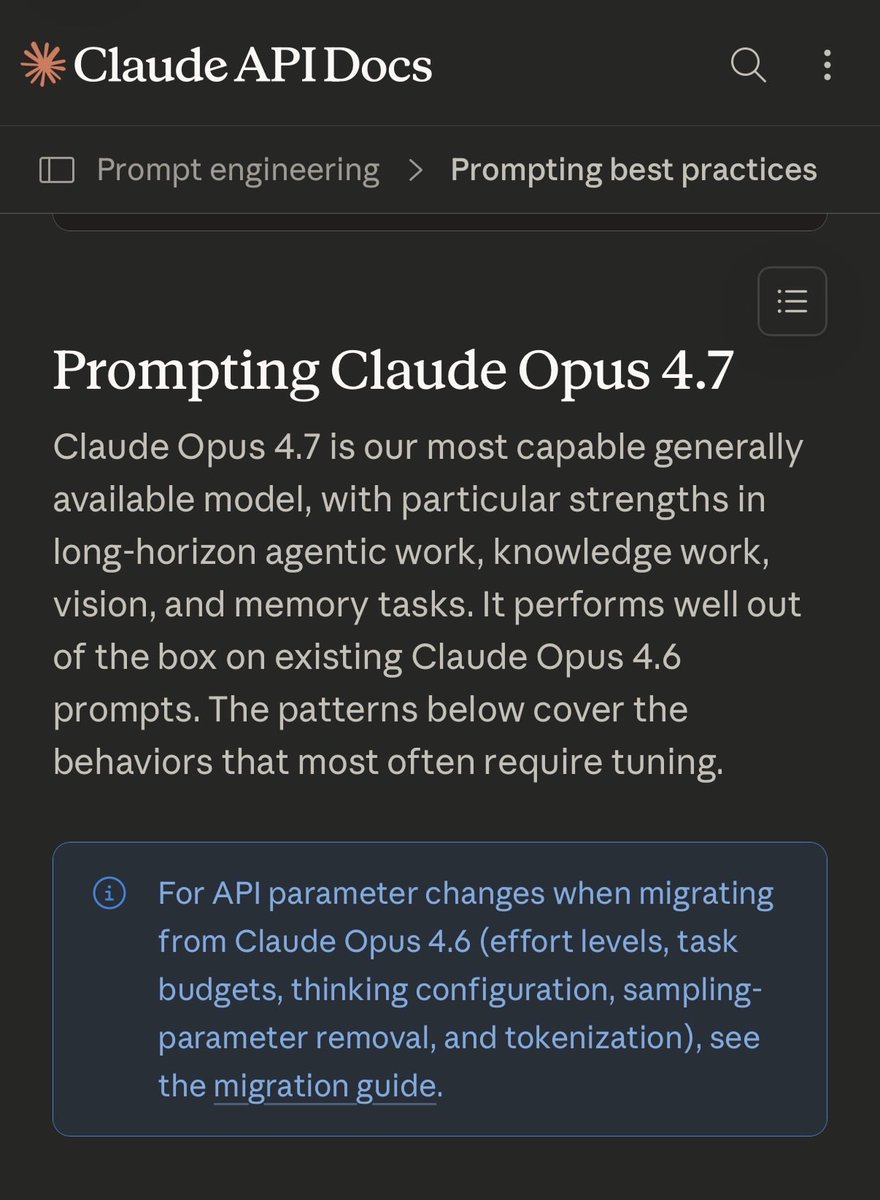

昨天OpenAI和Anthropic同时发布了官方提示工程指南,

看完我才发现,并不是模型变笨了,

是它们终于聪明到,不再容忍人类懒得想清楚了🤣🤣🤣

而且最有意思的是,

两个模型的进化方向,居然是完全相反的,

Claude Opus 4.7变得越来越字面,

以前它会主动帮你补全模糊的指令,

现在你说什么它就做什么,多一个字都不会猜🤣🤣

GPT-5.5变得越来越自主,

以前你要手把手教它每一步怎么做,

现在你只要告诉它你想要什么结果,它自己会选最优路径,

所以老提示失效的原因也完全相反,

用在Claude上的模糊提示,会得到越来越窄的输出,

用在GPT上的详细流程,会变成多余的噪声,

过去三年我们一直在学怎么教模型做事,

现在反过来了,

模型开始要求我们,先把自己的思考结构化,

其实就是提示工程的本质,

已经从教模型怎么做,变成了先把自己想明白,

所以真正的瓶颈可能不是模型的能力,而是写提示的那个人的思考清晰度,

我感觉以后赢的人,不会是提示写得最长最复杂的人,而是那个最知道自己真正想要什么的人🤔

中文

评论区凡是关注我的,大部分都关注了,如果还有漏掉的,可发在这条推下面,今晚或者明天会挨个关注

比特币总裁@chairbtc

互关互关互关 还差600个粉丝突破10万,继续冲,凡是我的粉丝,不管是不是蓝V,我都会一一关注,让我们一起来消除蓝V互关这种等级歧视,普通用户也值得被爱,值得被关注

中文

4月最后一天啦

继续继续——#蓝v互关

不管你有没有蓝v,正常账号我都会回

别太离谱哈哈🤭

如有没及时回关的老师留言@我!!!

Weilan| 🤖ボッ Bird🕊️@ohouhou717

兄弟们继续蓝v互关 评论区互帮互助 蓝v兄弟们 都搞起来 #蓝v互关

中文