Angehefteter Tweet

이대은(Dae-eun Lee)

2.8K posts

이대은(Dae-eun Lee)

@2daeeun

Computer Science Student / Otaku / Following and retweeting do not represent my views.

Dept. of Computer Science Beigetreten Haziran 2013

300 Folgt694 Follower

이대은(Dae-eun Lee) retweetet

Assembly code visualizer

asm.diveintosystems.org

Vivek Galatage@vivekgalatage

x86-64 Assembly Language Programming with Ubuntu This is another beginner-friendly book focusing on x86 and Ubuntu (accessible to almost every student). This also covers many advanced elements from the assembly programming. egr.unlv.edu/~ed/x86.html

English

이대은(Dae-eun Lee) retweetet

이대은(Dae-eun Lee) retweetet

2026 오픈소스 컨티르뷰션 아카데미(체험형) 멘티 모집이 이제 거의 마지막입니다. 4/1일까지에요 신청하세요.

contribution.ac

한국어

이대은(Dae-eun Lee) retweetet

@Yong_builder 저도 코덱스 사용하면서 바이브코딩을 하는 방법은 알고 있는데요,

흠... 바이브코딩으로 만든 코드는 나중에 디버깅 할 때는 어렵더라고요.

제가 ai를 잘 활용 못하는 문제도 있겠지만요😅

그래서 지금은 직접 코드 전체 다 분석한 뒤에 수제로 코드 짜고, 나중에 디버깅 할 때만 ai 도움 받아요ㅎ

한국어

@2daeeun @thx_for_today 반 바이브코딩이면 반은 직접 하신다는 거잖아요. 저는 비개발자라 거의 100% AI 의존인데 그것도 쉽지 않더라고요 ㅋㅋ

한국어

이대은(Dae-eun Lee) retweetet

@thx_for_today ㅋㅋㅋㅋㅋㅋㅋ

근데 저도 코드 오류나가너 그럴때는 지피티한테 자주 물어보긴해요.

약간 반 바이브코딩 해요 ㅋ

한국어

이대은(Dae-eun Lee) retweetet

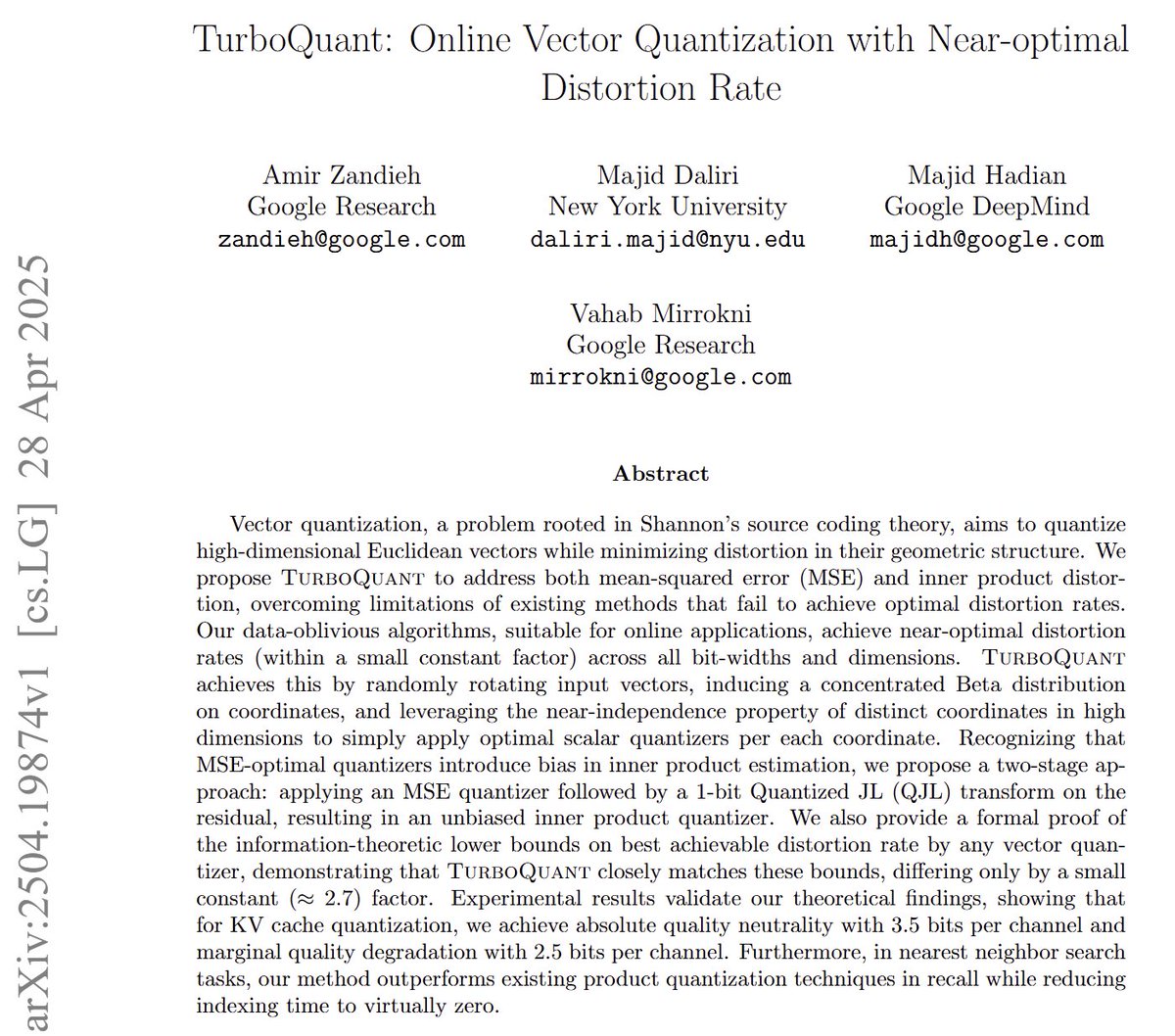

오늘 하루종일 핫한 TurboQuant #논문

내가 이해한 대로 읊어보면: 고차원 벡터를 양자화 압축해 데이터 양을 줄이는데, 압축하는 만큼 부정확해짐. 특히 예를 들어 100번째 좌표가 0.5 근처에 다 몰려있으면 양자화할 때 이 부분 정보가 사실상 날아감. 그래서 뭘 하냐면 랜덤한 방향으로 회전시킴

말러팔삼@mahler83

조깅 3일차. 타임라인에 열번쯤 올라온 TurboQuant arXiv 논문을 넣고 AO 만들어서 퇴근길, 빨래설거지, 조깅에 거쳐서 들어봤는데 어렵기도 하고 신기하기도 했다. 압축률이 Theoretical lower bound에 근접한다고? 시끌시끌할만 하구나 싶었다

한국어

이대은(Dae-eun Lee) retweetet

이대은(Dae-eun Lee) retweetet

@kokontouzai_vv ㅋㅋㅋㅋㅋㅋ

긴 글 잘 읽었어요.

글애서 마치 천사와 악마가 공존하는거 같았어요 ㅋㅋㅋ 😂

적절히 ai 도움을 균형 맞춰가며 쓰겠습니다..ㅎ

한국어

@gaeaearth_sehan 아앗 그런 슬픈사연이...

근데 사진을 또 보아도 우연의 일치로 칠판 배치가 저리도 딱 맞는게 진짜로 신기하네요 ㅌㅌㅋㅋㅋㅋㅋ

한국어

이대은(Dae-eun Lee) retweetet

🚨Big news from KubeCon Europe.

NVIDIA is donating the Dynamic Resource Allocation (DRA) Driver for GPUs to the CNCF, moving it from vendor governance to full community ownership under the Kubernetes project.

DRA is how Kubernetes talks to GPUs at a fine-grained level. Until now, that critical layer was controlled by a single vendor. Moving it upstream means the broader community, including AWS, Google Cloud, Microsoft, Red Hat, and others, can co-develop it in the open.

What the driver enables:

∙Smarter GPU sharing via MPS and MIG

∙Multi-node NVLink support for large-scale training on Grace Blackwell systems

∙Dynamic resource reconfiguration without restarting workloads

∙Fine-grained requests for compute, memory, and interconnect topology

Also announced at KubeCon:

∙GPU support for Kata Containers, extending hardware acceleration into confidential computing

∙KAI Scheduler accepted as a CNCF Sandbox project

∙Grove, an open source Kubernetes API for orchestrating inference workloads on GPU clusters, integrating with the llm-d stack

The pattern here is deliberate. NVIDIA is not just building AI hardware. It is building the open infrastructure layer that runs AI at scale and anchoring it in the CNCF ecosystem.

English