Valentin Silvestre

2.6K posts

Valentin Silvestre

@ValentinSilves

PHP lover, mostly working with Symfony. In contract with Akawaka.

C'est décidé. En Juin je m'achète un Mac Mini 32GB et je monte un LLM de code dessus. En perso j'aimerais leave Claude éventuellement car le coût à l'usage est devenu beaucoup trop cher. Ce sera uniquement en perso J'hésite juste entre 32GB de RAM ou 64 (prix x2)

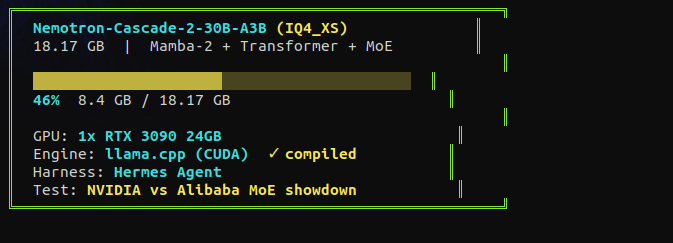

the hype around this model settled fast. good. now i can test it without the noise. NVIDIA released nemotron cascade. 30B total, 3B active. fits on a single RTX 3090. hybrid mamba MoE. gold medal on the international math olympiad with only 3 billion active parameters. they say it beats qwen on math, code, and reasoning. i tested qwen 3.5 35B-A3B on a single 3090 at 112 tok/s. now same card, same tests, different architecture. mamba vs deltanet. nvidia vs alibaba. receipts incoming tonight.

Je sais pas si je retrouverais un jour une montée de dopamine aussi forte qu'après ce drop , branchez vous team iop les enus c'est démodé.

New on the Anthropic Engineering Blog: How we use a multi-agent harness to push Claude further in frontend design and long-running autonomous software engineering. Read more: anthropic.com/engineering/ha…