Amjad AlJenbaz

3.2K posts

Amjad AlJenbaz

@dramjadj

مؤلف #ثاني_لفة_يمين في اختيار التخصص، و #اختراق_النمو، ومؤسس ألف ستارت أب @alefstartup في الريادة - حاصل على ماجستير AI من @UniOfYork وMBA من @Oxford_Brookes

⚡️ NEW: Block, Inc. has quietly rehired some of the 4,000 employees it laid off last month, with some workers receiving offers to return after the cuts were linked to clerical errors.

BREAKING: Meta is shutting down the Metaverse after spending $80 Billion on the project

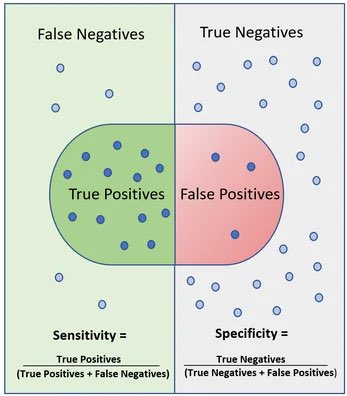

وهذا يُبرز مفهوم المقايضة (Tradeoff) بين الـAccuracy والـRecall في الإحصاء، وكيف أن أي نموذج عمل يمكن بسهولة وبكسل أن يكون ممتاز في أحدهما دون الآخر. مثلًا إذا بتكون حذر جدًا جدًا في القبض، بيرتفع الـAccuracy (نسبة كبيرة ممن قبضت عليهم فعلًا مجرمين) ولكن سينخفض الـRecall (من عموم المجرمين بالمجتمع، نسبة قليلة منهم قبضت عليهم) وممكن العكس، تكون شديد جدًا، بالتالي الـRecall يرتفع، لأنك تضف الجميع مجرم أو غير مجرم وبالتالي إذا نظرت للمجرمين في المجتمع ستجد أنك قبضت عليهم، ولكن من بين من قبضت عليهم بيكون قليل منهم فعلًا مجرمين (Accuracy أقل). هذه الظاهرة معروفة وواضحة في الذكاء الاصطناعي مثلًا، ولكنها فعليًا موجودة بكل الأنظمة والقرارات بالحياة. التحدي دائمًا بأن يتحسن الـAccuracy والـRecall معًا، وليس أحدهما دون الآخر. ووارد تضع أولوية لأحدهما، ولكن بدون ما يكون وضع الآخر كارثي.

رسالة توضيحية : وصل إلى بعض مستخدمي توكلنا رسالة تحذيرية اليوم قرابة الساعة 20:15 مساءً، بسبب خلل تقني أدى إلى وصول الرسالة لمستخدمين خارج نطاق المنطقة المحددة للإنذار، وبناء عليه يعتذر فريق توكلنا عن هذا الخلل.

My information consumption is now 1/4 X, 1/4 podcast interviews of the smartest practitioners, 1/4 talking to the leading AI models, and 1/4 reading old books. The opportunity cost of anything else is far too high, and rising daily.

BREAKING: Alibaba tested 18 AI coding agents on 100 real codebases, spanning 233 days each. they failed spectacularly. turns out passing tests once is easy. maintaining code for 8 months without breaking everything is where AI completely collapses. SWE-CI is the first benchmark that measures long-term code maintenance instead of one-shot bug fixes. each task tracks 71 consecutive commits of real evolution. 75% of models break previously working code during maintenance. only Claude Opus 4.5 and 4.6 stay above 50% zero-regression rate. every other model accumulates technical debt that compounds with every single iteration. here's the brutal part: - HumanEval and SWE-bench measure "does it work right now" - SWE-CI measures "does it still work after 8 months of changes" agents optimized for snapshot testing write brittle code that passes tests today but becomes completely unmaintainable tomorrow. they built EvoScore to weight later iterations heavier than early ones. agents that sacrifice code quality for quick wins get punished when the consequences compound. the AI coding narrative just got more honest. most models can write code. almost none can maintain it.

بحضور أحد مهندسي Cursor، أهم بيئات البرمجة الذكية اليوم! ⭐️ نقيم ورشة عملية مكثَّفة مع مهندس الذكاء الاصطناعي مازن العتيبي حول بناء البرمجيات من الفكرة إلى تطبيقها وإطلاقها بالاعتماد على وكلاء الذكاء الاصطناعي 🚀 كما سيحصل الحضور على أرصدة لا محدودة الاستخدام من Cursor، انتهز الفرصة وسجل الآن! luma.com/cwbemd5n

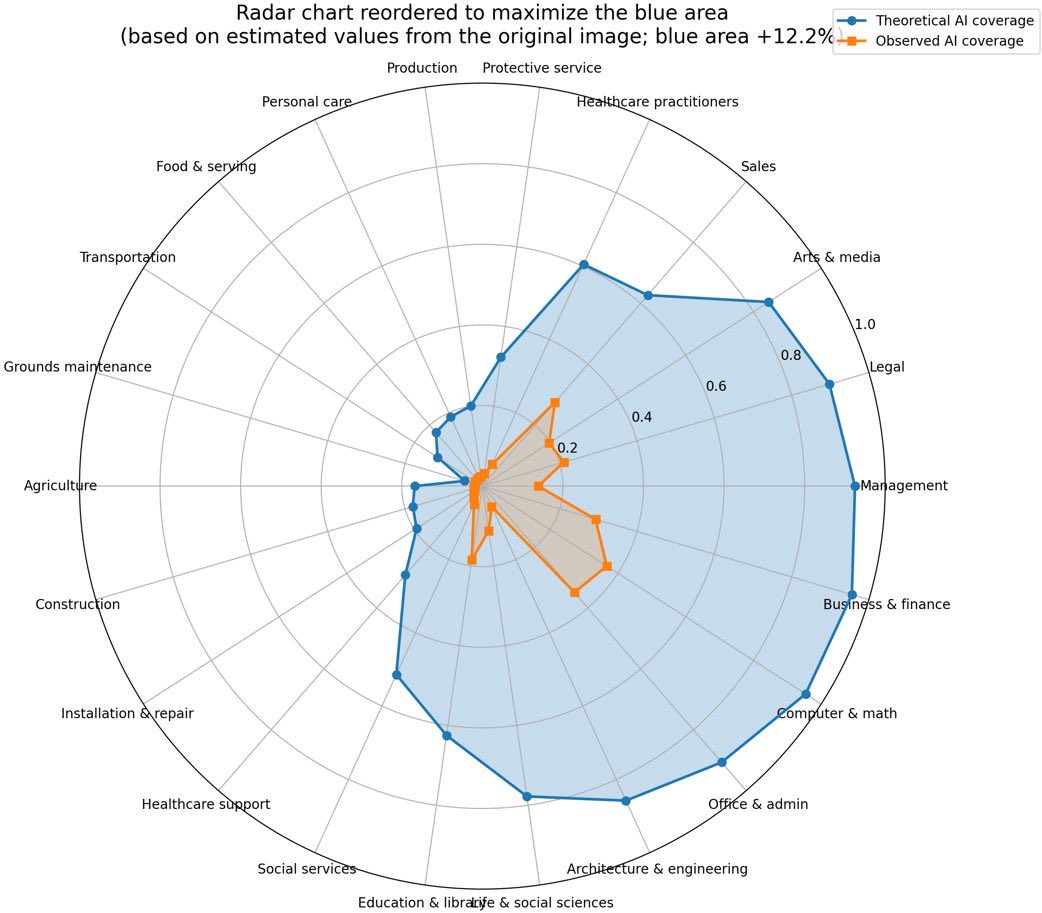

Striking image from the new Anthropic labor market impact report.