Flamme-Demon

6K posts

La France a parmi les meilleurs mathématiciens et ingénieurs IA du monde. On le sait. On les embauche partout ailleurs. Et la première chose qu'on fait au moment où on pourrait enfin capitaliser dessus ? On vote une loi qui transforme l'entraînement d'un modèle sur sol européen en parcours du combattant juridique. À l'unanimité. Avec le sourire. Le 8 avril 2026, le Sénat adopte la proposition de loi Darcos-Evren-Ouzoulias. Nouvel article L. 331-4-1 du Code de la propriété intellectuelle. Mécanisme : présomption d'utilisation des contenus culturels par les systèmes d'IA. Dès qu'un indice (développement, déploiement ou output) rend l'usage d'une œuvre protégée « vraisemblable », c'est à l'entreprise de prouver qu'elle ne l'a pas exploitée. Inversion de la charge de la preuve. Sur le papier, c'est « David contre Goliath ». Dans les faits, c'est surtout « Goliath américain et chinois qui s'en fout » contre « Mistral et les boîtes européennes qui jouent encore le jeu du sol ». Soyons clairs : les présomptions existent en droit, c'est un mécanisme connu. En matière de contrefaçon, ça fonctionne. Mais ici, on parle de prouver un négatif sur des datasets de centaines de milliards de tokens. La question n'est pas de savoir si c'est juridiquement possible en théorie. La question, c'est le coût de conformité, l'incertitude massive et le risque juridique concret que ça fait peser sur tout acteur qui entraîne ou déploie en Europe. Rien que ce risque suffit à décourager l'investissement. Et c'est exactement ce qui va se passer. Maintenant, posons le problème de fond : l'extraterritorialité. Une boîte américaine ou chinoise peut entraîner son modèle chez elle, sur n'importe quelles données, sans contrainte, puis venir vendre ses services en Europe. Une boîte française qui veut faire la même chose subit toute la contrainte sur son sol, avec ses données, avec ses capitaux. Le résultat est prévisible : les acteurs étrangers captent le marché européen sans friction, les acteurs locaux portent seuls le poids de la conformité. C'est exactement le piège de la régulation asymétrique. On crée un avantage compétitif pour ceux qu'on prétend combattre. OpenAI, Google, Meta ont entraîné leurs modèles frontier massivement sur le web ouvert entre 2022 et 2025. C'est un fait documenté, contesté en justice : le NYT a attaqué OpenAI, Getty a attaqué Stability AI, les procès sont en cours. Ce n'est pas que personne n'a réagi. C'est que la régulation arrive quatre ans après les faits, mal calibrée, et qu'elle ne touche pas ceux qui ont déjà engrangé l'avantage. Les modèles sont entraînés. Les poids sont dans la nature. C'est fini. Et c'est là que le décalage avec la réalité technique devient vertigineux. En 2026, sur un PC à 2 000 euros, n'importe qui fait tourner Qwen 3.5, Gemma4, GLM en local. Niveau frontier de 2024/2025 voir 2026. Sans garde-fous, sans journal de bord, sans rien. Les modèles sont open, distillés, parfois « obligatered » : sans aucune restriction. Demande à Gemini de reproduire une œuvre, il te dira non. Télécharge un modèle open en local, tu fais ce que tu veux. La loi ne touche pas ça. Elle ne touche que ceux qui déclarent leur activité en Europe et qui veulent scaler légalement. On pénalise la transparence. Ce n'est plus une affaire de « géants de l'IA » contre les créateurs. La démocratisation est totale. Le narratif « Big Tech pille les artistes » était peut-être pertinent en 2022. En 2026, c'est une grille de lecture obsolète qui ignore la réalité du terrain. La vraie mesure utile serait d'imposer aux modèles fermés qui opèrent en Europe des garde-fous anti-copie stricts c'est là que le levier existe, c'est là que l'enforcement est possible. Pas de compliquer l'entraînement pour tout le monde. Parlons de qui cette loi protège vraiment. On nous dit « les créateurs ». Les artistes face au pillage. Mais quand on regarde de plus près, les bénéficiaires ne sont pas les créateurs indépendants. Ce sont les sociétés de gestion collective historiques (CNC, SACEM), les lobbys culturels qui défendent un modèle économique du XXe siècle face à une technologie qui compresse le temps de création par un facteur 1000. Un youtubeur qui conjugue IA et création humaine ? Il n'est pas protégé par cette loi. Il est dans le viseur ou menacé indirectement. Un créateur indépendant qui nourrit son process avec du prompting ? Pareil. La loi protège le statu quo culturel, pas la création de demain. Le modèle de rémunération des créateurs doit évoluer, c'est une évidence. L'IA compresse en quelques minutes ce qui prenait des mois. Il n'y a pas de bouton pour revenir en arrière. Mais la réponse n'est pas de bloquer la technologie avec des lois qui ne s'appliquent qu'à ceux qui jouent le jeu. La réponse, c'est de construire un mécanisme de redistribution qui fonctionne dans le monde tel qu'il est, pas tel qu'on voudrait qu'il soit. Et justement, cette réponse existe. @MistralAI l'a posée sur la table. Mistral, le seul champion français de l'IA presque frontier. La boîte qui vient de lever 830 millions de dollars pour construire ses data centers près de Paris. Arthur Mensch, son CEO, a publié le 20 mars dans le Financial Times une tribune proposant une contribution obligatoire de 1 à 5 % du chiffre d'affaires des fournisseurs d'IA opérant en Europe, versée dans un fonds européen destiné à indemniser les créateurs. Transparente. Mesurable. Appliquée à tout le monde y compris les Américains et les Chinois qui vendent ici. C'est de l'équilibre économique réel. Ça finance la création sans tuer l'entraînement. Ça résout le problème d'extraterritorialité parce que la contribution s'applique au chiffre d'affaires réalisé en Europe, pas au lieu d'entraînement. On a préféré la présomption de culpabilité. Maintenant, zoomons arrière. Parce que le sujet des auteurs, c'est une toute petite partie de l'iceberg. L'IA, c'est une révolution. Pas un sujet de commission parlementaire entre deux cafés. C'est la plus grande redistribution de puissance technologique depuis Internet. Pendant qu'on débat de « pillage » et de « chalutage des contenus », la Chine forme des armées de robots autonomes, les États-Unis signent des contrats défense à 20 milliards avec Anduril et Palantir, et les labos chinois distillent les modèles américains pour les retourner contre eux. Nous, on en est encore à se demander si l'IA est « vraiment intelligente ». Le décalage entre la réalité technique et la compréhension qu'en ont ceux qui légifèrent est abyssal. Et je pèse mes mots. Quiconque a passé un weekend avec un modèle frontier un GPT-5.4 un opus4.6 à 200 dollars par mois sait que ce n'est pas un gadget. >>> C'est un accélérateur cognitif qui change fondamentalement la manière dont on travaille, dont on crée, dont on raisonne. -> Voter une loi sur l'IA sans avoir jamais poussé un de ces modèles dans ses retranchements, c'est comme réguler l'automobile en n'ayant jamais conduit. La France a une carte exceptionnelle. Le talent mathématique. L'énergie nucléaire pour alimenter les data centers. Une volonté de souveraineté qui, parfois, se traduit en actes concrets. Mais à chaque révolution technologique, on fait la même erreur : on protège d'abord les rentes du passé au lieu de construire les champions de demain. Et le résultat est toujours le même : on forme les meilleurs ingénieurs, qui partent chez Google, OpenAI ou Anthropic. La mondialisation a déjà bouffé nos boîtes malgré une révolution industrielle plutôt réussie. Nos entreprises n'ont pas eu le réflexe d'aller à l'étranger, de mettre en jeu leur IP, de jouer la compétition mondiale. On a préféré rester dans notre petit marché, protégés par nos petites lois. Et quand le train est passé, on a regardé. Celui-là ne repassera pas. Quand tu sabotes le process d'entraînement, tu sabotes les marges. Tu sabotes l'innovation. Tu sabotes l'intégration verticale. C'est le même principe que dans le manufacturing : celui qui contrôle le process contrôle les marges et la souveraineté. Tesla l'a compris avec ses Gigafactories. Apple l'a compris avec ses puces. Et nous, on fait exactement l'inverse. On met des bâtons dans les roues de nos propres constructeurs pendant qu'on continue de signer des chèques à Palantir pour nos besoins en données stratégiques. On fait fuir les entrepreneurs. On fait fuir les talents. On fait fuir les sachants. Et quand on n'aura plus que les yeux pour pleurer, on continuera d'applaudir les lois votées à l'unanimité en se demandant pourquoi on est à la traîne. Ce n'est pas David contre Goliath. C'est la France qui se tire une balle dans le pied, toute seule, avec le sourire, à l'unanimité, en se disant qu'elle protège la culture française. La solution adulte était sur la table : contribution sur le CA, appliquée à tous, garde-fous anti-copie stricts sur les modèles fermés. Pas une présomption qui transforme tout développeur européen en suspect par défaut et qui ne change rien pour le type qui fait tourner un modèle open en local sur son PC. Contrôle du process ou dépendance éternelle. On est en train de choisir la seconde. Réveillez-vous.

Une des nombreuses raisons qui font que ChatGPT ni aucune autre IA ne pourra remplacer un avocat : il n'y a aucune confidentialité dans vos échanges avec l'IA. (Et cela devrait faire aussi réfléchir les avocats y ayant recours).

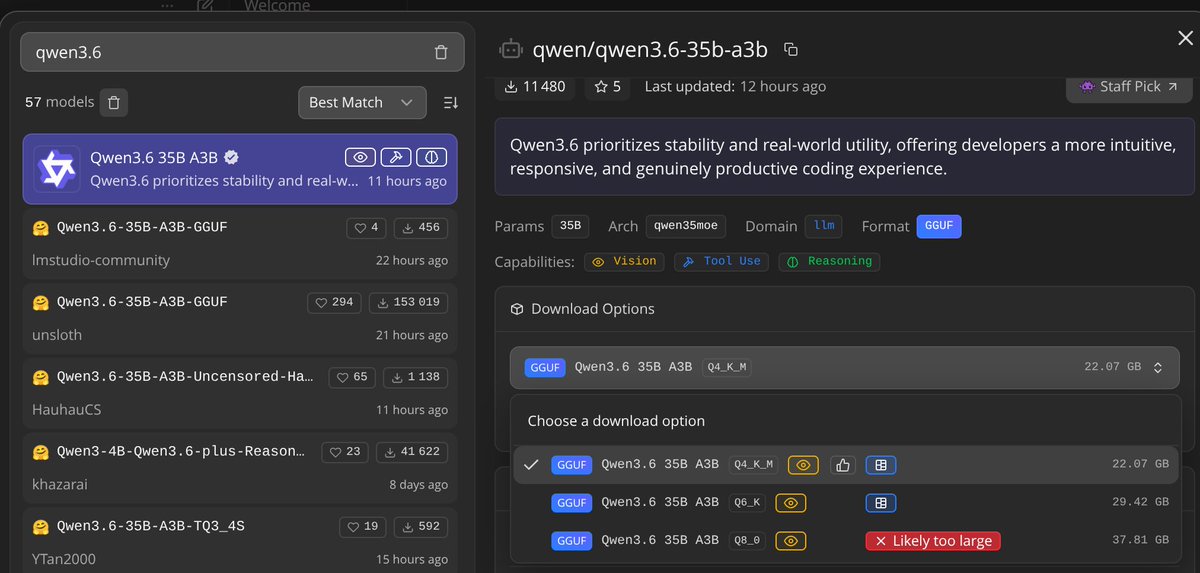

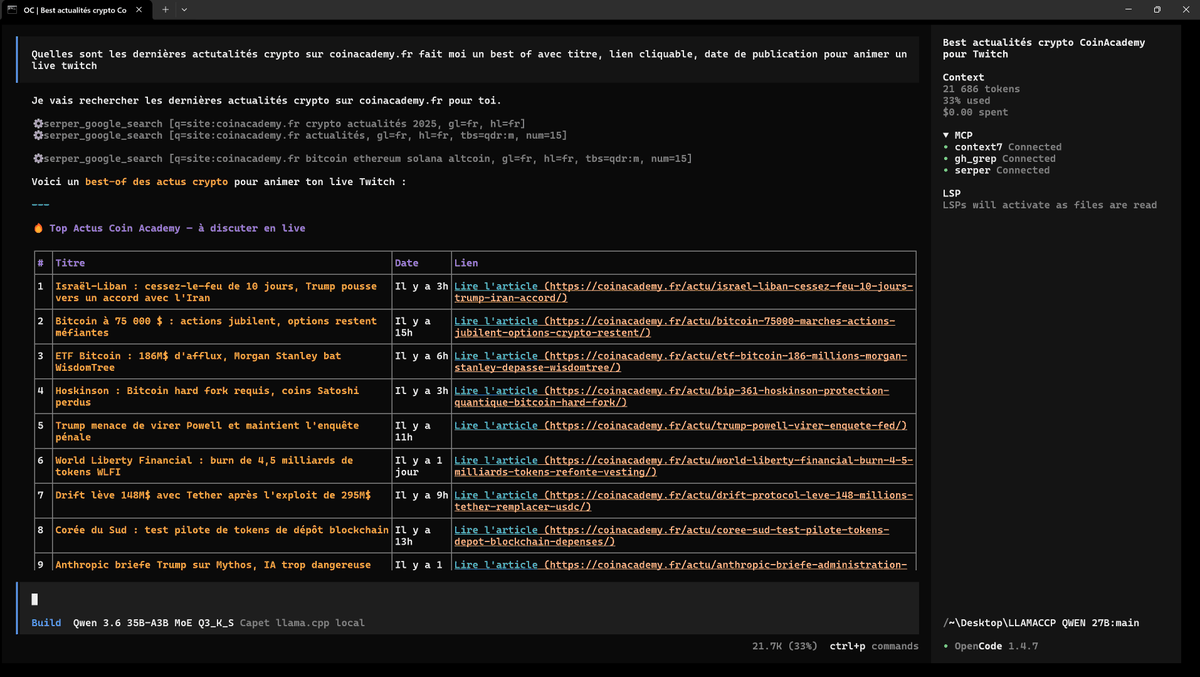

Plus je passe de temps à me renseigner sur l'IA en local et plus je trouve ça goatesque et passionnant et qu'on soit bien d'accord je m'autoproclame pas expert sur le sujet Mais l'année 2026 c'est l'année de l'IA en local ça va être un changement de dimension Je suis extrememnt bullish et il y a boire et à manger : des setup très simples avec OLLAMA au plus complexe avec LLAMACCP, LM STUDIO ou ExLlama v3 (que j'ai découvert aujourd'hui) Je suis bull car on va voir de nombreux modèles open source se focus sur des usages précis et ça va permettre à de nombreux secteurs d'activités de gagner en efficacité. On peut faire tourner de super modèles sur RTX 5090 / 4090 / 3090 et sur des Mac, pas besoin d'avoir un setup à 10000$ maintenant, cela devient vraiment accessible. On en parlera probablement en LIVE demain et lors de la Masterclass dimanche. Je continu de poncer le sujet en attendant.