Root Rat

34.8K posts

Root Rat

@root_rat

IT nerd 🖥️. Ex pisaplayas y 🔱. Rajadas, opiniones personales y shitposting. Gracias a Twitter, ahora tengo un pódcast.

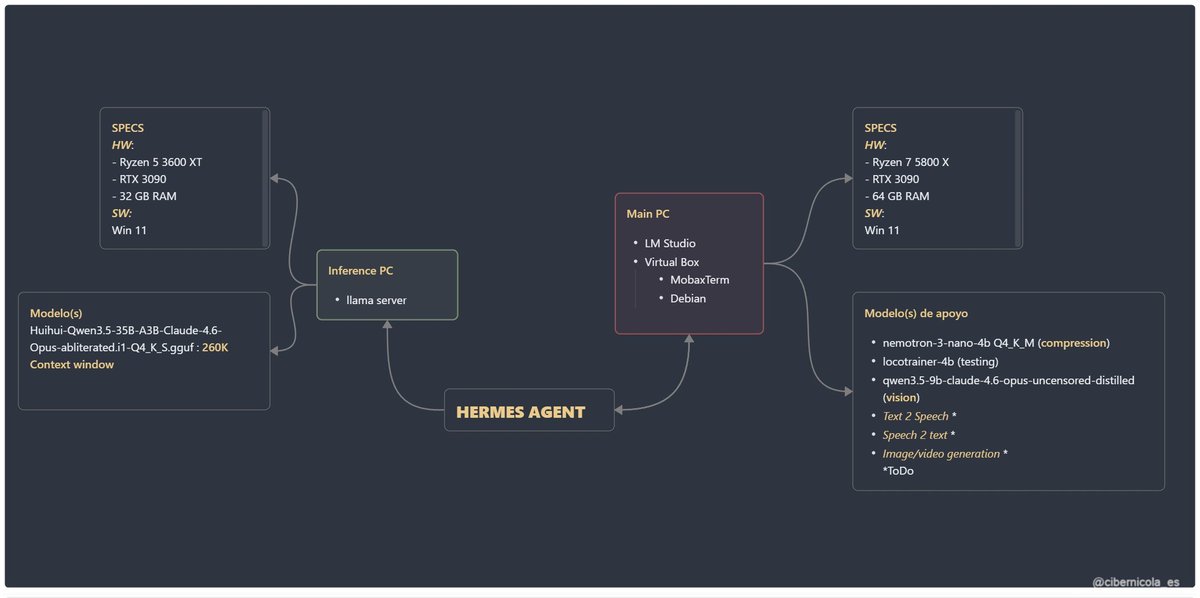

Terminando el sistema ya en serio, fuera del modo POC. Mañana vídeo con hilo de cómo funciona todo. Bastante virguero, 100% local, y con IA solo donde hay que usarla. Últimamente veo mucho esa filosofía de que el agente lo haga todo a pura fuerza bruta con modelos frontier. Me parece un error. Hay cosas en las que no necesitamos que el modelo haga absolutamente nada, y forzarlo igualmente es simplemente mala ingeniería. Como hablaba ayer en el podcast con Pau y @Poliorcetes: sistemas IA de guerrilla, optimización de recursos y capa de control. Ingeniería de software de siempre, pero con cositas golosonas a mayores que resuelven problemas que antes era imposible abordar desde un enfoque determinista. En este caso concreto, la selección de clips según qué diálogo se está teniendo, con condiciones preestablecidas, consiguiendo que el corte final quede como gancho que invite a ver el vídeo completo. Eso sí necesita modelo. El resto, no.

Pablo Echenique se sentará en el banquillo por un tuit de abusos en la Iglesia. theobjective.com/espana/tribuna…

📢 Os dejo un artículo de El País de @jordipc en el que he colaborado, donde se habla del estación de números V32 en farsi, aparecida recientemente coincidiendo con el inicio del conflicto en Irán: elpais.com/tecnologia/202…

Han tirado un B-12. Con un misil Ruca.