Tweet fijado

Itaru Tomita / 冨田到

5.8K posts

Itaru Tomita / 冨田到

@itarutomy

リサーチや研究開発向けの生成AIエージェント @snorbe_ai を作っています。 https://t.co/AC4vjFWlLR @deskrex | かんき出版『知的生産でAIを使いこなす全技法』12/17発売→重版! https://t.co/3ZTHROXGlV

Se unió Ocak 2018

467 Siguiendo1.5K Seguidores

Itaru Tomita / 冨田到 retuiteado

How I get my claw to be a durable AI agent I never have to instruct twice

Paste this into your OpenClaw's AGENTS.md or send it as a message:

You are not allowed to do one-off work. If I ask you to do something and it's the kind of thing that will need to happen again, you must:

1. Do it manually the first time (3-10 items)

2. Show me the output and ask if I like it

3. If I approve, codify it into a SKILL.md file in workspace/skills/

4. If it should run automatically, add it to cron with `openclaw cron add`

Every skill must be MECE — each type of work has exactly one owner skill. No overlap, no gaps. Before creating a new skill, check if an existing one already covers it. If so, extend it instead.

The test: if I have to ask you for something twice, you failed. The first time I ask is discovery. The second time means you should have already turned it into a skill running on a cron.

When building a skill, follow this cycle:

- Concept: describe the process

- Prototype: run on 3-10 real items, no skill file yet

- Evaluate: review output with me, revise

- Codify: write SKILL.md (or extend existing)

- Cron: schedule if recurring

- Monitor: check first runs, iterate

Every conversation where I say "can you do X" should end with X being a skill on a cron — not a memory of "he asked me to do X that one time."

The system compounds. Build it once, it runs forever.

English

Itaru Tomita / 冨田到 retuiteado

大変なことが起きました。なんと先日、ガーナの大統領が二郎系ラーメンを食べてくれました…!!!

それもなんと、マハマ大統領は夜は炭水化物を取らない主義らしく、麺抜きでの注文。二郎系(麺抜き)を一国の大統領が食べる時代がやってきました。

Kento Sekine | 唐揚げ屋さん@kento_sekine

ガーナで二郎系ラーメン屋、はじまりました。

日本語

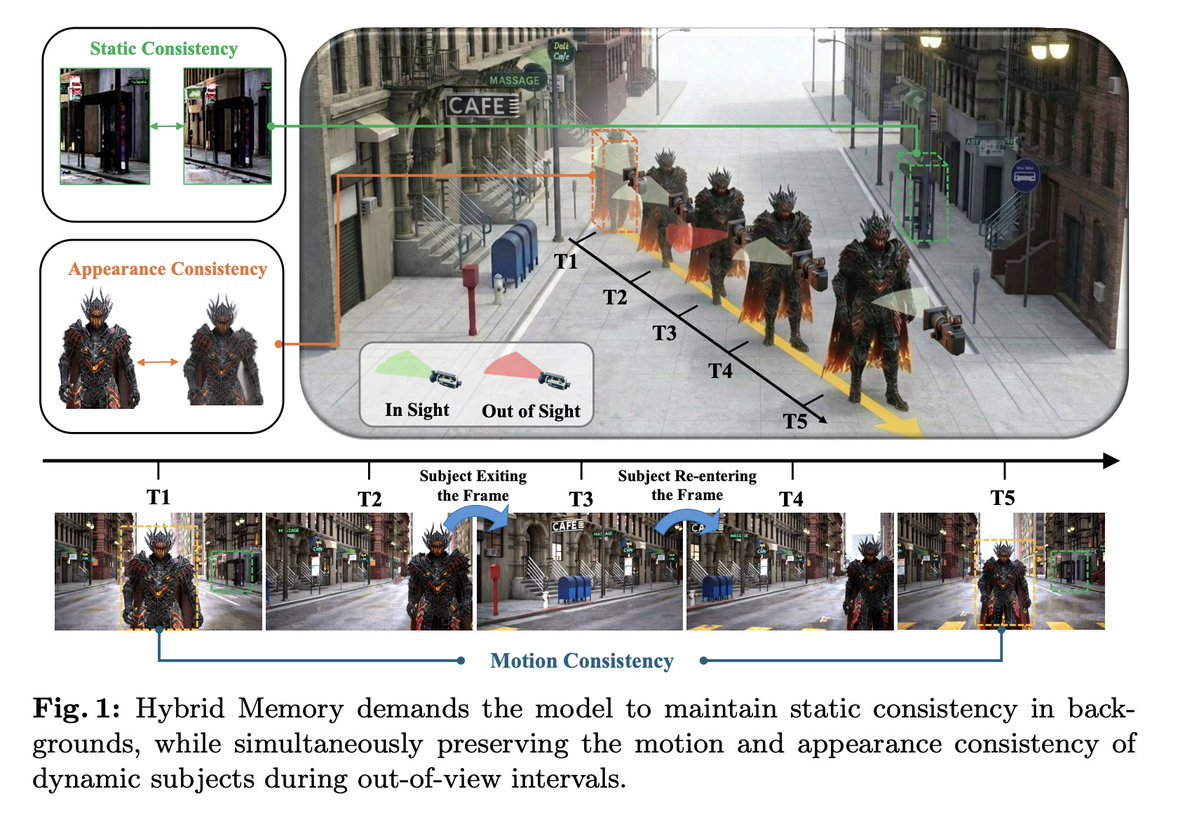

「見えなくなった被写体の軌道を予測しながら記憶する」という発想が、商用モデルを超えるほど重要だった。

arxiv.org/html/2603.2571…

日本語

動画生成AIの弱点、わかる?

カメラが横に動いて、一時的に人物や動物が画面外に消えた瞬間、多くのモデルは「その存在を忘れて」しまう。再登場時は動かない幽霊みたいに固まるか、形が崩れるか、最悪「消滅」する。

この問題、根本にあるのは記憶の設計思想だった。従来のビデオ世界モデル(現実世界をシミュレートしながら一貫した動画を生成するAI)の記憶機構は「世界は静止したキャンバス」として設計されている。建物や道路など動かない背景は得意だが、自律的に動く被写体(歩行者・動物)を追いかける発想がそもそもなかった。

今回の論文が提案する「Hybrid Memory(ハイブリッドメモリ)」はその根本を変える。背景の一貫性を保ちながら、見えなくなった被写体の軌道を内部で予測し続ける。論文タイトル通り「Out of Sight, but Not Out of Mind(見えなくなっても、忘れない)」な記憶能力だ。

具体的なアーキテクチャが「HyDRA(Hybrid Dynamic Retrieval Attention)」。2つの仕組みで構成される。

ひとつは「Memory Tokenizer(記憶の圧縮器)」。過去フレームを3D畳み込みで圧縮して「記憶トークン」を作る。3Dというのはタテ・ヨコに加えて「時間軸」も含めて処理するという意味で、この時間軸の処理を省くとPSNR(画像の再現精度を表す指標)が1.281も下がることがアブレーション実験で確認されている。動きの文脈を圧縮しているかどうかが肝心だということだ。

もうひとつは「Dynamic Retrieval Attention(動的検索アテンション)」。被写体が再登場する直前に、膨大な記憶トークンの中から「この場面に最も関連する記憶」を動的に絞り込む。比較手法のFOVベース検索(カメラの向きが近いフレームを選ぶやり方)では被写体一貫性スコアが0.908にとどまるのに対し、HyDRAの特徴量レベルで相関を計算する動的な選び方は0.926を達成した。取得トークン数が5個だと情報不足でキリンを2頭幻覚生成してしまう失敗例もあり、10個で安定することも確認されている。

トータルの効果を数字で見ると、ベースライン(カメラエンコーダだけ追加した同構成)のPSNRは18.696で、DFoT(隣接フレームのコンテキストウィンドウを使う手法)は17.693、Context-as-Memory(視野角の重なりで検索する手法)は18.921。HyDRAはこれらをすべて上回り、20.357を記録した。市販の商用モデルWorldPlayとのゼロショット比較でも全指標で上回り、PSNRで5.502の差をつけた。

学習には新たに構築した「HM-World」データセットを使用。Unreal Engine 5で生成した59,225本の高品質クリップに、17シーン・49種の被写体・28種のカメラ軌道を収録。自然動画では捉えにくい「被写体の出入りシーン」を大量に用意した。

日本語

Itaru Tomita / 冨田到 retuiteado

Itaru Tomita / 冨田到 retuiteado

oss界隈が1週間後に追いついて、モデルの制約なく使えるようになるの待ちたいね。OpenCodeとか、頼みます!

逆瀬川@gyakuse

Claude Managed Agent ・サーバーで動かすClaude CodeライクなAgentハーネス ・Claude Agent SDKを使ってe2bとかでhostingしてAPIサーバー立てればほぼ等価なことできるけど(Outcomesは要自作)、その面倒くささが吸収された ・コンテナ(8GB RAM / 10GB disk)は$0.08/h, idle / permission待ちは無料

日本語

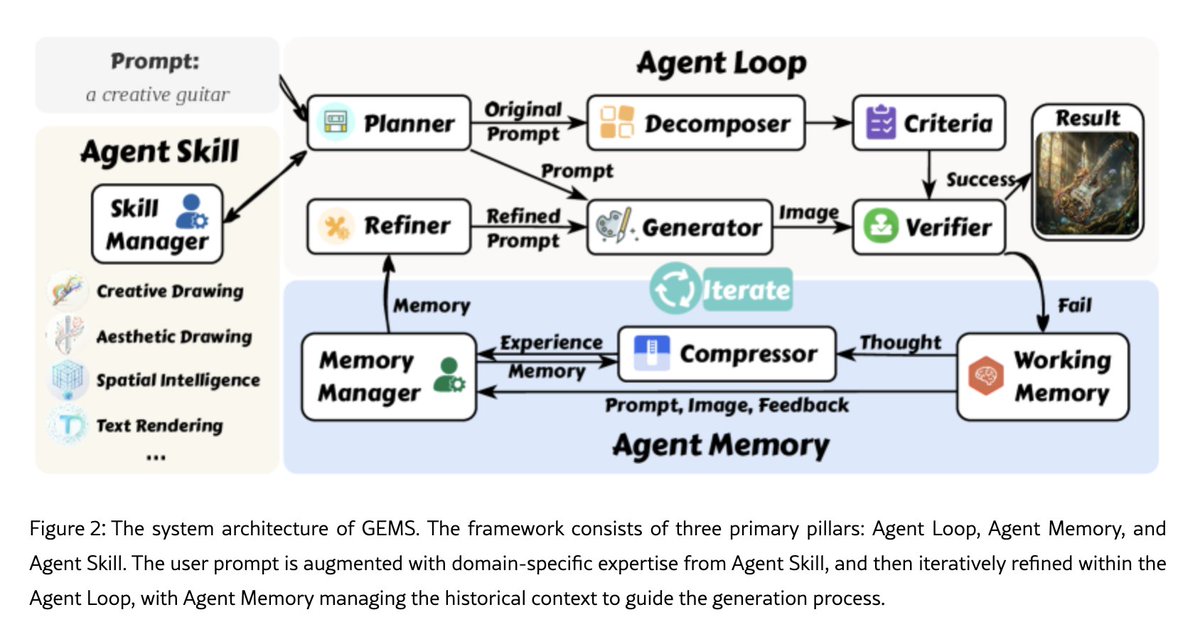

モデルを大きくするより、小さいモデルに「思考と記憶のループ」を組み込む設計のほうが効く場面が増えてきたかもしれない。

arxiv.org/html/2603.2808…

日本語

テキストから画像を生成するAIに「エージェント設計」を組み込んだら、6Bの軽量モデルが最強クラスの大型モデルを超えた。

GEMS(Agent-Native Multimodal Generation with Memory and Skills)という研究。Claude Codeのようなエージェントフレームワークにインスパイアされたと論文中に明記されている。

構成は3モジュール。

Agent Loop(反復改善ループ)はまずプロンプトを「赤い帽子が猫の左にある」のような個別確認できる条件に分解し、生成した画像を1項目ずつ採点して不合格部分だけ直す、を繰り返す。単なる「複数回生成して一番良いのを選ぶ」より根本的に違う設計で、GenEval2(画像生成の難易度の高い評価ベンチマーク)での達成率が反復のたびに62.2%→71.4%へ着実に上がった。

Agent Memory(階層圧縮メモリ)が特に面白い。「プロンプト・生成画像・採点結果」の事実データはそのまま保存するが、思考ログ(AIが自分の判断プロセスを書き出したテキスト)は圧縮して教訓として保存する。思考ログを丸ごと詰め込んだ場合と比べて、圧縮した教訓だけ残す設計のほうがスコアが+2.5点高かった。「情報は多いほど良い」が成り立たないケースで、生ログはノイズになる。

Agent Skill(専門スキルの必要時読み込み)はMarkdownファイルを置くだけで「テキスト描画」「空間表現」などの専門ノウハウをスキルとして登録でき、関連タスクが来たときだけ読み込む。汎用的なプロンプト書き換えだけのベースラインは文字描画タスクで逆に精度が落ちた(ドメイン知識なしで最適化すると肝心の文字情報が壊れる)が、専門スキルを使うとそれも解決した。

アブレーション結果:素のモデルが31.0→Agent Loop追加で52.4→Agent Memory追加で61.4→Agent Skill追加で63.5。この63.5がSOTA(最高水準)のNano Banana 2を超えた。主要5ベンチマーク平均+14.22点、専門4タスク平均+14.03点の改善。

日本語

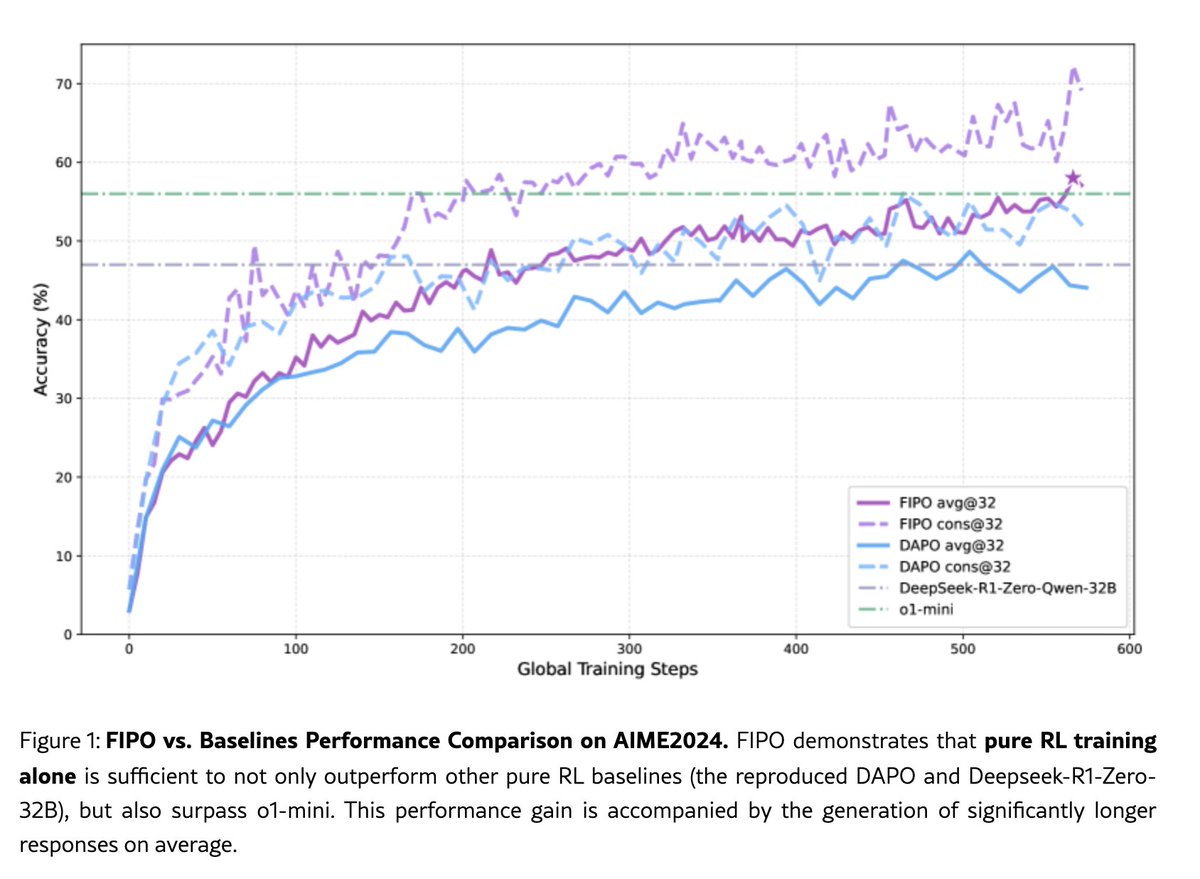

全ての思考ステップを「平等」に扱う設計が、AIの推論の天井を作っていたかもしれない。

arxiv.org/html/2603.1983…

日本語

AIに数学の難問を解かせる学習に、盲点があった。

DeepSeek-R1などのAIは「正解・不正解のフィードバックを何千回も繰り返して鍛える」強化学習で推論力を磨いている。でもその代表的な手法には問題がある。「正解できた/できなかった」という結果を、思考の全単語に均等に振り分けてしまうこと。「えっと」「の」という助詞も、「この前提は間違っている、やり直そう」という論理の転換点も、全部同じ重みで学習させる。

実際には、AIが長い思考を生成するとき、強化学習が本当に「次の言葉の選び方」を変えるのはステップ全体の2%未満だけ。残り98%超は「流れに乗るだけ」の言葉だ。この急所を際立たせられないから、思考の深さが中途半端なところで止まってしまう。

FIPOはここを変える。各単語に「これを選んだことで、後に続く思考の流れがどれだけ変わるか」を測り、影響が大きい単語ほど強く学習させる。「思考の分岐点を自動的に重視する」設計だ。

他の改善手法では「各思考ステップの良し悪しをリアルタイムで評価する、専用のサブAI」を別途用意する必要があり、そのサブAI自体の学習コストとデータが余分にかかる。FIPOはそれが要らない。AIが自分で生成した思考の流れだけから、どの単語が重要かを自動的に算出できるからだ。

Qwen2.5-32B-Baseで試すと、思考の平均的な長さが従来手法の約4,000単語相当から10,000単語超へ継続的に伸び、AIME 2024(全米の高校生が参加する競技数学の難問コンテスト)の正解率が50.0%から56.0%(収束値)に。ピーク時は58.0%を記録し、DeepSeek-R1-Zero-Math-32B(47.0%)もo1-mini(56.0%)も上回った。

特に面白いのが付録の事例研究だ。従来手法のAIは「方程式を立てて解く」という一つのアプローチで答えを出したらそこで終了だった。一方、FIPOで鍛えたAIは「今度は図形的に考えて本当に合っているか確かめ、さらに数値を1ステップずつ手作業で検算する」まで自然にやり始めた。答えを出した後で「本当に合ってる?」と自分で疑い始めた、という変化だ。「長く考えていい」と学習したら、自分で答えを検証する習慣まで生まれた。

日本語

「自動評価では強いのに人間評価では負ける」という逆転現象が起きていた。ElevenLabs Flash v2.5がその典型で、スコアは良くても人間はElevenLabs v3を好んだ。音声合成の評価指標がまだ成熟していないということかもしれない。

arxiv.org/html/2603.2555…

日本語

Mistral AIが音声合成モデル「Voxtral TTS」を公開した。たった3秒の音声サンプルから話者の声を再現できるモデルで、ElevenLabs Flash v2.5との多言語ゼロショット音声クローニング対決で68.4%の勝率を記録している。

設計で面白いのはハイブリッドアーキテクチャだ。音声には「何を言っているか(意味)」と「どんな声か(音響)」の2つの情報がある。VoxtralはこれをChatGPTと同じAR(自己回帰)方式とFlow-Matchingという別々の技術で生成する。Flow-MatchingはStable Diffusionに近い考え方で、ランダムなノイズから目的の音声へ「流れ」を学習させる手法。並列処理に近い形で動くのでARより速い。

同じ役割でMaskGITやDepth Transformerとも比較したが、特に感情表現の豊かさでFlow-Matchingが最も優れていた。計算量でも有利で、MaskGITがフレームあたりシーケンス長38を要するのに対しFlow-Matchingは3、Depth Transformerが36ステップのARを要するのに対しFlow-Matchingは8回の関数評価で完結する。

音声をトークンに変換する「Voxtral Codec」(約300Mパラメータ)も独自開発している。2.14kbpsという低ビットレートながら、同等ビットレートのMimi(Moshiで使われるコーデック)を全自動評価指標で上回った。WhisperのASR中間表現を蒸留して意味を学習させており、転写テキストや外部アライナーなしに音声とテキストの対応を学習できる。

ElevenLabs Flash v2.5との多言語ゼロショット音声クローニング対決(人間評価、勝率):

- 全体: 68.4%

- スペイン語: 87.8%

- ヒンディー語: 79.8%

- アラビア語: 72.9%

- 英語: 60.8%

- オランダ語: 49.4%(拮抗)

高資源・低資源言語ともに強く、汎化性能の高さが出ている。スピーカー類似度(声の再現精度)は英語でVoxtral 0.786に対しElevenLabs v3は0.484、Flash v2.5は0.489とほぼダブルスコアだ。

意外だったのが自動評価と人間評価の逆転。WERやUTMOSではElevenLabs Flash v2.5が強く見えるのに、人間評価ではElevenLabs v3の方が高評価になる。論文でも「UTMOSは緩いプロキシにすぎない」と明記している。Gemini 2.5 Flash TTSが全体で最強で、implicit steering設定での勝率は37.1%と歯が立たないことも正直に書いている。

DPOでドイツ語WERが4.08%→0.83%と劇的改善。ただしヒンディー語は3.39%→4.99%と悪化する副作用もある。推論ではH200 1枚で同時32ユーザー・スループット1,430文字/秒を達成。CUDA Graphで遅延を133ms→70msに47%削減している。

9言語対応。CC BY-NCで重みを公開済み。

日本語

35Bの小型オープンソースモデルでも、実行経験を汎用スキルに蒸留して大型モデルを上回れる、かもしれない。

arxiv.org/html/2603.2515…

日本語

Anthropicが公式に作ったxlsxの「スキル文書」がある。xlsxのタスクの進め方・注意点・失敗パターンをまとめたMarkdownの手順書で、エージェントのシステムプロンプトに読み込ませると性能が上がる。Qwen3.5-122Bに使わせるとSpreadsheetBenchで+20pp改善した。

ところが同じスキルをQwen3.5-35Bに渡すと-9.3ppと逆効果になった。スキルの品質ではなく、モデルとの「相性」の問題だ。

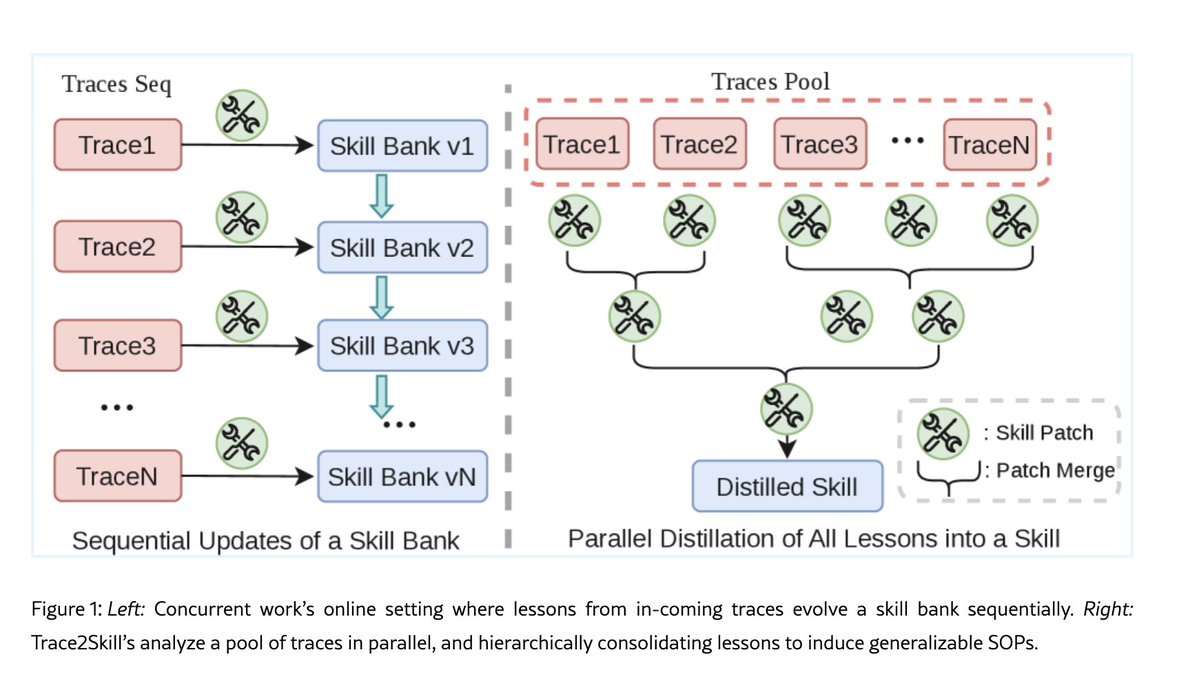

Trace2Skill(Alibaba)はこれを解決するフレームワーク。エージェントに200件のタスクを実行させ、その軌跡(思考・行動・結果の記録)を128個のサブエージェントが並列で分析してパッチを提案、全提案を階層的に統合してスキルを自動進化させる。

核心は「並列」にある。従来の逐次更新は直近の軌跡に引きずられるが、Trace2Skillは全軌跡を一気に分析して複数回出現するパターンだけを帰納的に残す。特定モデルや特定タスクの癖ではなく、本質的なSoP(標準作業手順)が浮かび上がる仕組みだ。

実際にスプレッドシートタスクの分析では323件のパッチから「数式書き込み後にrecalc.pyで再計算確認」(178件で共通)、「書き込みはpandas.to_excelでなくopenpyxlを使え」(177件)などが自動抽出された。人間の専門家なら経験で気づくことを、軌跡分析が自動で発見した。

結果が驚きの連続だ。Qwen3.5-35Bが自分の軌跡から作ったスキルをQwen3.5-122Bに使わせると、WikiTableQuestionsで+57.65pp改善し、Anthropic公式スキルの74.68%を超える81.38%に到達。スプレッドシートで鍛えたスキルが数学(AIME 2026)やDocVQAにも転移する。処理速度は逐次更新(60分)の20倍速い3分。パラメータ更新もRAGも不要。

もう一つ面白い発見がある。DocVQAではスキルなしで35B(ANLS 0.6843)が122B(0.6424)を上回るのに、スキルを執筆させると122Bが圧倒した。「タスクをこなす能力」と「失敗パターンを分析してルール化できる能力」は別物らしい。

日本語

Itaru Tomita / 冨田到 retuiteado

some more ramblings from working at @AnthropicAI.

I've been asked a few times what the single most important thing a growth marketer should be doing with AI that most aren't.

surprise, it's not just a single specific task. after running dozens of growth workflows through Claude, I think the useful stuff worth doing falls along four dimensions 🧵

English