콜 COLE

294 posts

콜 COLE

@JWMoonX

미장 투자함. AI랑 기술도 놓치기 싫은 사람. 관심사가 너무 많음.

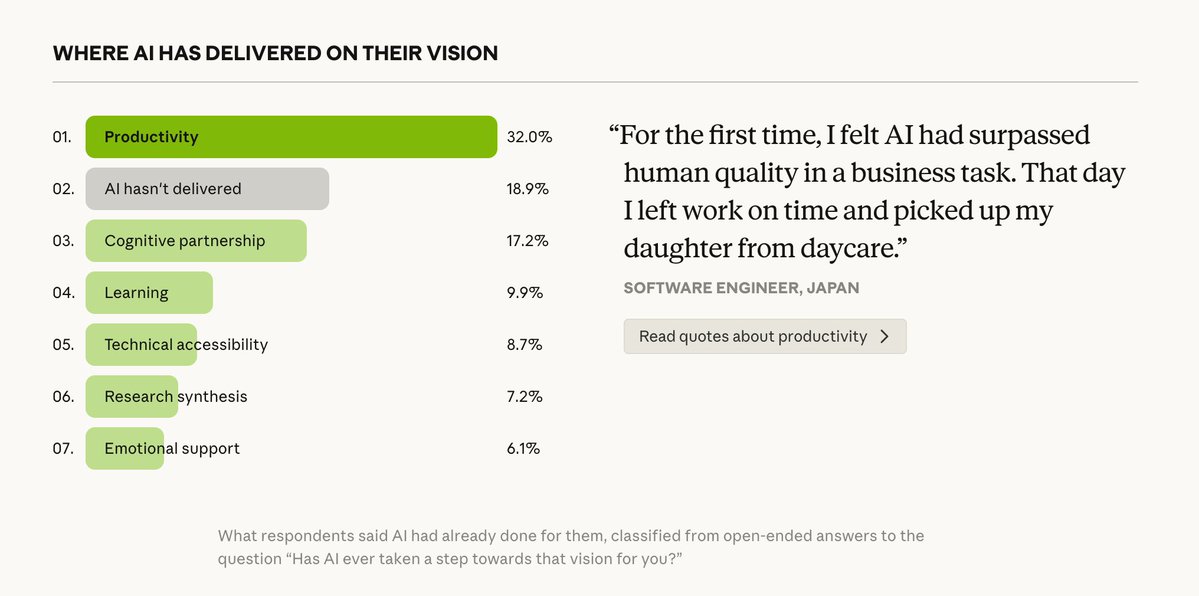

고액연봉 전문직으로 알려진 회계사들이 거리에서 북치며 시위중임 요즘 기업들이 AI때문에 신입 회계사들을 뽑지 않아서 취업하기가 하늘에 별따기라고 함 AI 발전으로 줄어드는 직장이 앞으로는 더 많아질 전망인데, 다들 본인 일자리는 안전한지 점검 한번씩 해봐야 할지도 모르겠음🥹

A Chinese engineering student built a weather tracking station in his dorm. Three Mac Minis. Two monitors. Satellite maps on both screens. Labels on each box: UI/UX. DEV. ADMIN. Total cost under $2,000. His roommate thought it was a climate research project. His professors thought it was a thesis prototype. He let everyone keep thinking that. Then someone noticed what the station was actually connected to. A wallet. Making $101K. Betting on the temperature. ColdMath. $101,042 profit. 5,252 predictions. Joined November 2025. Bio: Edge Compounds. → @ColdMath?via=carverfomo" target="_blank" rel="nofollow noopener">polymarket.com/@ColdMath?via=…

The station does one thing. Claude pulls live pilot weather data. Real sensors. Real readings. Updated every 1-3 hours from stations worldwide. Compares it to prediction market prices. When they don't match the DEV box flags it. Mismatch found. He places the trade. Green result. $25 on Tokyo hitting 16C on March 20. Payout: $12,452. $24 on Chicago reaching 54F on March 11. Payout: $12,398. $13 on Lucknow hitting 39C on March 7. Payout: $6,850. Twenty five dollar bets returning twelve thousand. On the weather. A friend who flies commercial told him pilots get atmospheric data hours before any public forecast. Temperature to a tenth of a degree. This data is free. Aviation safety requires it. Nobody outside of aviation even looks at it. He looked. Pointed Claude at the feeds. Said: find me every city where the forecast doesn't match the price. Claude found dozens. Every single day. His roommate saw the station running one morning and finally asked what it actually does. The student showed him the balance. The roommate didn't say anything. Just asked for a second monitor. 34K people watching. $96K still loaded in active positions. Three Mac Minis. Two screens. One quiet kid who realized the most predictable thing on Earth is the thing everyone ignores. The weather.

$IREN x @Lenovo x $DELL My new theory. First: 1. Dan said on our space(1) 2 weeks ago: "you can certainly buy GPUs outside of $NVDA, and in fact we do, you buy them through the OEMs". 2. He also said that the new 10MW IT load data center in Prince George may be deployed as liquid-cooled for the "1,000" GB300s (1,200 actually bought, rounded down), or installed as air-cooled. "but it's immaterial either way". With this in mind, and looking at the Lenovo case, I am considering the following: 1. $IREN rounds down 1,200 GB300s to 1,000 GPUs, this makes 200 GB300s worth "nothing", and 1,200 or 1,000 GB300s "immaterial". 2. Material or immaterial is being compared to either the $MSFT contract (76k), or to the fleet (currently ~150k disclosed as purchased). 3. IREN never cared to announce that they would be delivering the first NVL72 GB300 cluster in Canada with Dell(2), it was probably immaterial as well. 4. Dell delivered(?) these systems as pre-configured and fully integrated Dell Integrated Rack Scalable Systems, making an overlap with Lenovo's ThinkSystem nodes extremely unlikely. Now we have to ask ourselves: 1. If 648 nodes of Lenovo's ThinkSystem SR680a V3 holds 8 units of B200 GPU each, we get to 5,184 GPUs. 2. These are already deployed per today (see quoted post below), and as Dan said on the same space: they don't have GPUs energized in data centers that are idle. 3. Is this in any way MNPI to disclose? Based on all of the above, I think we can conclude that: 1. IREN didn't disclose a separate purchase of 5,184 B200s related to the Lenovo deployment. 2. 5,184 GPUs are probably immaterial for IREN compared to a fleet of 150k+ GPUs. 3. The purchase price of 648 complete SR680a nodes with B200 GPUs is probably around $350m, this is most likely immaterial for IREN with almost $10B of financing behind them. So: 1. IREN most likely didn't include these GPUs in their ARR guidance, as they were all based on Dell purchases that were disclosed. 2. So, these new GPUs could very well be deployed in their immaterial 10MW data center, and we would never know. 3. If so, these are not sitting idle, but are probably rented out for 3,4,5 years to AI natives and/or enterprises, forcing no MNPI disclosure either. 4. Even so, 5,184 B200s at $3.5 per GPU hour, would bring in ~$158m in ARR. 5. The additional 600x8 = 4,800 B300s at $4 per GPU hour, could bring in another ~$168m of ARR. I think it's completely plausible that $IREN has bought multiple smaller batches of <10k GPUs from different OEMs and other cloud providers, without telling the market. This Lenovo "discovery", was probably by request from, or a contractual obligation to Lenovo. IREN is setting up for a surprise to the upside in the coming 2,3 earnings reports. I have satellite imagery that confirms there is construction happening in Mackenzie, which could mean another "immaterial" data center is being contructed. I think we know now why we have a $6B ATM. I think they will tap this to pay for small <$500m purchases of GPUs to deal with the memory constraints, without having to access the debt markets. By the same token, they can tap the ATM to pay for the construction of these immaterial data centers, with possibly incremental immaterial megawatts. Everything is immaterial if it's small by comparison to the disclosures. IREN is here to fuck spiders, but they won't tell us about it. Not because they are shy, but because it's not going to move the needle. What it will move, is the revenue by aggregate, and the earnings surprise to the upside. The only thing that bothers me though, is the fact that Dell said in November 2025 that they will deploy Canada's first GB300 cluster with IREN, but Dan Roberts said 2 weeks they aren't sure what they will do with those "1000" GB300s they bought. Would Dell leave this on their website, if it never actually happened? I still lean to the "incremental OEM supplier" theory, and not to the "substitute OEM supplier". Typically IREN will disclose GPU purchases in their quarterly earnings reports, or their management discussion of the period. If not, I think this would make for a good analyst question. I am always very critical of lacking data points of the companies I invest in. For this reason (amongst others), $NBIS is uninvestible for me. $IREN on the other hand, claims they disclose much more than their competitors, and in a way that's true. But since we as retail investors are used to having the tools to calculate the future earnings, it's becoming quite hard to be precise enough, as the degree of immateriality is increasing, and there is basically an entire shadow operation going on outside of the disclosed projects and guidance. Many people like to blame IR. But I think this is a company culture "issue", if anything. But where we see a future of high margin earnings, the market sees a glass that is half empty. To be invested in $IREN, you need to have conviction, patience, and understanding. We do our best on here, to cover what we can find. But at the end of the day, the EPS will tell the story, and if IREN has indeed utilized their different OEM partners to deal with the time-to-GPU issue, then we will be rewarded to the upside. I'm long IREN, and I think 2026 will be our inflection year.

⚡️JUST IN: $CIFR announces another long-term hyperscaler deal. AWS: 15 years Fluidstack: 10 years New tenant: 25 years Premarket reaction: +11%.

$CIFR ANNOUNCES THIRD DATA CENTER CAMPUS LEASE: Cipher Digital just locked in its third hyperscaler tenant • AWS - 15 years/$5.5B • Fluidstack - 10 years/$9B with extensions • TBA - 25 years Demand for compute isn’t just strong, it’s being contracted for decades in advance

BREAKING: NVIDIA CEO announces “we’ve achieved AGI”

< 내가 생각하는 $IREN 예상 주가 , 보수적 > $IREN 이 mckenzie, canal flat, horizon 5-10, sweetwater 1의 600MW 가량을 공급한다고 할 때 필요한 CapEx는 얼마정도일까? Mckenzie + Canal flat 110MW, PUE 1.1, IT load 100MW B300 가용 숫자는 51813대 가량 GPU 단가는 $70K로 가정(이번 GPU 확보 딜 세부내용 참고) GPU 비용은 $3.63B retrofit capex 는 IT MW 당 $4M/MW으로 가정한다 DC 인프라 비용은 $0.40B = $4.03B Horizon 5-10 450MW, PUE 1.5, IT load 300MW B300 GPU 155440대 GPU 비용은 $10.88B retrofit capex는 텍사스 특성 상 더 여유롭게 $5M/MW로 계산 DC 인프라 비용은 $1.50B = $12.38B Sweetwater 1 600MW, PUE 1.5, IT load 400MW Vera rubin 계약은 선례가 없으니 GB 300 전제로 이전 $MSFT 와의 계약 기반으로 GB 300 152000대 가용 $MSFT 와 계약 시점에서 시간이 지나서 GB 300 가격은 20% 인상 (원래는 76K에 $5.8B) GPU 비용은 $13.92B 액냉식 DC 건설비 역시 IT load 1MW 당 $15M 에서 $17M으로 인상 DC 인프라 비용은 $6.80B = $20.72B 다 합치면 $37.13B GPU 조달 비용의 95%는 $MSFT 와의 선례와 마찬가지로 선급금과 GPU 파이낸싱으로 커버한다고 가정해보자(총 합해서 4%의 금리) GPU 비용은 총 $28.43B 그 중 5%인 $1.42B 는 조달 필요 DC 인프라 비용 역시 충당 필요 $8.7B 도합 $10.12B 조달 필요 전환사채와 ATM은 3:1 정도의 비율로 조달(선례를 바탕으로) $7.5B 전환사채 $2.5B ATM 필요 해당 시나리오 적용하면 총 Debt는 $38.6B, Equity는 $5.04B Debt/Equity ratio : 약 7.66x Coreweave 가 현재 D/E 8.9x 정도이니 못할 것도 없고 해당 계산식은 $IREN 이 데이터센터나 BTC에서 나오는 영업 현금흐름은 고려하지 않았기에 Debt/equity ratio는 더 낮아질것임 즉, $6B ATM 한도를 올린거에 겁 먹을게 아니라 ATM 의 규모가 어느정도 사업까지를 커버할지를 봐야하는거임 현재 기준 여태까지 쓴 전환사채 최대 잠재 희석 수를 고려하면 대략 410M개 가량의 주식 그러면 '$7.5B 전환사채 $2.5B ATM'으로 얼마만큼의 주식이 희석될까? 이건 내가 정확히 구할 수는 없지만 시나리오는 짜볼 수 있음(보수적으로) 신규 전환사채 $7.5는 최근 32/33 만료되는 전환사채처럼 현재 주가 기준에 전환가 프리미엄 25% 정도 붙여서 conversion price : $51.88 cap price: 100% 프리미엄 붙여서 $83 ATM $2.5B 는 주가 오를 때마다 분할 발행 주가가 오르면 전환사채 cap 초과분의 희석 발생은 증가하고 ATM으로 인한 희석 발생은 감소하는 구조 대략 100-150M개 희석 될 것으로 보임 그럼 보수적으로 기존 전환사채 전부 희석된다고 하면 주식 수 410M개 거기다가 최대 150M개 더 얹어서 560M개 그러면 내 질문은 이거다 $IREN 이 Mckenzie, Canal flat, horizon 5-10, sweetwater 1의 600MW 계약이 이행된다면 $IREN 의 시가총액은 몇 배 정도 커질까? 희석 증가율을 능가하는 시가 총액 증가율이 나올까? 원래 $3.4B ARR = Prince george, Horizon 1-4, Mckenzie/Canal flat이었는데 여기에 horizon 5-10, sweetwater 1 600MW가 더 들어온다 5-10에 가용할 수 있는 B300 GPU 갯수는 대략 15만개 현재 B300 임대료는 첨부한 그림에서 알 수 있듯이 증가 추세 특히 on demand average price가 최근 저점 기준 $7.17 장기계약이니까 여기에 60% 할인한 값을 적용 그럼 horizon 5-10에서 나오는 ARR은 $3.7B가량이 나옴 sweetwater 1 600MW에서 나오는 ARR은 $MSFT 계약 기반 GPU 가격 상승률 고려해서 ARR도 +20% 증가시키면 $4.65B 가량 나옴 그러면 해당 사업들이 모두 진행됐을 때 ARR은 $3.4B + $3.7B + $4.65 = $11.75B임 나는 27년 연말~28년초까지 해당 ARR이 실제 장부에 찍힐 수 있는 ARR이라고 생각함 (내가 생각하는 타임라인 26년 캐나다 데이터센터 운영 완료 + horizon 1-4 운영 완료 + horizon 5-10 일부 운영 완료 27년-28년 초 horizon 5-10 전체 운영 완료 + sweetwater 1 600MW 운영 완료, 특히 액냉식 데이터센터 건설 경험이 있는 상태에서 속도는 더 빨라진다는 가정, GPU 조달 속도는 변수) $CRWV 의 26E 매출 기준 P/S = 3.2~3.5x(고성장 반영돼서 forward multiple이 압축된 상태) $IREN 의 28E 매출 하방이 $11.75B 정도 (+당연히 추가여력은 더 있지만 언급한 사업들만 고려하겠음) 멀티플 '4' 부여( $CRWV 대비 수직통합 이점, 현재 $CRWV 보다 성장 여력 더욱 남아있음, $CRWV 보다 부채 구조 깨끗할 예정) Makret cap = $47B 주식 수 = 560M 예상 주가 = $83.9 고로 내가 위 사업이 실현됐을 때만 가지고 $IREN 의 가치를 판단한다면 27년 연말-28년 초 주가는 $83.9 (누군가는 이게 bull case라고 하겠지만 나한테는 base case다 ) --- 위 계산에서 고려되지 않은 $IREN 의 가치 1) 28년에 energization 될 600MW의 sweetwater 2 2) sweetwater 1에서 $MSFT 계약 대비 경제성의 개선이 아예 없다는 전제로 가정(하이퍼스케일러 첫 계약 및 uptime 입증되지 않은 상태에서의 계약이라는 점 고려해야함) 3) sweetwater 1의 나머지 800MW의 가치(솔직히 나는 600MW가 GB300으로 계약된다고 생각하지는 않음, 그냥 단적인 예시를 들려고 GB300을 가져온거임, 젤 계산하기 편하니까, Vera rubin 계약하면 가치는 더 커질거임) 4) 오클라호마 1.6GW 사이트 28년 substation enerization 예정 5) horizon 5-10 의 B300 GPU 임대료도 최대한 싸게 계산함($2.86), 지금 점차 임대료가 증가하는 추세에서 이게 유지될까? 피드백 환영, 계산 지적해주면 감사합니다