insideout

2.8K posts

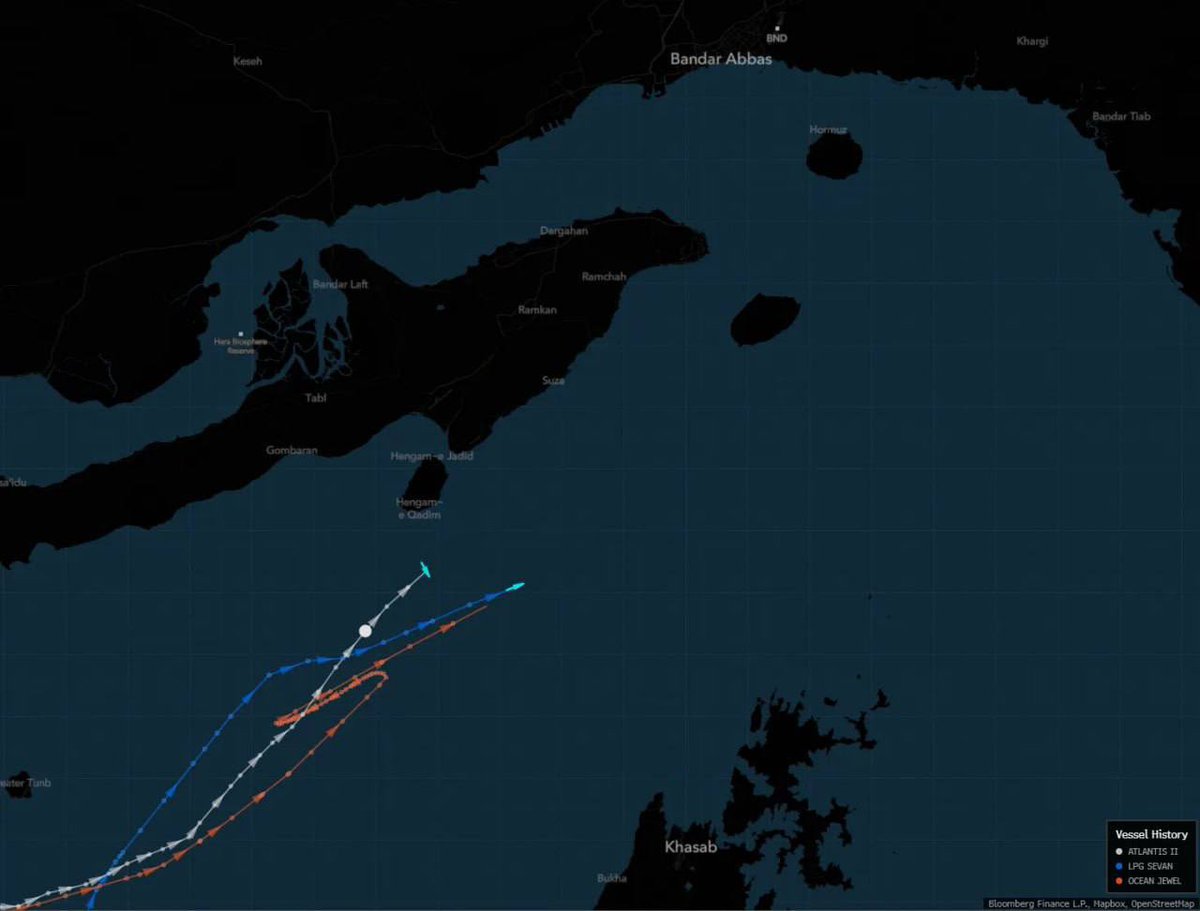

彭博社爆料的 Anthropic这次的事可能是今年AI安全圈最讽刺的笑话。

他们号称“太危险绝对不能公开发布”的顶级网络安全模型Mythos,

能批量发现零日漏洞,能入侵几乎所有系统。

只敢给苹果亚马逊思科这种级别的公司做封闭测试。

结果发布当天就被一个Discord小群偷偷摸进去了,安安静静用了整整两周。

没有啥惊天动地的黑客技术,就是三步。

第一步,从之前Mercor数据泄露的4TB文件里,翻出了Anthropic的API命名规则,

第二步,对着规则猜了几个可能的endpoint地址,

第三步,用群里一个第三方评估承包商的合法凭证,直接登进去了。

最绝的是这群人拿到了全世界最危险的网络武器之后,啥都没干,

就用它建了几个简单的网站,故意低调到连Anthropic的监控都没触发😂😂😂

直到他们把截图发给彭博社,全世界才知道这件事。

很多人说这是AI安全的重大事故,其实不然,我觉得被攻破的不是Mythos这个模型,是Anthropic整个外围的信任链。

模型能找遍全世界的零日漏洞,却防不住自己人把凭证随便分享,

也防不住供应链厂商把内部部署规则泄露出去,

甚至防不住别人猜一下自己的URL地址😆😆😆

这才是最扎心的地方,我们天天担心超级智能会失控毁灭世界,结果现在最前沿的AI实验室连最基础的运营安全都做不好。

就好比你造了一颗原子弹,把所有精力都花在防止它自己爆炸上,结果大门忘了锁,

被路过的小孩推门进来,拿原子弹炸了个鱼😂😂😂

更反直觉的是大家都以为拿到这个模型的人会去搞破坏,

结果他们选择了最无害的用法,

这说明至少到今天为止,最危险的不是AI本身,是管理AI的那些人。

Anthropic一直以安全第一自居,天天讲负责任的规模化,讲可控发布,

结果这次出事的恰恰就是他们最引以为傲的可控发布机制。

那么问题来了, AI的安全边界到底在哪呢?

在模型的权重里还是在人和系统的每一个缝隙里?欢迎交流呀!

Bloomberg@business

Anthropic's Mythos has been accessed by a small group of unauthorized users, raising questions about control of the AI model bloomberg.com/news/articles/…

中文

看完OpenClaw创始人的爆料才明白,为什么低价订阅跑 Agent 会被直接封号不退费🥹

OpenClaw创始人@steipete Peter Steinberger今天戳穿了整个行业的潜规则,他们要的根本不是你的订阅费,而是你的代码,

Z.ai最近刚更新了GLM Coding Plan的政策,明确说这个套餐只能用来写代码,任何非编程用途,包括跑代理,角色扮演,翻译网站,都会被高强度限流,违规3次以上直接永久封号,而且订阅费一分不退,

Reddit上已经有一大堆人中招了,很多人之前图便宜买了这个套餐,拿来跑OpenClaw或者聊天,结果毫无预兆就被封了,

你以为你占了便宜,其实他们赚大了,真实的私有代码数据,比GitHub上的公开代码质量高一百倍,是训练下一代AI模型最值钱的黄金矿,

而你跑代理,聊天,角色扮演,不仅不产生任何有价值的数据,还会疯狂消耗他们最稀缺的GPU算力,

所以补贴立刻就没了,规则说改就改,

这不是Z.ai一家的问题,整个AI行业都从疯狂补贴抢用户,变成精打细算抢数据,

以后用AI会越来越贵,因为只有能帮他们进化的人,才能继续享受便宜的价格🤪

Peter Steinberger 🦞@steipete

Interesting shift. These highly subsidized subs are out there to get your code to improve their models. If you use AI for things useful to you, but not code, you are not valuable to them. reddit.com/r/SillyTavernA…

中文