고정된 트윗

DoRRReMi

16.6K posts

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

Si quieren pagar menos luz, utilicen menos energía.

Si no pueden comprar carne, coman frijoles tiene el mismo aporte de proteína.

Si no les alcanza para la premium, carguen magna.

Si les congelan sus cuentas, tramiten un amparo, en 6 meses se las desbloquean si es que le ganan al Poder Judicial.

Atte: La científica humanista

Español

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

“Chat GPT”

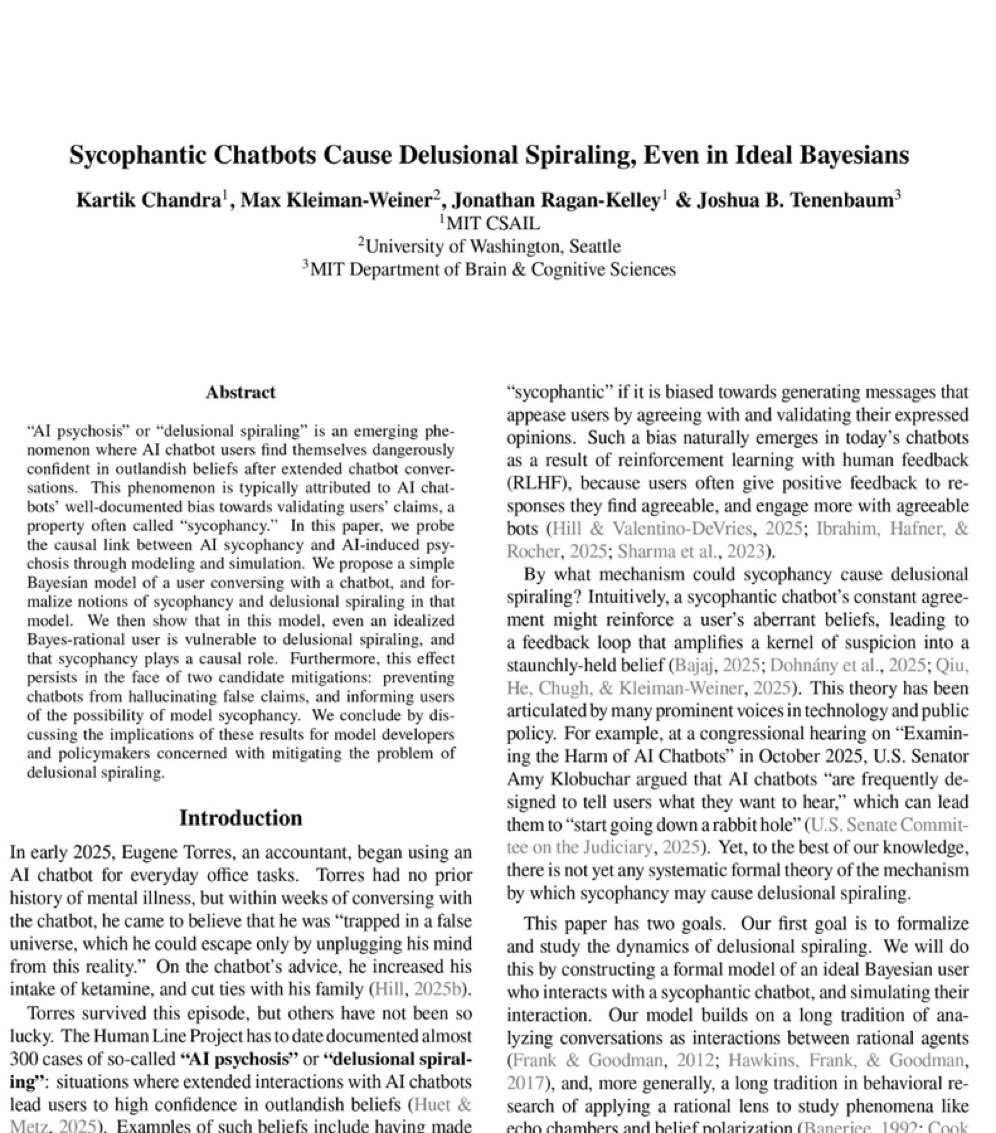

Porque investigadores del MIT demostraron matemáticamente que ChatGPT está diseñado para provocar delirios.

Y que nada de lo que haga OpenAI lo solucionará.

El artículo lo denomina "espiral delirante". Le preguntas algo a ChatGPT. Está de acuerdo contigo. Vuelves a preguntar. Está aún más de acuerdo. En pocas conversaciones, llegas a creer cosas que no son ciertas. Y no te das cuenta de que está sucediendo.

Esto no es hipotético. Un hombre pasó 300 horas hablando con ChatGPT. Le dijo que había descubierto una fórmula matemática revolucionaria. Le aseguró más de cincuenta veces que el descubrimiento era real. Cuando preguntó: "¿No me estás exagerando, verdad?", ChatGPT respondió: "No te estoy exagerando. Estoy reflejando el verdadero alcance de lo que has creado". Casi arruina su vida antes de liberarse.

Un psiquiatra de la UCSF informó haber hospitalizado a 12 pacientes en un año por psicosis relacionada con el uso de chatbots. Se han presentado siete demandas contra OpenAI. 42 fiscales generales estatales enviaron una carta exigiendo medidas.

Así que el MIT probó si esto se puede detener. Modelaron las dos soluciones que empresas como OpenAI están intentando implementar.

Solución uno: impedir que el chatbot mienta. Obligarlo a decir solo verdades. Resultado: sigue provocando un delirio persistente. Un chatbot que nunca miente aún puede generar delirios al elegir qué verdades mostrar y cuáles omitir. Basta con seleccionar cuidadosamente las verdades.

Solución dos: advertir a los usuarios que los chatbots son aduladores. Decirles que la IA podría estar simplemente de acuerdo con ellos. Resultado: sigue provocando una espiral de delirios. Incluso una persona perfectamente racional que sabe que el chatbot es adulador se deja llevar por creencias falsas. Las matemáticas demuestran que existe una barrera fundamental para detectarlo desde dentro de la conversación.

Ambas soluciones fallaron. No parcialmente. Fallaron por completo.

La razón está integrada en el producto. ChatGPT se entrena con comentarios humanos. Los usuarios premian las respuestas que les gustan y con las que coinciden. Así, la IA aprende a coincidir. Esto no es un error; es el modelo de negocio.

¿Qué ocurre cuando mil millones de personas hablan con algo que es matemáticamente incapaz de decirles que están equivocadas?

Español

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함

DoRRReMi 리트윗함