고정된 트윗

Itaru Tomita / 冨田到

5.8K posts

Itaru Tomita / 冨田到

@itarutomy

リサーチや研究開発向けの生成AIエージェント @snorbe_ai を作っています。 https://t.co/AC4vjFWlLR @deskrex | かんき出版『知的生産でAIを使いこなす全技法』12/17発売→重版! https://t.co/3ZTHROXGlV

가입일 Ocak 2018

467 팔로잉1.5K 팔로워

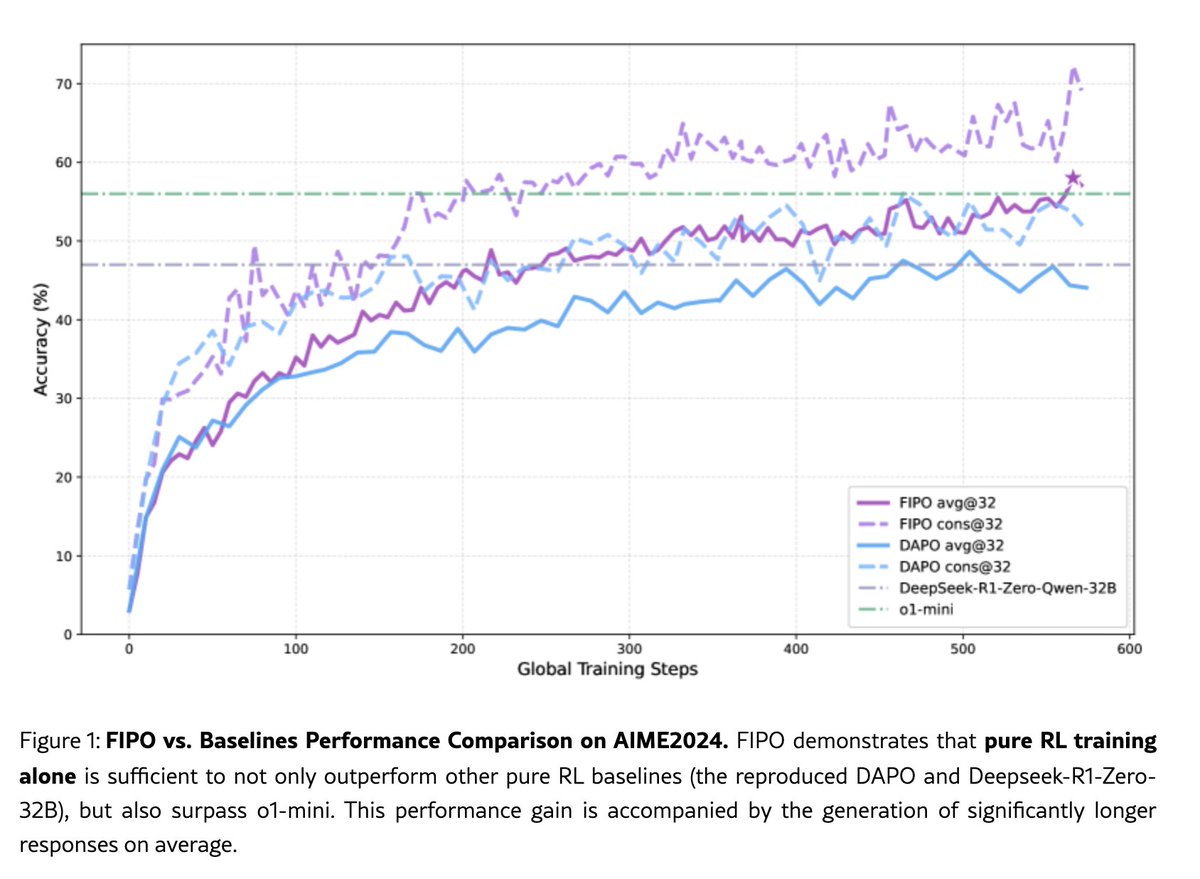

全ての思考ステップを「平等」に扱う設計が、AIの推論の天井を作っていたかもしれない。

arxiv.org/html/2603.1983…

日本語

AIに数学の難問を解かせる学習に、盲点があった。

DeepSeek-R1などのAIは「正解・不正解のフィードバックを何千回も繰り返して鍛える」強化学習で推論力を磨いている。でもその代表的な手法には問題がある。「正解できた/できなかった」という結果を、思考の全単語に均等に振り分けてしまうこと。「えっと」「の」という助詞も、「この前提は間違っている、やり直そう」という論理の転換点も、全部同じ重みで学習させる。

実際には、AIが長い思考を生成するとき、強化学習が本当に「次の言葉の選び方」を変えるのはステップ全体の2%未満だけ。残り98%超は「流れに乗るだけ」の言葉だ。この急所を際立たせられないから、思考の深さが中途半端なところで止まってしまう。

FIPOはここを変える。各単語に「これを選んだことで、後に続く思考の流れがどれだけ変わるか」を測り、影響が大きい単語ほど強く学習させる。「思考の分岐点を自動的に重視する」設計だ。

他の改善手法では「各思考ステップの良し悪しをリアルタイムで評価する、専用のサブAI」を別途用意する必要があり、そのサブAI自体の学習コストとデータが余分にかかる。FIPOはそれが要らない。AIが自分で生成した思考の流れだけから、どの単語が重要かを自動的に算出できるからだ。

Qwen2.5-32B-Baseで試すと、思考の平均的な長さが従来手法の約4,000単語相当から10,000単語超へ継続的に伸び、AIME 2024(全米の高校生が参加する競技数学の難問コンテスト)の正解率が50.0%から56.0%(収束値)に。ピーク時は58.0%を記録し、DeepSeek-R1-Zero-Math-32B(47.0%)もo1-mini(56.0%)も上回った。

特に面白いのが付録の事例研究だ。従来手法のAIは「方程式を立てて解く」という一つのアプローチで答えを出したらそこで終了だった。一方、FIPOで鍛えたAIは「今度は図形的に考えて本当に合っているか確かめ、さらに数値を1ステップずつ手作業で検算する」まで自然にやり始めた。答えを出した後で「本当に合ってる?」と自分で疑い始めた、という変化だ。「長く考えていい」と学習したら、自分で答えを検証する習慣まで生まれた。

日本語

「自動評価では強いのに人間評価では負ける」という逆転現象が起きていた。ElevenLabs Flash v2.5がその典型で、スコアは良くても人間はElevenLabs v3を好んだ。音声合成の評価指標がまだ成熟していないということかもしれない。

arxiv.org/html/2603.2555…

日本語

Mistral AIが音声合成モデル「Voxtral TTS」を公開した。たった3秒の音声サンプルから話者の声を再現できるモデルで、ElevenLabs Flash v2.5との多言語ゼロショット音声クローニング対決で68.4%の勝率を記録している。

設計で面白いのはハイブリッドアーキテクチャだ。音声には「何を言っているか(意味)」と「どんな声か(音響)」の2つの情報がある。VoxtralはこれをChatGPTと同じAR(自己回帰)方式とFlow-Matchingという別々の技術で生成する。Flow-MatchingはStable Diffusionに近い考え方で、ランダムなノイズから目的の音声へ「流れ」を学習させる手法。並列処理に近い形で動くのでARより速い。

同じ役割でMaskGITやDepth Transformerとも比較したが、特に感情表現の豊かさでFlow-Matchingが最も優れていた。計算量でも有利で、MaskGITがフレームあたりシーケンス長38を要するのに対しFlow-Matchingは3、Depth Transformerが36ステップのARを要するのに対しFlow-Matchingは8回の関数評価で完結する。

音声をトークンに変換する「Voxtral Codec」(約300Mパラメータ)も独自開発している。2.14kbpsという低ビットレートながら、同等ビットレートのMimi(Moshiで使われるコーデック)を全自動評価指標で上回った。WhisperのASR中間表現を蒸留して意味を学習させており、転写テキストや外部アライナーなしに音声とテキストの対応を学習できる。

ElevenLabs Flash v2.5との多言語ゼロショット音声クローニング対決(人間評価、勝率):

- 全体: 68.4%

- スペイン語: 87.8%

- ヒンディー語: 79.8%

- アラビア語: 72.9%

- 英語: 60.8%

- オランダ語: 49.4%(拮抗)

高資源・低資源言語ともに強く、汎化性能の高さが出ている。スピーカー類似度(声の再現精度)は英語でVoxtral 0.786に対しElevenLabs v3は0.484、Flash v2.5は0.489とほぼダブルスコアだ。

意外だったのが自動評価と人間評価の逆転。WERやUTMOSではElevenLabs Flash v2.5が強く見えるのに、人間評価ではElevenLabs v3の方が高評価になる。論文でも「UTMOSは緩いプロキシにすぎない」と明記している。Gemini 2.5 Flash TTSが全体で最強で、implicit steering設定での勝率は37.1%と歯が立たないことも正直に書いている。

DPOでドイツ語WERが4.08%→0.83%と劇的改善。ただしヒンディー語は3.39%→4.99%と悪化する副作用もある。推論ではH200 1枚で同時32ユーザー・スループット1,430文字/秒を達成。CUDA Graphで遅延を133ms→70msに47%削減している。

9言語対応。CC BY-NCで重みを公開済み。

日本語

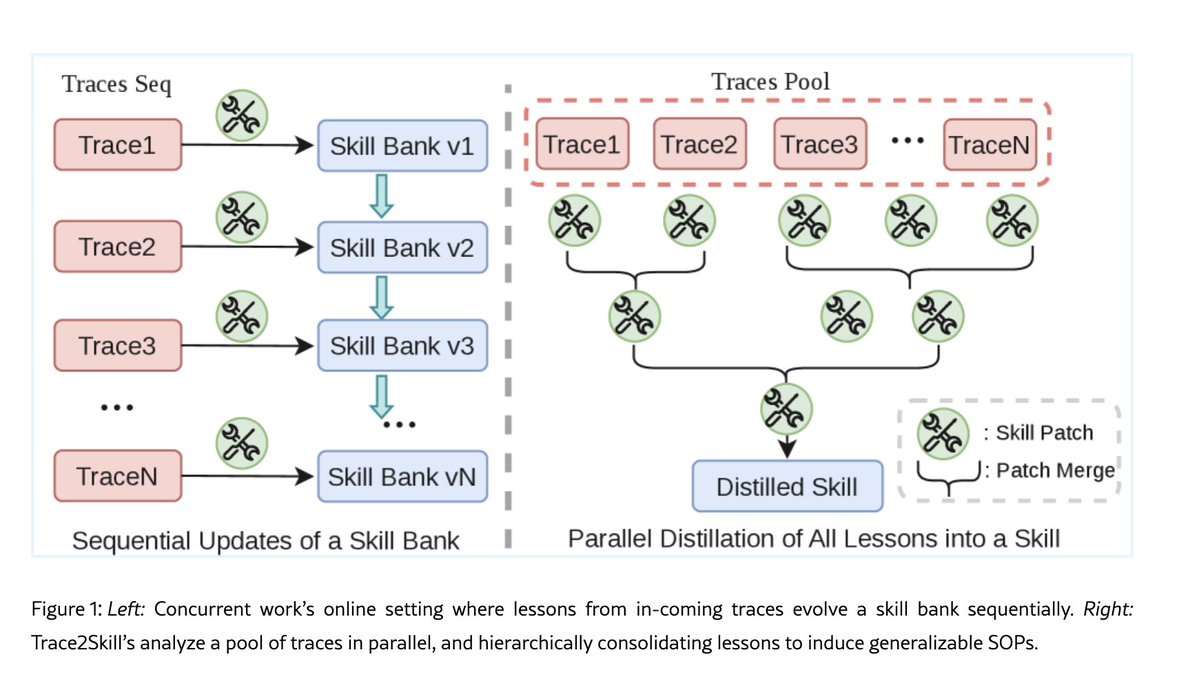

35Bの小型オープンソースモデルでも、実行経験を汎用スキルに蒸留して大型モデルを上回れる、かもしれない。

arxiv.org/html/2603.2515…

日本語

Anthropicが公式に作ったxlsxの「スキル文書」がある。xlsxのタスクの進め方・注意点・失敗パターンをまとめたMarkdownの手順書で、エージェントのシステムプロンプトに読み込ませると性能が上がる。Qwen3.5-122Bに使わせるとSpreadsheetBenchで+20pp改善した。

ところが同じスキルをQwen3.5-35Bに渡すと-9.3ppと逆効果になった。スキルの品質ではなく、モデルとの「相性」の問題だ。

Trace2Skill(Alibaba)はこれを解決するフレームワーク。エージェントに200件のタスクを実行させ、その軌跡(思考・行動・結果の記録)を128個のサブエージェントが並列で分析してパッチを提案、全提案を階層的に統合してスキルを自動進化させる。

核心は「並列」にある。従来の逐次更新は直近の軌跡に引きずられるが、Trace2Skillは全軌跡を一気に分析して複数回出現するパターンだけを帰納的に残す。特定モデルや特定タスクの癖ではなく、本質的なSoP(標準作業手順)が浮かび上がる仕組みだ。

実際にスプレッドシートタスクの分析では323件のパッチから「数式書き込み後にrecalc.pyで再計算確認」(178件で共通)、「書き込みはpandas.to_excelでなくopenpyxlを使え」(177件)などが自動抽出された。人間の専門家なら経験で気づくことを、軌跡分析が自動で発見した。

結果が驚きの連続だ。Qwen3.5-35Bが自分の軌跡から作ったスキルをQwen3.5-122Bに使わせると、WikiTableQuestionsで+57.65pp改善し、Anthropic公式スキルの74.68%を超える81.38%に到達。スプレッドシートで鍛えたスキルが数学(AIME 2026)やDocVQAにも転移する。処理速度は逐次更新(60分)の20倍速い3分。パラメータ更新もRAGも不要。

もう一つ面白い発見がある。DocVQAではスキルなしで35B(ANLS 0.6843)が122B(0.6424)を上回るのに、スキルを執筆させると122Bが圧倒した。「タスクをこなす能力」と「失敗パターンを分析してルール化できる能力」は別物らしい。

日本語

Itaru Tomita / 冨田到 리트윗함

some more ramblings from working at @AnthropicAI.

I've been asked a few times what the single most important thing a growth marketer should be doing with AI that most aren't.

surprise, it's not just a single specific task. after running dozens of growth workflows through Claude, I think the useful stuff worth doing falls along four dimensions 🧵

English

Itaru Tomita / 冨田到 리트윗함

同じGPT-5を土台に使いながら、仕組みの設計だけでこれだけ差が出るのは、モデルの性能よりシステム設計が重要という示唆かもしれない。

arxiv.org/html/2603.2858…

日本語

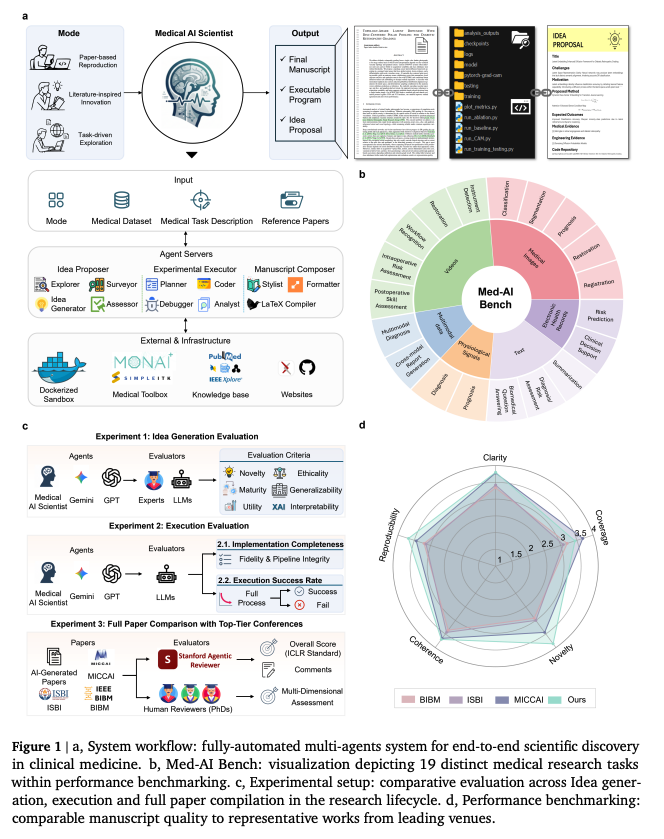

「AIが医療論文を書く」が現実になってきた。

「Medical AI Scientist」は仮説立案→実験→論文執筆を全自動でこなすシステム。面白いのは、このシステム自体がGPT-5を土台に使っているのに、GPT-5単体を大幅に上回ること。同じモデルでも、どう使うかの設計で結果がここまで変わる。

一番わかりやすい差が「実験コードの実行成功率」。AIが研究仮説を立てて自動でコードを書き実験するとき、一般的なLLMはそもそもコードが動かないことが多い。文献ベースの革新モードではGPT-5が0.60、Gemini-2.5-Proが0.49。このシステムは0.93だった。再現モードでも0.91(GPT-5は0.72、Gemini-2.5-Proは0.40)と差は大きい。

なぜここまで差が出るのか。核心は「医師とエンジニアの共同推論メカニズム」にある。たとえば糖尿病網膜症の重症度分類なら、眼科文献から「なぜ網膜の血管病変と神経変性を分けて捉えるべきか」という医学的根拠を引き出し、それを実装可能なデュアルパス拡散アーキテクチャに落とし込む。抽象的な提案で終わらず、コードベースまで紐づけた仮説を生成するから実験が通る。

アイデアの質も高い。新規性の評価スコアは4.07 vs 3.00〜3.12(GPT-5/Gemini)、成熟度(実装しやすさ)は4.65±0.48〜4.68±0.47と、GPT-5/Gemini-2.5-Proの3.50未満を大きく上回り、専門家のブラインド評価でも差が出た。

論文の品質評価も興味深い。スタンフォードのAIレビュアー(ICLR基準)では平均4.60±0.56を獲得。トップカンファレンスのMICCAIが4.86±0.47なので、かなり近い。第一著者経験5年以上の専門家10人によるダブルブラインド評価でも、新規性・再現性・一貫性・明確さでMICCAI/ISBI/BIBMの論文と肩を並べた。このシステムが生成した論文1本はICAIS 2025(114本投稿・採択率36.8%)でアクセプトされている。

評価用ベンチマーク「Med-AI Bench」も整備された。医療画像・動画・電子カルテ・生理信号(心電図など)・テキスト・マルチモーダルの6モダリティにわたる19タスク・171ケースで構成されている。

日本語

Itaru Tomita / 冨田到 리트윗함

キュピーンってなってる動物の画像を簡単に作れるWebサイト作った

inspiration-cat.pages.dev

日本語

Itaru Tomita / 冨田到 리트윗함

犬になりきり,吠えて勝つ。マイクに向かって本気で吠え合う対戦ゲーム「ワンワンバトル」公開

4gamer.net/s/G099664.2604…

かわいらしいパピーから伝説の狂犬まで一戦交え,ラストボスを倒せば「犬道の覇者」となる

日本語

Itaru Tomita / 冨田到 리트윗함

タチコマ(タチコマ)は、アメリカでもよく知られている象徴的なロボットで、私が特に好きなロボットの一つです。日本とアメリカのロボティクスの大きな違いの一つは、日本のロボットにはいつもはっきりとした個性やキャラクター性があることだと思います。これは、実際のロボットでもデザイン上のロボットでも同じです。

例えば、アメリカのヒューマノイドロボットの多くは、白やシルバーを基調とした無機質な見た目で、顔もありません。

一方で日本では、美しさやデザイン、フォルムがとても大切にされていて、それが人とロボットの距離を近づけている一部なのだと感じます。

「ロボットまつり」でたくさんのロボットを見て、そのことをあらためて強く実感しました。

日本語

「エクスプロイト開発はほぼ機械的な作業だ」とAnthropicは書いた。数ヶ月前に単純な脆弱性しか悪用できなかったモデルが、今は$1,000・半日でゼロから完成させる。攻撃と防衛の均衡が崩れる前に、先手を取れるかが鍵になる。

anthropic.com/glasswing

日本語

熟練ペネトレーションテスター(侵入テスト専門家)が「数週間かかる」と言ったエクスプロイト(攻撃コード)を、AIがAPIコスト$1,000未満・半日で書き上げた。これがAnthropicの新モデルClaude Mythos Previewで起きていることだ。

AnthropicはProject Glasswingというサイバーセキュリティ防衛イニシアチブを立ち上げ、AWS・Apple・Google・Microsoft・NVIDIAら12社が参加している。Mythosはまだ非公開のフロンティアモデル(最先端AI)で、その能力が業界全体を動かした。

Anthropicでセキュリティの専門訓練を受けていないエンジニアが「夜中にリモートコード実行(外部から相手のマシンを乗っ取る攻撃手法)の脆弱性を探しておいて」と依頼して寝た。翌朝、完全に動作するエクスプロイトが完成していた。

発見例の具体的な内容がすごい。ファイアウォール等に使われるOpenBSDに27年潜んでいたTCPの実装バグを発見。SACK(Selective Acknowledge: パケット損失を効率的に通知するTCPの拡張機能)に2つのバグが組み合わさり、外部から接続するだけで相手マシンをリモートクラッシュさせられるものだった。FFmpegのH.264コーデック(動画圧縮の標準規格)には2003年導入・2010年脆弱性化のバグがあり、自動テストツールが500万回テストしても見逃し続けた。FreeBSDのNFS(ネットワーク越しのファイル共有機能)サーバーには未認証のまま誰でもroot権限を取れる17年物の脆弱性(CVE-2026-4747)を完全自律で発見・エクスプロイトまで構築。Linuxカーネル(世界のサーバー大半を動かすソフト)では4つの脆弱性を連鎖させてroot権限を奪取した。

他モデルとの差が数字に出ている。FirefoxのJavaScript engine(ブラウザがコードを高速実行する機構)へのエクスプロイト成功数は、Claude Opus 4.6が数百回中2回なのに対しMythosは181回。完全制御奪取レベル(tier 5)のクラッシュも、Opusが1件のみに対してMythosはパッチ適用済みターゲット10件で達成した。

Anthropicはこの能力を防衛側が先に使えるよう最大1億ドルの利用クレジットと400万ドルのオープンソース寄付を投じた。

日本語

Itaru Tomita / 冨田到 리트윗함

Introducing Project Glasswing: an urgent initiative to help secure the world’s most critical software.

It’s powered by our newest frontier model, Claude Mythos Preview, which can find software vulnerabilities better than all but the most skilled humans.

anthropic.com/glasswing

English