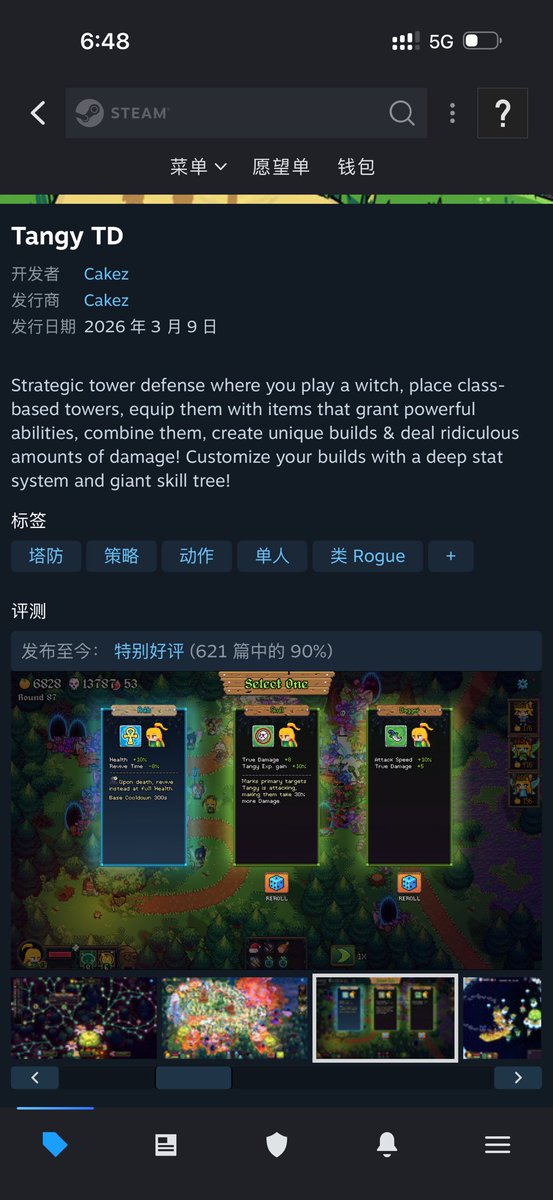

一周净赚超 600 万,独立开发者当场落泪 由独立开发者 Cakez 历时 4 年打造的像素塔防游戏《Tangy TD》,在 Steam 上拿下 89% 好评。 上线仅一周:售出 28,078 份,净收入达 197,847 美元(约合新台币 600 多万元)。 当他打开后台看到数据的那一刻,情绪瞬间崩溃,当场落泪;一旁的妻子也激动欢呼,两人紧紧相拥。 这是一次典型的独立开发者逆袭——没有团队,没有资本,只有时间、坚持,以及一点点运气。

Datou

27.7K posts

一周净赚超 600 万,独立开发者当场落泪 由独立开发者 Cakez 历时 4 年打造的像素塔防游戏《Tangy TD》,在 Steam 上拿下 89% 好评。 上线仅一周:售出 28,078 份,净收入达 197,847 美元(约合新台币 600 多万元)。 当他打开后台看到数据的那一刻,情绪瞬间崩溃,当场落泪;一旁的妻子也激动欢呼,两人紧紧相拥。 这是一次典型的独立开发者逆袭——没有团队,没有资本,只有时间、坚持,以及一点点运气。

很多人没有意识到,工作是做不完的,当你通过各种工具提高了效率,并不会真正获得更多自由时间,只会被分配更多工作。 因为本质上市场所购买的是你的时间,至于你在工作时间内能产出多少、市场又能消化多少,并不在考虑范畴内。

根据我的出片理论,外观占宣传的 64%,内饰占 16%,藏在壳子里面的技术不能出片,再怎么宣传也是只占 20%🤪

一个比较全面的大模型,完全下载到本地,小的能小到十几个G。你随便问它问题,他全部知道。他会所有人类语言。这就是人类全部知识骨架,或者说是知识 DNA,也就十几个G。

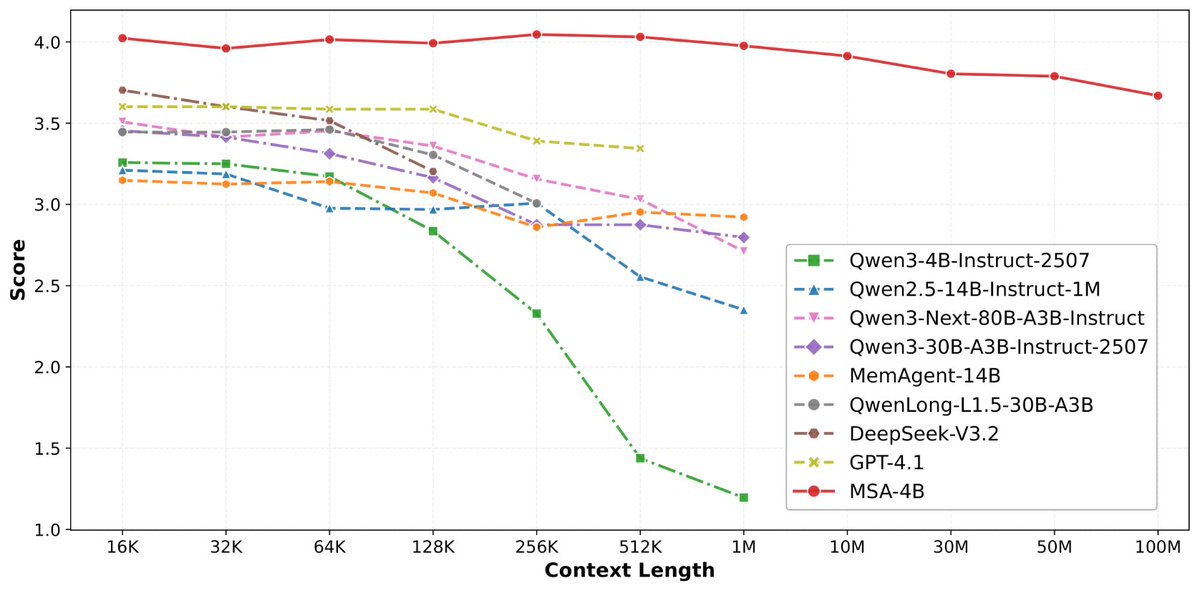

稍微剧透一下,@EverMind 这周还会发一篇高质量论文

在说一个暴论。skills 就是 ai 时代的低代码,看起来很美,但最终还是阶段性产物。确定性流程是自动化的基础,每个环节稳定性 90%,十个环节稳定性就是 34.9%。

你们可能觉得买2T是夸张了,但是一年后这台机就是我的了,2T拿来装Apple Music里的最高码率无损那是很爽的好吧?懂了么?

为什么玩家最爱骂腾讯,但最后赢的还是腾讯? 群里昨天有人说,某种意义上基本只有竞技游戏才能经久不衰。偏偏竞技游戏,大部分都在腾讯手上。还有一句也很准,玩家那么爱骂腾讯,从另一个角度看就是玩家多。 很多游戏会被玩完。 主线打完,活动刷完,版本一过,热度就掉。 竞技游戏不是,每一局都是新的。 现在很多人也没法再把整块时间交给游戏了。群里有人说,MMO 如果每天吞掉两小时以上就会流失,上班太累,最后只能回到时间没那么长的竞技游戏。 所以腾讯赢,可能不是因为它最会挨骂。 是因为它手里那批游戏,本来就更不容易过时。 你觉得呢? #gamedev