Yvan SEO

1.1K posts

Yvan SEO

@YvanSEO

Passionné par le #SEO depuis 2004 #SMO #SMA #SEA

Paris Entrou em Mayıs 2014

519 Seguindo923 Seguidores

@AugeSouryan Ouais j'avais testé ça marchait bien antigravity pour le design. Mais j'y ai pas trop touché depuis environ 2 mois, ça a bien évolué ?

CC même avec le forfait à 200 dollars j'atteins la limite semaine en 4j

Français

@YannDecoopman @lanoixdu24 Pareil chez moi mais je voulais savoir, pour info, Pour ceux qui se sont fait ban si ils ont été refund ou pas?

Français

@YvanSEO @lanoixdu24 J’ai pas été ban , juste ils bloquent l’utilisation de l’abonnement dans Open claw / Hermes

Français

@lanoixdu24 @YannDecoopman Juste pour info, ils remboursent les bans ou pas? :)

Français

@YannDecoopman 2 collègues même config = 2bans dont 1 hier

bref tout le monde a bougé vers codex ou minimax

il y a un hack ou votre oncle/tante/cousine bosse chez anthropic ? 😎

Français

Yvan SEO retweetou

LLM Knowledge Bases

Something I'm finding very useful recently: using LLMs to build personal knowledge bases for various topics of research interest. In this way, a large fraction of my recent token throughput is going less into manipulating code, and more into manipulating knowledge (stored as markdown and images). The latest LLMs are quite good at it. So:

Data ingest:

I index source documents (articles, papers, repos, datasets, images, etc.) into a raw/ directory, then I use an LLM to incrementally "compile" a wiki, which is just a collection of .md files in a directory structure. The wiki includes summaries of all the data in raw/, backlinks, and then it categorizes data into concepts, writes articles for them, and links them all. To convert web articles into .md files I like to use the Obsidian Web Clipper extension, and then I also use a hotkey to download all the related images to local so that my LLM can easily reference them.

IDE:

I use Obsidian as the IDE "frontend" where I can view the raw data, the the compiled wiki, and the derived visualizations. Important to note that the LLM writes and maintains all of the data of the wiki, I rarely touch it directly. I've played with a few Obsidian plugins to render and view data in other ways (e.g. Marp for slides).

Q&A:

Where things get interesting is that once your wiki is big enough (e.g. mine on some recent research is ~100 articles and ~400K words), you can ask your LLM agent all kinds of complex questions against the wiki, and it will go off, research the answers, etc. I thought I had to reach for fancy RAG, but the LLM has been pretty good about auto-maintaining index files and brief summaries of all the documents and it reads all the important related data fairly easily at this ~small scale.

Output:

Instead of getting answers in text/terminal, I like to have it render markdown files for me, or slide shows (Marp format), or matplotlib images, all of which I then view again in Obsidian. You can imagine many other visual output formats depending on the query. Often, I end up "filing" the outputs back into the wiki to enhance it for further queries. So my own explorations and queries always "add up" in the knowledge base.

Linting:

I've run some LLM "health checks" over the wiki to e.g. find inconsistent data, impute missing data (with web searchers), find interesting connections for new article candidates, etc., to incrementally clean up the wiki and enhance its overall data integrity. The LLMs are quite good at suggesting further questions to ask and look into.

Extra tools:

I find myself developing additional tools to process the data, e.g. I vibe coded a small and naive search engine over the wiki, which I both use directly (in a web ui), but more often I want to hand it off to an LLM via CLI as a tool for larger queries.

Further explorations:

As the repo grows, the natural desire is to also think about synthetic data generation + finetuning to have your LLM "know" the data in its weights instead of just context windows.

TLDR: raw data from a given number of sources is collected, then compiled by an LLM into a .md wiki, then operated on by various CLIs by the LLM to do Q&A and to incrementally enhance the wiki, and all of it viewable in Obsidian. You rarely ever write or edit the wiki manually, it's the domain of the LLM. I think there is room here for an incredible new product instead of a hacky collection of scripts.

English

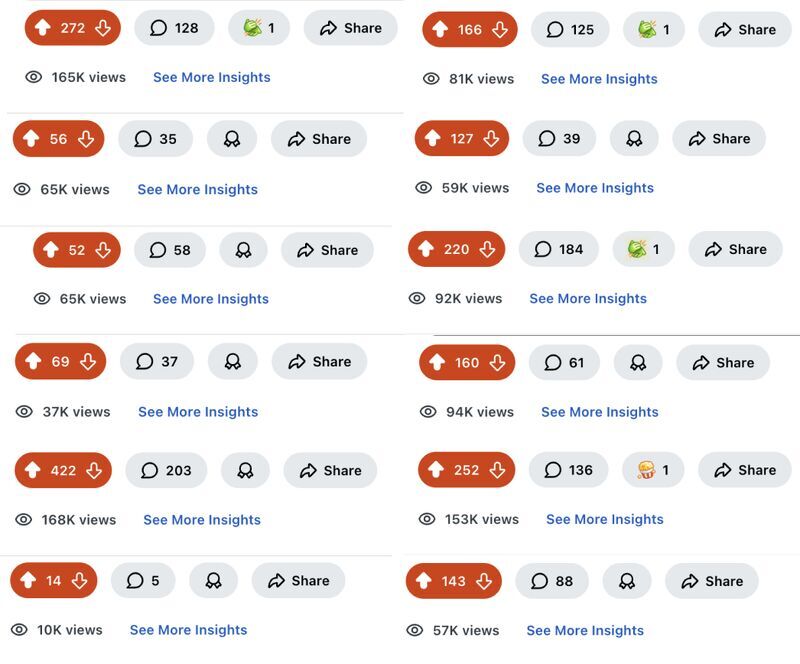

Plus d'1M de vues sur Reddit en 2 mois en bossant en claquettes.

Voici comment abuser de Reddit aujourd'hui :

La plupart des gens n'ont aucune idée de comment faire du marketing sur Reddit.

Voilà ce qui se passe généralement :

-> Ils créent un compte

-> Cherchent des subreddits

-> Commencent à spammer leurs liens produits

---> Se font bannir.

Ce n'est PAS comme ça qu'il faut promouvoir son produit sur Reddit.

En fait, il existe une méthode précise (et plutôt simple) pour le faire.

Cette méthode m'a permis de créer des posts viraux facilement.

J'ai décidé de TOUT partager avec vous :

-> Comment chauffer son compte

-> Trouver les bons subreddits

-> Comment Reddit fonctionne (ce n'est pas LinkedIn)

-> Comment 50% de mes posts deviennent viraux

-> Utiliser ChatSEO pour une stratégie Reddit/SEO

-> Comment Reddit s'intègre dans ta stratégie GEO

Tu veux le système qui a généré 1M de vues en 2 mois ?

Commente "REDDIT"

et RT pour que les autres voient

Français

Yvan SEO retweetou

@Dark_Emi_ Totalement d'accord sur le problème mais en désaccord sur ta solution. C'est pas un problème privé/public c'est plus profond que ça

Français

Les médias publics devraient être privatisés d'urgence.

C'est quoi ces journalistes pas foutu de lire une page wikipedia ? Ou de regarder ce qui est sorti dans les dossiers Epstein ?

Comment ils peuvent dire que c'est l'extrême droite mdrr

C'est une folie.

franceinfo@franceinfo

🔴 Affaire Epstein : "Mettre en cause quelqu’un sur la simple mention de son nom dans des documents serait dangereux", estime Paul Melun, tandis que Nathan Devers appelle à s’en tenir aux faits établis et au travail d’enquête journalistique. #LePourEtLeContre #canal16

Français

@Smadaleno C'est pas un fournisseur de proxy legit c'est un botnet qui utilise des applications Android et Windows vérolés pour ensuite revendre la bande passante sans aucun accord des propriétaires des lignes

Français

😣Après SerpAPI, Google attaque les fournisseurs de proxy… cloud.google.com/blog/topics/th…

Français

@CTRBooster75 Y a pas d'IP dédiées mobile. Elles sont partagées de manière aléatoire parmi les utilisateurs du réseau de la SIM. En France on est souvent entre 50 et 150 personnes sur les la même IP. Dans certains pays c'est beaucoup plus, c'est LA force des proxy 4G, noyés dans la masse

Français

Manipulation CTR Black Hat SEO : guide après plus de 2 années de tests

La manipulation du CTR consiste à envoyer des clics artificiels, mais réalistes, sur vos résultats Google (SERP, Maps, GMB, actu).

L’objectif est simple : augmenter le taux de clic pour provoquer, dans certains cas, un boost temporaire de position.

Ce n’est ni magique ni garanti, mais après plus de deux années de tests, certains principes reviennent systématiquement.

🟢 Voici les 3 clés incontournables

Sans elles, les chances de succès deviennent très faibles.

🟢 Clé n°1 : Multitude de proxies rotatifs

La première erreur consiste à sous-estimer l’importance de l’infrastructure réseau.

Pour que la manipulation du CTR ait une chance de fonctionner, il faut une vraie multitude de proxies rotatifs.

⚠️ Un proxy qui change d’IP toutes les minutes, même avec des milliers d’adresses disponibles, ne suffit pas.

Google observe bien plus que la simple rotation d’IP.

Les offres très discount sont à éviter :

➡️ proxies illimités

➡️ proxies résidentiels

➡️ proxies data center, ISP

❌ Dans la majorité des cas, ils ne sont ni réellement dédiés ni réellement propres.

🚨 Beaucoup de plateformes de manipulation CTR utilisent le même pool de proxies, parfois partagé entre des dizaines de clients.

C’est un red flag immédiat pour Google.

J’ai également testé des plateformes étrangères. Le problème est récurrent : des spammeurs utilisent les mêmes infrastructures.

🧪 J’ai même transformé des smartphones en proxies dédiés (mode avion activé régulièrement pour changer d’IP).

Sur le papier, l’idée paraît ingénieuse.

Dans les faits, cela reste un signal suspect.

🟢 Clé n°2 : Proxies mobiles 4G/5G de vrais opérateurs

Après plus de deux ans de tests, le constat est clair.

Les proxies bas de gamme, illimités, partagés ou résidentiels donnent des résultats médiocres et sont détectés rapidement.

✅ La seule solution réellement viable repose sur des proxies mobiles réels :

🟢 SFR, Orange, Free, Bouygues ou des opérateurs étrangers reconnus comme Verizon, AT&T ou T-Mobile (US).

🟢 IPs cellulaires naturelles

🟢 rotation organique

🟢 empreintes mobiles crédibles

💰 C’est coûteux, mais c’est le prix de l’efficacité.

🟢 Clé n°3 : Proxies dédiés uniquement

Les proxies partagés sont un danger permanent.

Il suffit qu’un autre utilisateur abuse de la même IP au même moment pour déclencher un red flag immédiat.

🟢 Autres points essentiels

La technique seule ne suffit pas. Le comportement doit suivre.

🟢 Simulez une navigation humaine crédible :

➡️ temps sur page variable (30 secondes à 3 minutes et plus)

➡️ scroll naturel

➡️ mouvements de souris

➡️ retour occasionnel vers la SERP

🟢 Variez absolument tous les paramètres :

➡️ user-agents

➡️ fingerprints

➡️ appareils

➡️ horaires

➡️ géolocalisation précise (via des générateurs de coordonnées GPS cohérentes avec l’IP, par exemple GeoHack ou GPS Coordinates, afin d’éviter les incohérences de localisation. Exemple : un rayon de 200 km autour de Paris permet de générer des milliers de coordonnées GPS réparties de manière crédible.)

✅ La manipulation du CTR fonctionne encore en 2026, mais uniquement dans certains contextes.

⚠️ Il n’y a aucune garantie de résultats.

🚨 C’est du Black Hat SEO.

Cela comporte toujours des risques, même si, dans certains cas, Google se contente d’ignorer l’anomalie.

Par principe, il vaut mieux prévenir que promettre.

#blackhatseo #manipulationctr #ctr

Français

@eldoranext 💯 ils auraient sans doute mieux fait de se spécialiser sur un sujet que de vouloir être partout ils se sont fait dépasser. Il leur reste l'adoption de masse du grand public mais ce qui rapporte de l'argent c'est les entreprises et elles sont en train de switch sur Gemini

Français

@YannDecoopman @512banque Coolify ils ont un MCP pas besoin de passer par le GUI. Ou sinon tu donnes un accès SSH à ton serveur Coolify et il peut de créer des Supabase et les gerer

Français

@512banque ahah, il me fait les setups Coolify en ce moment même car j'y comprends rien non plus..

Français

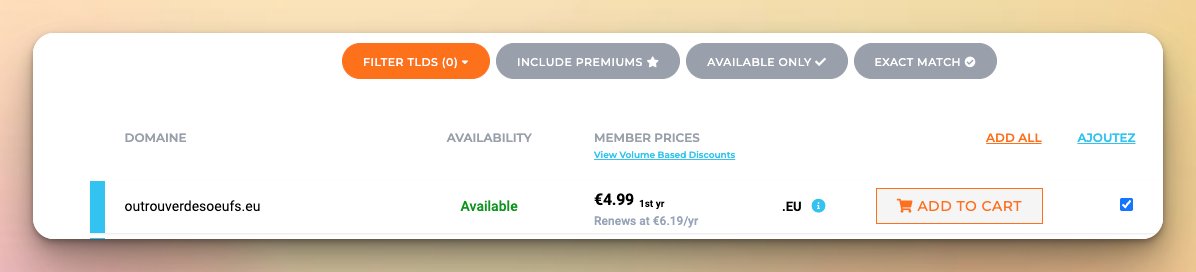

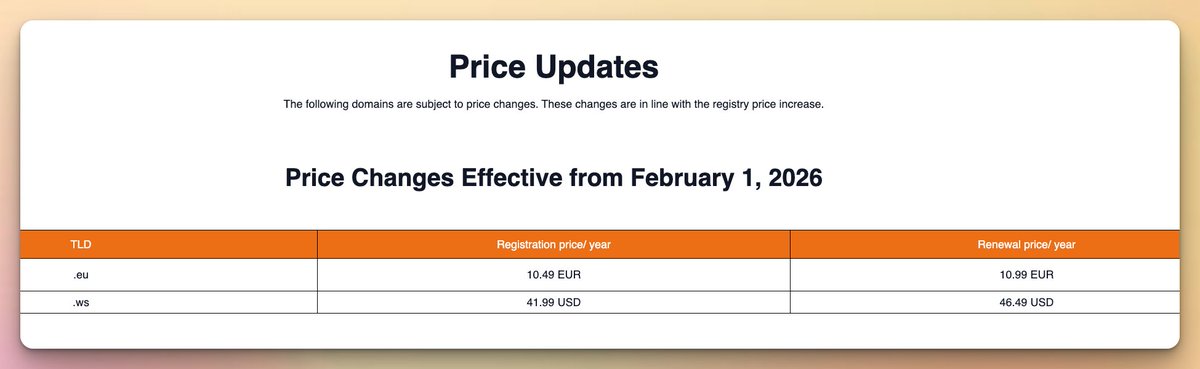

@Mohamed__l C'est chiant à faire mais franchement partez d'InternetBS au moins pour les nouveaux NDD

Français

@Axxl_SEO @Greg0ry ils peuvent rendre le scrape plus couteux en retirant le num=100 et en rendant certains cookies indispensables ce qui oblige à passer par un vrai browser dans le flux d'automatisation mais complètement bloquer, non. Tout ce qu'un humain peut faire via browser, ça s'automatise.

Français

@512banque Ce qui permet d'économiser en frais de proxies pour ceux qui scrapent eux-mêmes. Le nombre de hacks que t'as publié me fait demander combien t'en a gardé privé 🫣

Français

@DavidDarkSEO Ma théorie c'est que la source a beaucoup de jus mais est pénalisée et que l'algo met plus de temps à transférer la pénalité que le jus de la source. Si c'est le cas ce décalage est une faille exploitable 💲

Français

@YvanSEO Non justement, j’ai vue des patern bizare avec plein de site qui rank dans les premier pour des requets mega difíciles, le mec fait des canonical rank dans le premier moi qui suit, refait un canonical ver un nouvelle copie etc… par contre j’ai pas réussi a choper la source

Français