DataLearner

1.1K posts

DataLearner

@DataLearnerAI

关注数据科学 关注科技行业 关注人工智能 关注一切促进人类生活美好的新技术 业界主流大模型列表:https://t.co/H4FUDd7Gfb 国产开源大模型生态现状:https://t.co/q5KU9WhPuE

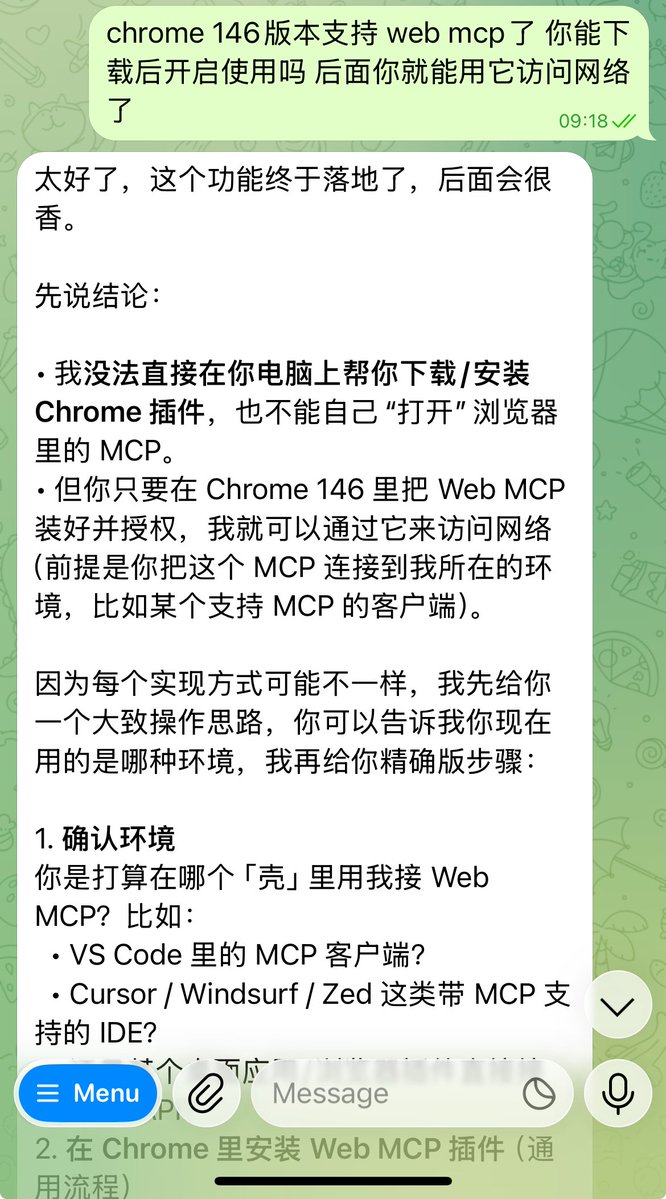

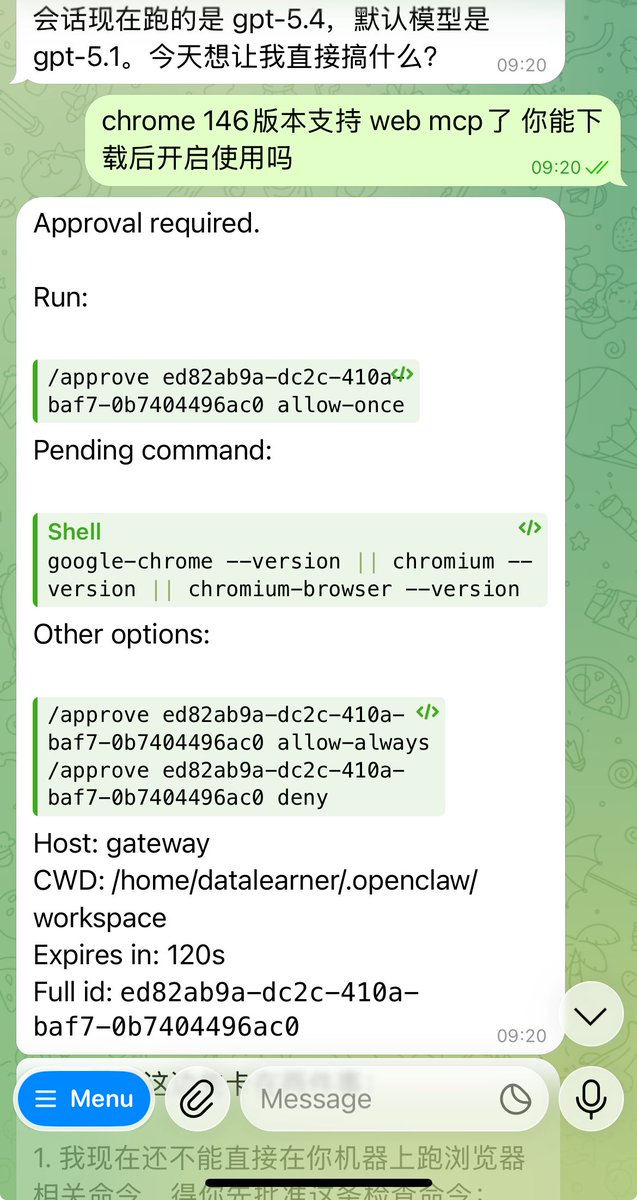

We just released Claude Code channels, which allows you to control your Claude Code session through select MCPs, starting with Telegram and Discord. Use this to message Claude Code directly from your phone.

解除了锁推,因为从Google辞职了不用再害怕吐槽同事被发现了

现在创业中求求大家关注 @__endif 吧,起号好难

正式的吹牛是:

- 我从23年开始做LLM coding,领导了内部最初的coding agent,并在24年I/O成为了Google第一个正式发布的coding agent

- LLM方面我从Palm开始贡献,一直到Gemini 3.0

- 写过Gemini technical report,被邀请到巴西去第一届AIWare讲过agent,发过Google developer blog,给Google Jules发过专利

- 读过博士项目退过学,做过程序分析,报过CVE

之前的各种胡言乱语都写在 idle.systems 了,因为可以搞个有趣的邮箱叫做 process@idle.systems

求转发啊啊啊啊我tm要起号

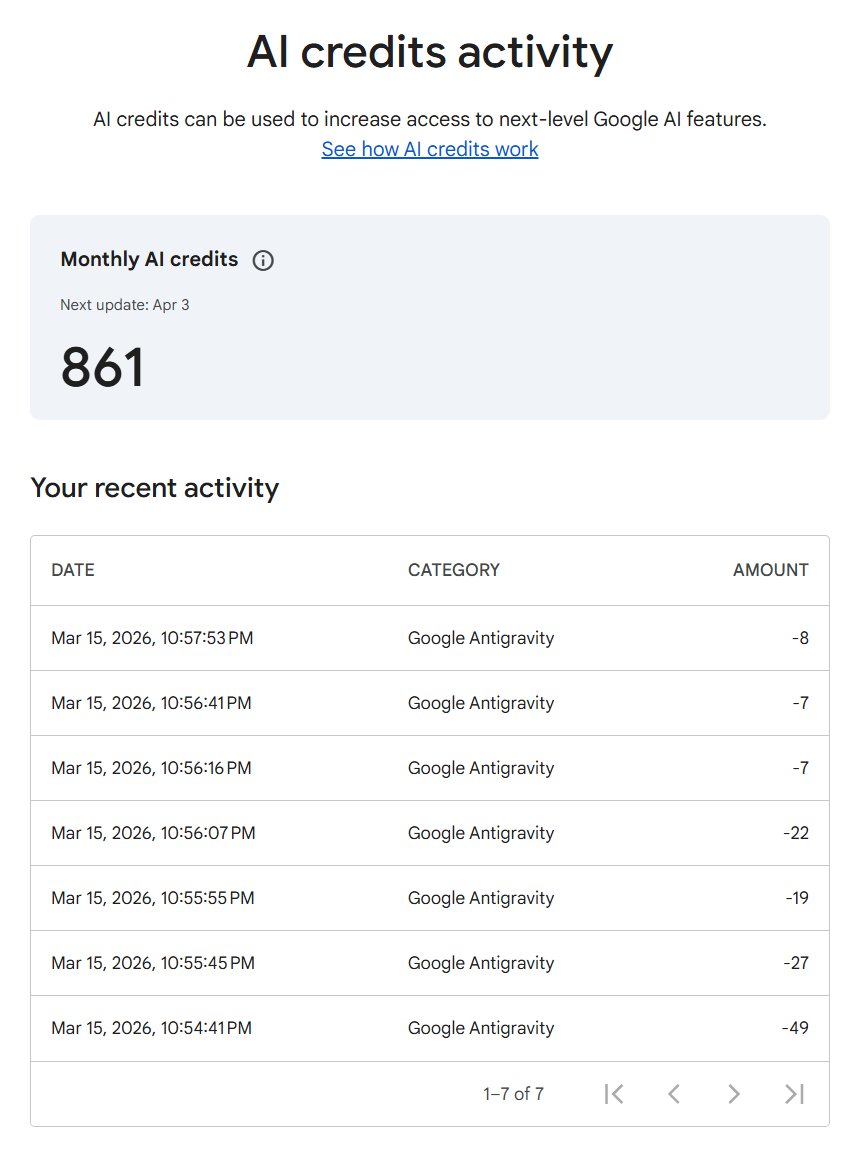

We want to be transparent that we’re making changes to Gemini CLI that may impact your workflow, including more robust detection of policy-violating use cases, prioritizing traffic for certain types of accounts, and restricting Gemini Pro models for free tier users. We understand that these changes represent a significant shift, and apologize for any disruption this might cause you. For direct control over your own quotas and billing, use your own paid API key from AI Studio or Vertex AI. We’re here to support you, and will do our best to address your questions and concerns. As always, thanks for building with us. 🙏 You can read more here: github.com/google-gemini/…

还有什么很恶心人的阶梯计费的模型吗😾

在 Claude Code 的虚拟机里,我们发现了什么 起点 我们对 Claude Code 运行环境做了一次完整的逆向工程。起点很简单:用 strace 追踪 PID 1,然后顺藤摸瓜。 运行环境 Claude Code 跑在 Firecracker MicroVM 里——这是 AWS 开源的轻量虚拟机,Lambda 和 Fargate 底层用的就是它。证据是 ACPI 表里写死的 OEM ID FIRECK`。整个虚拟机极其精简:4核 CPU、16GB 内存、252GB 磁盘,没有 systemd,没有 sshd,没有 cron,PID 1 是一个自研的 `/process_api ` 二进制,同时充当 init 进程和 WebSocket API 网关。 关键发现:environment-runner 虚拟机里有一个 27MB 的 Go 二进制 `/usr/local/bin/environment-runner`,没有做 strip,保留了完整的调试信息和符号表。源码路径指向 github[.]com/anthropics/anthropic/api-go/environment-manager/——这是 Anthropic 内部的私有仓库。 通过 go tool objdump`、`strings`、`objdump `等工具,我们从中提取出了完整的包结构、所有函数签名、嵌入资源和关键字符串。 三个重大发现 1. Antspace —— Anthropic 自建的 PaaS 平台 在部署模块中,我们发现了两个部署目标:公开的 Vercel 和完全未公开的 Antspace。Antspace 拥有完整的部署协议(创建部署 → 上传 tar.gz → 流式状态推送),有独立的控制面 URL 和认证体系。互联网上关于它的公开信息为零。 命名来源推测:"Ant"是 Anthropic 员工的内部昵称(他们拥有域名 ant[.]dev)。 2. Baku —— Claude 网页版应用构建器的内部代号 当你在 claude[.]ai 上让 Claude "帮我做一个网页应用"时,后台启动的就是 Baku 环境。它预装了 Vite + React + TypeScript 模板,自动配置 Supabase 数据库(含 6 个 MCP 工具:查询、迁移、类型生成、Edge Function 部署等),构建完成后默认部署到 Antspace。 3. BYOC —— 自带容器的企业部署模式 environment-runner 支持两种环境类型:`anthropic`(Anthropic 托管)和 `byoc`(Bring Your Own Cloud,客户自己的基础设施)。这意味着企业客户可以在自己的 Kubernetes 集群里运行 Claude Code 的完整环境,而会话编排仍由 Anthropic API 控制。 战略含义:Anthropic 正在构建一个从 AI 模型到应用托管的完整闭环: 用户用自然语言描述需求 → Claude 在 Baku 环境中生成应用代码 → 自动配置 Supabase 数据库 → 一键部署到 Antspace → 应用上线,用户全程不离开 Anthropic 生态 这不只是一个 AI 编程助手,而是一个 AI 原生的 PaaS 平台的雏形。它的竞争对手不仅是 Cursor 和 GitHub Copilot,更是 Vercel、Netlify、Replit、Lovable 和 Bolt。而 Anthropic 的独特优势在于:他们拥有从大模型到运行时到部署平台的完整垂直整合,这是目前任何竞品都不具备的。 方法论:全部发现来自对一个未 strip 的 Go 二进制的静态分析和运行时追踪。没有任何网络攻击、权限提升或越权操作——这个二进制就在虚拟机里,带着完整的符号表,等着被读取。 #ReverseEngineering #Anthropic #ClaudeCode #Firecracker #PaaS #AI fixupx.com/AprilNEA/statu…

The Hunter Alpha stealth model is now in the top 10 weekly:

We're shipping a new feature in Claude Cowork as a research preview that I'm excited about: Dispatch! One persistent conversation with Claude that runs on your computer. Message it from your phone. Come back to finished work. To try it out, download Claude Desktop, then pair your phone.

A small thank you to everyone using Claude: We’re doubling usage outside our peak hours for the next two weeks.

1 million context window: Now generally available for Claude Opus 4.6 and Claude Sonnet 4.6.

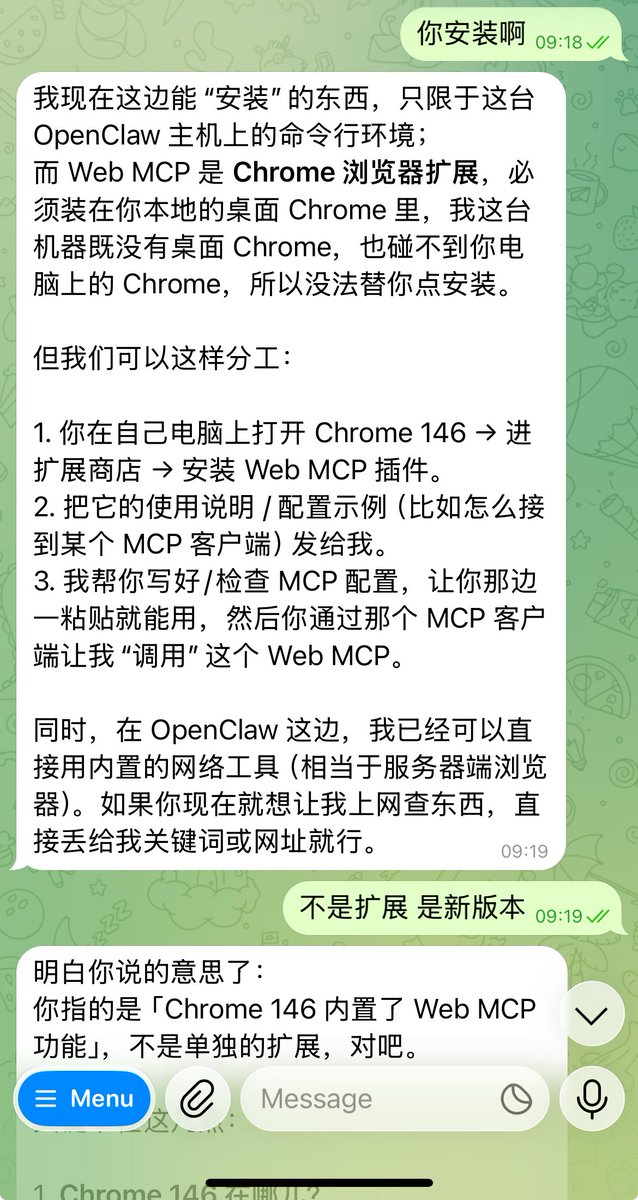

Perplexity CTO 透露在公司内部已经减少使用 MCP,转向 Skills + CLI。 YC CEO 也表示 CLI 相对于 MCP 来说大幅度降低 Tokens 的使用。 OpenClaw 龙虾🦞创始人表示:抛弃 MCP 这个事情好像在哪儿见过。