Zen Kato nag-retweet

Zen Kato

30.6K posts

Zen Kato

@_9dc

La vivo estas tro laciga, la mondo devas esti detruita kiel eble plej baldaŭ.

sonĝo lando Sumali Kasım 2012

1.8K Sinusundan242 Mga Tagasunod

Zen Kato nag-retweet

Zen Kato nag-retweet

Zen Kato nag-retweet

Zen Kato nag-retweet

苹果的MacBook Neo 卖这么便宜,很大一个原因是 CPU 成本低,CPU 成本低是因为用的是 A18 的"残次品"——性能不变哈

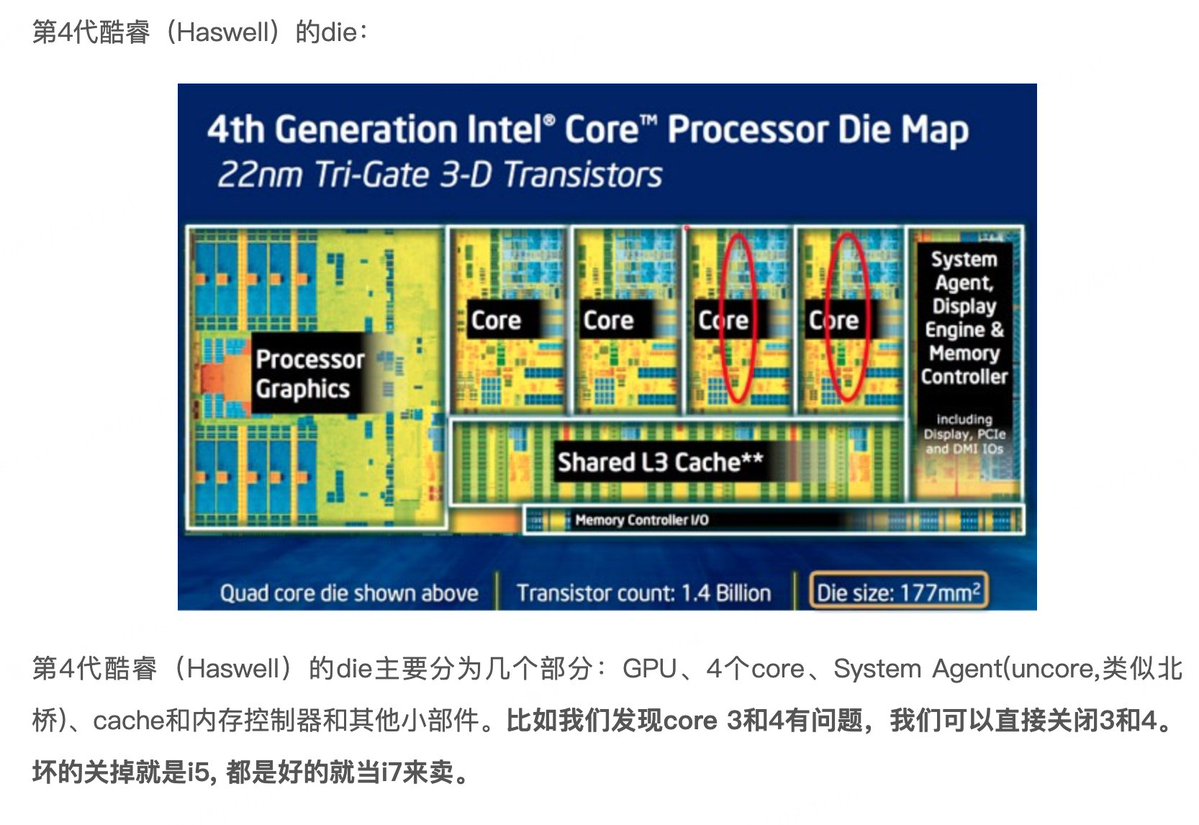

如图是一个 4 核的 CPU,如果生产的时候其中1-2 核是坏的,那么可以将它们关闭当成 2 核来卖

其实我一直想买个 3核 5核这种奇数的 CPU 来体验下,性价比超高

MacBook Neo 用的 A18 Pro 芯片,有两个来源:

1. iPhone 16 Pro 生产线的剩余库存 — 生产了但没用完的合格芯片

2. 有缺陷的芯片经过chip binning(芯片分级筛选)处理 — 比如 6 个 GPU 核心中有 1 个有缺陷,就关掉那个核心,以 5 核 GPU 的规格使用

所以 MacBook Neo 的 A18 Pro 是 5 核 GPU,而 iPhone 16 Pro 是 6 核 GPU。CPU 部分(6 核)保持一致。

这个做法在芯片行业非常普遍,不只是 Apple:

- NVIDIA 的 RTX 4070 就是 RTX 4080 的 binning 版本(关掉部分 CUDA 核心)

- AMD/Intel 的低端型号也经常是高端型号关掉部分核心的产物

- 甚至 Apple 自己的 M 系列芯片,M3 和 M3 Pro 之间也有类似关系

Apple 这次做法的精明之处在于:这些芯片对 Apple 来说几乎是"免费"的 — 不需要额外向 TSMC 下单生产,直接复用已有的库存和"残次品",所以 MacBook Neo 才能做到 $599 的低价。

不过根据最新报道(2026年4月7日),MacBook Neo 卖得太好了,A18 Pro 的库存可能不够用。Apple 正在和供应链讨论是否需要额外生产,但 TSMC 的 3nm 产能基本满了,额外生产成本会很高。Apple 的计划是 2027 年的 MacBook Neo 用

iPhone 17 Pro 的 A19 Pro binning 版本,延续这个循环利用的模式

中文

Zen Kato nag-retweet

Zen Kato nag-retweet

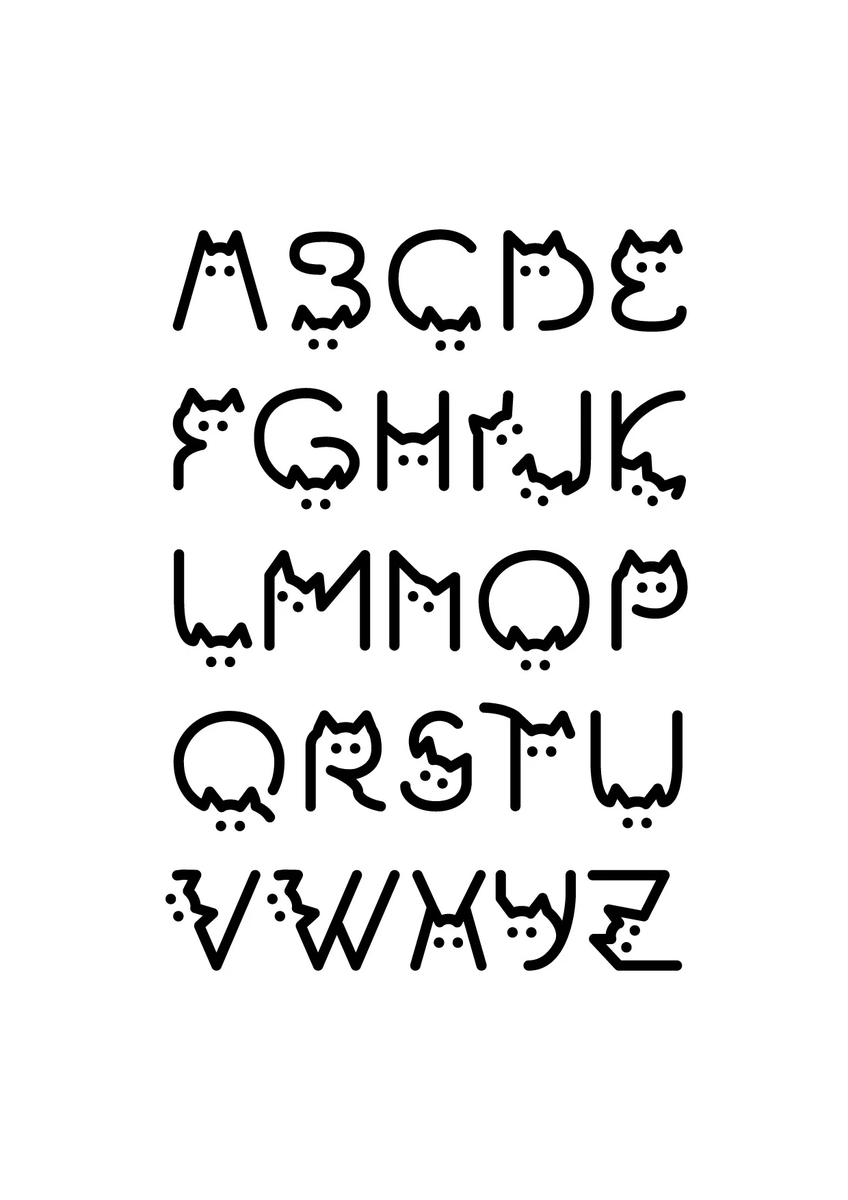

找到字体作者了,是设计师Péter Vasvári的作品,可惜只有alphabet,要是有分大小写和标点符号就好了

behance.net/gallery/762997…

迷状況bot@R18sok

猫好きは全員知ってるらしい

中文

Zen Kato nag-retweet

Zen Kato nag-retweet

Zen Kato nag-retweet

Zen Kato nag-retweet

Zen Kato nag-retweet

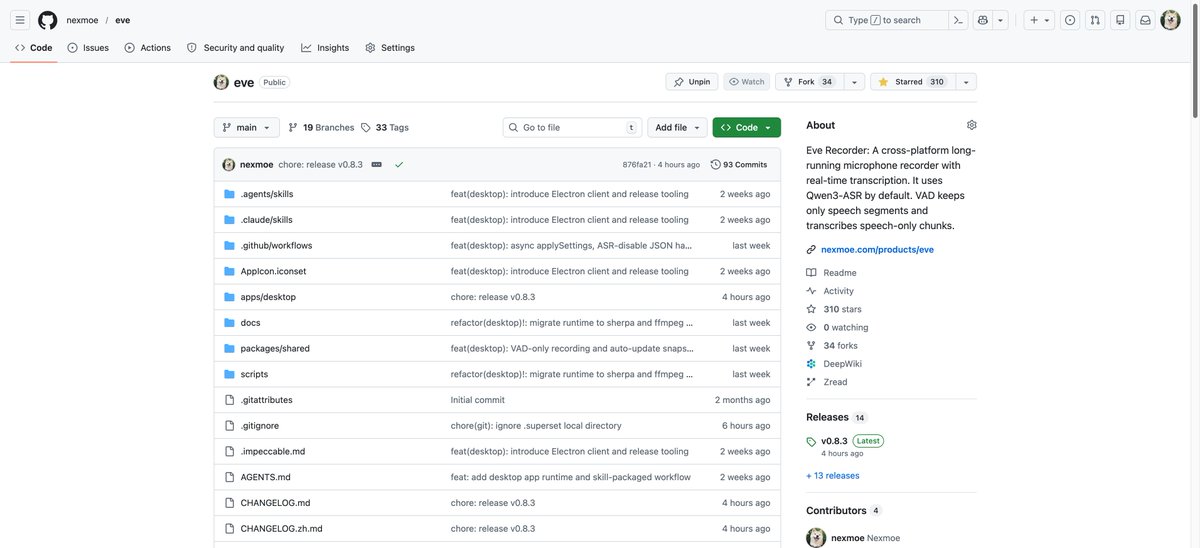

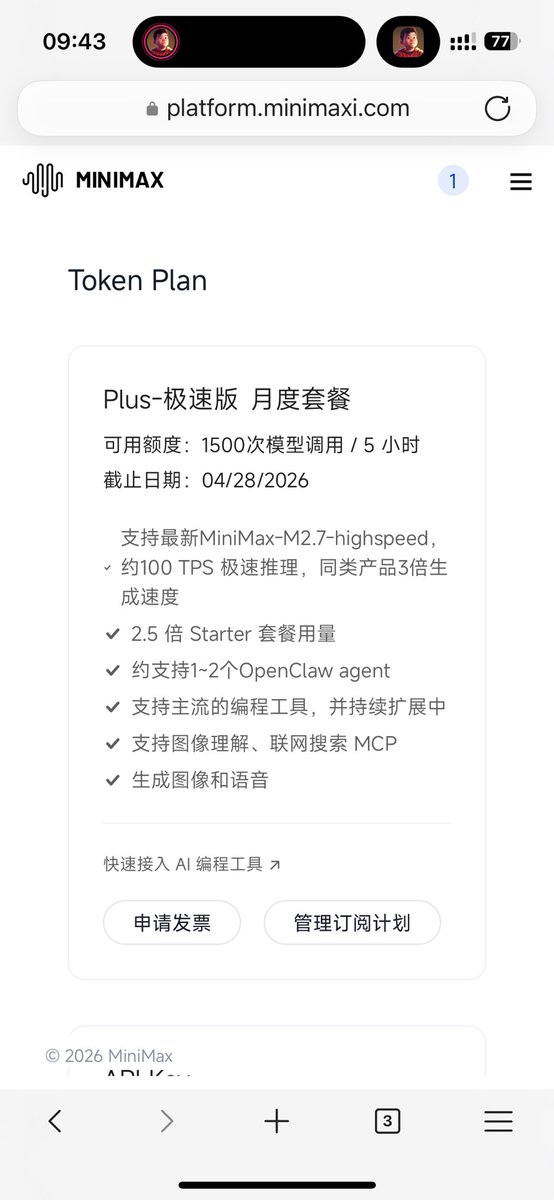

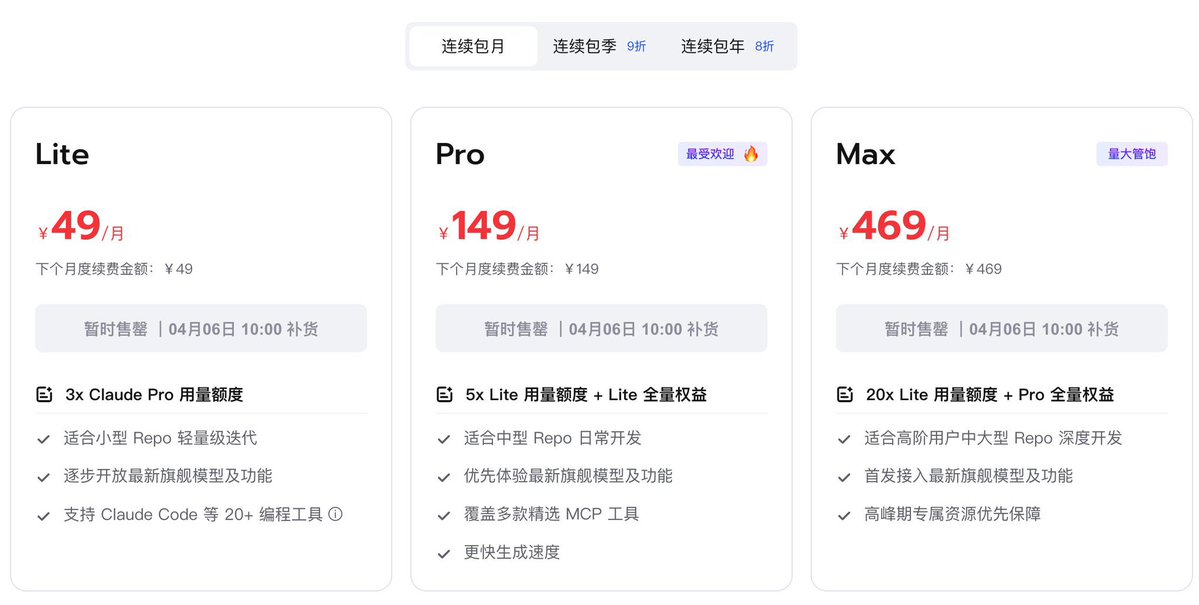

最近刚刚好把国产模型都玩了一遍,包含GLM、MiniMax、Kimi。国外的Gemini、Claude、Codex我也在高强度使用。

国产三个会员我都开了套餐使用了一下,我就说一下我的使用感受。

使用场景:

1、文学创作

Claude > Gemini = Codex > GLM > Kimi > MiniMax

Claude还是当之无愧文学创作方面是用着最舒服的,不管是流程整理,还是文章输出都是最贴近真人的感觉。

2、代码编写

Codex > Claude > Gemini > GLM > Kimi > MiniMax

在代码方面我和大部分人可能不一样,我觉得codex会更舒服,加上官方单独的review额度,精准的查找问题确认BUG。

Claude不敢大量使用,不是说不够好是token不够烧

3、日常任务理解

Claude > Codex = Gemini > GLM > Kimi > MiniMax

在日常使用当中,得益于Claude仔细的任务编排,会把任务做很好的规划,但是在提示词优化或者图片生成方面Gemini给我的最舒服

Codex在脚本编写归纳,也是非常的舒服,所以我会把他放在和Gemini一样的程度。

国产里面GLM是最强的,但是缺货和不稳定时它最大的问题,应该是算力不足。

Kimi本来领先但是最近没有什么新模型的消息所以落后了一点。

Minimax在能力上虽然不行,但是有两个非常明显的特点:

1、量大管饱

2、算力充足反应快

我的小龙虾主力,因为我不需要做复杂的任务,只需要简单的任务编排,量大管饱和反应速度就是我最看重的体验。

本观点只代表个人,如果有不同的观点欢迎评论区讨论。

中文

Zen Kato nag-retweet

Zen Kato nag-retweet

Parlor — 跑在你机器上的实时语音+视觉对话 AI

→ Gemma 4 E2B + Kokoro TTS,全程本地推理,不依赖任何云端 API

→ M3 Pro 上端到端 2.5-3 秒延迟,支持打断、免按键、句子级 TTS 流式

→ ~3GB 内存,Silero VAD 浏览器端检测,摄像头+麦克风双模态

github.com/fikrikarim/par…

中文