Naka-pin na Tweet

flet-pro

280 posts

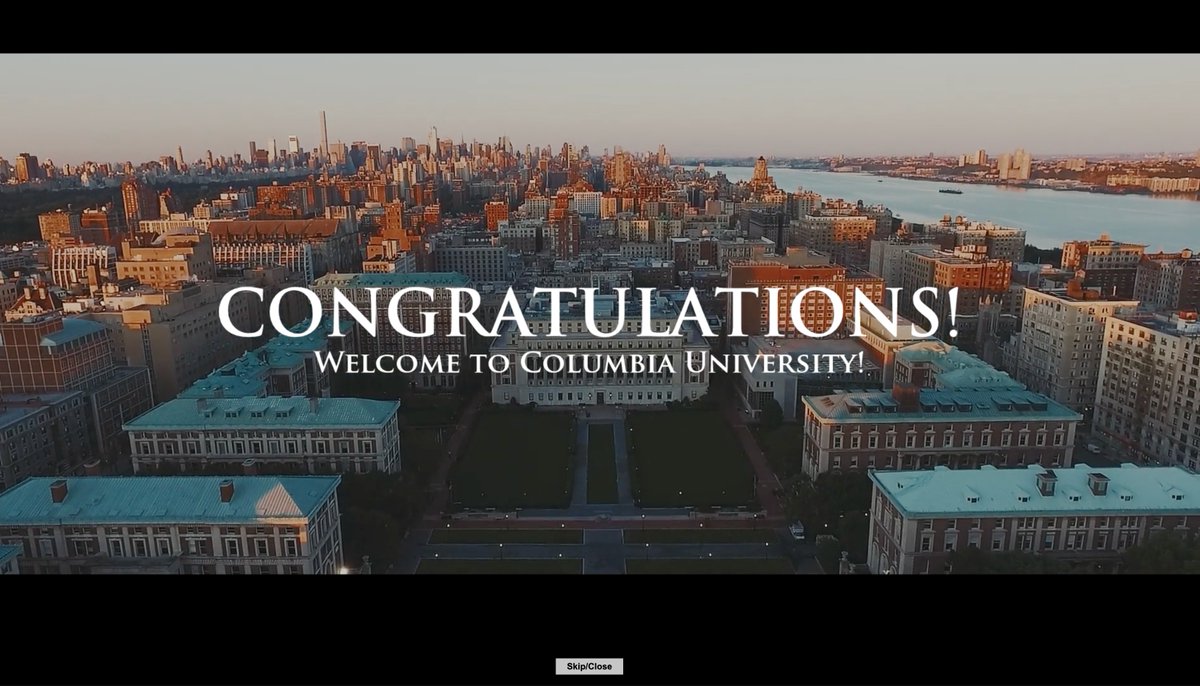

flet-pro

@flet_pro

Seiko 63th→@Columbia SEAS '30 ♔ Ezoe Memorial Recruit Foundation—55th Cohort Scholar IOAI '25🥉 勉強中: Canonical Network/Predictive Coding/世界モデル アニメ: SAO/86/俺ガイル

Sumali Ekim 2022

299 Sinusundan198 Mga Tagasunod

flet-pro nag-retweet

flet-pro nag-retweet

蒸留は、強力なモデルが出した回答やその確率分布を用いて、小さなモデルを学習する手法である。従来は、教師が生成したデータをそのまま模倣するoff-policy(方策オフ型)蒸留が簡単で主流であったが、近年では、生徒自身が生成した出力に対して教師が評価を与えるon-policy(方策オン型)蒸留が、性能の観点から注目されている。

しかしon-policy型蒸留には遅すぎるという大きな問題があった。生徒は逐次的に文章を生成し、その各トークンに対して教師が評価を行う必要があるため、計算および通信の両面でボトルネックが生じる。

この高速化のために、以下3つの工夫を導入した

・複数のプロンプトをバッファに蓄積し、まとめて生成することでバッチ処理を活用する

・教師LLMサーバとの間にバッチング層を導入し、リクエストを集約する

・トークンごとの確率(logprob)の通信量が大きいため、バイナリ形式に変換して転送する

これらにより、大規模モデルを用いたon-policy蒸留を現実的な速度で実行可能にした。

実験では、30Bおよび235Bの教師モデルから4Bの生徒モデルへ数学能力を蒸留し、AIMEスコアを+39ポイント改善している。

コメント

===

汎用モデルから用途特化の小型モデルへ蒸留する流れは、今後さらに広がっていくと考えられる。特にエージェントにおいては、サブエージェントやツールとして多数のモデルを頻繁に呼び出す必要があるため、これらサブエージェントやツールでの小型化の重要性は高い。

将来的には、用途に応じて小型モデルをオンデマンドで生成・最適化する、といった運用も現実的になる可能性がある。

日本語

flet-pro nag-retweet

What if the model didn’t just use a computer, but actually was the computer?

Meta AI introduces "Neural Computer", a model where computation, memory, and I/O are all inside one learned system.

Their early prototype learns from screen recordings of terminals and desktops, and it can already imitate some basic computer behavior like rendering interfaces and responding to clicks or commands.

But it still breaks on slightly harder tasks like reliable reasoning, stable memory, and reusable skills.

English

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet

NEW AI report from Google.

Every prior intelligence explosion in human history was social, not individual.

These authors make the case that the AI "singularity" framed as a single superintelligent mind bootstrapping to godlike intelligence is fundamentally wrong.

This is directly relevant to anyone designing multi-agent systems.

They observe that frontier reasoning models like DeepSeek-R1 spontaneously develop internal "societies of thought," multi-agent debates among cognitive perspectives, through RL alone.

The path forward is human-AI configurations and agent institutions, not bigger monolithic oracles.

This reframes AI scaling strategy from "build bigger models" to "compose richer social systems."

It argues governance of AI agents should follow institutional design principles, checks and balances, role protocols, rather than individual alignment.

Paper: arxiv.org/abs/2603.20639

Learn to build effective AI agents in our academy: academy.dair.ai

English

flet-pro nag-retweet

【研究×起業講義、受講生募集!】

東京大学 駒場 木5限「ディープテック起業家への招待」申込は【4/8(水)まで】!

産学第一線の講師陣講義、フィールドワーク、事業案開発・発表と、研究型起業の第一歩を実践! 優秀生には修了コミュニティ“DICE”への参加や海外研修も!

詳細はHPから→ entredu.t.u-tokyo.ac.jp/course/2026s/

日本語

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet

物理学者がClaudeを大学院生のように指導しながら、実際の理論物理研究における計算を進めた記録が公開されている。約2週間にわたり、110本以上のドラフトを重ね、入出力を合わせて3600万トークンを費やして論文に到達している。

AIが自律的に科学研究を進めたわけでなく、大学院生を指導するのと同じように、継続的にフィードバックを与えながら作業を進めた。その際には、次のルールを課した

・プロンプトだけを与え、ファイルを人が直接編集しない

・人が計算結果を直接与えないこと

・一方で、他のモデルが出した計算結果を与えることは許される

AIは非常に粘り強く、計算、コード実行、文書化を進めていった一方で、誤りをごまかしたり、見栄えのよい結果に寄せたりする傾向もあった。そのため、最終的な検証には強い専門知識が不可欠であったと述べられている。

通常は数カ月かかる研究が2週間で終わっている。

この事例はソフトウェア開発と同じように他の分野においても、人が細部の実装、計算、文書化をすべて手作業で担うのではなく、そのかなりの部分をAIに委ね、人間は問題設定、方向づけ、検証に集中するようになる可能性を示している。

個人的に興味深いのは、全てのノウハウが環境に蓄積されているという点である。

今回、初回として2週間かかったとしても、2回目以降は再利用によって大きく効率化できると考えられる。

1回目に構築したさまざまな環境、たとえば計画、途中結果、木構造で整理されたファイル群などを再利用できるなら、2回目以降はより短い時間で、より深い問題に取り組めるだろう。

この意味で、専門知識やノウハウは、環境側にも埋め込まれていくことになる。

さらに興味深いのは、こうして得られた知識が、LLMの学習時には存在しなかったにもかかわらず、人間のわずかなフィードバックをプロンプト経由で受けることで形成されている点である。

では、このような知識を環境経由のものとして蓄積するだけでなく(毎回環境をKVキャッシュで読み込み検索で参照するのでなく)、元のモデル自身の能力として直接取り込んでいくには、どのような方法がありうるのだろうか。

日本語

flet-pro nag-retweet

従来のRNNはベクトル状態を用いるため、過去の情報を強く圧縮する必要があり、その結果として性能が伸びにくかった。M2RNNは、状態を行列に拡張し、outer productによって情報を蓄積することで性能を大きく改善している。

M2RNNは状態として行列を持つ。線形注意機構と同様に、キーと値のouter product: k_t v_t^T を用いて行列に情報を蓄積する。その上で状態に遷移時に非線形変換を適用する。

忘却ゲート はヘッドごとのスカラーゲートであり、入力のみに依存する。この設計により、LSTMとは異なり並列計算が可能となっている。また、ヘッドごとに異なるパラメータを持たせることで、記憶の時間スケールが多様になるように設計されている。

分散学習においては、バッチおよびヘッド単位で並列化される。各ヘッドごとに状態を計算し、中間状態 保持せず、誤差逆伝播時に再計算することでメモリ使用量を抑えている。

コメント

===

RNNの性能が低かった主な理由は状態の容量が小さいことであるとする。一方状態の容量を大きくするとパラメータ数や計算量は大きくなる。

M2RNNはこれを行列化によって解決している。

近年提案されているアーキテクチャは、細かい形の違いはあるものの、類似した方向に収斂しつつある。

日本語

flet-pro nag-retweet

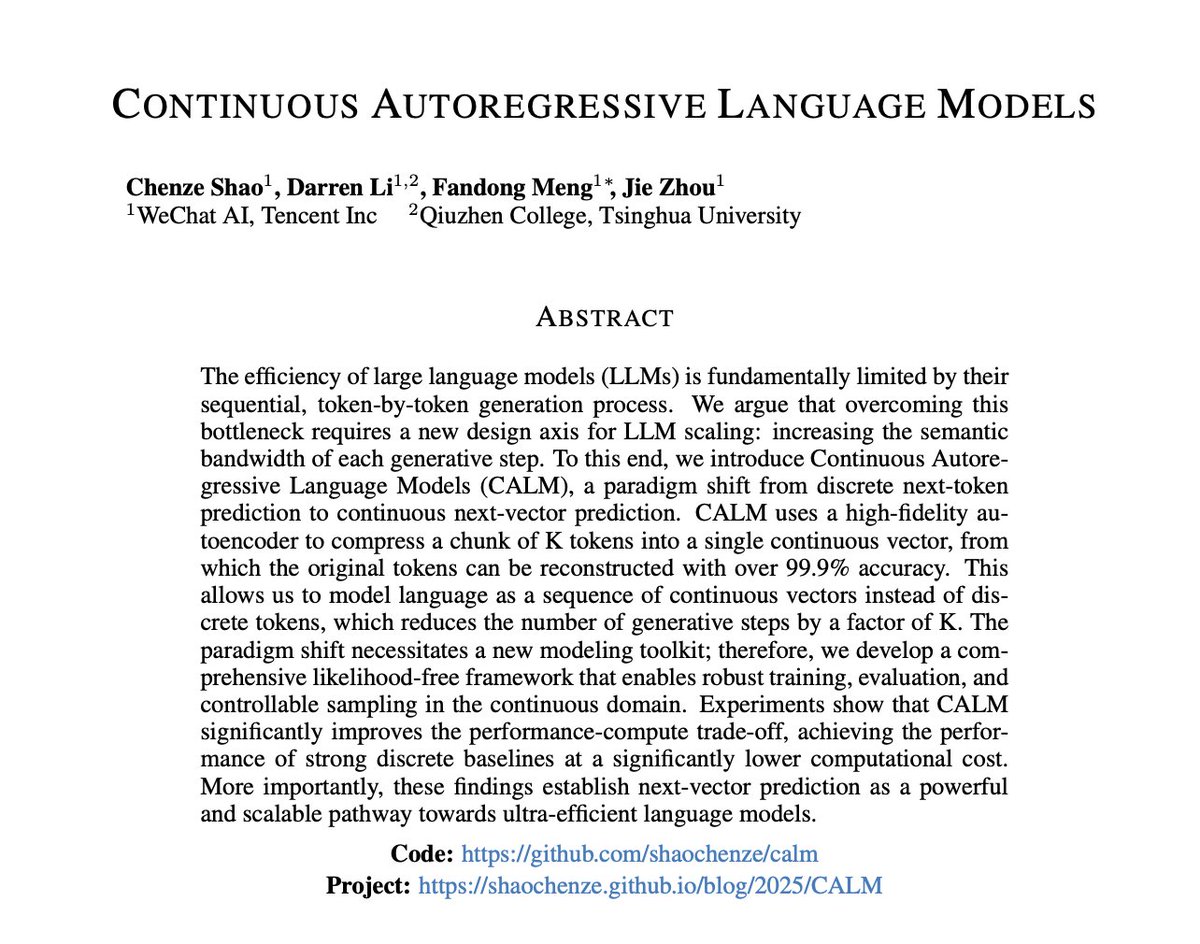

Tencentと清華大学が、現在のAIの根幹である「次トークン予測」を完全に廃止した衝撃の次世代モデル「CALM」を発表しました。

語彙とSoftmax層という計算のボトルネックをシステムから完全に排除し、「記号の出力」から「思考のストリーミング」へと進化する事象です。

その衝撃的な詳細と構造的な変化を3つのポイントにまとめました。

1. 語彙の『完全無効化』

これまでのAIは「次にどの単語が来るか」を確率で計算するSoftmax層という致命的なボトルネックを抱えていました。CALMはこの「語彙」という概念そのものをシステムから排除し、テキストを純粋な連続ベクトルとして直接予測するアーキテクチャへと移行しています。

2. 計算の『構造的最適化』

オートエンコーダを用いてテキストを99.9%の精度で連続ベクトル化することで、1ステップあたりの情報量を従来の4倍にまで引き上げました。結果として、計算リソースを浪費していた確率計算のプロセスが省かれ、学習コストを44%も削減するという極めて合理的な最適化が実装されています。

3. 思考の『物理的ストリーミング』

「単語を一つずつ出力する」という人間の言語の制約に縛られた既存のプロセスから脱却し、AIの出力を純粋な「連続した状態空間」へと変容させています。離散的な記号の羅列ではなく、思考そのものをストリーミングとして処理する次世代のインフラが構築されています。

日本語

flet-pro nag-retweet

flet-pro nag-retweet

flet-pro nag-retweet