پن کیا گیا ٹویٹ

Ali Greo

8.2K posts

Ali Greo

@AliGreo

مطور برمجيات متخصص في الذكاء الاصطناعي وعلم البيانات | للتواصل 👇🏼

شامل ہوئے Mart 2021

953 فالونگ33.2K فالوورز

كورس ممتاز جدا جدا لتعلم الذكاء الاصطناعي من الصفر الكورس مقدم من ستانفورد يعني محتوي غني وقيم للتعلم والفهم

youtube.com/playlist?list=…

العربية

@Alharari01 جرب Nvidia nemotron 3 nano 4b ممتاز جدا جدا في ال agentic tasks

Català

@Alharari01 صحيح اكيد طبعا عشان كذا بقول مهم تختار موديل جيد في ال agentic tasks و تكون عارف انك مش هتاخد اكبر context window ممكنة لكن هل هنقدر نشتغل؟ اه طبعا

متنساش ان ال 4bit quantized version من ال 9b حجمه 4.5gb

العربية

@AliGreo المشكلة مش في جودة اللي بيطلع، المشكلة انه بيعطل ومش بيطلع حاجة لما تحطه في agentic loop

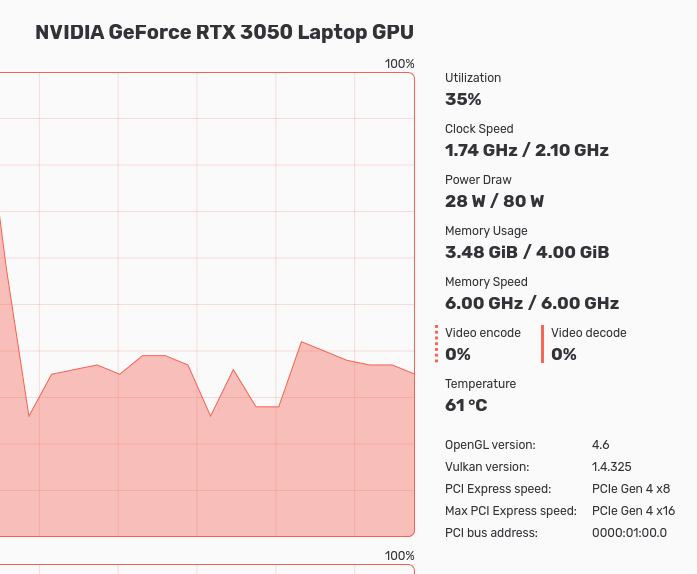

انا عندي نفس الكارت وجربت بيه

العربية

KVCache quantization is a no-no as well

I’d rather quantize the model to 2-bit rather than quantize the KVCache to 4-bit or even 8-bit

Ahmad@TheAhmadOsman

a lot of REAPs out there DO NOT work and are a waste of time lots of lists for models that fit under the 16GB / 8GB are simply useless (I don’t wanna say engagement farming…) there is so much unwarranted hype and I don’t want newcomers to local AI disappointed let’s do better

English

تقنية google الجديدة turbo quant هي تقنية مميزة مسئولة عن ضغط الـ kv cache في الـ LLM لتقليل استهلاك الذاكرة وحفظه في 3bit بدلا من 16bit وده بيقلل الاستهلاك 6 اضعاف وبالتالي استهلاك رام اقل

دي فيديوهات بتشرج طريقة عمل التقنية الجديدة

- youtu.be/g81hslUXe6o?si…

YouTube

العربية

@nawaf__oga لم نعد نميز وطننا حتى ولا مدننا من كثر الاجانب الي عددهم اكثر من المواطنين

و فوقها صاروا يتصرفون بكل بجاحه و محد وراهم

العربية

@Abdulaziz747_Ai كلاود ممتاز وهو ال top مع كودكس بس مكلفين جدا والليميت قليل جدا

العربية

Ali Greo ری ٹویٹ کیا

@R6mezMedhat جرب qwen 3.5 4b وخلي ال context window 8k هتلاقي ال tps عدى ال 20

و هو ضعيف عشان لما ال vram بيتملى الموديل بيلود في ال ssd وده بيخلي العملية بطيئة جدا

العربية