lost wanderer

9.7K posts

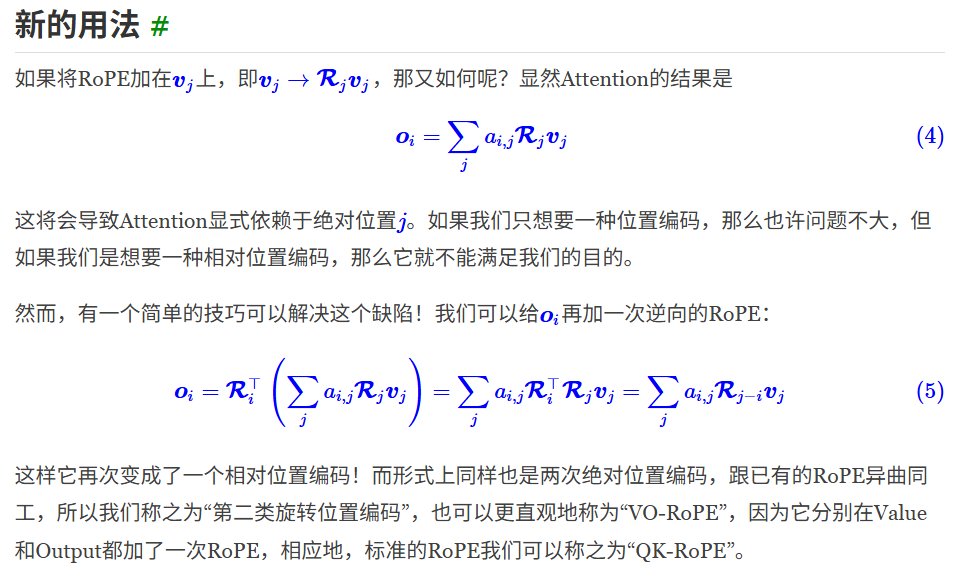

DeepSeek-V4 RoPE Design In-Depth Analysis 🔍 Key technical insights curated from Zhihu contributor kaiyuan 🧩 Core Pain Points of RoPE in DeepSeek-V4 🚨 DeepSeek-V4 leverages RoPE as its positional encoding scheme. However, its upgraded attention architecture raises two fundamental design challenges: • CSA & HCA adopt token compression, merging multiple tokens into one critical representation. The key question: inject RoPE before or after token compression? • The attention layer runs on MQA mode with shared KV representation. Directly applying RoPE rotation to KV will leak positional information into value matrix V — how to resolve this contamination? 💡This breakdown unpacks how DeepSeek-V4 solves RoPE layout around these two dilemmas. RoPE Design Legacy: MLA Mechanism Recap 📚 ✔ Background of MLA Constraints Before analyzing V4, we first review the MLA (Multi-head Latent Attention) adopted in DeepSeek-V2/V3. MLA already encounters the same MQA sharing and KV cache compression issues seen in V4. ✔ Hidden Defect of Shared KV Cache In MLA, downsampled K and V share identical cache weights to cut VRAM usage. The downside: if RoPE is applied to K, V will be rotated together, making V mixed with irrelevant positional information. ✔ MLA Compromise Solution The straightforward fix is splitting K and V, only rotating K — yet this needs separate K/V cache storage, bringing overhead close to GQA. 💡MLA uses an optimized workaround: Reserve a dedicated portion of Q and K hidden dimensions solely for RoPE computation. This keeps positional signals inside K only, avoids polluting V, and only stores lightweight RoPE-related K cache — far more efficient than full K/V separation. RoPE Implementation in CSA & HCA ⚙️ Unified Design Logic of CSA & HCA DeepSeek-V4’s CSA and HCA both face KV cache compression and MQA shared KV troubles. The two modules follow identical RoPE processing logic; the following takes HCA as the typical case. Key Modules Involved in HCA RoPE Four core parts participate in positional encoding: • KV features from sliding window attention (SWA) • Compressed KV output from C128A compressor • Upsampled query Q features • Final attention output matrix O Why Apply Extra Rotation to Output 💡 Root Cause of Absolute Position Bias In shared KV structure, direct RoPE rotation inevitably introduces positional noise into V. HCA only applies RoPE on the final rope_head_dim of window-channel and compressed-channel KV. This operation brings obvious absolute position information into attention output. Drawback of Absolute Position Encoding Absolute position lacks stability, especially for long context extrapolation, far inferior to relative position encoding in scalability. Inverse Rotation Optimization HCA adds an inverse rotation on final output O, converting absolute position expression back to standard relative position form. Simple forward rotation cannot fix the issue — it still keeps the model bound to absolute position logic. Why RoPE Cannot Be Applied Directly to Matrix P ❌ Dimension Mismatch Matrix V follows the dimension layout of sequence and attention head. Matrix P is only a sequence-to-sequence weight matrix with no head dimension. RoPE rotates along head hidden dimension, which matrix P does not have at all. Computational Essence Mathematically, PV calculation equals scalar weights multiplied by feature vectors. P is just a set of scalar weights, with no rotatable vector dimension to support RoPE. RoPE Timing: Before Compression or After Compression 📌 RoPE Position Index Rule RoPE rotation angle is strictly tied to absolute token position index. C128A compresses 128 raw KV states into one single compressed KV token, and QK similarity calculation uses only the compressed K. The core debate: how to assign valid position index for compressed K. Option 1: Rotate Before Compression Rotate every original token with RoPE first, then execute compression. Though logically intuitive, positional signals will be mixed and accumulated along the sequence dimension, destroying the relative position structure required by RoPE. Option 2: Rotate After Compression Assign a unified calibrated position anchor for each compressed K token. The anchor can be segment start, end or midpoint — only needing consistent mapping rules globally. 🧠DeepSeek-V4 Final Choice HCA selects the starting position of each 128-token segment as the position anchor for compressed K RoPE rotation. #DeepSeekV4 #RoPE #LLMArchitecture #TransformerOptimization #AI 🔗Full article: zhuanlan.zhihu.com/p/202913410749…

在支付宝买美股又不丢人。。 兄弟们,我先说句得罪人的话。 很多人觉得在支付宝买基金,是小白才干的事。 觉得真正的投资者,应该开港美股账户、看Level 2行情、盯盘到深夜。 坦率的讲,这种人往往大多数(当然不是绝对)亏得最惨。 为什么? 因为他把仪式感当成了能力,把复杂当成了专业。 真正赚钱的人,根本不在乎你在哪个平台买。 他只在乎,你买的东西对不对。 01) 例如一直支付宝投的一只基金,叫建信新兴市场优选混合。 一季度干了件狠事:狂加仓韩国芯片股。 三星电子从18万股加到40万股,翻了一倍多。 SK海力士从6万股加到10万股,接近翻倍。 今年回报多少? 44%。 更狠的是,这基金前两大重仓不是韩国股,是英伟达和台积电,各占10%。 等于一只基金,同时押中了AI芯片的龙头、代工的老大、还有韩国存储的爆发。 唯一就是现在限额 20 元每天。。。 QDII额度就那么多,想买的人排成队,基金公司只能把门缝越关越小。 心里一万个MMP。 02)为什么美股永远在新高? 很多兄弟不理解,为什么美股能年年新高,A股十年还在3000点。 他们找各种理由:美国经济好、科技公司强、美联储放水。 这些都是表象。 真正的原因是,美股有三台发动机,A股一台都没有。 第一台发动机:401k,美国人的"工资定投机" 美国打工人从入职第一天起,工资自动扣一部分进401k。 这笔钱不能取出来买房、不能炒股、不能消费,只能买基金。 而且绝大部分流向标普500。 全美7000万个账户,每个月像发工资一样准时买入。 2008年金融危机,散户在割肉,401k在买。 2020年疫情熔断,散户在恐慌,401k在买。 2022年加息暴跌,散户在骂娘,401k还在买。 我跟你说,这不是投资,这是制度化的"人肉定投"。 不管牛熊,不管情绪,不管新闻,钱源源不断地流进股市。 A股有这玩意吗? 我们的养老金在干嘛? 买国债、存银行、偶尔买点A股还被人骂"国家队砸盘"。 A股的增量资金从哪来? 从散户的存款里来,从大妈的买菜钱里来。 今天听邻居说新能源火了,追进去。 明天跌五个点,割肉出来骂庄家。 这种资金结构,能稳才怪。 第二台发动机:回购注销,公司给自己"减肥增肌" 2023年,美国上市公司回购了将近8000亿美元自家股票。 关键不是买了,是买了之后注销掉。 什么意思? 公司总股本100亿股,回购注销10亿,剩下90亿。 利润没变,但每股收益涨了11%。 市盈率没变,但股价涨了11%。 这不是做庄,这是合法地给自己"减肥增肌"。 苹果过去十年回购了6000多亿美元,股本少了近40%。 相当于你什么都没干,手里的股票自动升值了40%。 A股呢? A股也有回购,但大部分不是注销,是"股权激励"。 买回来,低价发给高管。 高管拿了股票,转头就减持。 你以为是公司在抬股价,其实是高管在拿你的钱给自己发红包。 更离谱的是减持。 美股大股东减持要公告、要解释、要交重税。 A股大股东减持? 离婚可以减,子女上学可以减,"个人资金需求"可以减。 理由比减持方式还多,花样比上市公司还多。 第三台发动机:美元霸权,全球给美股"交保护费" 沙特卖石油,收美元。 中国出口手机,收美元。 印度做软件外包,收美元。 全世界做生意,最后都攒下一堆美元。 这些美元花不完,放哪? 买美债,买美股。 华尔街就像一个巨大的蓄水池,全球的资金最后都流进来。 美股涨,不是因为美国经济有多好,是因为全世界都在给它"交保护费"。 包括中国。 我们出口赚来的美元,很大一部分最后变成了美债和美股。 等于中国人辛苦打工,间接给美股输血。 A股有这待遇吗? 人民币不是储备货币,全球没有配置A股的刚需。 外资进来,监管说查配资,跑了。 外资进来,说整顿平台经济,跑了。 外资进来,说教培不能搞了,跑了。 来的是热钱,走的是惊弓之鸟。 这种市场,靠谁撑? 靠散户。 散户占交易量70%以上,情绪主导一切。 牛市来了,广场舞大妈开户。 熊市来了,大妈割肉去跳广场舞。 十年一个轮回,原地踏步。 03)A股的死循环 没有401k托底,资金靠情绪。 没有回购注销,公司在割韭菜。 没有全球配置,外资说走就走。 这不是A股不争气。 这是制度层面的先天不足。 更可怕的是,这是一个死循环。 A股不涨 → 散户亏钱 → 没人愿意长期投资 → 市场更依赖短线资金 → 波动更大 → 更不敢长期持有 → A股还是不涨。 美股呢? 401k持续买入 →主权基金持续买入 → 股价稳定上涨 → 散户愿意长期持有 → 市场更稳定 → 更多资金进来 → 股价继续上涨。 两个循环,方向完全相反。 站在A股里想赚钱,等于在逆风的游泳池里往前游。 不是游不动,是费劲。 ---- 坦率的讲,兄弟们,我不是唱空A股。 A股也有好公司,也有赚钱的人。 但问题是,你作为一个普通投资者,在一个散户占70%、没有养老金托底、公司不回购只减持、外资说来就来说走就走的市场里,你的胜率是多少? 10%? 5%? 过去十年,有人拿着A股亏了一半,同期标普涨了两倍。 不是他不努力。 是他站错了池塘。 我跟你说,投资这件事,选对池塘比会钓鱼重要一百倍。 你在一个鱼都快被捞光了的池塘里,技术再好也白搭。 美股那三台发动机——401k、回购注销、美元霸权——只要还在转,美股就还有新高。 A股什么时候能装上这三台发动机? 不知道。 但在那之前,在支付宝买QDII基金,不丢人。 丢人的是,明明有更好的池塘,你非要在一个漏水的船上拼命划桨。

When relativity is involved, physics can get cruel. A 100-ton pole of tungsten, synthetic diamond and CNTs contains 2783 gigatons of TNT worth of kinetic energy when launched at 90% of lightspeed. That's precisely what this inconspicuous megastructure is made to shoot.