Deeju

762 posts

I generate 200+ qualified leads per week and never send a single cold DM the secret: a lead generation skill graph 30+ markdown files wired together that turned my AI agent into a full sales team where it runs: - claude as the AI brain (reads the graph, executes every step) - n8n as the automation backbone (triggers, webhooks, scheduling) - a folder of .md files as the system (no fancy tools needed) the folder structure: /lead-gen-skill-graph ├── index.md (entry point — maps the entire pipeline) ├── content/ │ ├── pillars.md (3-5 core topics that attract your ICP) │ ├── hooks.md (scroll-stopping openers by platform) │ └── cta-playbook.md (which CTA to use where and why) ├── magnets/ │ ├── lead-magnets.md (free resources that capture interest) │ ├── dm-triggers.md (comment keywords → auto-DM sequences) │ └── landing-pages.md (conversion copy frameworks) ├── nurture/ │ ├── dm-flows.md (full DM conversation sequences by platform) │ ├── segmentation.md (tag leads by intent, behavior, stage) │ └── redirect.md (when to move from X/LinkedIn → WhatsApp/Telegram) ├── conversion/ │ ├── offer-stack.md (what you sell, at what price, to whom) │ ├── objections.md (every "no" mapped to a response) │ └── close-scripts.md (DM closes on-platform + messenger closes) └── audience/ ├── icp.md (ideal customer profile — specific, not vague) └── stages.md (cold → warm → hot → buyer journey) each file = one knowledge node inside each file you add [[wikilinks]] to related nodes example: inside dm-triggers.md: "when someone comments [keyword] on a post from [[pillars]], send them [[lead-magnets]] via DM. use tone from [[dm-flows]]. tag them in [[segmentation]] as 'engaged-warm'. if they reply, continue the [[dm-flows]] nurture sequence. match [[icp]] before any outreach" the agent reads one file → follows the links → executes the full pipeline without you touching anything the key file is index.md — your command center put 3 things in it: 1. who you are + what this system does "lead generation system for [your brand]. turns content into qualified leads and closes them via DMs on autopilot across X, LinkedIn, WhatsApp, and Telegram" 2. the node map with context - [[pillars]] — 3-5 content themes that attract buyers, not just followers - [[hooks]] — platform-specific openers, updated weekly - [[cta-playbook]] — "comment X" vs "DM me" vs "link in bio" logic - [[dm-triggers]] — keyword detection → automated first touch - [[lead-magnets]] — free resources matched to each funnel stage - [[dm-flows]] — full DM nurture sequences, platform-native tone - [[segmentation]] — cold/warm/hot tagging + behavior-based routing - [[redirect]] — rules for when to move conversation to WhatsApp/Telegram - [[offer-stack]] — products mapped to lead temperature - [[objections]] — pre-written responses to every common pushback - [[close-scripts]] — DM close on X/LinkedIn, messenger close on WhatsApp/Telegram 3. execution instructions "when given a content topic: check [[pillars]] for alignment. write post using [[hooks]] + [[cta-playbook]]. set [[dm-triggers]] for engagement capture. route new leads through [[segmentation]] → [[dm-flows]]. when lead hits 'hot' → check [[redirect]] for platform routing → deploy [[close-scripts]] with [[objections]] handling" here's what makes this different from a basic funnel: it's NOT a linear pipeline where everyone gets the same 5 messages it's a graph where every lead gets routed based on how they entered and what they did next > commented on X post → DM with lead magnet → replied → DM nurture flow → showed buying intent → close in X DMs > engaged on LinkedIn → DM with case study → asked about pricing → redirect to WhatsApp → close on WhatsApp > DM'd you directly on X → skip nurture → qualifying questions → offer stack → close in Telegram same offer. different path, timing, tone, and platform per lead the graph encodes all those rules. claude reads them. n8n executes them the n8n part: - webhook triggers when someone comments a keyword - claude reads the graph → decides which node to execute - n8n sends the DM, tags the lead, routes to the next step - when a lead goes hot → n8n handles the redirect to WhatsApp/Telegram - every action loops back into the graph for the next decision you build the intelligence in .md files you build the automation in n8n claude is the bridge between thinking and doing this replaced my $3-5k/mo in lead gen tools and a part-time VA one folder of markdown files + one AI agent + one automation tool = infinite lead engine however, currently I am building even smarter system by covering full closing cycle, with 100% personalized approach & process of the lead there's no more pre-made funnels, but absolutely unique once specifically for each lead yeah, that's what exactly we do in Close AI and currently we're opening "Whitelist" stage we provide to you a full-ready for implementation system, you just pay basic costs of our spends (with no extra charge from our side) if you're interesting in, apply here: forms.gle/VX55roCUeh3mLo… study this. save it so you don't lose it ❤️

Ceux qui travaillent dans des métiers manuels disent encore qu'ils ne seront jamais remplacés... voyez plutôt ce qui suit. La Chine est en train de construire des usines à données pour robots. À une échelle que personne n'avait anticipée. Ce que vous voyez sur cette vidéo : des rangées d'opérateurs humains équipés de casques VR et de contrôleurs, qui téléopèrent des robots humanoïdes en temps réel. Chaque geste est capturé, enregistré, puis envoyé dans le cloud pour entraîner l'IA. C'est comme ça que les robots apprennent. Pas en lisant du code. En copiant des humains (tant que les modèles monde ne seront pas opérationnels). Le plus grand centre de ce type vient d'ouvrir dans le Sichuan, à Zigong. 6 000 m². Objectif : 15 000 données d'entraînement par jour. 3 millions d'entrées de haute qualité par an. Un nouveau métier est né : "entraîneur de robots IA". Les opérateurs portent des casques VR, leurs mouvements sont répliqués en temps réel par les robots Walker S2. Tri de colis, préparation de café, ménage. Tâche après tâche, le robot accumule des milliers de trajectoires de données par session. Pourquoi c'est crucial : la Chine compte plus de 140 fabricants de robots humanoïdes et plus de 330 modèles différents. Le goulot d'étranglement n'est plus le hardware. C'est la donnée. Et la Chine résout ce problème par la force brute : des centaines de travailleurs dans des centres géants qui font des tâches banales pendant des heures. Les ouvriers se surnomment eux-mêmes "cyber-travailleurs". Parallèlement, le 29 mars, la première ligne de production automatisée de robots humanoïdes en Chine a démarré dans le Guangdong. Capacité : 10 000 unités par an. Un robot sort de la chaîne toutes les 30 minutes. Goldman Sachs estime le marché mondial des robots humanoïdes à 38 milliards de dollars d'ici 2035. Pendant que l'Occident débat de l'IA ... la Chine entraîne des armées de robots. Littéralement. La prochaine révolution ne s'écrit pas en lignes de code. Elle s'apprend par imitation. Et elle a déjà commencé.

1/ Insane: A single injection into the inner ear reversed deafness in all ten patients. Some started hearing again within weeks. Gene therapy just crossed a threshold we thought was still years away. Lets dig into this breakthrough and how it works 🧵

@EricBuess Yep, working on improving clarity here to make it more explicit

@nb4ld Le truc est la: vous prétendez remplacer les avocats sur des dossiers qu’on ne prend pas parce que ça rapporte pas. Ben parfait. Allez y.

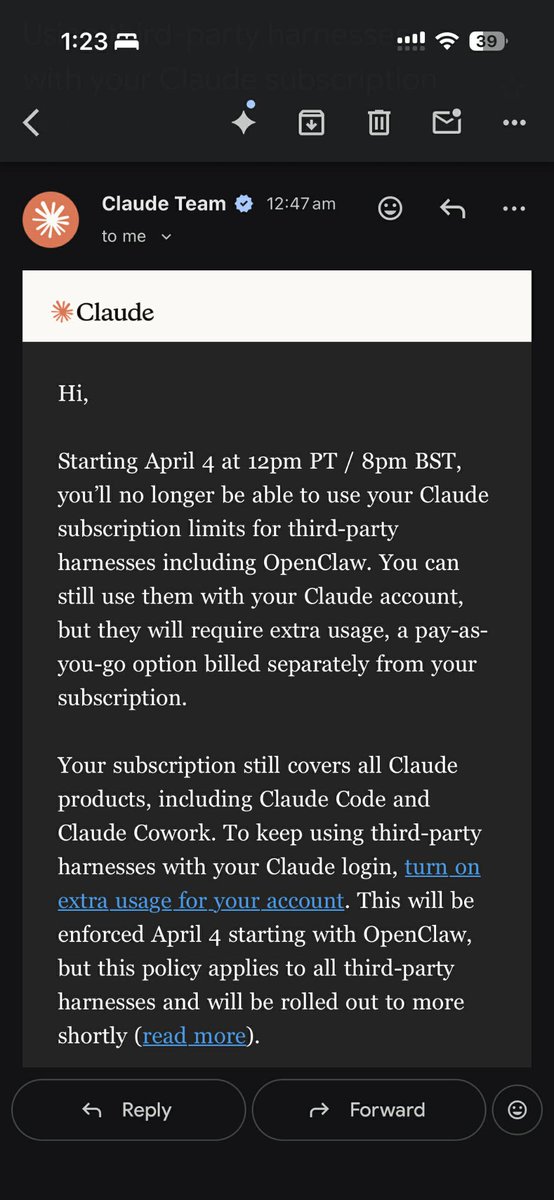

Le harness, pas le modèle : Stanford vient de montrer où se joue vraiment la performance IA Voilà un article qui n'est pas du réchauffé. On entend beaucoup parler de harness engineering ces derniers mois. Le terme revient dans les blogs d'Anthropic, d'OpenAI, chez Martin Fowler, et même jusque sur la timeline du tweet FR. Mais jusqu'ici c'était surtout de l'intuition de praticien : "ouais, le code autour du modèle compte énormément". Tout le monde le sentait, personne ne l'avait vraiment formalisé ni prouvé à grande échelle. Stanford vient de le faire. Et les résultats donnent une perspective très différente de ce qu'on lit d'habitude sur les benchmarks de modèles. Le papier s'appelle Meta-Harness: End-to-End Optimization of Model Harnesses. Publié le 30 mars 2026 par Yoonho Lee, Chelsea Finn, Omar Khattab (MIT) et une équipe Stanford/KRAFTON. Ce qu'ils montrent tient en une phrase : le plus gros levier de performance dans un système IA aujourd'hui, ce n'est pas le modèle : c'est le code autour du modèle. Et ce code peut maintenant être optimisé automatiquement, mieux que ne le font les humains. Commençons par le début : c'est quoi un harness Si tu utilises un LLM dans un produit, un agent, un pipeline tu as un harness. Même si tu ne l'appelles pas comme ça. Le harness, c'est tout le code qui entoure le modèle et qui décide : -> Ce que le modèle voit à chaque étape (quel contexte on lui envoie) -> Ce qu'on stocke en mémoire entre les appels -> Ce qu'on récupère et quand (retrieval, RAG, exemples few-shot) -> Comment on construit le prompt à chaque tour -> Ce qu'on fait de la réponse du modèle avant le tour suivant Concrètement : le system prompt, la logique de RAG, la gestion de mémoire, l'orchestration agent, le choix des outils, le formatage des résultats tout ça c'est du harness. Et le point central du papier : tu prends le même modèle, les mêmes poids, tu changes uniquement le harness, et tu peux observer un écart de performance allant jusqu'à 6x sur le même benchmark. Six fois. Même modèle. C'est un chiffre qu'on retrouve dans la littérature (SWE-Bench Mobile, entre autres), mais que l'industrie a tendance à ignorer parce que toute l'attention va aux annonces de nouveaux modèles. Stanford remet ce fait au centre. Le problème : le harness engineering est encore artisanal. Aujourd'hui, optimiser un harness c'est un processus manuel. C'est un peu comme régler un moteur à l'oreille : tu testes, tu écoutes, tu tournes une vis, tu retestes. Sauf que là c'est du code, chaque test coûte du compute, et tout repose sur l'expérience de l'ingénieur qui tourne les vis. Il existe des méthodes automatiques pour optimiser des "artefacts texte" : des prompts, des templates. OPRO, TextGrad, AlphaEvolve/OpenEvolve, GEPA, TTT-Discover. Mais ces méthodes ont toutes le même défaut : elles compriment le feedback. Certaines ne donnent à l'optimiseur que des scores numériques. D'autres génèrent un résumé par LLM de ce qui s'est passé. D'autres encore limitent le feedback à des templates courts. Dans tous les cas, l'optimiseur travaille avec entre 100 et 30 000 tokens d'information par itération. Le problème : un harness agit sur des horizons longs. Un seul choix de design. Par exemple, ce qu'on décide de stocker en mémoire peut affecter le comportement du système des dizaines ou des centaines d'étapes plus tard. Quand tu comprimes le feedback en un score ou un résumé, tu perds exactement l'information dont tu as besoin pour comprendre pourquoi le système a échoué. C'est le cœur de la contribution de Stanford : ils ont construit un système qui ne comprime pas. Meta-Harness : le système Le principe est simple à décrire. L'exécution est massive. Meta-Harness est une boucle d'optimisation. À chaque itération : Un agent codeur (dans leurs expériences : Claude Code avec Opus 4.6) a accès à un filesystem complet contenant tout l'historique des tentatives précédentes : le code source de chaque harness testé, les scores obtenus, et les traces d'exécution complètes (les prompts envoyés au modèle, les réponses, les appels d'outils, les mises à jour d'état). L'agent inspecte ce qu'il veut dans ce filesystem. Il utilise grep, cat, il navigue dans les fichiers. Il n'ingère pas tout d'un bloc, il choisit ce qu'il lit. Il propose un nouveau harness (un programme Python complet). On évalue ce harness sur un jeu de tâches. On stocke tout (code, scores, traces) dans le filesystem. Et on recommence. L'agent lit en médiane 82 fichiers par itération dans le setting le plus exigeant. Il référence plus de 20 candidats précédents par étape. Et le volume d'information diagnostique disponible par évaluation peut atteindre 10 millions de tokens : trois ordres de grandeur au-dessus de ce que les méthodes précédentes utilisaient. C'est la différence fondamentale. Pas un nouveau trick algorithmique. Pas une nouvelle architecture. Juste : donner à l'optimiseur l'accès complet aux données brutes, et le laisser décider quoi regarder. Le résultat qui change tout : la compression tue le signal C'est le résultat le plus important du papier. Et celui qui a les implications les plus larges, bien au-delà du harness engineering. L'équipe a fait une ablation propre en comparant trois configurations d'interface pour l'optimiseur, sur la même tâche de classification de texte : Scores seuls : l'optimiseur ne voit que les scores numériques de chaque candidat. Résultat : 34,6 % de précision médiane, 41,3 % au meilleur. Scores + résumé LLM : on génère un résumé par LLM de chaque exécution et on le donne à l'optimiseur en plus des scores. Résultat : 34,9 % médiane, 38,7 % au meilleur. Les résumés font légèrement pire que les scores seuls sur le meilleur candidat. Traces brutes complètes (Meta-Harness) : l'optimiseur a accès au code source, aux traces d'exécution, aux logs complets. Résultat : 50,0 % médiane, 56,7 % au meilleur. L'écart entre l'interface complète et l'interface compressée est de 15 points de médiane. Et le candidat médian de Meta-Harness bat le meilleur candidat trouvé sous n'importe quelle condition compressée. Pourquoi les résumés ne marchent pas ? Parce qu'un choix de design dans un harness (qu'est-ce qu'on stocke en mémoire, quand est-ce qu'on le récupère, comment on formate le prompt) peut se propager à travers des centaines d'étapes en aval. Pour comprendre pourquoi un harness a échoué sur une tâche donnée, il faut pouvoir tracer la chaîne causale complète : quel prompt a été envoyé, quelle réponse est revenue, quel état a été mis à jour, comment ça a affecté les étapes suivantes. Un résumé, aussi bon soit-il, détruit cette chaîne. Un score encore plus. C'est une leçon qui s'applique directement à quiconque construit des systèmes d'agents, du RAG complexe, ou de la mémoire persistante : si tes boucles d'optimisation travaillent sur des résumés plutôt que sur des traces brutes, tu perds le signal qui compte.

JUST IN: Artemis II crew experiences issues with Microsoft Outlook on their way to the Moon, asks ground crew for assistance.

this is the lineup that has been winning at every tier i've tested. 27B one shotted a full game on a single 3090. 9B built a playable version on 12GB of VRAM. now i loaded alibaba's 122B flagship unquantized on 2x H200 NVL and gave it the same job as nvidia. build me a GPU marketplace from scratch. coded 1,054 lines in a single file from one prompt on hermes agent. one shot. served it successfully to localhost. Qwen3.5 122B-A10B. pure MoE transformer. 10B active params out of 122B total. 61.5 tok/s at BF16 unquantized across 287GB of VRAM. full width layouts. particle effects. polished aesthetic. every section with detail. same prompt nvidia got, different result. this model doesn't just build. it finishes. nvidia coded 769 lines. qwen coded 1,054. same hardware, same prompt, same harness. tonight they both face the real test. octopus invaders. multi-file autonomous build with hermes agent. a game i open sourced so anyone can test their model against the same challenge. watch the video to the end for the full UI walkthrough.