Koby🇫🇷

40.7K posts

Angehefteter Tweet

@Maazamangue94 Ouais j’capte, en + y’en a qui ont a distance donc t’aurais pu être avec eux

Français

@basemilitaire_ Mais déjà moi je pensais y’avait qq chose à gratter genre az c tjrs un plus d’être dans les pljs boostés et en plus y’avait mes darons à côté de moi quand j’ai fzir le test donc c’était dur des résister mdr

Français

Genre peut-être vous voyez ce que j'appelle du bleu et vous appelez ça du vert

K 🇵🇸@Mezinke

Vous pensez le vert que je vois c'est le même vert que vous voyez ?

Français

Koby🇫🇷 retweetet

Koby🇫🇷 retweetet

@LordBidoof4 @rzamd92 @OKCThunderFR Mais malgré le fait qu’il soit sous côté, Doncic lui met quand meme une distance dans ce domaine c’est pas un drame

Français

@basemilitaire_ @rzamd92 @OKCThunderFR Alors "tuer" SGA en playmaking c'est vraiment parler sans regarder ses matchs mdr. C'est une de ses qualités les plus sous côtés. Ce que je relève chez Lucas c'est qu'il est bien plus inconstant pendant cette saison. Je trouve que son CV pour le MVP commence à se garnir trop tôt.

Français

@basemilitaire_ @llogo36413303 @SASpursFr oui oui sauf que l'an dernier ça bien attendu okc denver en play off

Français

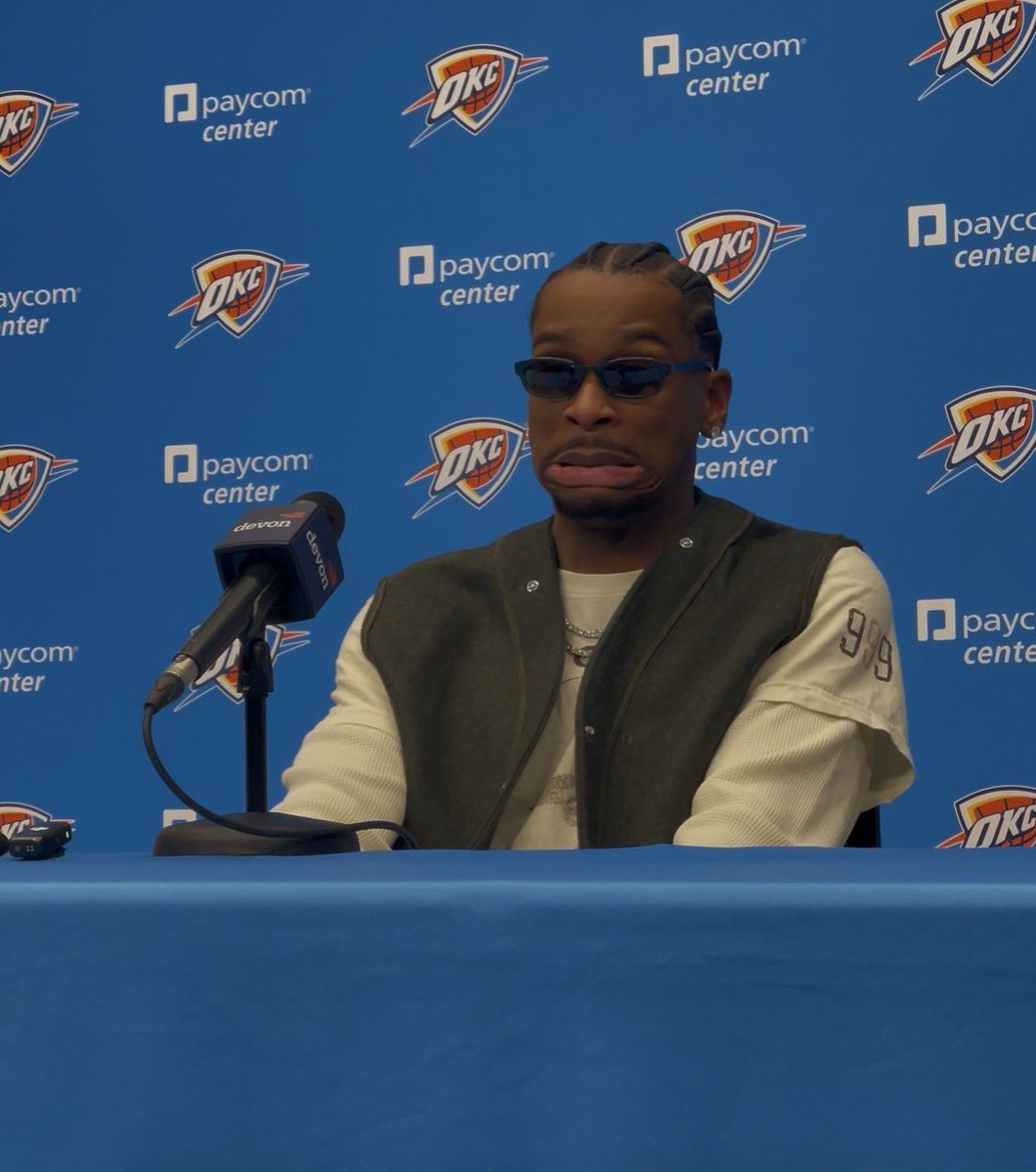

Je crois qu'on peut définitivement tourner la page du MVP hein, il est trop fort ce con.

50 Nuances 🇺🇸🏀@50NuancesDeNBA

SHAI GILGEOUS-ALEXANDER CE SOIR : 40 POINTS 7 ASSISTS 3 REBONDS 17/27 FG | 1/2 3-PTS | 5/8 FT …EN 32 MINUTES ! ⏱️ ET LA WIN FACE AUX WIZARDS ! 👀✅ SEPTIÈME MATCH À 40+PTS CETTE SAISON POUR LE MVP EN TITRE ! 🔥

Français

@dieter345 @JdponTransfem Dcp d’après toi faut faire quoi ? Redonner le droit de fumer en intérieur, dans les métros, les salles de cours, les bars etc ? C’est quoi le projet ? Revenir au pic de la cigarette ?

Français

@JdponTransfem ça fait des décennies que les fumeurs sont culpabilisés : ils puent, ils empoisonnent leurs enfants, ils n'ont aucune volonté, ils ne devraient pas avoir la sécu. loies hygiénistes ridicules et liberticides ( interdit de vapoter à moins de 10 m d'une école ). C'est dur de...

Français

Après faut peut être vous culpabiliser un minimum psq vous êtes super chiant

The Pirate Queen@PirateQueenTV

C'est le genre de bouquin qui va culpabiliser les consommateurices (majoritairement prolos, racisé'e's, LGBTIA+, et de toutes minorités). C'est contre-productif de ouf

Français

@llogo36413303 @SASpursFr Pcq le mvp c’est uniquement sur la saison régulière

Français

@SASpursFr Après jvais dire un truc con mais comment sa se fait on sait déjà les 3 premier mvp de souce sur et que shai va sans doute le gagner alors que les play off etc vont débuter que bientôt ?

Français

c'est les fans de ce mec qui crachent sur SGA toute la journée mdrrrr

BGB♛@BonesGotBizzy

“An ethical 60”

Français

7km en 35min c’est faible pour un gars de la marine mdrrrrr

🇫🇷 fred le gaulois 🇫🇷 Uniondesdroites 🐱🐱@FredGaulois

L'armée dépense des sommes considérables dans des systèmes de brouillage sophistiqués, et tu as un abruti qui utilise une application de géolocalisation pour savoir combien de kms il a fait durant son footing sur le porte avion Charles de Gaulle🤦♂️

Français

@DelawarBluMagic @deyv_g Ça a aucun rapport ? Messi peut pas se faire cibler sur chaque possession

Français

@deyv_g Comme Léo au foot par ex. Pourquoi lui demander de se la donner défensivement ? Avec le ballon il te fait tout 😂

Français

@Nerdrous @SASpursFr D’accord mais est ce qu’ils ont le même impact que wemby sur le terrain

Français

@KaioAE5 @MarblePreda @WatashigaEren @Barbz_lb Tu comprends pas que ça a pas de sens de remettre en question l’avis de la personne que tu aimes ? Genre elle est pas sensée te mentir

Français

@MarblePreda @WatashigaEren @Barbz_lb n'importe quel mec un tant soit peu intelligent peut se poser des questions, peut avoir des doutes sur ses performances en dépit de toutes remarques. Mais bon apparemment c'est trop demander pour certains gars ici de réfléchir sur ce qui se passe en dehors de leurs intérêts

Français