arimang ꧁IP꧂(Ø,G)

6K posts

arimang ꧁IP꧂(Ø,G)

@luvsw2

NFT lover Story Protocol ꧁IP꧂ WAGMI Based angel

Beigetreten Temmuz 2022

4.1K Folgt437 Follower

兄弟们,Headless Chrome 该退休了!

有人用 Rust 搓了个专给 AI Agent 和爬虫用的无头浏览器引擎——Obscura,性能直接把 Chrome 按地上摩擦:

① 内存只吃 30MB(Chrome 吃你几个G)

② 启动只要 85ms,快得离谱

③ 整包才 70MB,Chrome 装完硬盘哭了

还支持 CDP 协议,Puppeteer、Playwright 无缝接,你原来的脚本不用改一行。

最绝的是 stealth 模式——随机化指纹、主动拦截追踪器,爬站被封概率直接拉低一个档次。

CLI 一条命令搞定单页抓取,想并行跑多个 URL 也行,起个 WebSocket 服务给自动化脚本挂着用也没问题。

Rust 写的性能怪物,爬虫党和 AI Agent 开发者必须看一眼。

🔗 github.com/h4ckf0r0day/ob…

中文

arimang ꧁IP꧂(Ø,G) retweetet

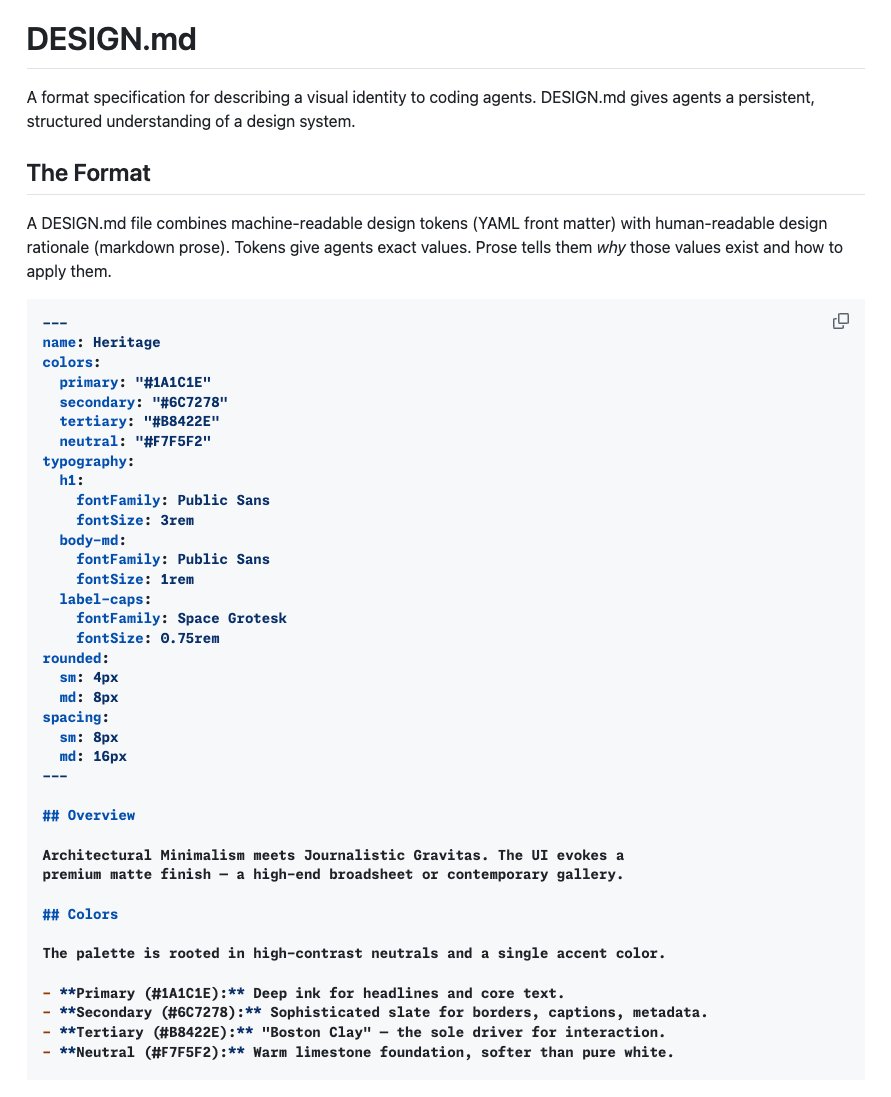

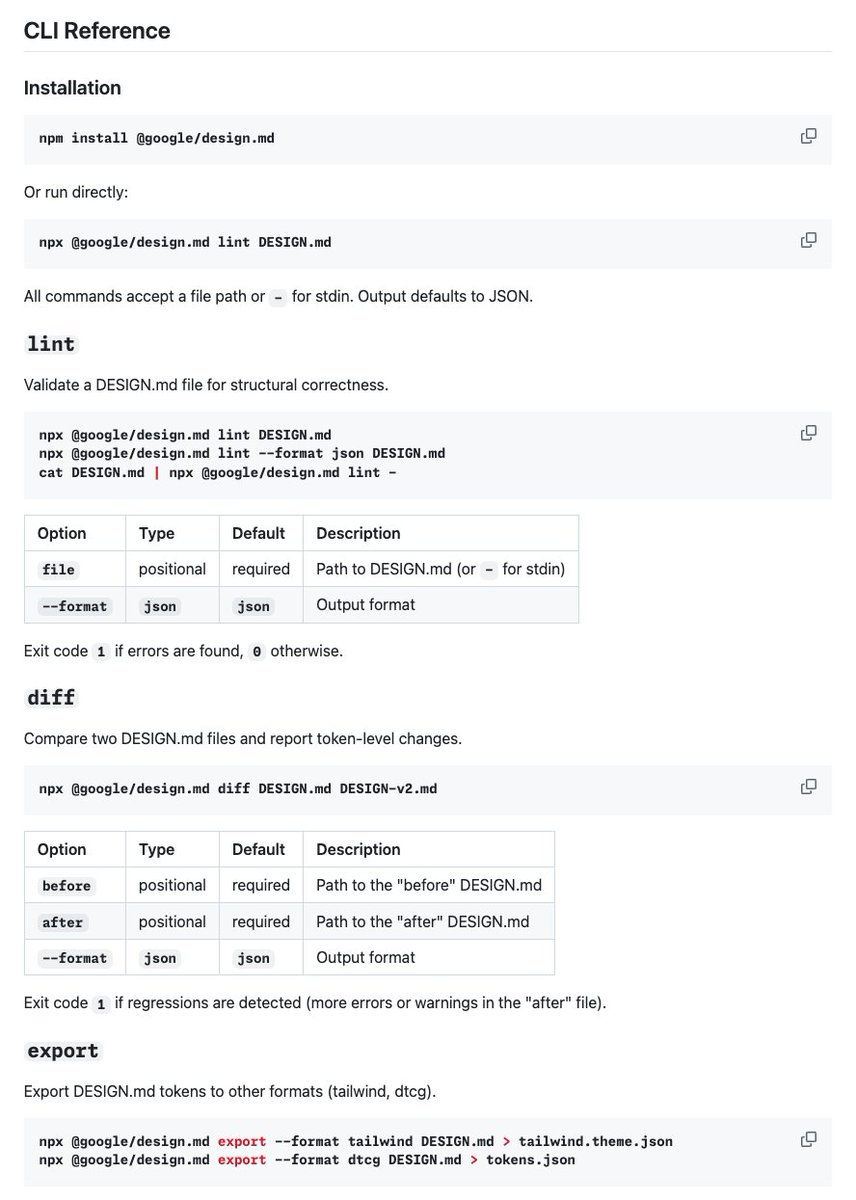

억 이번에 구글에서 DESIGN.md 스펙을 더 구체화할 수 있는 CLI 도구도 공개했네요!

github.com/google-labs-co…

DESIGN.md

= AI 코딩 에이전트에게 디자인 시스템을 전달하기 위한 파일 포맷 스펙

아이디어 자체는 단순하죠. 이걸로 디자인 시스템의 "언어"를 에이전트에게 알려주니까요.

여기에 CLI 도구도 함께 공개됐는데, 실용적인 기능이 꽤 들어있어요.

> npx @google/design.md lint DESIGN.md

이렇게 하면 형식 검사, 깨진 토큰 참조 감지, WCAG 명암비 체크까지 JSON으로 돌려줘요.

> npx @google/design.md diff DESIGN.md DESIGN-v2.md

두 버전을 비교해서 어떤 토큰이 추가/수정/삭제됐는지, 품질 저하가 생겼는지를 감지하기도 하구요.

Tailwind CSS / W3C DTCG 이걸로 export 기능도 지원!

AI 코딩 에이전트를 프론트엔드 작업에 활용하는 분들이라면 도움 많이 되실 듯..

한국어

도주하던 10대 오토바이…경찰차 정면 차단, 과잉 대응 논란

한밤중 빠른 속도로 달리던 10대 2명. 신호 위반, 지그재그 운전, 계속되는 도주. 경찰은 여러 번 멈추라고 했지만 이들은 끝까지 속도를 줄이지 않았습니다.

그런데 그다음 장면이 문제였습니다. 반대편에서 달려오던 경찰차가 갑자기 중앙선을 넘어 정면으로 방향을 틀어버린 겁니다. 도망치던 오토바이는 피할 틈도 없이 그대로 충돌했고, 두 명은 그대로 도로 위로 날아가듯 쓰러졌습니다.

결과는 충격적이었습니다. 운전하던 10대는 목뼈 골절로 중상을 입었고, 친구도 팔과 다리 인대가 파열됐습니다.

가족들은 분노했습니다. 단순 위반인데 왜 목숨까지 위험해질 정도로 막았냐는 겁니다.

하지만 경찰의 입장은 완전히 다릅니다. 이미 수차례 위반했고, 정지 명령도 무시했다. 최소한의 물리력으로 검거한 것이라는 주장입니다.

문제는 바로 이 지점입니다. 정면 충돌로 막는 방식, 이게 과연 정당한 공권력일까요? 아니면 과잉 대응일까요?

여러분이라면 이 상황에서 경찰의 선택, 맞다고 보시나요?

한국어

GitHub의 Rowboat 프로젝트는 사용자의 업무 데이터를 **지식 그래프(Knowledge Graph)**로 변환하여 실질적인 업무를 돕는 오픈소스 AI 개인 비서(Coworker) 프로젝트입니다.

이 프로젝트의 핵심 개념과 주요 특징을 정리해 드립니다.

1. Rowboat란 무엇인가?

Rowboat는 단순한 챗봇이 아니라, 사용자의 이메일, 회의록, 캘린더 등에서 맥락을 추출하여 **'장기 기억'**을 구축하는 도구입니다. 이 데이터는 사용자의 컴퓨터에 Markdown(마크다운) 형식으로 저장되며, 이를 바탕으로 문서 작성, 회의 준비, 정보 추적 등의 작업을 수행합니다.

2. 주요 기능 및 활용 사례

지식 그래프 시각화 및 편집: 업무 데이터를 연결된 그래프 형태로 관리합니다. 마크다운 기반이므로 Obsidian(옵시디언) 같은 도구와도 호환됩니다.

문서 및 프레젠테이션 생성: "다음 분기 로드맵에 대한 덱(Deck)을 만들어줘"라고 요청하면, 지식 그래프의 맥락을 사용해 PDF 슬라이드를 생성합니다.

회의 준비(Meeting Prep): 특정 인물과의 회의 전, 과거의 결정 사항, 질문, 관련 스레드를 요약하여 브리핑해 줍니다.

라이브 노트(Live Notes): 특정 주제(경쟁사, 프로젝트 등)를 지정하면 뉴스, Reddit, X(트위터) 등을 모니터링하여 자동으로 노트를 업데이트합니다.

음성 메모: 음성으로 메모를 남기면 자동으로 핵심 내용을 추출해 지식 그래프에 반영합니다.

3. 기술적 특징 (How it works)

로컬 우선(Local-first): 모든 데이터는 사용자의 머신에 저장됩니다. 개인정보 보호를 최우선으로 하며 데이터가 외부 서버에 종속되지 않습니다.

모델 선택의 자유 (BYOM): Ollama나 LM Studio를 통해 로컬 LLM을 사용할 수도 있고, OpenAI/Anthropic 같은 클라우드 모델의 API 키를 연결해 사용할 수도 있습니다.

MCP(Model Context Protocol) 지원: Anthropic에서 발표한 MCP를 지원하여 검색, 데이터베이스, Slack, Jira 등 다양한 외부 도구와 쉽게 연동됩니다.

Composio 통합: 다양한 제품 통합 라이브러리를 통해 외부 툴과의 연결성을 확장했습니다.

4. 기존 AI 도구와의 차이점

일반적인 AI 도구는 사용자가 질문할 때마다 관련 문서를 검색(RAG 방식)하지만, Rowboat는 **시간이 지날수록 누적되는 명시적인 관계망(지식 그래프)**을 유지합니다.

전통적 방식: 매번 검색하여 단기적인 답변 생성.

Rowboat: 과거의 결정과 맥락이 연결되어 시간이 흐를수록 AI의 '기억'이 더 정교해짐.

5. 설치 및 설정

OS 지원: Mac, Windows, Linux용 설치 파일을 제공합니다.

외부 서비스 연동:

Google: Gmail, Calendar, Drive 연동 가능.

음성: Deepgram(입력), ElevenLabs(출력) API 지원.

검색: Exa AI를 통한 웹 리서치 지원.

요약하자면:Rowboat는 **"나만의 업무 지식을 마크다운 기반의 그래프로 관리하고, 이를 LLM이 읽어 업무를 보조하게 만드는 로컬 AI 허브"**라고 할 수 있습니다. 특히 데이터 보안이 중요하거나, 파편화된 업무 맥락을 하나로 묶어 관리하고 싶은 사용자에게 유용한 도구입니다.

더 자세한 정보나 설치 파일은 Rowboat GitHub 저장소에서 확인하실 수 있습니다.

한국어

Anthropic just got punched in the face. ⚡️

This kills the idea of “paying for AI coworkers”:

• 100% local (no data leaks)

• Talks. Listens. Acts.

• Works with ANY LLM

• Agents running while you sleep

• Builds its own brain over time

Open-source.

Free.

And getting smarter every day.

We’re not renting intelligence anymore.

We own it.

GitHub github.com/rowboatlabs/ro…

English

arimang ꧁IP꧂(Ø,G) retweetet

paperclipai 비슷하게

agent 일 시키는 회사 web을 개발/구성했는데, token을 너무 많이 써서 보니,,,

llm token너무 많이 쓰지 않는지 점검

현재 LLM 토큰 사용량을 점검한 결과, 상당히 높은 수치가 기록되어 원인을 분석하고 조치를 취했습니다.

📊 점검 결과

전체 토큰 사용량: 약 1억 2,400만 (124M) 토큰

에이전트별 최대 사용: Backend-dev, Frontend-dev, CEO, DEV 에이전트들이 각각 누적 2천만(20M) 토큰 이상을 사용했습니다.

건당 최대 사용량: 특정 1회 런(Run)에서 Frontend-dev가 약 380만(3.8M) 토큰, DEV가 약 150만(1.5M) 토큰을 한 번에 소모한 것으로 확인되었습니다.

🔍 원인 분석

이러한 막대한 토큰 소모의 주된 원인은 프로젝트 내에 무시(Ignore) 파일이 설정되어 있지 않았기 때문입니다. AI 에이전트(Gemini CLI)가 코드 베이스의 컨텍스트를 파악할 때 다음 파일과 폴더들을 통째로 읽어들이고 있었습니다:

auto_company.db (약 147MB의 데이터베이스 파일)

debug_gemini.txt (에이전트 로그가 쌓여 약 42MB가 된 파일)

node_modules/, venv/, __pycache__/ 등 방대한 라이브러리와 환경 폴더

에이전트가 단일 작업을 위해 저 수십 MB짜리 더미 파일들을 LLM 컨텍스트에 욱여넣다 보니 한 번의 호출로도 수백만 토큰이 소진된 것입니다. (비용 낭비와 응답 지연의 주범)

🛠️ 조치 사항

이를 해결하기 위해 프로젝트 전체(Root, Backend, Frontend 폴더)에 .gitignore 및 .antigravityignore 파일을 생성하여 다음 규칙을 적용해 두었습니다.

DB 파일 제외: *.db, *.sqlite, auto_company.db

거대 로그 파일 제외: debug_gemini.txt, debug_notification.txt 등

환경/빌드 폴더 제외: venv/, node_modules/, __pycache__/, dist/ 등

✅ 이제 에이전트는 무거운 파일들을 스캔하지 않고 실제 소스 코드에만 집중하게 되므로, 향후 토큰 사용량이 획기적으로 줄어들고 반응 속도도 훨씬 빨라질 것입니다. 추가로 점검할 부분이 필요하다면 말씀해 주세요!

한국어

arimang ꧁IP꧂(Ø,G) retweetet

ㅋㅋ 구글 Research 팀이 만든 오픈소스 TimesFM.

시간 시리즈 데이터만 있으면 거의 모든 산업 미래 예측 가능함.

크로스보더 이커머스 폭주, 재고 최적화, 코인/주식 변동, AI 데이터센터 전력 수요까지 다 커버.

100B+ 실데이터로 미리 학습돼서 zero-shot으로 바로 쓰고, 성능은 전문 모델급인데 완전 로컬+무료+Apache 2.0.

GitHub에 올려놨으니 바로 테스트해보라는 내용.

만능 예측기라면서? ㅋㅋ 진짜 써봐야 알겠다.

github.com/google-researc…

한국어

arimang ꧁IP꧂(Ø,G) retweetet

저의 요즘 클로드 최애 도구

AI가 말귀를 못 듣는다구요?

그건 바로 ouroboros가 필요하시군요!

1. github.com/Q00/ouroboros 설치

2. ooo interview "원하는 거 입력" 실행

3. 요구사항이 명확해질 때까지 AI가 계속 질문함

4. AI가 정리해서 스펙을 만들어줌

AI가 말귀를 못 알아듣는 게 아니라

사실은 우리가 원하는 게 뭔지

우리도 모르는 경우가 많슴다

ooo로 생각 정리하고 개발하십쇼

아이반 IVAN@0ooooo0

AI가 못 만드는 게 아니라, 우리가 제대로 못 알려준 검다 AI한테 개발 맡길 때 “할 일 관리 앱 만들어줘” 이렇게 모호하게 물어보시지 않씀까? 근데 그렇다고 자세히 말하려고 하면 어디까지 자세히 말해야 할지도 모르겠고, 정작 나 자신도 뭘 어떻게 만들지 명확하지 않을 때가 많슴다 그래서 결국 AI가 대충 만듦 → “아 이거 아닌데” → 다시 시킴 → 또 아님 → 반복 이 루프의 원인은 AI 성능이 아니라 입력의 품질임다 그런데 이 입력을 제대로 만드는 방법이 있슴다..!

한국어

arimang ꧁IP꧂(Ø,G) retweetet

장안의 화제 - mirofish를 나오자 마자 LLM을 만든 문서4개를 넣고 돌려봤는데, 너무 오래 걸려서 포기했다가 오늘 다시 gemini에 물어보니, 친절하게 답변해줘서 다시 시도해보려 합니다.

질문 :

mirofish를 github에서 받아서 실행한 뒤, 첨부 문서 4개를 업로드하고 "트럼프 임기말까지 발생 가능한 일, 미국 경제에 미치는 영향"을 물어봤는데 분석에 너무 오래 걸리는 데 개선점은 ? 문서4개가 너무 많아 ?

답변 :

MiroFish와 같은 온톨로지(Ontology) 시각화 및 지식 추출 도구에서 4개의 문서를 한꺼번에 분석하는 것은 문서의 개수보다 '비정형 데이터의 양'과 '추론 방식' 때문에 과부하가 걸릴 가능성이 큽니다.

사용자께서 업로드하신 4개의 문서는 각각 트럼프의 세금 정책, 에너지 전략, 경제적 영향 등을 다루는 매우 밀도 높은 텍스트입니다. MiroFish가 이를 분석할 때 시간이 오래 걸리는 원인과 이를 획기적으로 개선할 수 있는 팁을 정리해 드립니다.

1. 분석이 오래 걸리는 이유 (Bottleneck 분석)

비정형 텍스트의 구조화 작업: 일반적인 챗봇(RAG)은 텍스트를 읽고 답변만 하지만, MiroFish는 텍스트 안에서 **'개체(Entity)'와 '관계(Relationship)'를 추출하여 그래프(Graph)**를 그립니다. 4개 문서의 양이 상당하기 때문에 이 관계망을 형성하는 데 엄청난 연산이 필요합니다.

중복 관계 계산: "트럼프", "경제", "관세"와 같은 키워드가 4개 문서에 반복적으로 등장합니다. MiroFish는 이 문서들 사이의 연결 고리를 계산하며 온톨로지를 병합(Merging)하는데, 데이터가 많을수록 계산 복잡도가 기하급수적으로 늘어납니다.

LLM 토큰 제한 및 API 속도: 만약 MiroFish 내부적으로 LLM API를 호출하여 구조화한다면, 업로드한 텍스트의 총량이 토큰 한계를 넘거나 API 응답 대기 시간이 길어질 수 있습니다.

2. 성능 개선을 위한 실전 팁

① 문서를 '구조화된 데이터'로 변환 후 업로드 (가장 권장)

MiroFish에 생(Raw) 마크다운 문서를 바로 주는 대신, Gemini나 ChatGPT를 활용해 **미리 구조화된 포맷(JSON-LD, Turtle, 또는 CSV)**으로 변환해서 입력해 보세요.

방법: "이 4개 문서의 내용을 MiroFish에서 인식하기 쉬운 Node(개체)와 Edge(관계) 리스트의 JSON 포맷으로 요약해줘"라고 명령한 뒤, 그 결과물만 MiroFish에 넣으면 분석 시간이 90% 이상 단축됩니다.

② 문서별 '단계적 업로드' 및 병합

4개를 한꺼번에 올리지 말고, 가장 핵심이 되는 문서(예: trump 정책.md)를 먼저 올려서 기초 뼈대(Ontology)를 잡은 뒤, 나머지 문서를 하나씩 추가하며 업데이트하는 방식을 사용하세요. 이렇게 하면 툴이 처리해야 할 실시간 연산량이 분산됩니다.

③ '핵심 엔터티' 중심의 필터링 (Entity Pruning)

문서에 포함된 모든 단어를 연결하려 하지 말고, 중요 카테고리를 한정해 보세요.

프롬프트 수정 예시: "트럼프의 '경제 정책', '에너지 전략', '중국과의 관계'라는 3가지 핵심 축을 중심으로만 온톨로지를 생성해줘."라고 범위를 좁히면 계산량이 대폭 줄어듭니다.

④ 텍스트 전처리 (Noise 제거)

업로드하신 문서에는 표(Table) 형식이나 세부적인 수치 데이터가 많습니다. MiroFish가 그래프를 그릴 때 방해가 되는 불필요한 서술어(예: "본 문서는 ~를 정리한 것입니다", "추후 예상 및 분석") 등을 삭제하고 핵심 주장과 결과 위주로 텍스트를 정제하여 업로드하세요.

3. 요약: 4개 문서가 너무 많은가?

"문서 개수가 많은 것이 아니라, 문서의 정보 밀도가 너무 높습니다."

현재 상태: 4개 문서의 총 단어 수가 수천 단어에 달하며, 정책-영향-전망이 서로 얽혀 있어 MiroFish가 추론해야 할 '선(Edge)'의 개수가 수만 개로 늘어난 상태입니다.

해결책: 4개의 문서를 LLM으로 먼저 읽혀서 **하나의 통합된 '지식 그래프 데이터(JSON)'**로 만든 다음 MiroFish에 넣어보세요. 시각화 도구는 '글을 읽는 곳'이 아니라 **'구조를 보는 곳'**으로 활용하는 것이 정석입니다.

실행해 볼 만한 질문 예시:

"방금 업로드한 4개 문서의 내용을 바탕으로, MiroFish 온톨로지 툴에 입력할 수 있도록 주요 인물, 정책, 경제적 결과 사이의 관계를 나타내는 JSON-LD 포맷으로 출력해줘."

이렇게 나온 결과값을 MiroFish에 넣으면 즉시 복잡한 관계도를 확인하실 수 있을 겁니다. 추가로 특정 섹터(예: 주식 시장 영향)에만 집중해서 분석하고 싶으신가요?

한국어