CABELO

2.2K posts

A server for text-to-speech generation using OmniVoice. It provides a simple and efficient REST API that allows applications, scripts, automation pipelines, and backend services to convert text into speech and receive the generated audio in WAV.

github.com/cabelo/OmniSpe…

English

Vazamento do Claude Code: expõe meio milhão de linhas de IA

assuntonerd.com.br/2026/03/31/vaz…

Português

Como Resolver o “ECA Digital” no Linux sem Nuvem e preservando a privacidade do usuário.

assuntonerd.com.br/2026/03/22/vlm…

Português

Obrigado aos nossos nobres deputados que votaram em peso e demonstraram que não entendem nada de TI

Ayub | Internet propriamente dita@ayubio

Distribuição Arch Linux 32, um derivado do Arch Linux voltado a CPUs de 32 bits, bloqueia acesso de todos os brasileiros para não violar a Lei Felca. O download de novas instalações bem como a atualização dos computadores já instalados com o sistema no Brasil estão bloqueados.

Português

Diante do volume de mensagens e e-mails que recebi nos últimos dias, impulsionados por mi mi mi, interpretações equivocadas e muito ruído, decidi me posicionar de forma clara sobre esse assunto.

assuntonerd.com.br/2026/03/18/lei…

Português

𝐎𝐖𝐀𝐒𝐏 𝐒𝐏 𝐝𝐢𝐬𝐩𝐨𝐧𝐢𝐛𝐢𝐥𝐢𝐳𝐚 𝐌𝐨𝐝𝐒𝐞𝐜𝐮𝐫𝐢𝐭𝐲 (𝐂𝐑𝐒) 𝟒.𝟐𝟒.𝟏 𝐩𝐚𝐫𝐚 𝐨𝐩𝐞𝐧𝐒𝐔𝐒𝐄.

Hoje às 14h30, uma hora a após o lançamento desta versão (4.21.1) do OWASP CRS, disponibilizamos este release para todos openSUSE.

assuntonerd.com.br/2026/03/09/owa…

Português

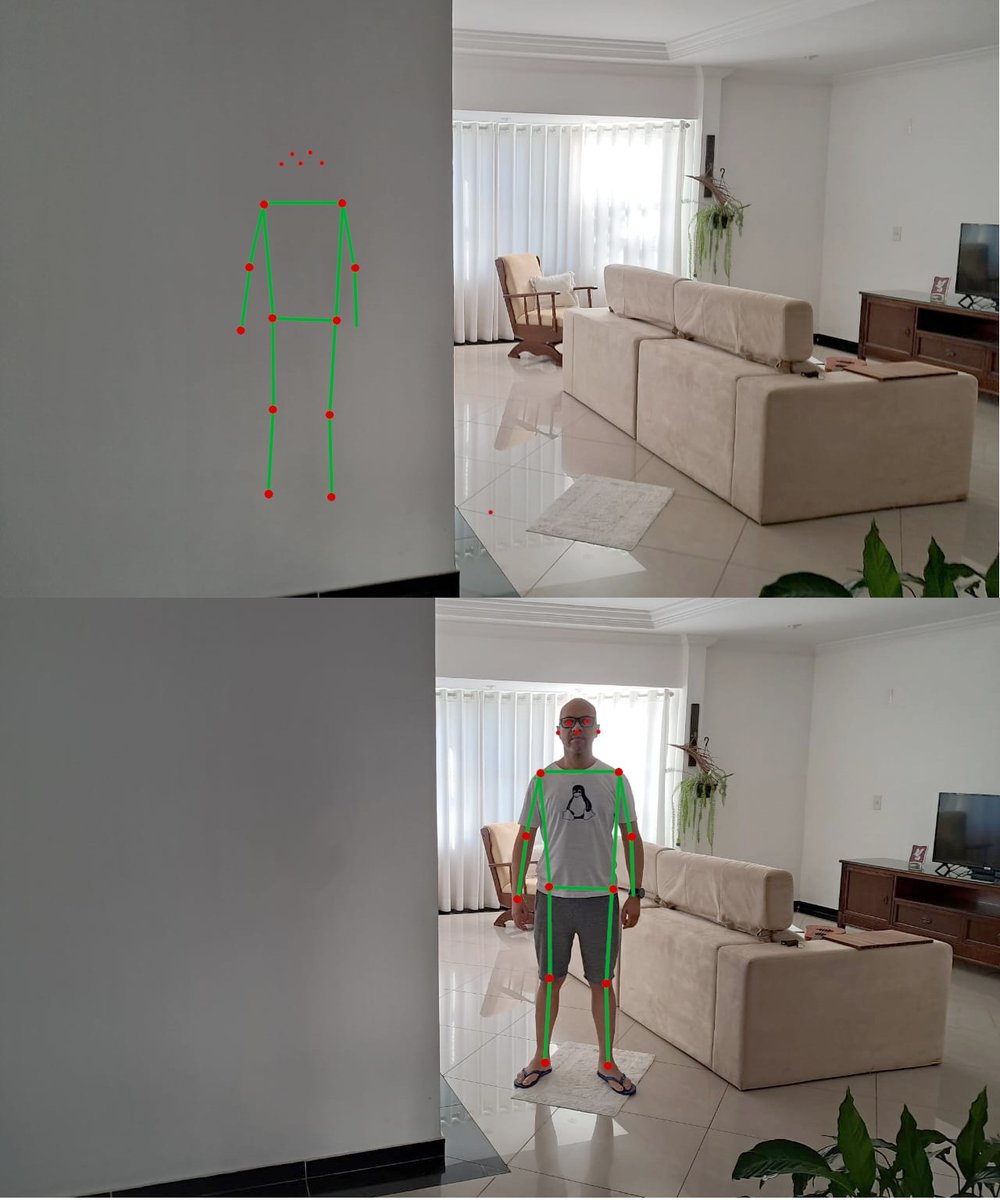

𝐄𝐧𝐱𝐞𝐫𝐠𝐚𝐫 𝐩𝐞𝐬𝐬𝐨𝐚𝐬 𝐚𝐭𝐫𝐚𝐯é𝐬 𝐝𝐚𝐬 𝐩𝐚𝐫𝐞𝐝𝐞𝐬 𝐜𝐨𝐦 𝐖𝐢-𝐅𝐢 𝐞 𝐬𝐞𝐦 𝐜â𝐦𝐞𝐫𝐚!

O projeto RuView (também chamado de WiFi DensePose) testado na MultiCortex é daqueles projetos que parecem ficção científica.

Mais info: assuntonerd.com.br/2026/03/06/enx…

Português

LingBot-World: Geração de mundo “jogável” opensource. Mais info:

assuntonerd.com.br/2026/03/01/lin…

Português

CABELO रीट्वीट किया

BREAKING: Llama.cpp joins Hugging Face 🤯

Georgi Gerganov@ggerganov

Today ggml.ai joins Hugging Face Together we will continue to build ggml, make llama.cpp more accessible and empower the open-source community. Our joint mission is to make local AI easy and efficient to use by everyone on their own hardware.

English

CABELO रीट्वीट किया

A revolução do AI PC chegou ao Linux, impulsionada pela inovação brasileira! 🚀

O Intel Innovator Alessandro Faria viabilizou o suporte à NPU dos processadores Intel Core Ultra no openSUSE, e integrou o OpenVINO de forma nativa. Seu trabalho democratiza a Inteligência Artificial local, garantindo mais eficiência e performance para desenvolvedores e usuários do Linux.

Isso significa aceleração dedicada para tarefas de IA, menor consumo de energia e um ecossistema robusto para a nova geração de AI PCs. Um marco para a comunidade! 🇧🇷✨

Português

Now flux2.c is consistently faster than the official PyTorch MPS pipeline, and not far from Draw Things (14s vs 19s at 1024x1024). Draw Things uses 6bit quantization while flux2 inference is against the official BF16 (2.7x the weights): memory bandwidth is not the hard limit here, but 6bit quants help and likely explain the remaining gap. Happy with the result so far. github.com/antirez/flux2.c

English

CABELO रीट्वीट किया

Our CTO @cabelo_linux demonstrated that it is possible to deliver AI-ready solutions to end users on Linux, leveraging NPUs and without reliance on GPUs. This has the potential to redirect billions in the AI computing market.

newsroom.intel.com/pt/client-comp…

English

CABELO रीट्वीट किया

Um brasileiro está por trás de um avanço muito importante para o uso de inteligência artificial diretamente no computador, sem depender de internet ou serviços em nuvem. Alessandro “Cabelo” Faria, da comunidade openSUSE e Intel Innovator, liderou o trabalho que tornou possível...

CABELO@cabelo_linux

Português

@coffnix Tá podendo usar NPU pra rodar IA de forma local sem gambiarra ?? Tenho um Lenovo Yoga onde o processador é um Intel Core Ultra 7 e atualmente uso Fedora nele, queria poder rodar um qwen3 da vida via Ollama usando a NPU mas até o momento pelo visto não tem como fazer isso

Português

Foi um Brasileiro! (e não americano, chinês, alemão, Indiano ou russo) o primeiro no mundo a disponibilizar o driver da NPU funcionando nativamente no openSUSE Linux sem precisar de repositórios, pacotes e instalações adicionais. Com isto rodamos IA em PC sem internet, chatgpt e outrs e democratizaremos a IA no Brasil como ninguém fez no mundo com NPU.

Parabéns @cabelo_linux por nos ajudar sempre! Comunidade open source é isso! E os BR são FODA!!!

newsroom.intel.com/pt/client-comp…

Português