Tomoki

26.6K posts

Tomoki

@0kkus0

Biostatistics PhD Candidate @UCLA | Dad of Holly & Pluto 🐱 | 🇯🇵 National Team Fan & ex-JFA | Can't wait for the 2026 World Cup 🇺🇸🇨🇦🇲🇽

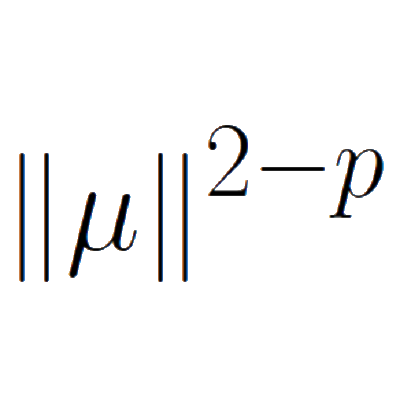

LLMは頭の中でコイントスができるか? ブログ:pub.sakana.ai/ssot 論文(#ICLR2026):arxiv.org/abs/2510.21150 一見簡単そうで奥深いこの問題を「プロンプトだけ」で解決した論文 "SSoT: Prompting LLMs for Distribution-Faithful and Diverse Generation" が #ICLR2026 に採択されました。 LLMに「コイントスをして」と100回プロンプトすると、出力の表と裏の比率は50:50から大きく離れてしまいます。明示的に確率の指示が与えられても、LLMがそれに忠実に従って出力を生成することは難しい問題です。 このことは、コイントスに留まりません。LLMに小説のアイデアを何本か出してもらったら似たような案ばかり出てきた、という経験はないでしょうか。コイントスを歪ませるのと同じ確率的な偏りが、創作やブレインストーミングなど多様な出力が求められるタスク全般で多様性を抑制しています。 私たちはこれらの問題の解決策として、String Seed of Thought (SSoT)というプロンプトを発見しました。SSoTは、LLMに頭の中で一旦ランダムな文字列を考えさせ、その文字列を操作させて結果を出力させるという非常にシンプルな手法です。外部の乱数生成器は一切使いません。 SSoTにより出力のバイアスはオープンモデルでもクローズドなモデルでも幅広いLLMで低減されます。一部のreasoningモデルでは、実際に乱数を使った場合とほぼ変わらない精度を達成しました。これは、2択の選択肢だけでなく一般の離散分布について有効です。 さらに重要なのは、SSoTはモデル出力の多様性を高めるのに使えることです。創作的な文書作成などにおいて、SSoTをプロンプトに加えるだけで、出力される文書などの多様性が高まることがわかりました。 本手法はコンテンツ生成やアイディア出し、推論時スケーリングの新手法の開発など、LLMを実世界のシステムに組み込んでいく上で重要な基盤になると考えています。 SSoTのメカニズム、理論的な解析、インタラクティブなデモについてはブログと論文をご覧ください。 OpenReview:openreview.net/forum?id=luXtb…