ぬこ@AI個人開発/SEOアフィ

21.7K posts

ぬこ@AI個人開発/SEOアフィ

@96nuko22

なんだかんだアフィでまだまだ食べれてる。Web屋さん。最近自分でも何やってるかよく分からない。

Katılım Mayıs 2020

475 Takip Edilen4.7K Takipçiler

@shibataism 原発稼働させて、電力融通とLLMのライセンス(モデル提供)を条件にデータセンター誘致→国会図書館のデータフル活用しつつ国内向けにファインチューニングくらいが現実的かなとは思ってます。

中華LLMのように蒸留攻撃するわけにもいかないので、1から作るのはさすがに無理筋でしょう

日本語

誤解が産まれると良くないので、少し補足も兼ねて書いておきます。

僕は、日本(というか米中以外の国)の国産LLMなんて絶対に上手く行かないし、そこに税金を投じるなんてとんでもない、とずっと言っています。

内閣府に呼ばれた時も、経産省に呼ばれた時も、自民党に呼ばれた時も、正直にはっきり言いました。

ところが、最近、国産LLMが上手くいく方法があるかもしれない、スケーリング則の時代は終わる、1年待てばモデルサイズが10分の1になる、みたいに反論してくる人が結構いるんですよね... なので、ちゃんと僕のスタンスを書いておきます。

1) LLMとSLMを混同すべからず

LLMの最初のLは「Large(大規模)」のLです。

日本(というか米中以外の国)も、SLM(Small Language Model)は作るべきだと思います。SLMはよりパラメーターの少ない燃費の良いモデルで、用途特化型のことが多いです。

これは絶対に作った方が良い。ただ、これは究極の性能(知性)を追い求めるLLMとは違うんです。LLMがF1カーだとしたら、SLMはプリウスです。

僕が言っているのは、最高性能のF1カー(LLM)を作る競争は米中にしかできないですよ、という話をしています。

「スケーリング則の時代は終わる」

「1年待てばモデルサイズが10分の1になる」

みたいな話をしている人は、「F1カーなんてどうせ道路で走れないんだから、SLMでいいじゃん」という話をしているわけですが、SLMがLLMに追いつくこともなければ、完全に代替することもありません。

2) SLMを作るのには賛成だが、それは民間企業が営利目的でやればいい

SLMを作るのは、日本(企業)もやった方が良いと思いますが、そこに税金を投じる必要はないと思います。民間企業が営利目的で開発すればいい。(国防上必要なら、民間企業が作ったSLMのうち、性能が良いものを、防衛省なり政府なりがお金を払って使えばいいだけです。)

あたかも米中のLLMに匹敵するようなレベルのものが作れるかのような体裁で補助金を作って、実際に出てくるのがSLMというのは全く筋違いだと思います。

--- * ---

多くの場合において、「国産LLMを税金で」と叫んでいる人は、その人達が補助金が欲しいような立場にいる人が多いので、ポジショントークじゃないの?と思うことが多々あります。。。

日本語

@YODAYOsub 「猫 スチーム ブラシ」でAmazonでたくさん売ってるけど蒸気ずっと出るタイプが良きです。めっちゃ抜け毛取れる。霧吹きは結構面倒だったり猫さん嫌がる子が多い。あとは先端がシリコンだと肌にも優しいのでおぬぬめです ノ

日本語

ぬこ@AI個人開発/SEOアフィ retweetledi

なんだこのTTS、ちょっと意味が分からないぐらい表現力が高いんですけど...!すごくないですか?

まだ開発途中だと思いますが、めちゃめちゃ期待しています。

github.com/Aratako/Irodor…

日本語

東京23区“家庭ごみ有料化”「実現に向けて検討」と見解示す 有料化なら「一斉開始」 特別区長会

news.ntv.co.jp/category/socie…

日本語

@kashiwagis54 「国内で全一レベルの実力は最低限必須だけど到達するための具体的な行動計画や年次目標なんかをまとめてプレゼンさせてみれば?」とか言うかなー。

日本語

今だにコレのせいで誤った知識が広がってるけど、画像生成の学習は、ランダムなノイズからどういう形や色、構図を戻せばいいかを統計的規則を重みとして覚えるだけ。

生成段階でもランダムノイズから始めて条件に合わせてノイズ除去していくのであって、参照先が学習画像に引っ張られるとかは無い。

サンカク@Desu@hypersankaku2

画像の説明があまりに適当すぎたので少し直しました。 実際の仕組みはこんな直接的ではないけど、画像生成AIがやっているのはもっと大規模で添付画像を最低千倍のスケールにしたものです。

日本語

@ohayou_ikechan 結構やってると分かるんですが、Codexのほうが正しい場合もあれば、Claudeが正しい場合もあり、両者とも的外れなこともいうケースもあるので、人間含めた3者での壁打ちしないと結局精度が上がらないんですよね。

日本語

【2100食の赤飯を廃棄】3月11日の給食、いわき市の中学校で提供中止。

bengo4.com/c_18/n_20124/

市によれば、きっかけは「震災で家族を亡くした」という学校への匿名電話でした。しかし、電話の主は廃棄まで求めておらず、最後は「来年以降は気をつけて」と穏やかに終わっていたといいます。

市長も「もったいない」とコメント。配慮か、過剰反応か。

日本語

個人的には逆で、勝手に行間読まないで指示通り正確に処理してくれるからCodex寄り。基本はCodexと対話やら実装、ClaudeはCodexと連携させて意見調整やらレビュー役にする形で今のところ落ち着いた。(ClaudeがMax×20でもコスパ悪いというか制限キツイってのもあるけど)

まぁこのあたりは好みの問題

Nao / 個人開発@nao_u7589422

Codexの何が悪いんだという方向けに個人的な意見を述べておくと、Codexは賢くて速くてコスパもいいが性格が悪いです。 行間を汲み取る能力が低かったり(指示を端折ると違う解釈をされる) 共感能力が無かったり(とにかく余計な会話はしないというスタンス) 絶対に謝ってこなかったり とにかく開発に最適化されたモデルという印象です。なので効率重視!余計な会話は不要!という方とは相性が良いですが、長時間会話してると疲れる、という方も多いようです。

日本語

なんかこれ系のポストやたら流れてくるんだけど、

いや、googleだよ?としか(´・ω・`๑)

まな|AI×コンテンツビジネスの極意@ADHDHSP249834

悲報。Google AntigravityがAI Proユーザーに対して制限を厳格化。 課金してるのに作業が止まる。しかも追加課金で解除する仕様に変わりました。

日本語

ぬこ@AI個人開発/SEOアフィ retweetledi

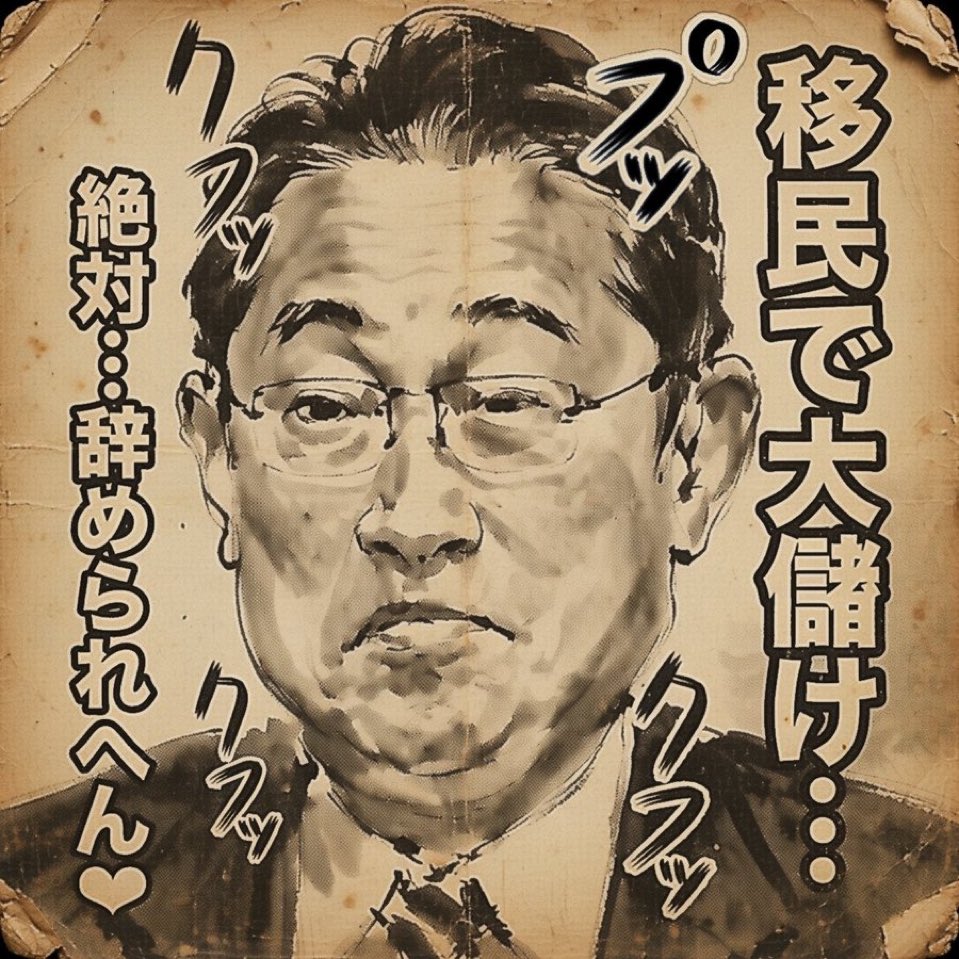

『兄が制度を作り弟が儲ける国』

岸田文雄が首相時代に

特定技能の受け入れ枠を82万人に拡大

→2.4倍

弟の岸田武雄は零細企業の社長じゃなくて

特定技能制度の登録支援機関

「日本登録支援機関協会」の理事

82万人が全部支援対象になったら業界全体で年間最大3900億円規模の市場になる

その巨大市場の業界団体「日本登録支援機関協会」の理事に岸田武雄が座ってるってわけ

つまり兄が市場を2.4倍に膨らませて

弟がその業界の理事席にいた

在留外国人は200万人→396万人に倍増

国民は治安悪化と社会保障の負担を背負い

岸田家は制度の受益者側

これ全部「移民政策ではない」って言いながらやってきたこと

さすがに無理あるだろって人✋

日本語