Sabitlenmiş Tweet

مروان

33 posts

مروان

@9o_van

وَقُل رَّبِّ زِدْنِي عِلْمًا - Bug Hunter

Katılım Nisan 2025

100 Takip Edilen10 Takipçiler

@winterfee21 @REDFEILD26 ههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههههه قتلني

العربية

@REDFEILD26 سنكره ماشاءالله من كثر ماهو متعمق بمجال الالكترونيات دخل سطح المكتب

العربية

لما يصير اختراق لسيرفر أو شبكة، عندنا “Playbook” واضح: نرجع للـ logs، نفحص الـ endpoints، نتتبع بعض الادلة… لكن لما يصير الاختراق على نظام ذكاء اصطناعي، كثير من فرق السايبر يوقفون مكانهم ويسألون: من وين نبدأ أصلاً؟

المشكلة أن الـ AI مو تطبيق عادي فيه input وoutput واضحين، هو منظومة متشعبة فيها طبقات، وكل طبقة لها سطح هجوم مستقل.

اول شيء بوضح انه هنا انا اتكلم اكثر عن تطبيقات AI، لانه موضوع الكلاود مثل حادثة Vercel وLovable لها طريقة تحقيق مختلف.

المهم خليني اكلمك عن الطبقات اللي المفروض يبدأ عندها أي تحقيق في حادثة اختراق AI، مرتبة من الأقرب للمستخدم للأعمق:

1. طبقة المدخلات (Prompt Layer)

أول مكان تبحث فيه هو سجلات الـ prompts. هل فيه Prompt Injection مباشر؟ أو الأخطر، Indirect Injection جاء من ملف PDF أو صفحة ويب أو إيميل النموذج قراه؟ كثير من الاختراقات اليوم تبدأ بنص مخفي داخل مستند يبدو بريء.

2. طبقة الـ System Prompt والـ Guardrails

افحص هل تم تسريب الـ system prompt (وهذا يحصل أكثر مما تتوقع)؟ هل فيه محاولات Jailbreak ناجحة في السجلات؟ الـ Guardrails تم تجاوزها بصياغة معينة؟

3. طبقة الـ RAG وقواعد البيانات المتجهة (Vector DBs)

إذا النظام يعتمد على RAG، فقاعدة البيانات المتجهة هي “ذاكرة” النموذج. تسميم البيانات هنا (Data Poisoning) يخلي النموذج يرد بمعلومات مزيفة أو ينفذ تعليمات خبيثة بدون ما أحد يحس. راجع مصادر الـ ingestion: من له صلاحية يضيف مستندات؟

4. طبقة الأدوات والإضافات (Tools/MCP Layer)

هنا بالذات الخطر الأكبر اليوم. الـ AI Agent لما يكون متصل بـ MCP servers أو Plugins، كل أداة هي “باب” جديد. افحص:

•وش الأدوات اللي استُدعيت وقت الحادثة؟

•فيه استدعاءات خارج النمط الطبيعي؟

•الصلاحيات الممنوحة لكل أداة (مبدأ Least Privilege مطبق؟)

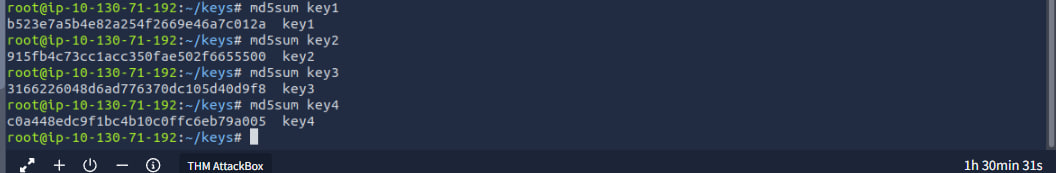

5. طبقة المفاتيح والهويات (API Keys & Identity)

الـ AI Agents غالباً تشتغل بـ service accounts صلاحياتها واسعة. افحص:

•هل فيه مفاتيح API مسربة في GitHub أو في logs؟

•Tokens الـ OAuth المربوطة بالوكيل تم استخدامها بشكل غير طبيعي؟

•من عنده صلاحية fine-tune أو deploy للنموذج؟

6. طبقة المخرجات (Output Layer)

آخر شي وأهم شي: وش طلع من النموذج؟ راجع هل فيه تسريب PII في الردود؟ أوامر نُفذت على أنظمة خارجية بناء على مخرجات النموذج؟ كود خبيث تم توليده ونُفذ مباشرة؟

7. طبقة المراقبة (Observability)

وهنا نكتشف أن أغلب المؤسسات عندها فجوة ضخمة؛ ما عندهم baseline لسلوك النموذج الطبيعي. بدون baseline، ما تقدر تكتشف الشذوذ. لازم يكون عندك logging لكل tool call، كل prompt، كل retrieval.

الخلاصة: الـ AI ما يُخترق “كنموذج”، يُخترق كمنظومة. والمهاجم ما يحتاج يكسر النموذج نفسه، يكفيه يلعب على طرف واحد من هذي الأطراف السبعة.

قاعدة ذهبية في الـ DFIR للـ AI: “ابدأ من الأداة اللي استُدعيت آخر شي، وارجع للخلف”. غالباً سلسلة الاختراق تبان من هناك.

وأخيرا سؤالي لك: لو صار اختراق لـ AI Agent في جهتك اليوم، عندك الـ logs الكافية اللي تخليك تسوي تحقيق جنائي رقمي صحيح؟ أو لا؟

وسلامتكم!

العربية

مروان retweetledi

@alghali @DarkNavyOrg يالغالي ماذكر اني سمعت أو قرأت عن AI قدر يكتشف Zero-Days!?

العربية

مروان retweetledi

منصة بحثية تنشر تحليلات للهجمات السيبرانية، تحليل البرمجيات الخبيثة، وتقارير عن مجموعات التهديد، إضافة إلى أدوات مجانية للكشف والتحليل، بهدف دعم فرق الأمن بمعلومات حديثة وموثوقة.

elastic.co/security-labs

#الأمن_السيبراني

العربية