Gentleman Programming

4.3K posts

@G_Programming

@GoogleDevExpert Angular | @MVPAward | Front End Architect | Gentleman Programming Community Owner | Book Author Collab: [email protected]

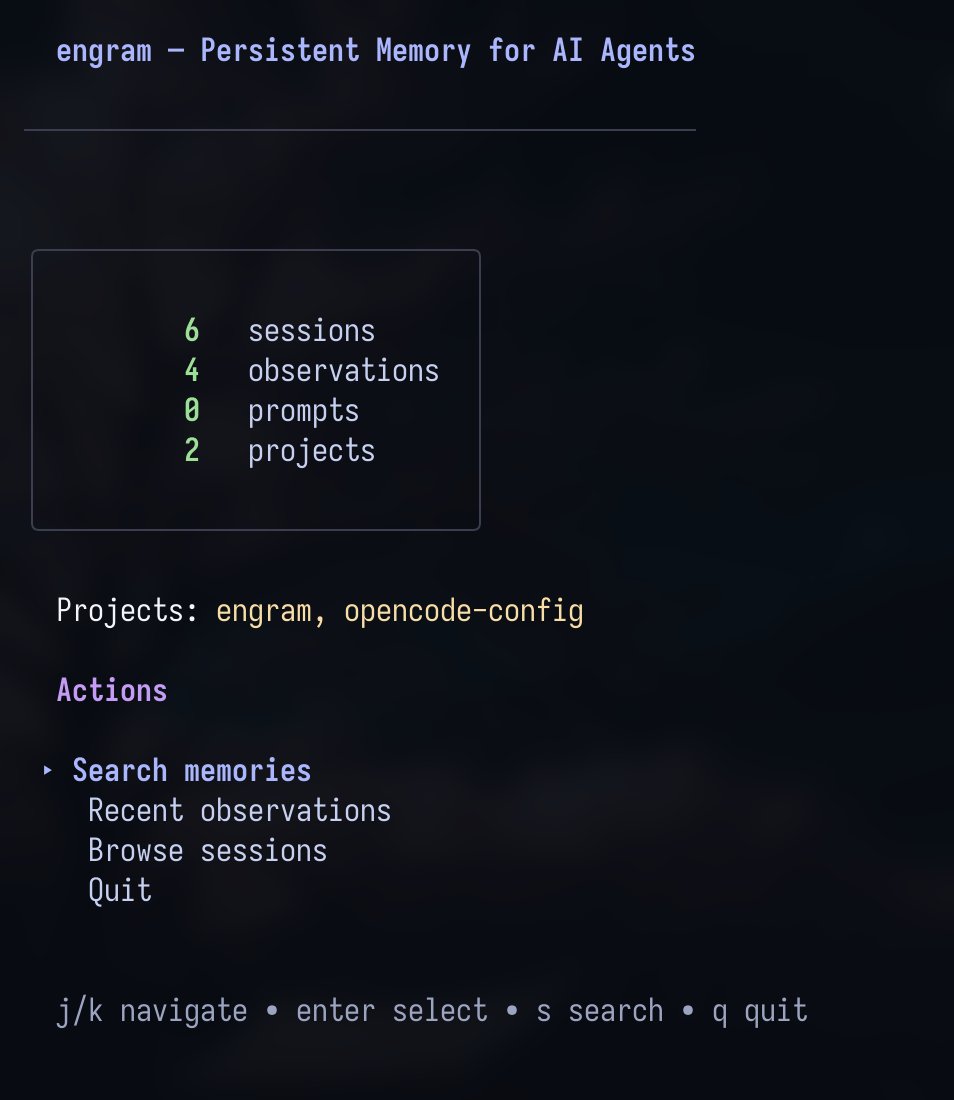

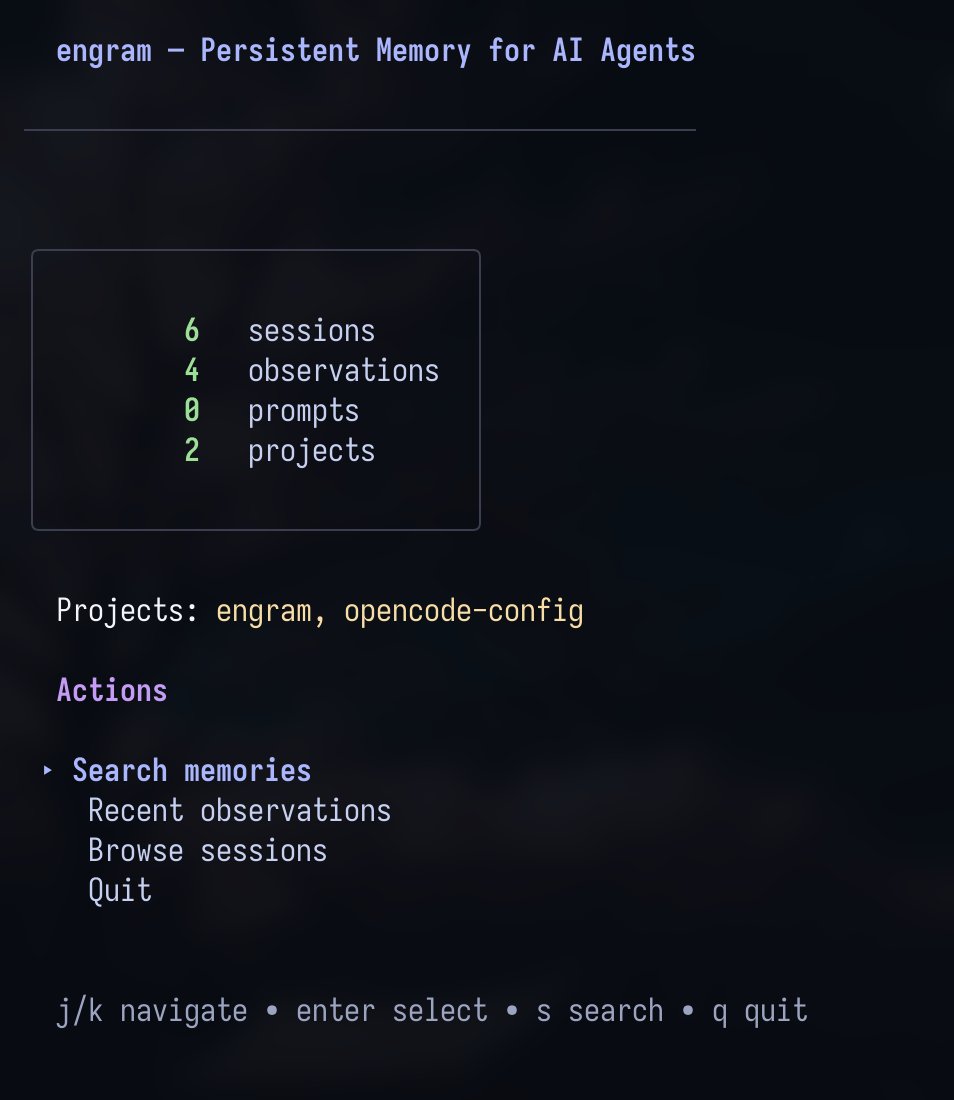

Cerrás la laptop. Abrís otra máquina. Tu agente arrancó de cero. 200 mensajes de contexto. Decisiones de arquitectura. Bugs resueltos. Todo se fue. Hoy lancé Engram Cloud. La pieza que faltaba. Local first. Self hosted. Open source. Tu data vive donde vos decidís. Si mañana yo desaparezco, tu cloud sigue funcionando porque está en tu servidor. No es un SaaS. No es cloud de otro. Es tuyo. Video en comentarios. #AI #OpenSource #LocalFirst #DevTools #SelfHosted

⚠️ Ojo con Claude Opus 4.7 porque esto pega directo en el bolsillo: Nuevo tokenizer = el mismo texto puede consumir más tokens. ¿Traducción para humanos? 💸 Mismo prompt 💸 Más tokens 💸 Más coste real 💸 Menos contexto disponible 💸 Agents que empiezan a romper antes Y acá viene el problema: la mayoría no va a ponerse a hacer auditorías finas, caching, telemetry, dashboards y toda esa fiesta. Seamos honestos: eso no lo hace una persona normal. Por eso cada vez tiene más sentido usar algo como Engram. La idea es simple: en vez de mandarle TODO el contexto al modelo cada vez, tenés una memoria externa que recupera lo importante cuando hace falta. Menos contexto basura. Menos tokens quemados. Más continuidad. Más control. Porque el futuro no es meterle 200k tokens a todo como animal. El futuro es memoria bien usada. Concepts > Code.