HenyJone STEM

4.7K posts

HenyJone STEM

@HenyJone

每日分享喜欢的美食,美女,旅行还有各种科技❤️互关互粉互Fo💯回关 Share your favorite food, beauty, travel and various technologies every day😄

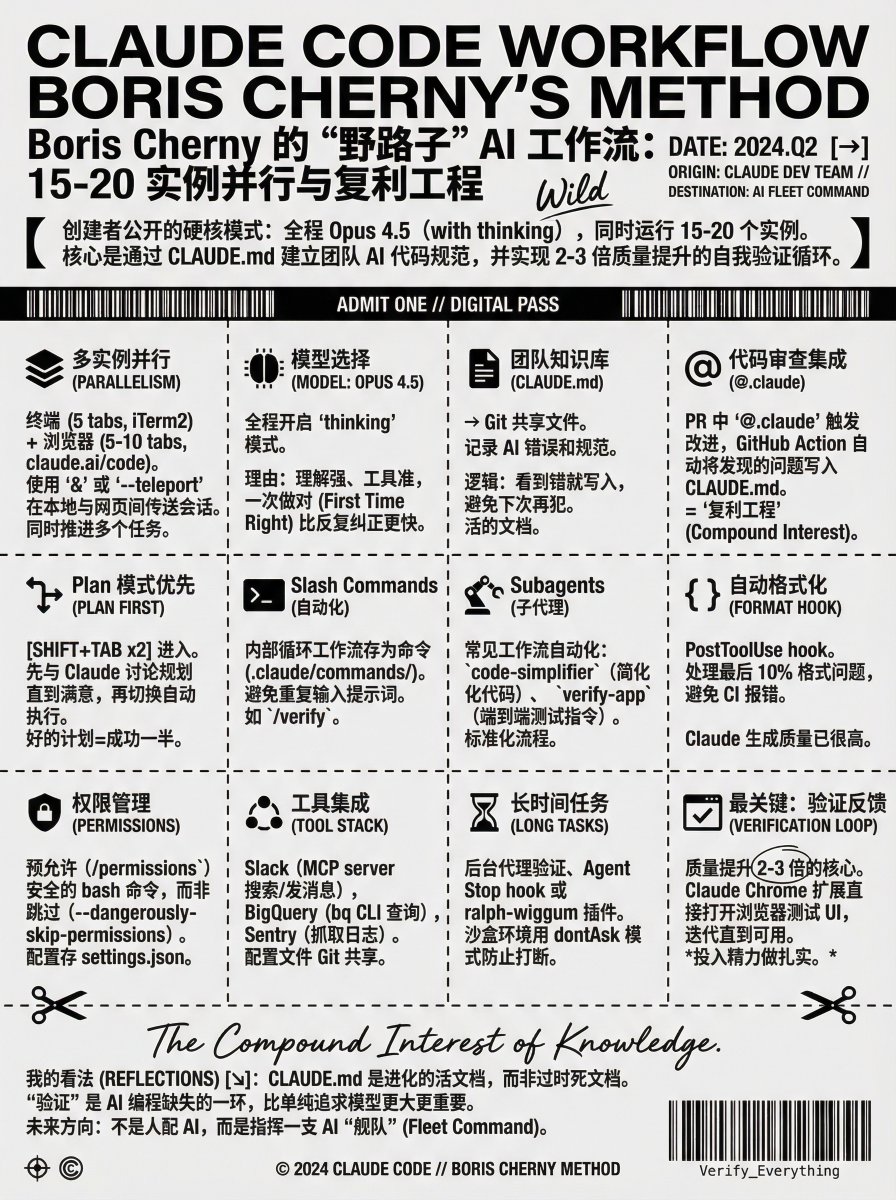

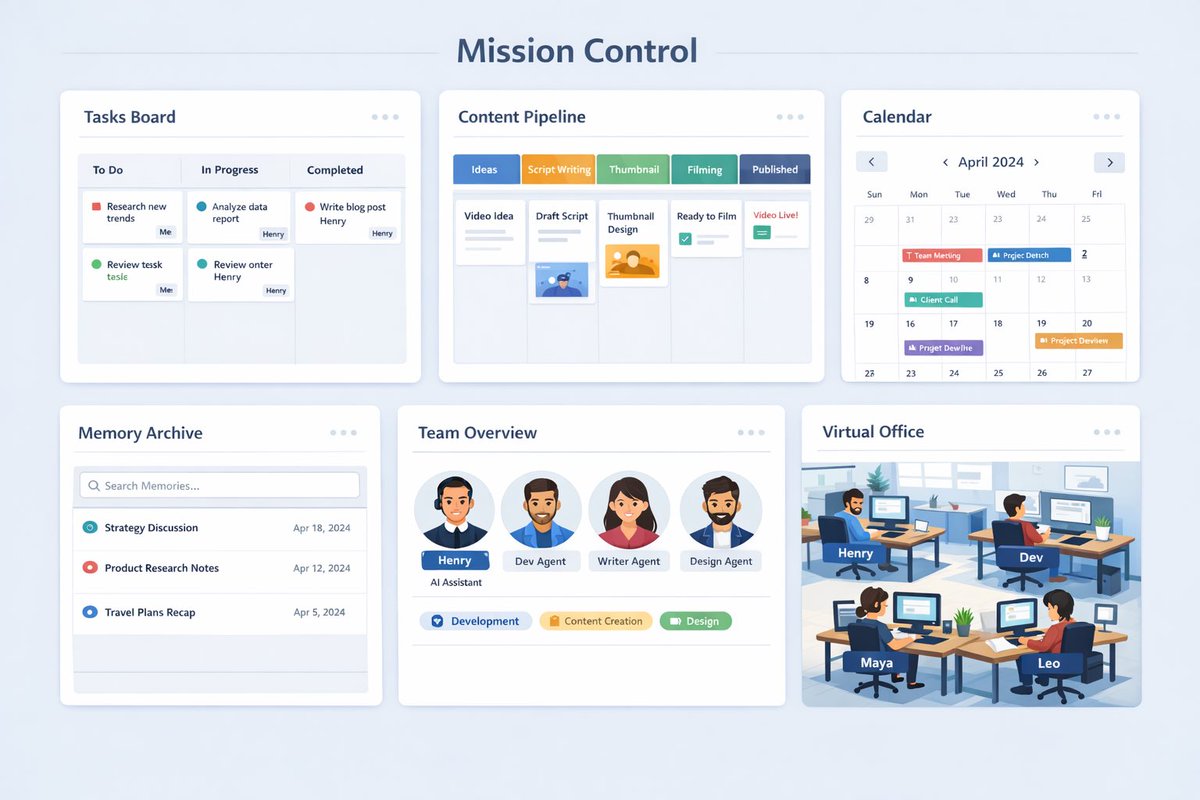

I'm Boris and I created Claude Code. Lots of people have asked how I use Claude Code, so I wanted to show off my setup a bit. My setup might be surprisingly vanilla! Claude Code works great out of the box, so I personally don't customize it much. There is no one correct way to use Claude Code: we intentionally build it in a way that you can use it, customize it, and hack it however you like. Each person on the Claude Code team uses it very differently. So, here goes.

🔥兄弟们!今天啥也没干,就给祖国的花朵和教育工作者,做了一套互动教学Skills! 直接让你的龙虾🦞OpenClaw 学习起来吧! 很多老师备课的时候,最头疼的就是那些抽象概念怎么才能让学生一眼就懂。 物理运动轨迹、数学函数图像、化学反应机理…… ✍🏻PPT讲得干巴巴,自己做3D互动又要学半天软件,时间精力根本不够。 我已经开源到 GitHub 上,直接做了个skills--AetherViz Master。 这个项目号称“互动教育可视化建筑师”,只要输入任意教学主题,AI就能一键生成一个完整、沉浸式、可交互的3D网页!零代码,普通老师也能秒变3D课件大师。 它有哪些优势呢? - 智能识别学科(物理/化学/生物/数学/天文/编程等),自动匹配颜色方案、渲染模式和专业语言 - Three.js r134 专业3D引擎 + SVG/D3.js 混合渲染,支持物理模拟、粒子系统、矢量箭头 - 拖拽旋转、滚轮缩放、触屏 pinch 操作,60fps 丝滑流畅 - 内置学习目标打卡、KaTeX 公式渲染、生活化类比、小测验面板、播放控制条 - 玻璃拟态现代UI,手机/平板/电脑全响应 对一线老师、在线教育创作者、想让学生秒懂抽象知识的朋友来说,这妥妥的是降维打击级的神器。 强烈推荐大家立刻试试,把你的课堂变成沉浸式3D宇宙吧! 地址:GitHub:github.com/andyhuo520/aet… 记得给我Star⭐️啊!一键三连哦!

人工智能的认知皮层 至此,我们已经从整体结构上解构了大语言模型 Transformer 的单层模块,它也常被类比为“人工智能的认知皮层”。在 Transformer 架构中,每一层 Layer 并不只是一个简单的神经网络运算单位,而是一个结构化的信息处理模块,仿照人类大脑皮层的处理方式,将输入的语言信息逐步抽象、压缩、选择,并生成更高层次、更符合语义逻辑的表达。 一个标准的 Transformer 层通常包含三个核心组成部分。第一是多头自注意力机制(Multi-Head Self-Attention),它允许每个 token 不只是理解自己,还能同时“看到”句子中其他所有 token,并以不同的角度去判断哪些信息在当前语境中最为重要。注意力机制的“多头”结构则让模型在多个语义空间中并行提取关联特征。第二部分是前馈神经网络(Feed-Forward Network, FFN),它对每个 token 的表示向量单独进行处理:先升维以拓展语义表示空间,再通过非线性激活函数选择有意义的特征,最后再降维回原始维度,以完成一次局部语义的加工。第三部分是残差连接与层归一化(Residual Connection + LayerNorm),它们共同保证信息的稳定传递:残差连接允许模型保留原始信息而不被新一层完全覆盖,而归一化机制则避免激活值在层间传递中失衡,有助于稳定训练过程。 x.com/feltanimalworl… x.com/feltanimalworl… x.com/feltanimalworl… 这个结构可以被简化成一个逻辑流程图:输入向量首先进入多头注意力模块,然后加上残差并做一次归一化处理;接着传入前馈神经网络,再次残差连接并归一化。最终输出的新向量则会成为下一层的输入。这样的模块并不是独立存在的,而是作为整个模型的基础单元被一层层堆叠起来。以 GPT 模型为例,GPT-2 包含 12 至 24 层,GPT-3 增至 96 层,而 GPT-4 被推测可能超过 100 层;BERT-base 有 12 层,BERT-large 有 24 层。每一层都拥有相同的结构,但参数独立、语义功能递进。就像人脑皮层中不同区域处理不同层级的信息,每一层 Transformer 都负责更进一步的语义抽象。 从认知结构的角度来看,Transformer 的每一层可以类比为一个“人工皮层单元”,具备类神经系统的三个核心功能:感知、加工、整合。感知机制由多头注意力实现,相当于模型的“感官”;加工机制由 FFN 执行,完成特征提取与语义变化;整合机制则通过残差连接与归一化,把旧的信息结构与新提取的语义进行融合,形成更稳定的表达方式。这使得每一层都具备了局部理解、结构压缩和语义统一的能力,是大模型内部的认知最小单位。 一句话总结:Transformer Layer 就是大型语言模型的大脑皮层。每一层都在进行一次“看懂 → 加工 → 整合”的语义演化过程,最终通过数十乃至上百层的堆叠,构建出类人语言智能的神经系统。