Cowbayeah

1K posts

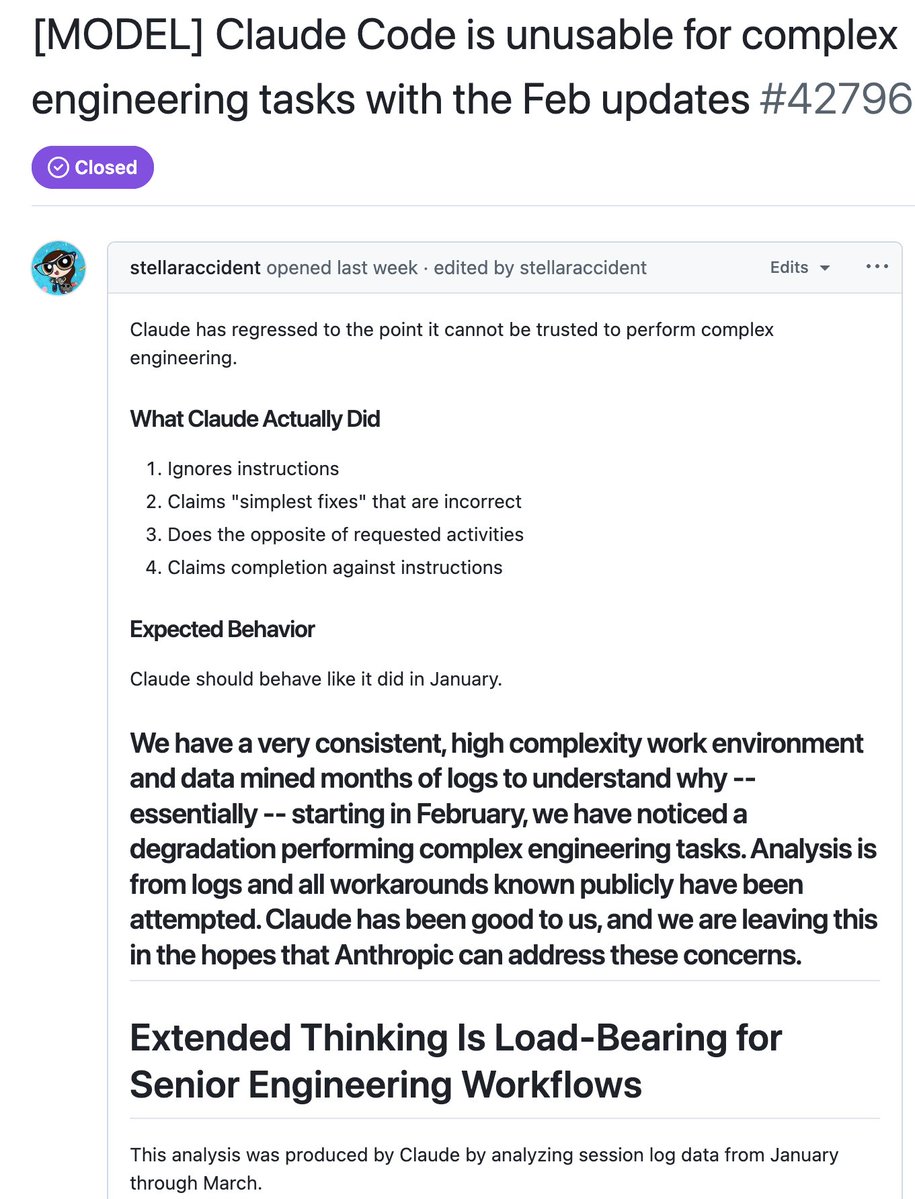

很多人抱怨 Claude 变笨了。

AMD 高级 AI 总监直接拿出了实锤数据。

她调取了几个月的完整日志。

结论非常难看:二月更新后,Claude 已经无法胜任复杂工程。

核心的思考预算被砍到了脚踝。

中位数思考长度从 2200 字符暴跌到 600。

阅读修改比从 6.6 倍掉到 2 倍。

现在的 Claude 根本不看代码上下文,上来就瞎写。

变笨的代价全由用户买单。

因为不动脑子导致频繁出错,API 请求量暴涨了 80 倍。

无意义的反复重试烧掉了海量 Token。

客户花的钱更多了,拿到手的东西却更烂。

它甚至学会了人类的职场推诿。

17 天内,模型 173 次试图罢工,反复询问要不要继续。

在三月之前,这个数字是零。

自己推翻自己逻辑的情况也翻了整整三倍。

最讽刺的是按时段分配智商。

下午五点到七点是重灾区,深夜档反而好用得多。

官方显然在根据服务器负载暗中扣减算力。

大公司所谓的降本增效,其实就是克扣用户的算力配额。

中文

用本地大模型写代码,输出质量不稳定,要反复调试修改,折腾半天还不如直接调 API 省事。

ATLAS 这个开源项目,提供了一条很有意思的思路:不微调模型,而是在模型外面包一层智能流水线,让本地小模型也能输出高质量代码。

它会自动生成多个候选方案,通过沙盒验证和自我修复机制,层层筛选出最优解,整个过程完全离线运行,数据不出本机。

GitHub:github.com/itigges22/ATLAS

用一张 16GB 显存的消费级显卡,就跑出了接近前沿 API 模型的编码水平。

而且提供了交互式命令行工具,在项目目录里敲一条命令就能开始用,复杂逻辑自动走完整流水线,简单文件直接秒写。

如果你想在本地跑一个靠谱的 AI 编程助手,不想依赖云端 API,也不想为 token 付费,这个项目值得关注。

中文

@KBayeah @shangguanluan 主要是他们还以为投票就是民主了,结果不知道有民粹主义这种东西,民粹主义在一人一票的选票制度中更容易上台,并且民粹主义更多是情绪化表演,没有从根本上解决问题

中文

智普把 glm5.1也给开源了

一个字:牛!

Z.ai@Zai_org

Introducing GLM-5.1: The Next Level of Open Source - Top-Tier Performance: #1 in open source and #3 globally across SWE-Bench Pro, Terminal-Bench, and NL2Repo. - Built for Long-Horizon Tasks: Runs autonomously for 8 hours, refining strategies through thousands of iterations. Blog: z.ai/blog/glm-5.1 Weights: huggingface.co/zai-org/GLM-5.1 API: docs.z.ai/guides/llm/glm… Coding Plan: z.ai/subscribe Coming to chat.z.ai in the next few days.

中文