Kotaro Kinoshita / MLism

1.4K posts

Kotaro Kinoshita / MLism

@KINOCOAI

MLism Inc. / https://t.co/S3XdNdiidI 会社経営は趣味、本職はAIエンジニア/YomiTokuの商用利用に関してはhttps://t.co/rWuzpdvY6Xにお問い合わせください/機械学習、 画像処理、文書画像解析

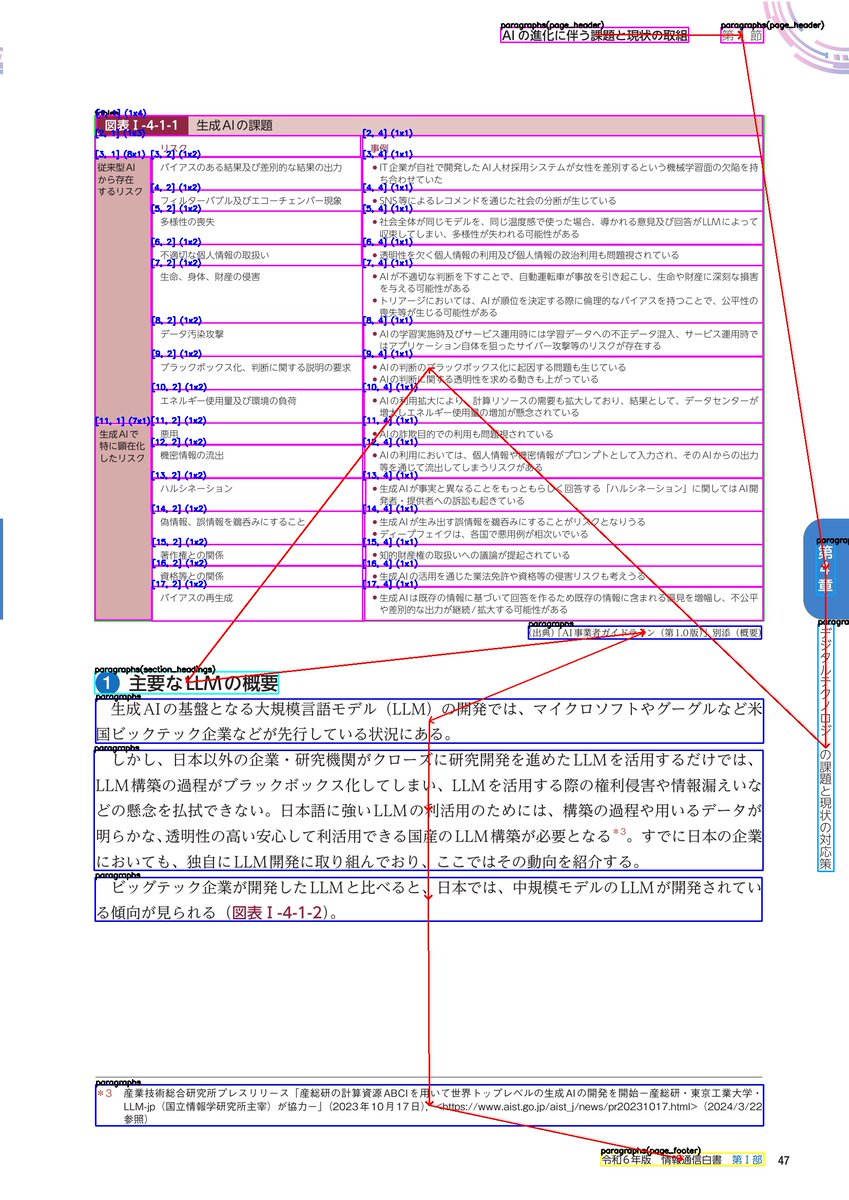

誤解が産まれると良くないので、少し補足も兼ねて書いておきます。 僕は、日本(というか米中以外の国)の国産LLMなんて絶対に上手く行かないし、そこに税金を投じるなんてとんでもない、とずっと言っています。 内閣府に呼ばれた時も、経産省に呼ばれた時も、自民党に呼ばれた時も、正直にはっきり言いました。 ところが、最近、国産LLMが上手くいく方法があるかもしれない、スケーリング則の時代は終わる、1年待てばモデルサイズが10分の1になる、みたいに反論してくる人が結構いるんですよね... なので、ちゃんと僕のスタンスを書いておきます。 1) LLMとSLMを混同すべからず LLMの最初のLは「Large(大規模)」のLです。 日本(というか米中以外の国)も、SLM(Small Language Model)は作るべきだと思います。SLMはよりパラメーターの少ない燃費の良いモデルで、用途特化型のことが多いです。 これは絶対に作った方が良い。ただ、これは究極の性能(知性)を追い求めるLLMとは違うんです。LLMがF1カーだとしたら、SLMはプリウスです。 僕が言っているのは、最高性能のF1カー(LLM)を作る競争は米中にしかできないですよ、という話をしています。 「スケーリング則の時代は終わる」 「1年待てばモデルサイズが10分の1になる」 みたいな話をしている人は、「F1カーなんてどうせ道路で走れないんだから、SLMでいいじゃん」という話をしているわけですが、SLMがLLMに追いつくこともなければ、完全に代替することもありません。 2) SLMを作るのには賛成だが、それは民間企業が営利目的でやればいい SLMを作るのは、日本(企業)もやった方が良いと思いますが、そこに税金を投じる必要はないと思います。民間企業が営利目的で開発すればいい。(国防上必要なら、民間企業が作ったSLMのうち、性能が良いものを、防衛省なり政府なりがお金を払って使えばいいだけです。) あたかも米中のLLMに匹敵するようなレベルのものが作れるかのような体裁で補助金を作って、実際に出てくるのがSLMというのは全く筋違いだと思います。 --- * --- 多くの場合において、「国産LLMを税金で」と叫んでいる人は、その人達が補助金が欲しいような立場にいる人が多いので、ポジショントークじゃないの?と思うことが多々あります。。。

日本は同調圧力が凄いから大卒→ホワイトカラー以外は負け組みたいな風潮あるけど本来は職人に向いてる人、農業に向いてる人、サービスに向いてる人、家畜や植物を育てるのに向いてる人等が一斉にホワイトカラーを目指して鬱病になってる気がする。

この期に及んで、まだAIより人間(自分)の方が優れていると思える人、その底抜けの自己肯定感とメタ認知力の低さがうらやましい。