Dev Bora 개발자 이보라 🇰🇷

13.5K posts

Dev Bora 개발자 이보라 🇰🇷

@LearnerBR

⌨ Software Engineer 🌎 @microsoft MVP ❤️ @Lovable Ambassador 💻 @hackglobalinfo

The TurboQuant paper (ICLR 2026) contains serious issues in how it describes RaBitQ, including incorrect technical claims and misleading theory/experiment comparisons. We flagged these issues to the authors before submission. They acknowledged them, but chose not to fix them. The paper was later accepted and widely promoted by Google, reaching tens of millions of views. We’re speaking up now because once a misleading narrative spreads, it becomes much harder to correct. We’ve written a public comment on openreview (openreview.net/forum?id=tO3AS…). We would greatly appreciate your attention and help in sharing it.

Next.js 16.2 introduces a stable Adapter API, built with Netlify, Cloudflare, OpenNext, AWS, and Google Cloud. But the API is only part of the story. Next.js is used by millions of developers across every major cloud, and making it work well everywhere is on us. Here are our commitments. nextjs.org/nextjs-across-…

행안부가 셀 병합 금지 🚫 지침 내림 흠흠 나는 해야지 그래야 제안서 이쁘거덩🤣 아 몰라요 통과만 되믄 됨!!!! (유우머 섞인거 아시죠? 저는 md 마니아입니다)

등록 좋은데 바로 봇들 우두두두 들어옴 소수만 쓰는거면 천천히 하세유

행안부가 셀 병합 금지 🚫 지침 내림 흠흠 나는 해야지 그래야 제안서 이쁘거덩🤣 아 몰라요 통과만 되믄 됨!!!! (유우머 섞인거 아시죠? 저는 md 마니아입니다)

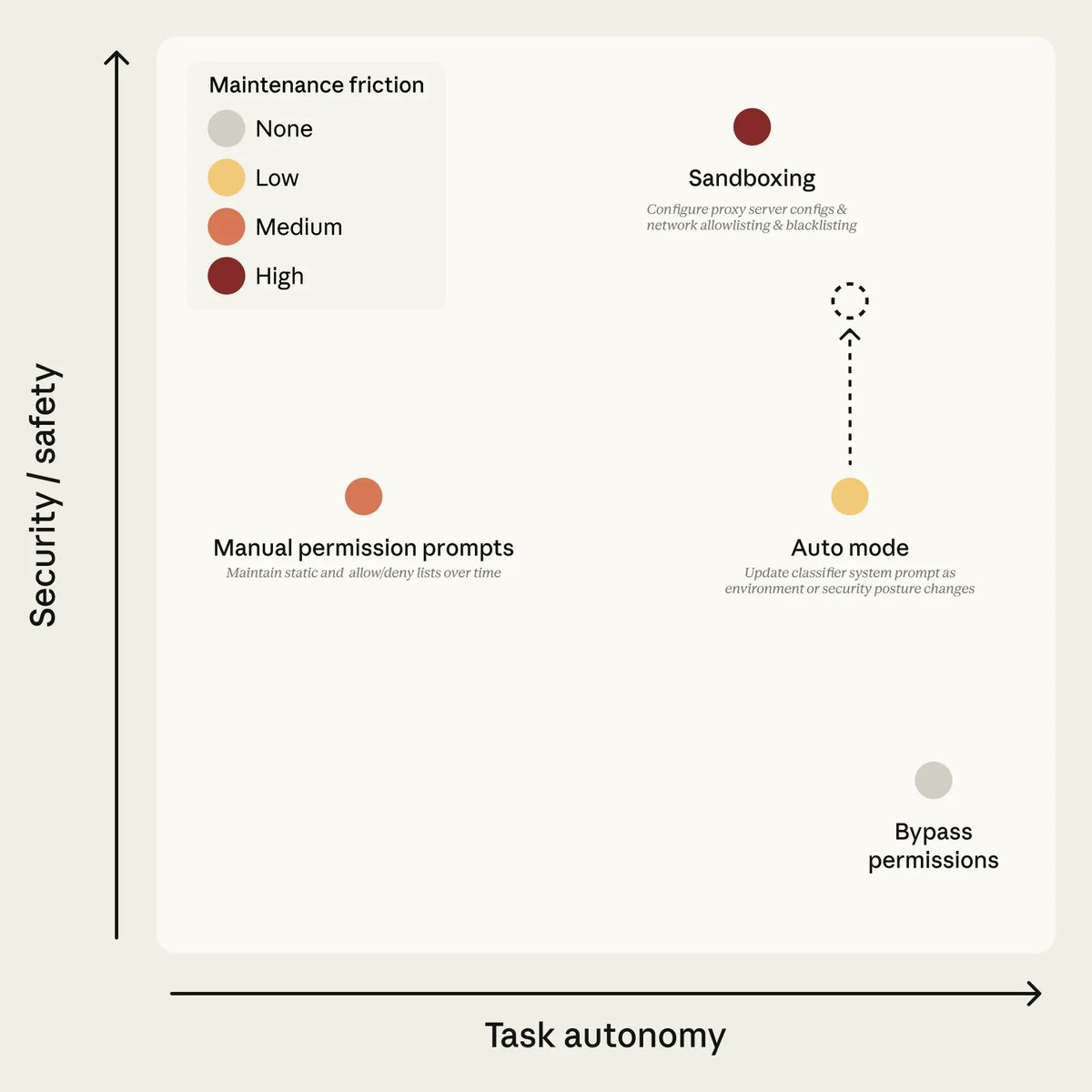

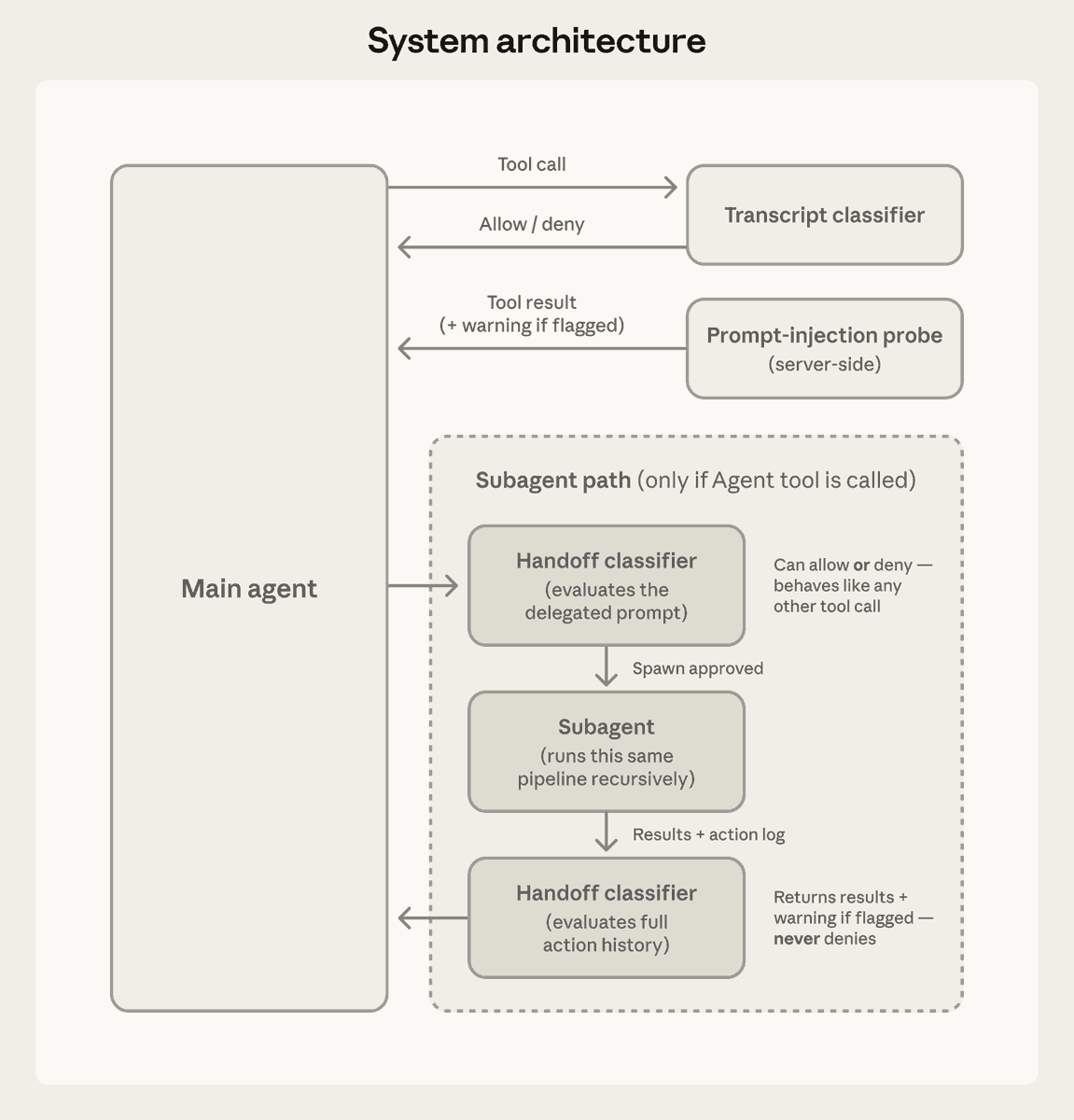

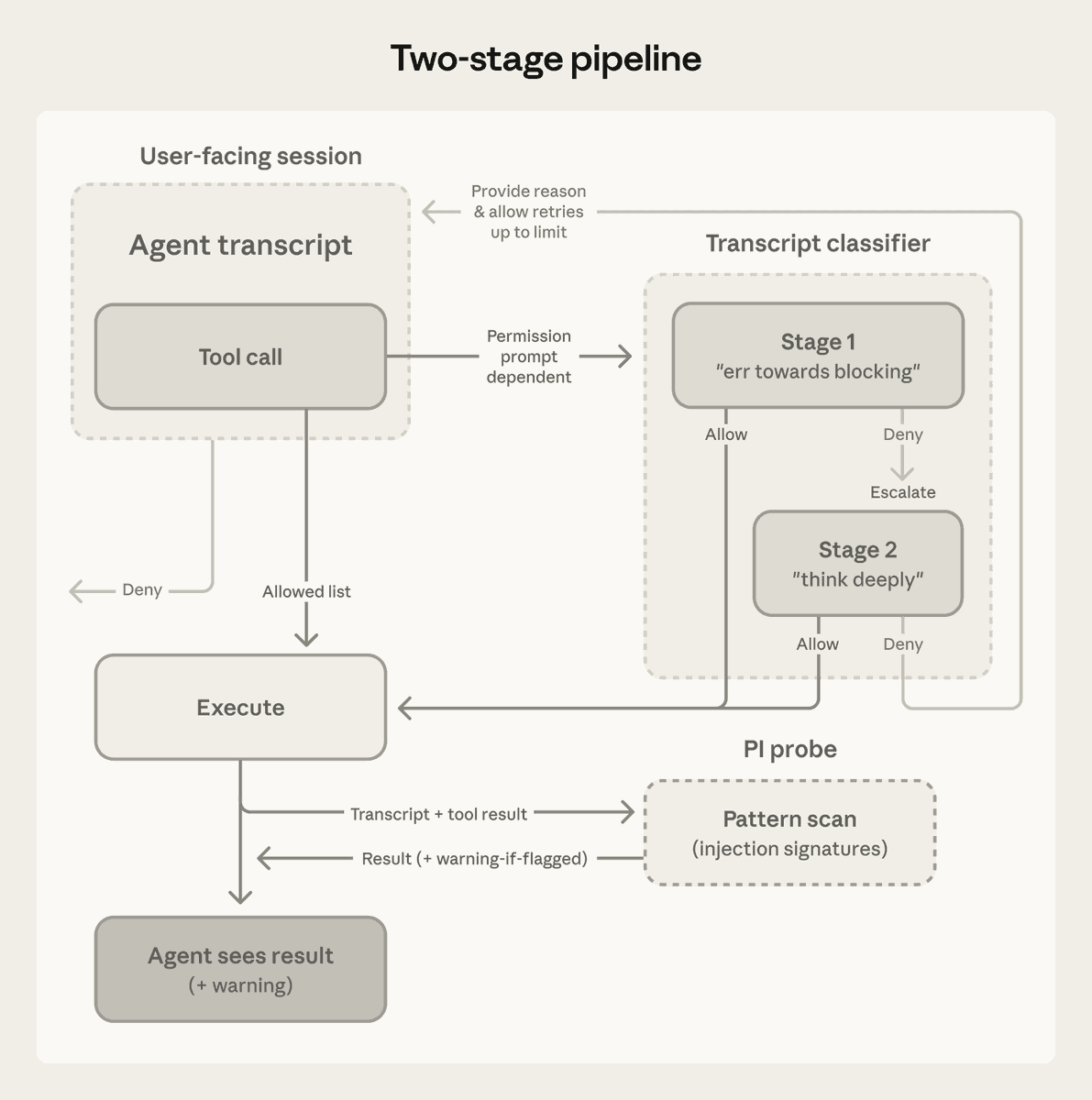

New on the Engineering Blog: How we designed Claude Code auto mode. Many Claude Code users let Claude work without permission prompts. Auto mode is a safer middle ground: we built and tested classifiers that make approval decisions instead. Read more: anthropic.com/engineering/cl…

깃헙이 4월 24일부터 깃헙 코파일럿과의 상호작용 데이터를 모델 트레이닝에 쓸것이라 발표. 그래도 오랫동안 타사와 다르게 데이터 안가져다 썼는데 이젠 시작된듯. 끄는 방법은 설정에.