Sabitlenmiş Tweet

莫折柳

578 posts

Pakistan proposes two-week Iran ceasefire ahead of Trump deadline trib.al/Qx6n8p8

English

莫折柳 retweetledi

@YumemitaiS 本当にそのとおりです。日本の問題は8割の人間が日本と全く違う文化を体験していない事です。具体的には海外旅行と留学です。彼らは日本のルールが全てと思い込んでいるのでルールを守らない人間を悪者扱いします。ただ分かってほしいのはタイ人を人種差別してるわけではない事です。タイ人好きです。

日本語

@cyodyssey @BNBCHAIN 举手!人文社科phd在读要多很多量化的内容,目前在用gemini的免费一年会员,一直希望能多用下claude,谢谢!

中文

在读的 PhD 可以联系我,Happy-Sci 会为在读 PhD 捐助 $240,一年的 Plus 订阅 or 一个月 Max 加点咖啡钱。助力每一个科研梦,不限专业,不限国家,不限学校。

经费会通过 @BNBCHAIN 上的稳定币发放。

Jason Young@Jason_Young1231

在中转站的群里看到很多大学生,他们是真的价格敏感用不起 $200 的订阅,这点让我感觉中转站的存在是有意义的

中文

莫折柳 retweetledi

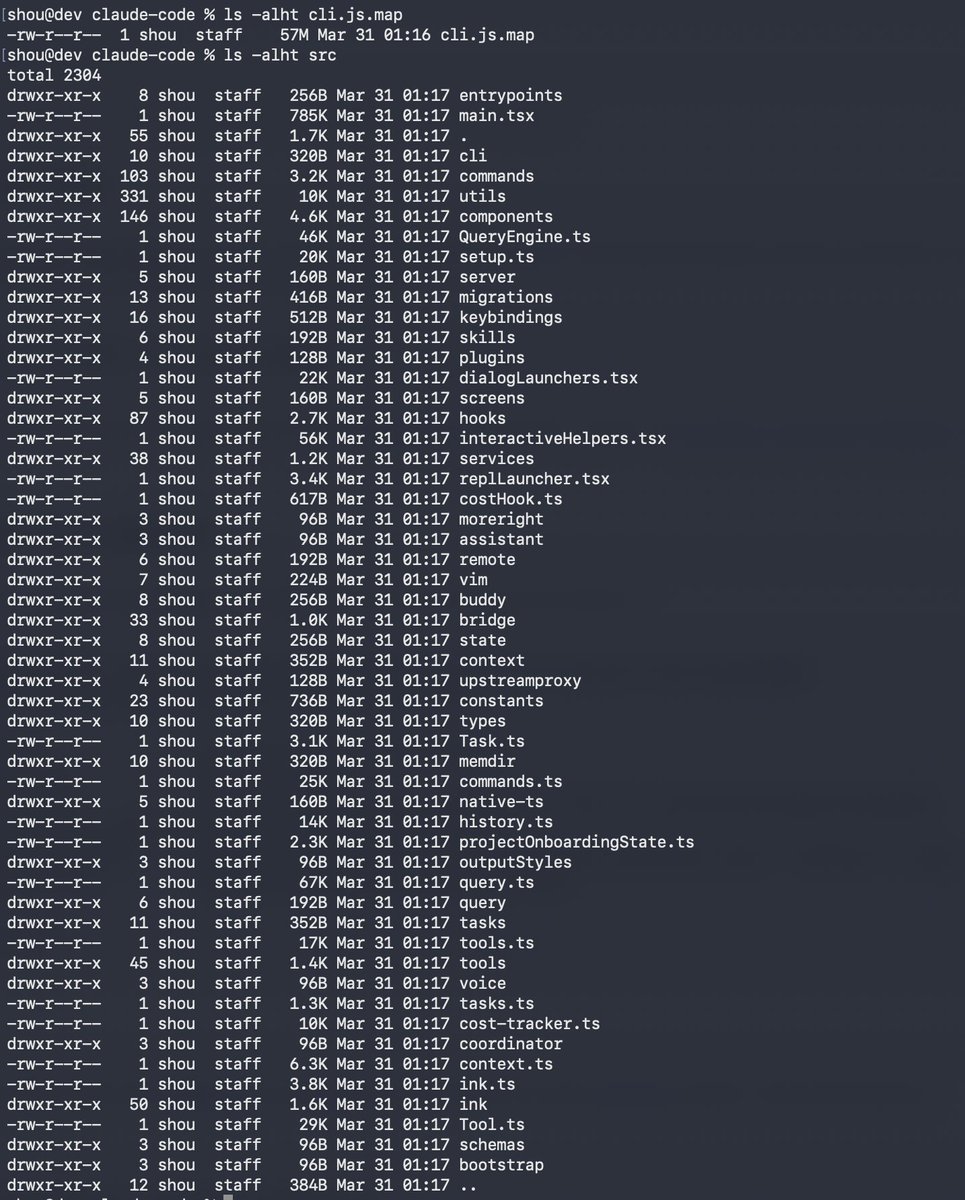

Claude code source code has been leaked via a map file in their npm registry!

Code: …a8527898604c1bbb12468b1581d95e.r2.dev/src.zip

English

莫折柳 retweetledi

哥们儿你这四个AI证书拿到手软,结果基础问题直接投降喊救命?哈哈哈,高级训练师认证的含金量我看懂了。

简单说吧,大语言模型的词向量就是把每个词扔进一个超级高维空间里(比如几千维),让意思相近的词坐标挨得近点。跨语言呢,英语的“cat”和日语的“猫”本来八竿子打不着,但模型训练时用海量多语种数据(新闻、wiki、聊天记录啥的),哪怕没一字一句的平行翻译,上下文模式也会慢慢把它们拽到同一隐空间里——比如“cat meows”和“猫 喵喵”这种结构一多,注意力机制就自动发现“哦,这俩玩意儿语义同构”。

本质上靠的是规模和统计:数据够脏够多,模型自己就玩转映射了,不用死磕平行语料。证书上没教这个?下次别光晒图了,先把问题看懂再问啊。

中文

莫折柳 retweetledi

莫折柳 retweetledi

美光占据存储市场20%左右的份额,26年的产能合同几乎不存在重新议价的可能性,

存储周期至少会延续到28年,28年以后或许智能驾驶中汽车芯片迎来大爆发,那或许又造就存储供需更大的缺口,400以下的美光我等到了……

Shay Boloor@StockSavvyShay

$MU and $SNDK are getting hit hard at the open from the release of $GOOGL TurboQuant. The market is reading it as a potential headwind for memory names because long-context AI inference may now need far less memory per workload.

中文

莫折柳 retweetledi

伊朗的文官集团,应该是被革命卫队劫持了!今天接受伊朗国家电视台采访的伊朗总统,是坐在抽干水的泳池中,周围搭了幕布。最后发言环节,被专家破译,完全是在看他右前方的提词板,歪着脖子,照稿子读下来的…

伊朗,正处在内乱的前夜…

KUNLUN昆侖@Kunluntalk

伊朗国家电视台,今天采访了伊朗总统。伊朗总统坐在被抽干的泳池里,在包括小哈梅内伊等三位伊朗最高领袖遗像的鼓励下,发表了对伊朗人民的讲话。 他激励伊朗人人民要勇敢的抵抗美帝国主义,相信伊朗一定会打败美国。

中文