Michał od marketingu

1.3K posts

Michał od marketingu

@MikeP2137

Transformuję niewidoczne firmy w lokalnych liderów. Obserwuj po praktyczne taktyki marketingowe, które działają od pierwszego dnia.

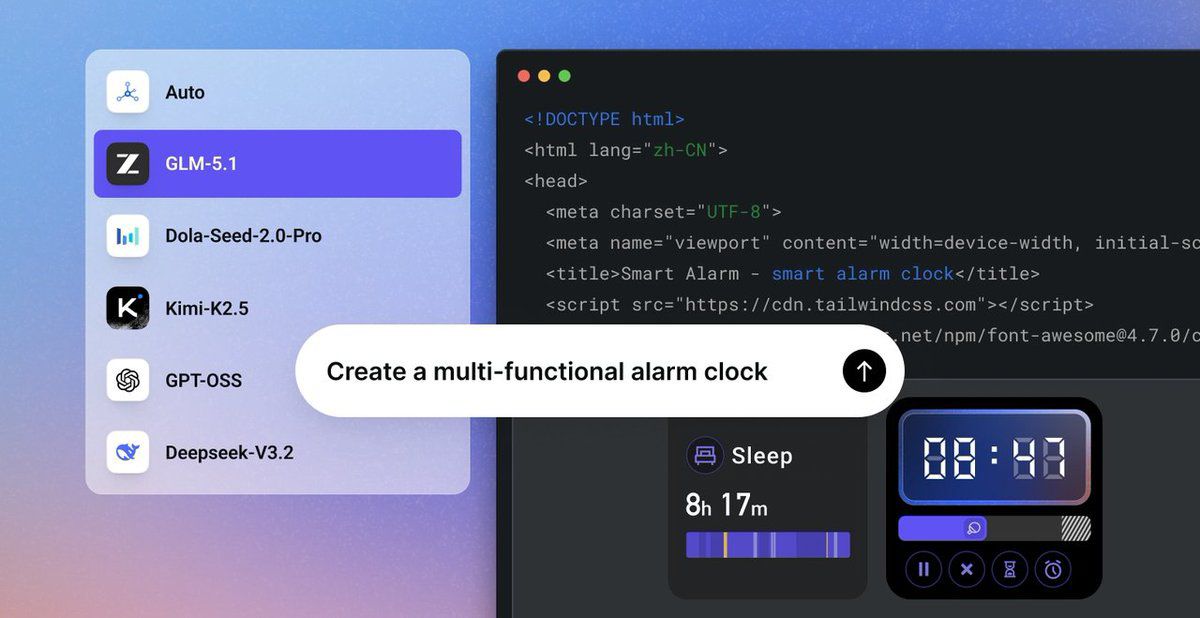

github.com/Leonxlnx/taste… Here is the skill for only image generation using GPT images v2 images-taste skill is based on that

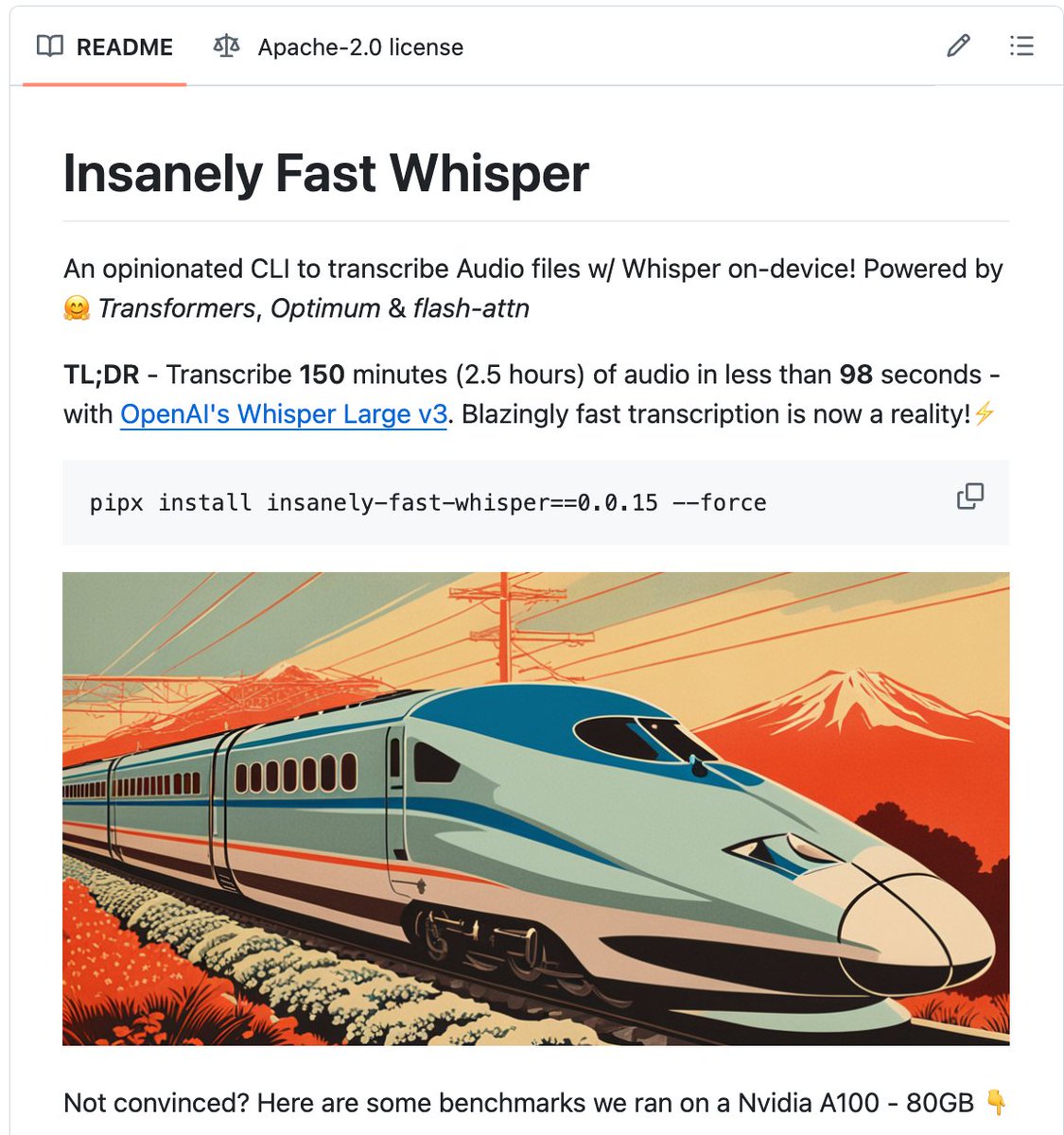

Ooo. Benchmarki spoczko. Nazwa na plus. Raczej nie będę używał, ale na pewno potestuję.

Your grandparents had grandparents. They had grandparents. Somewhere back there, someone got on a boat, or didn't. Someone changed their name, or had it changed for them. Someone is buried in a cemetery you've never heard of in a country you've never been to. Most families lose track after two generations. I used AI to push mine back nine. One session with @karpathy's autoresearch pattern: over 100 organized research files. It found a 1940 Norwegian emigrant history with my ancestors in it. Resolved a maiden name question that confused my family for 70 years. Identified relatives no one alive knew existed. The method is simple: set a goal, measure progress, verify against real records, repeat. The AI searches public archives, cross-references birth certificates against cemetery records against church books, and logs everything it finds (and everything it doesn't). Open sourced the whole toolkit. Prompts that do the research for you, archive guides for 20+ countries, starter templates, even a framework for making sense of DNA results. If you have a box of old photos and unanswered questions, this is where to start. github.com/mattprusak/aut…

Today, we’re releasing a feature that allows Claude to control your computer: Mouse, keyboard, and screen, giving it the ability to use any app. I believe this is especially useful if used with Dispatch, which allows you to remotely control Claude on your computer while you’re away.