Sabitlenmiş Tweet

Mujirushi

753 posts

Mujirushi

@Muji___rushi

データサイエンティスト | Kaggle Master https://t.co/AMr1JEU8u9

Katılım Ocak 2020

806 Takip Edilen996 Takipçiler

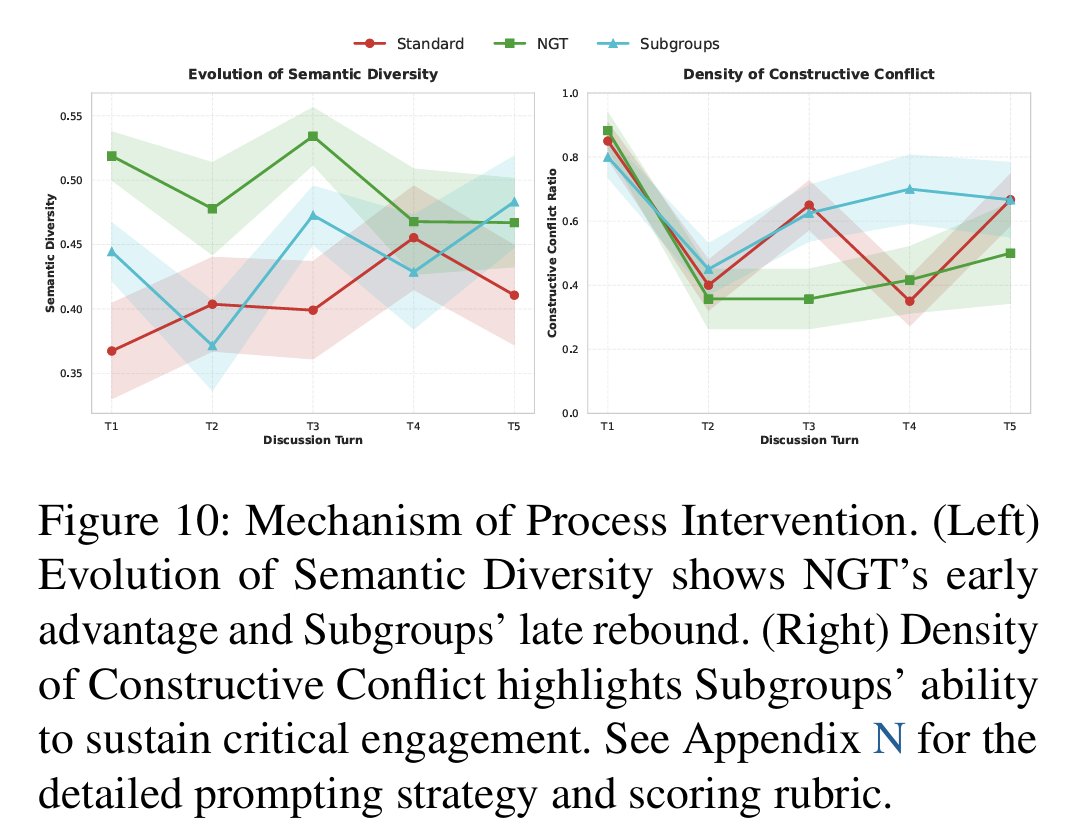

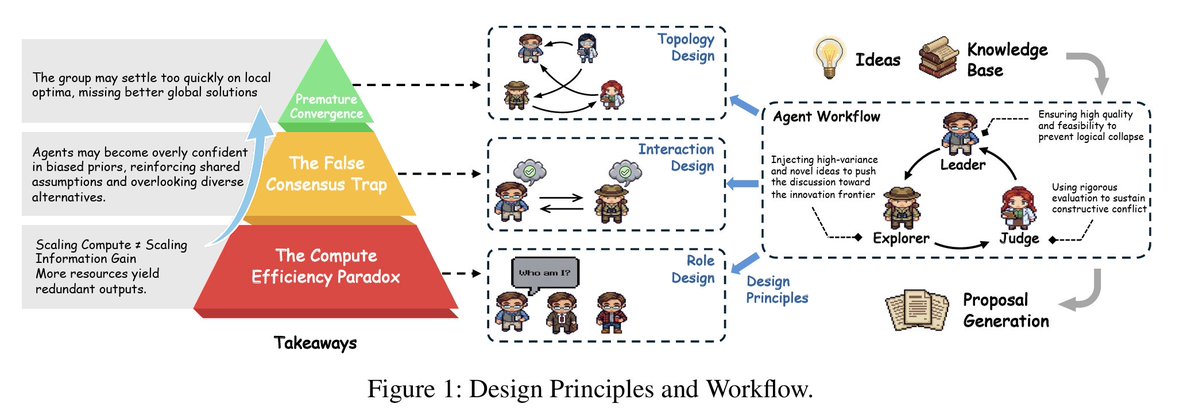

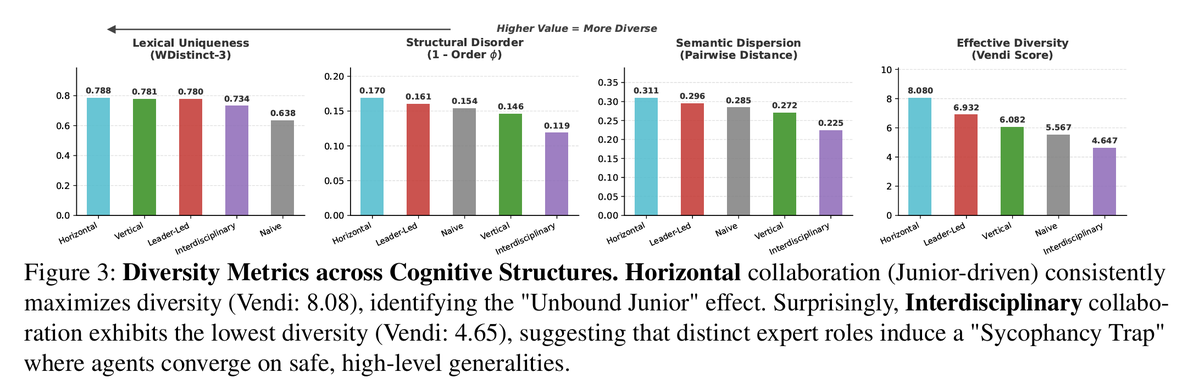

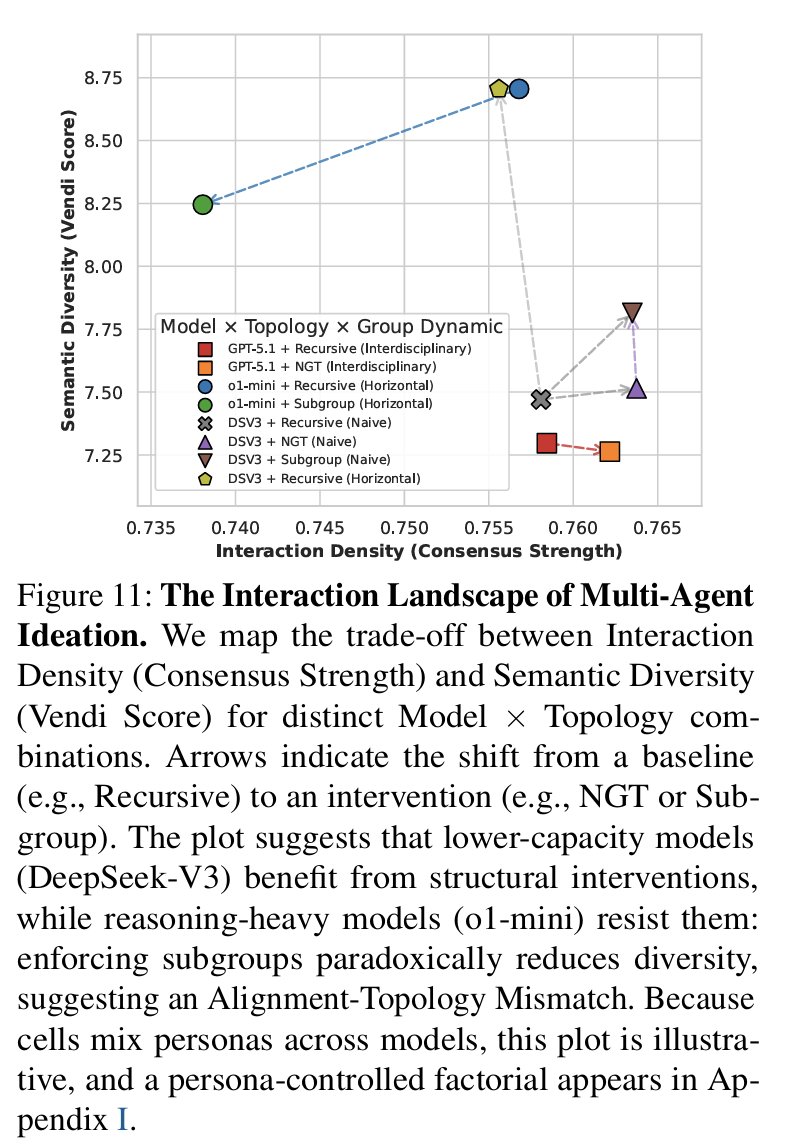

LLMを複数エージェントで議論させれば発想が広がるとは限らず、構造次第で思考の収束(多様性の崩壊:diversity collapse)が起きることを示した論文

エージェント間の相互作用が、個々のエージェントが持つ探索空間を不本意に収縮させる「構造的結合」が起因してるという主張

arxiv.org/pdf/2604.18005

日本語

MLE-Benchで以前に1位になったNeoの開発に関する記事。

"Kaggle Grandmaster as a Service"というパワーワードも登場してる。

hackernoon.com/the-engineer-i…

日本語

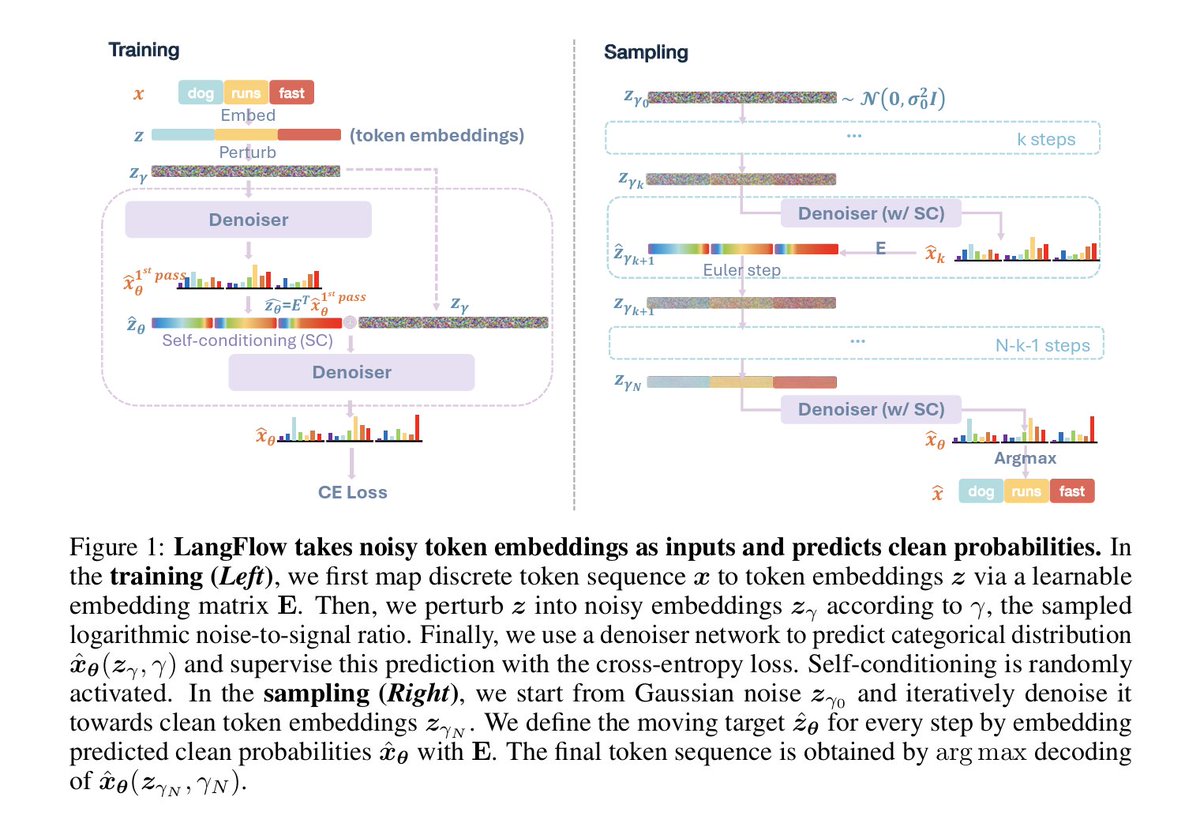

言語で不利とされた連続拡散モデルを単語直接予測と言語向けノイズ設計で強化し、離散拡散モデルに匹敵すると、主張するLangFlow

学習では、単語埋め込みにノイズを加えて元単語を直接予測。生成では、一様なノイズ設計をやめて重要ノイズ帯に計算を集中しつつ復元する。

arxiv.org/pdf/2604.11748

日本語

推論LLMのRLで正解率だけを追うと多様性が失われやすい問題に対し、「良い答えの分布」を学ばせるLearning Advantage Distribution for Reasoning(LAD)

GRPOは高advantage応答を増やす更新(単一モードに潰れやすい)、FlowRLは報酬分布への整合、LADはadvantage分布への整合

arxiv.org/pdf/2602.20132

日本語

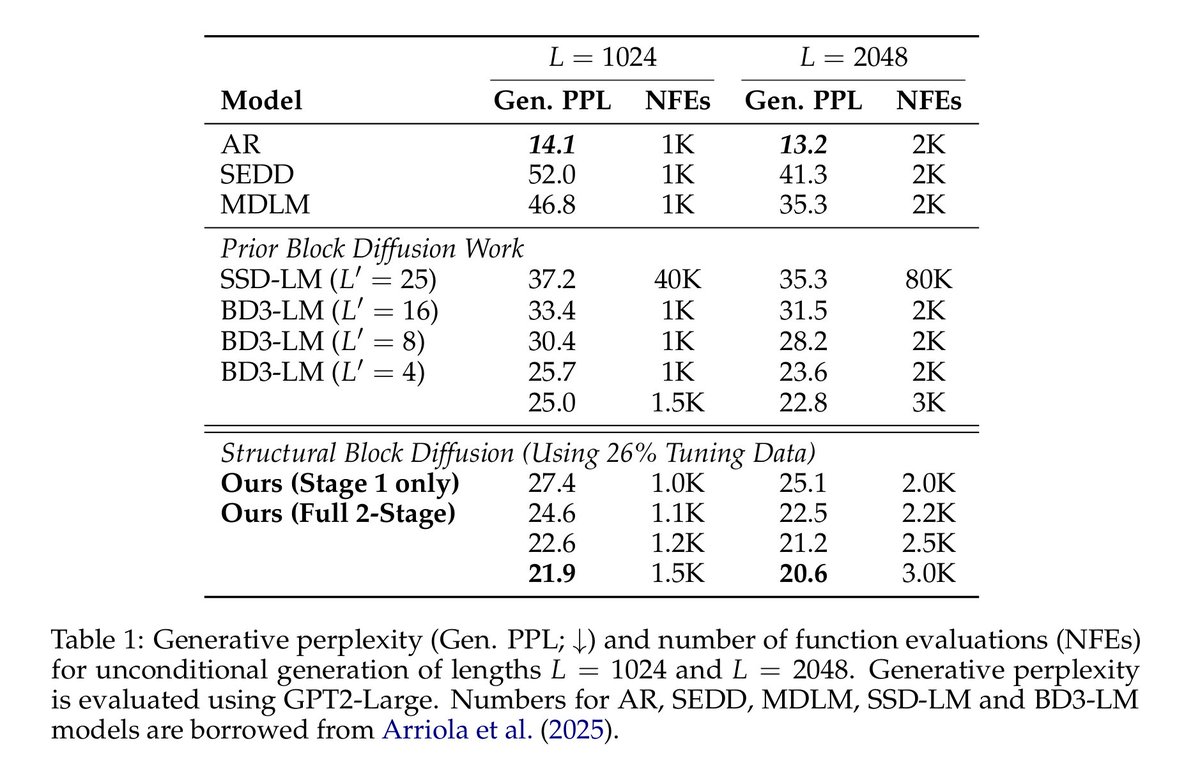

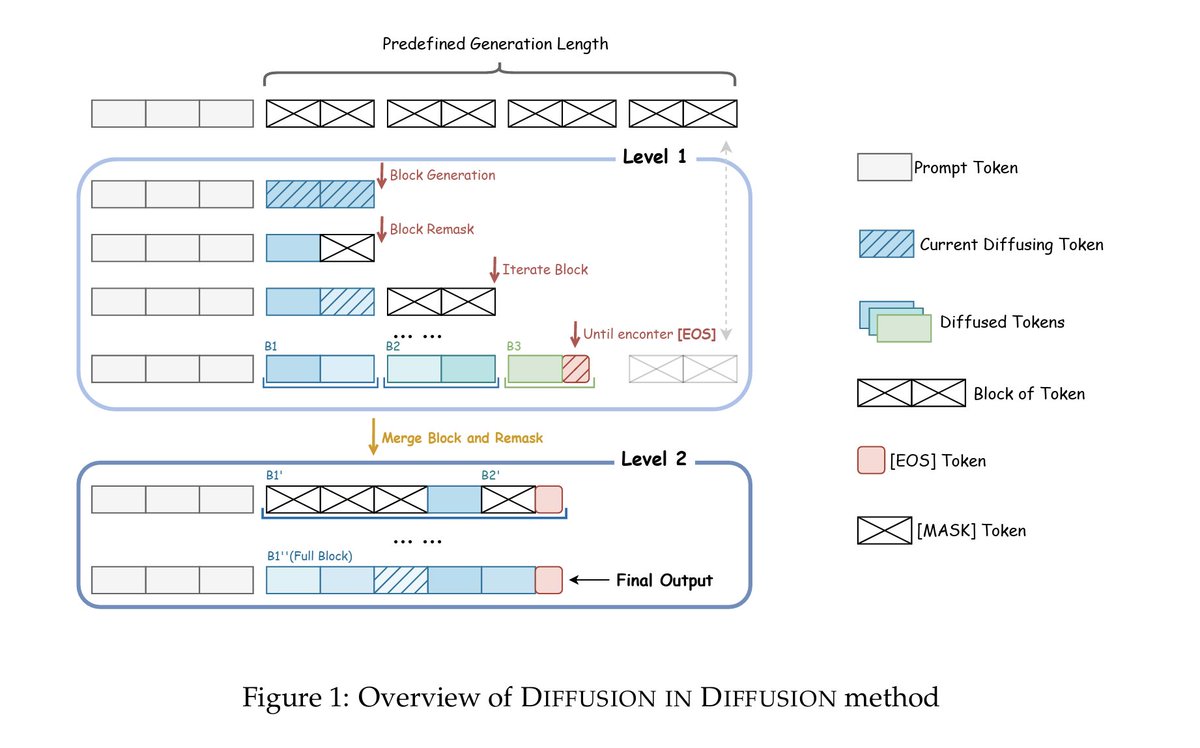

まず小さな単位で高速に下書きを作り、次に大きな文脈を見ながら必要な箇所だけ書き直すDiffusion In Diffusion

block diffusion の速いけれど前から順にブロックを確定していくため「先に書いた部分を後で直せない」「長距離の一貫性が崩れやすい」という課題に対応

arxiv.org/pdf/2601.13599

日本語

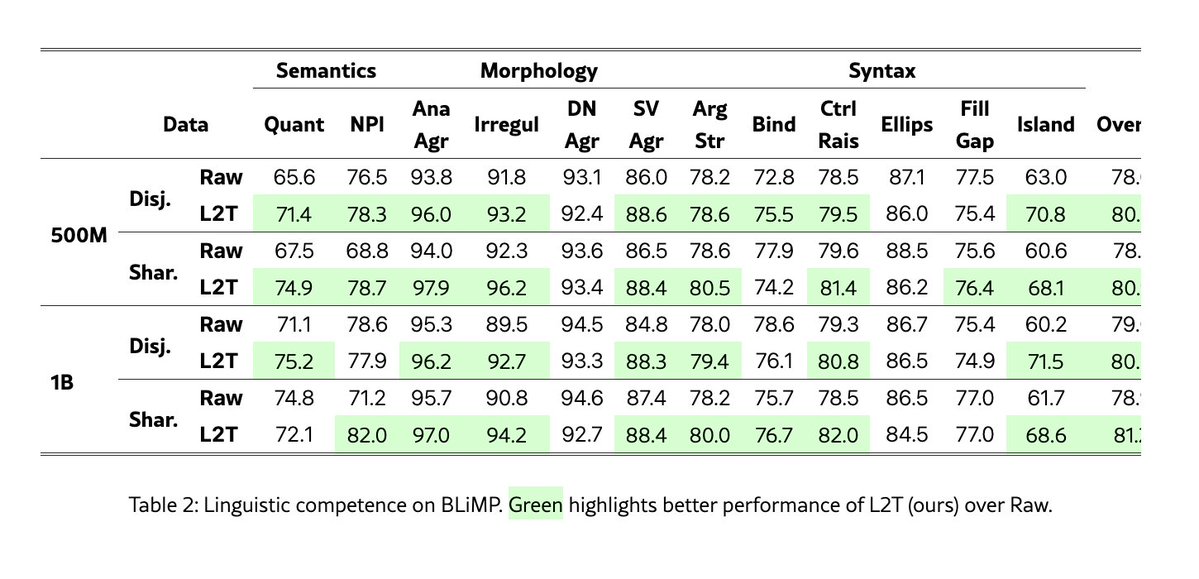

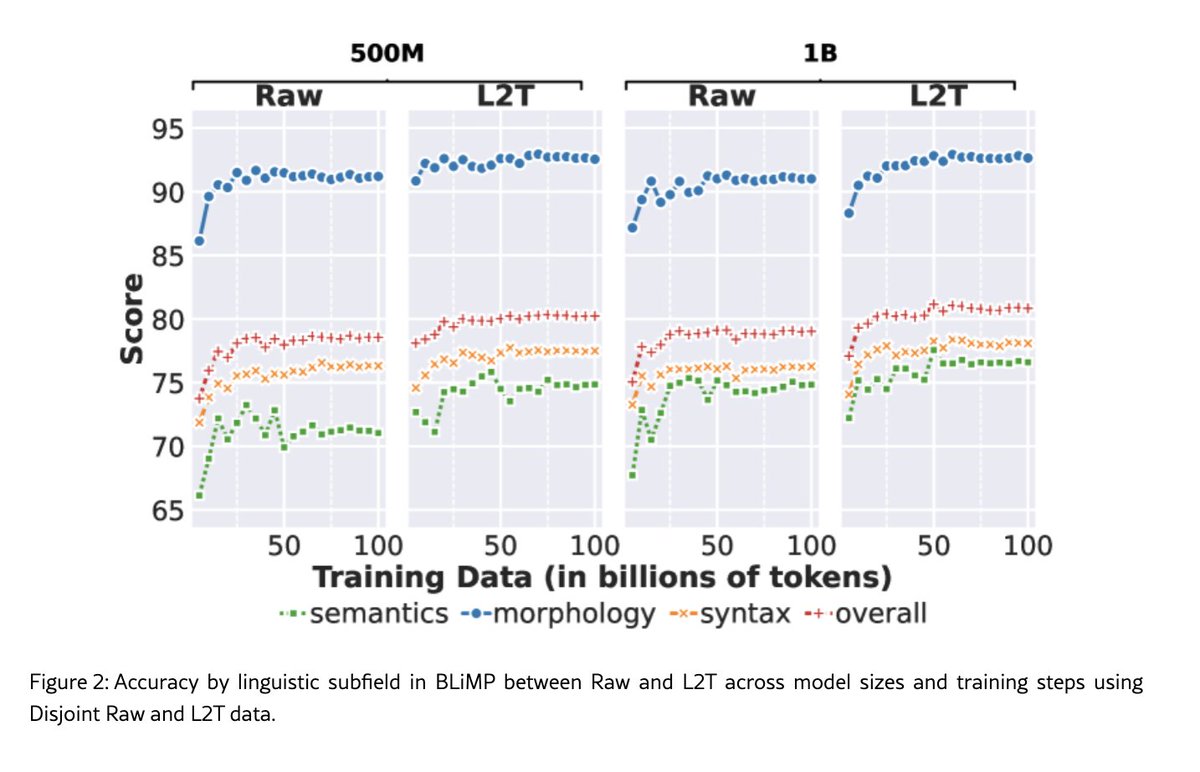

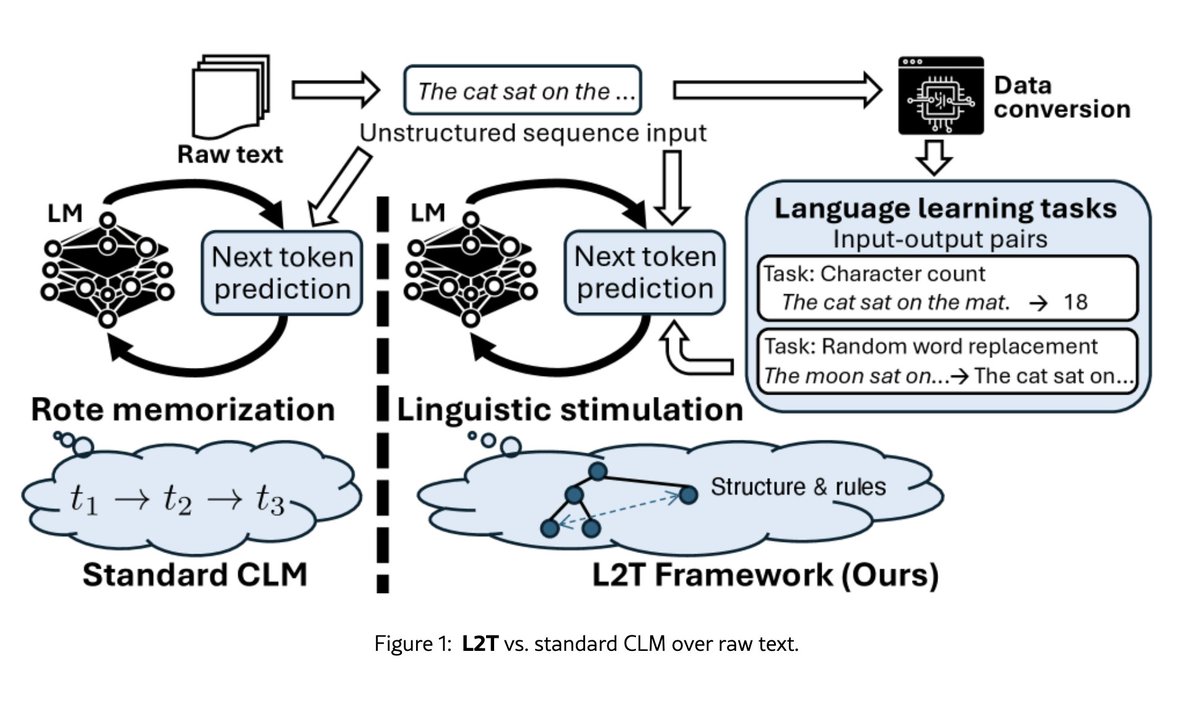

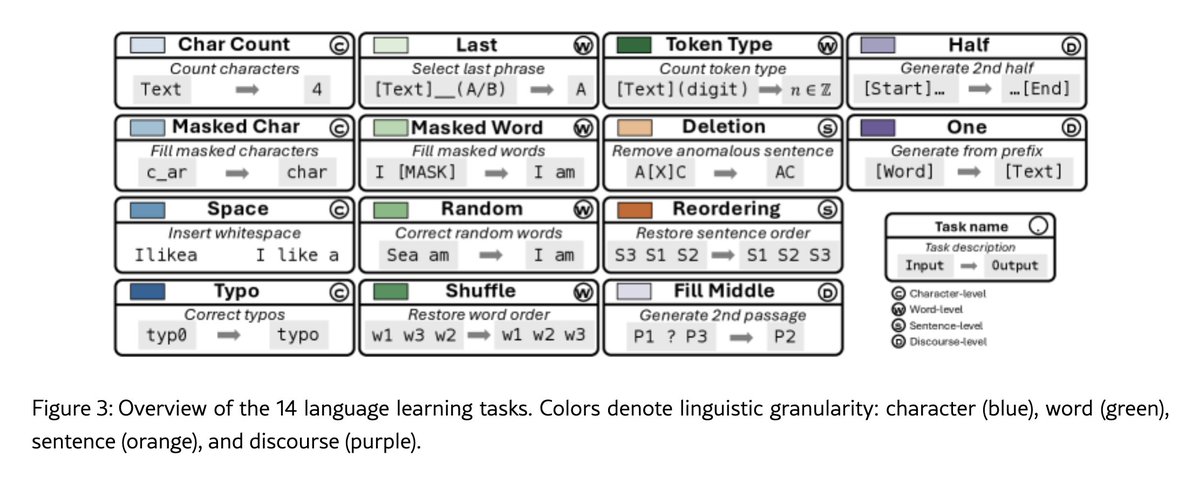

事前学習においてNext Token Prediction だけでなく、学習データから自動生成した“言語学習タスク”も混ぜて事前学習するLanguage Learning Tasks(L2T)提案

元の事前学習データから、文字数を数える、マスクされた文字の復元、typoを直す、などの14種類の言語タスクを作成

arxiv.org/pdf/2601.03448

日本語

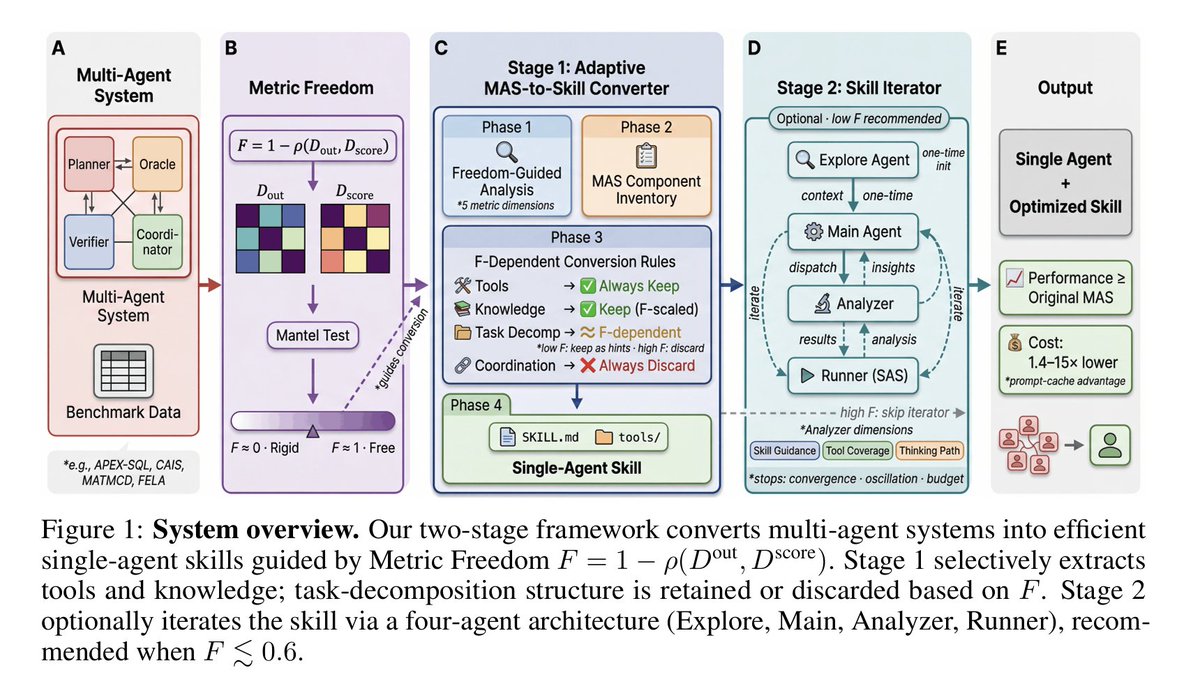

マルチエージェントの知見を単一エージェントにSkill蒸留(Weight DistillationではなくSkill Distillation)すると、どんな時に効果があるのか?を示した論文

Skill蒸留の有効性は、タスクそのものではなく、評価指標の性質で決まる、という主張。

arxiv.org/pdf/2604.01608

日本語

@Muji___rushi なるほど。

丸投げじゃなくて、組織としてちゃんとスキルとか整備してかなきゃ成功率上がらなそうですね(と、理解したが間違ってるかも)

日本語

Task Horizonのわかりやすい記事で勉強になった。

AI利用による「生産性プラセボ」効果、気付かずに起きてるかもだから気をつけよう。

>大事なのは、人間の感覚と実際のパフォーマンスの間にはまだ大きなギャップがある ということを認識した上で、指数関数的な成長トレンドを読み解くことです。

株式会社AI Shift@AIShift_inc

【AI Shift公式note】 本日はMLエンジニアの戸田が執筆しております! AIが数時間自律して働く? AIエージェントの進化と「AI Task Horizon」 ぜひご一読ください! note.com/ai_shift/n/n28…

日本語

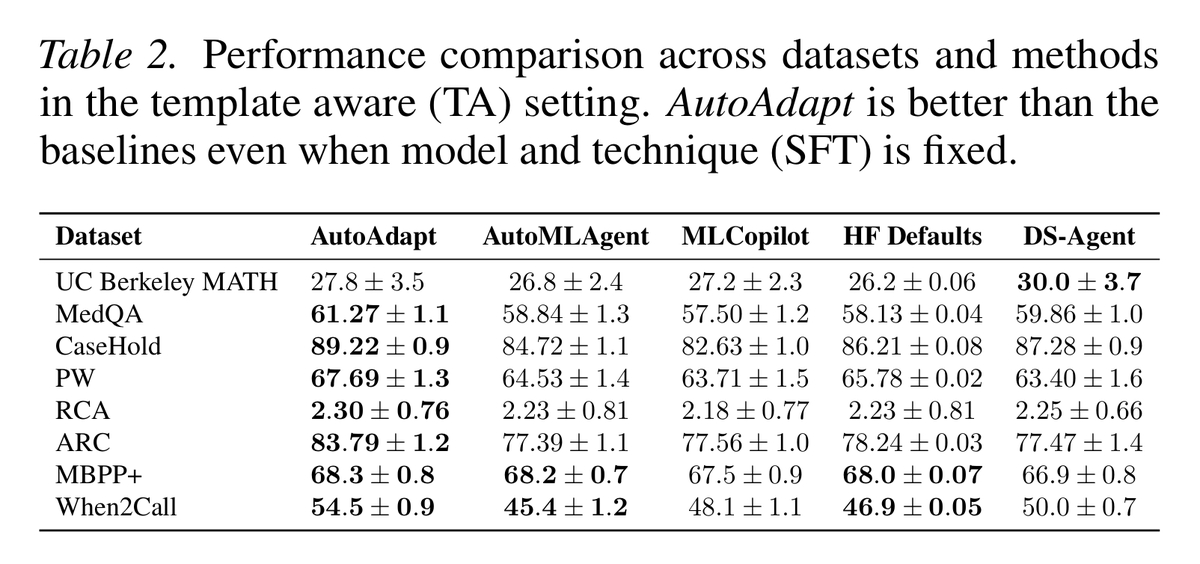

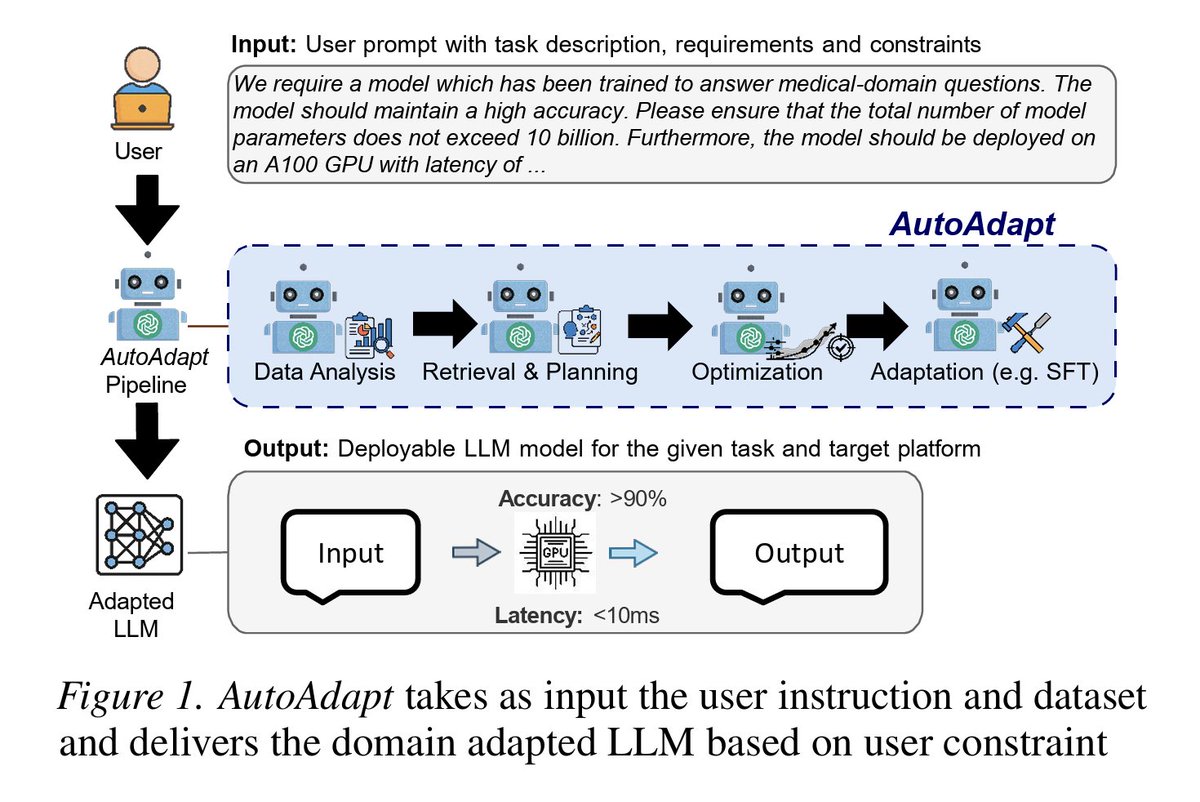

専門領域にLLMを適用する際に、RAG or SFT、LoRAを使うか、学習率やバッチサイズはどうするか、環境制約(GPU、レイテンシ、モデルサイズ上限など)を満たす構成をどうするかなどの決定を自動化するAutoAdapt提案

LLM特化でのドメインへの技術適用を自動化するイメージっぽい

arxiv.org/pdf/2603.08181

日本語