现状 交易

2.3K posts

现状 交易

@PresentTrading

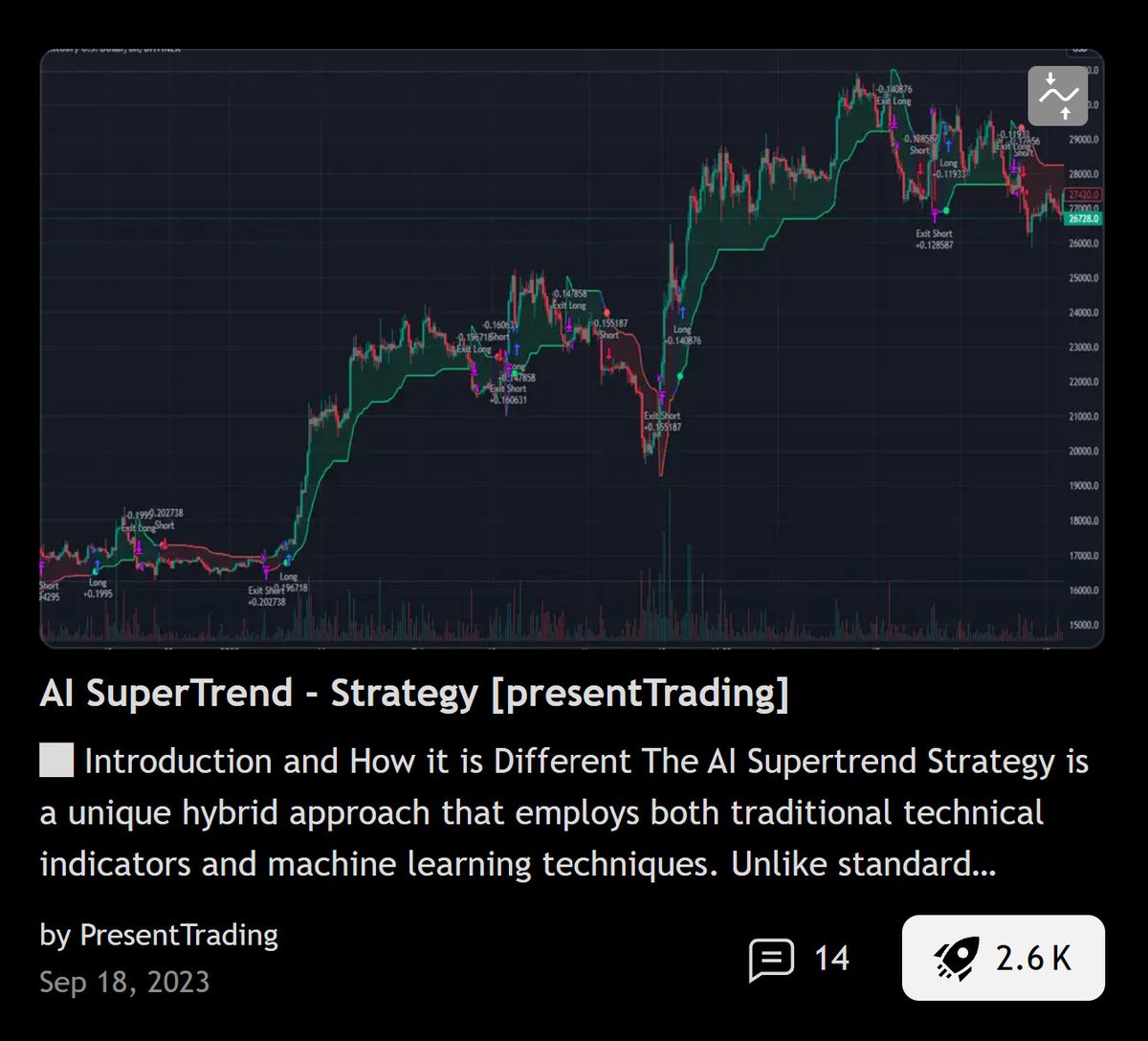

@Tradingview algo交易策略 | 创作者 | 机器人VLA | AI 使用研究 任何策略都必有系統要回测 https://t.co/vGtiKCpNUF en - @MathsTrading

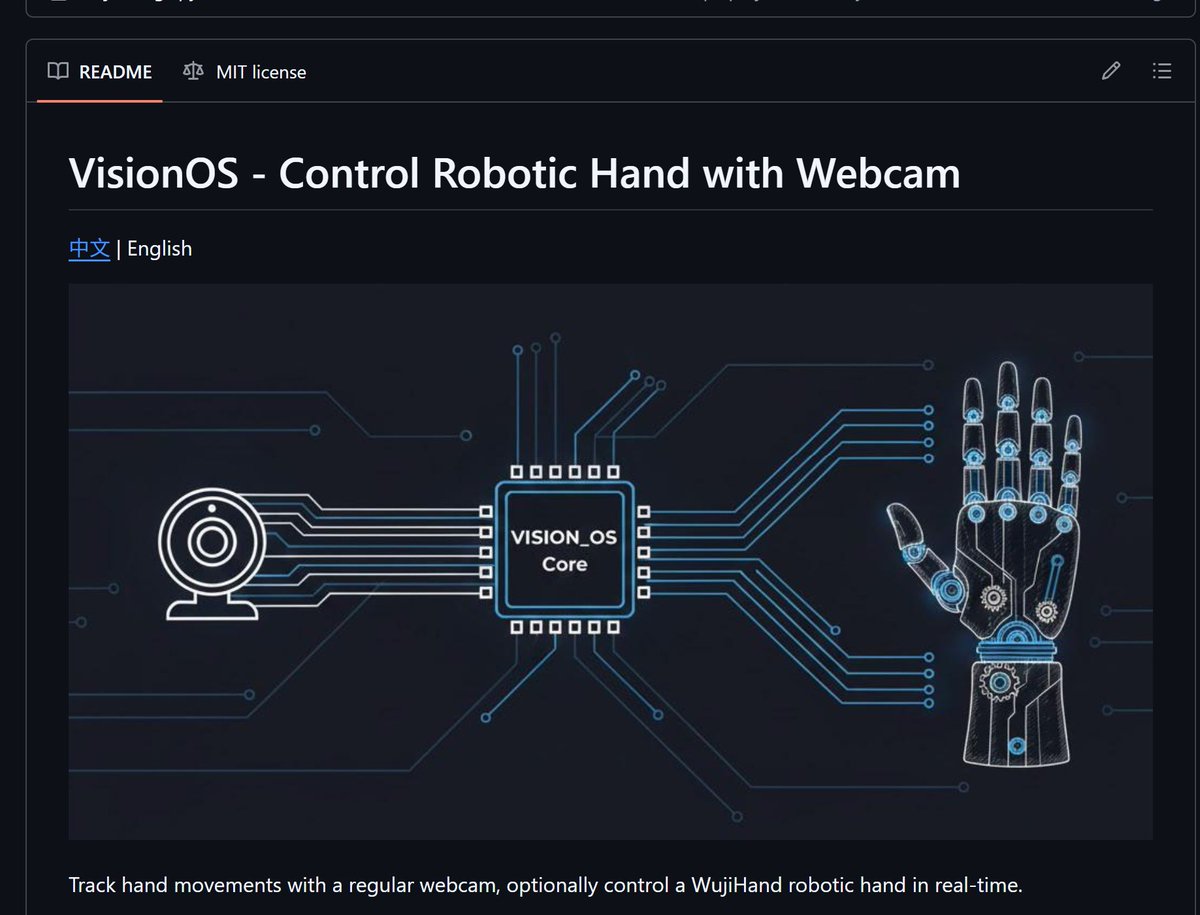

CES 2026上RealHand展示的机器人钢琴演奏 从技术展示看,机器人精细操作能力正在快速提升,离真正的通用机器人又近了一步

最近在看 Claude Code 创始人 Boris Cherny 的一些使用习惯,他提到一个细节让我特别有共鸣——他每天会用 /commit-push-pr 这种自定义命令十几次。 我一下就意识到,这不是「技巧」,而是效率体系。 用 Claude Code 写代码,其实有很多指令是每天重复在说的: 写完功能 → 看 diff → 生成 commit message → 提交 → 推送 → 开 PR; 或者反复说「帮我 review 一下这段代码,有没有 bug、性能问题、有没有更好的写法」。 单次不复杂,但高频、重复,非常消耗注意力。 Slash Commands 本质上就是:把你经常对 AI 说的一整段话,变成一个一键命令。 在 .claude/commands/ 目录下放一个 Markdown 文件,文件名就是命令名,内容就是提示词。 以后不需要再解释一堆背景,直接 /review、/commit-push-pr,Claude 就知道该干什么。 更爽的是,这些命令不是“玩具级”的。 你可以把一整套工程化流程写进去: 比如 commit message 规范、PR 描述结构、测试失败怎么处理、重构原则是什么,全部固化下来。 久而久之,你不是在「用 AI 写代码」,而是在用 AI 执行你的开发 SOP。 还有一个我觉得被低估的点:参数化命令。 用 $ARGUMENTS,你可以做搜索、查文档、针对某个模块操作的命令。 比如 /doc React hooks,Claude 自动在项目文档 + 官方文档里帮你查、总结、给示例。 这类命令一旦做顺了,基本就是你的私人 CLI + AI 助手。 Slash Commands 和 Subagents 也很好区分: 前者是「省掉重复输入的快捷方式」, 后者是「需要独立上下文、并行执行的复杂任务」。 不要纠结谁更高级,用对场景就行。 我最认可的一点是:这些命令可以直接提交到 Git。 .claude/commands/、CLAUDE.md、权限配置,全都版本化、团队共享。 个人的效率习惯,会慢慢变成团队的工程资产。 一句话总结就是: 如果你发现自己经常在对 Claude 说同样的话,那这件事就值得被做成一个 Slash Command。 单次可能只省几秒,但每天用几十次,效率差距会被无限放大。