Sabitlenmiş Tweet

Arthur Sarazin

1.9K posts

Arthur Sarazin

@SrzArthur

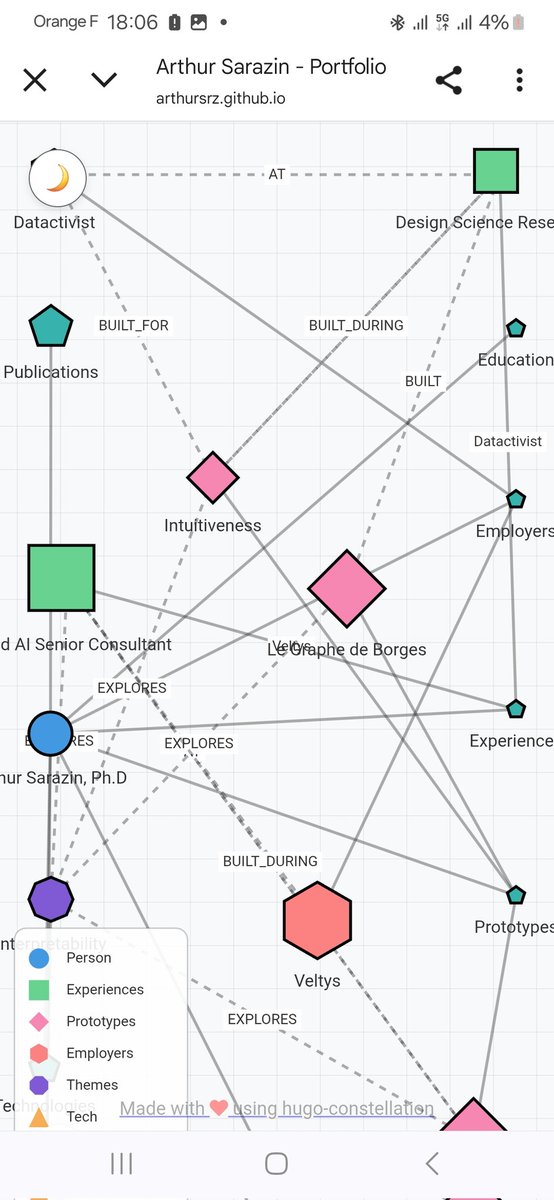

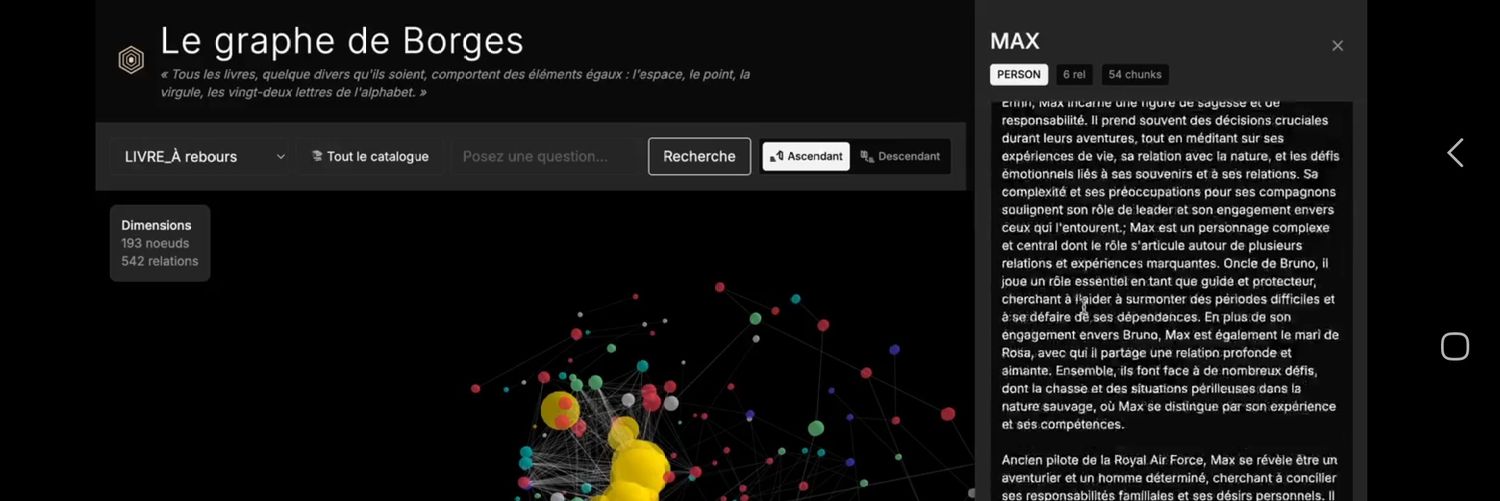

IT, Governance and Design 🧐 | Ongoing designer of Le Graphe de Borges 📚

Paris, France Katılım Aralık 2015

354 Takip Edilen448 Takipçiler

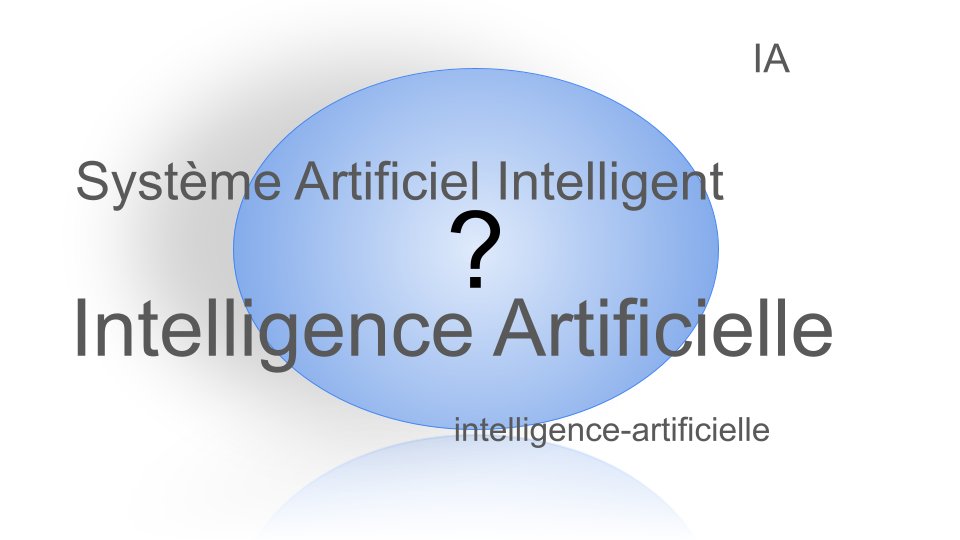

Dans tous les lieux de débats, on parle indistinctement d'IA, d'Intelligence Artificielle et des IAs mais...

...ces termes recouvrent-ils la même chose ? Si oui, de quoi parlons-nous ? Si non, de quoi parlons-nous ? 🙃

👇

linkedin.com/pulse/lia-lint…

Français

[Loin des LLMs, proche des reasoners] Le 6 janvier 2026, une solution totale au problème d'Erdos #728 a été trouvée, une nouvelle qui bouleversa le quotidien...

...de personne, et pourtant 👇

linkedin.com/pulse/d%C3%A9c…

Français

If your idea is off the GenAI training data distribution chart, then you know you are on a really creative path !

@emollick

English

@safehell Pour info : la vectorisation est extrêmement rapide sur Databricks, avec un petit modèle d'embeddings mais le calcul derrière sur ces vecteurs (cosine similarity par ex) trés long et coûteux. J'en ai jeté l'éponge.

Français

@safehell Mmm, on m'a mis a dispo une instance Databricks. Je suis en train de tester.

Français

Au risque de poser une question bête : est-il possible d'embedder des fichiers parquet sans sortir de #duckdb ?

Français

@ThbPlg @FraySebastien ...qu'ils n'ont pas réussi à résoudre.

Français

@FraySebastien J'ai une autre réponse à t'apporter : le détecteur d'IA de Compilatio a renvoyé un "faux positif", très probable au regard des garanties catastrophiques offertes par l'entreprise et son soit disant modèle de détection. Fiable à 70 % au mieux selon des études scientifiques

Français

Arthur Sarazin retweetledi

Oh yes. And this opens up many opportunities for massive RAG. It's very hard to maintain a big embedded collections while everything is data ready for a bm25 with query/document augmentation.

Baudouin@b_arbaretier

The overlooked truth about RAG in the LLM era: the query is just as important as the retrieval system. With BM25 and a solid query augmentation system, you can virtually retrieve anything.

English

3 Master et un doctorat.

Je suis responsable des archives d'un établissement de recherche français d'environ 4000 personnes.

Je gagne 2490 euros mensuels avant impôts.

Veve 🥷🏿@veleonaa

Coucou ! Vous êtes à quel niveau d’études et vous faites quoi comme métier actuellement ? +salaire svp

Français

@InfosReseaux Oui, d'où l'idée de commencer avec du connu (ontologie, noeuds de base) pour faire peut être de l'analyse de graphe et détecter des dépendances dangereuses, gap analysis, etc. Tu fais du query dans réseau, pas de génération. Puis pour le reste des simulations via LLM

Français

@SrzArthur Un début de réponse : les LLM ne sont pas le seul cas d'usage du SI. Ca détruirait beaucoup de chose pour un seul cas d'usage qui ne reprendrait pas tout le reste avec des risques importants

(Regardes ce qu'il est arrivé à gifi juste sur un changement de CRM)

Français

Réflexion tardive : si la gouvernance des données piétine parce qu'on ne peut savoir tout ce qu'il se passe dans un SI, et que les #LLMs naviguent dans des espaces latents, est ce que ça ne serait pas malin de concevoir un SI comme un espace latent ?

Français

Je découvre l'interface de @databricks pour travailler avec des données via notebooks.

Un chef d'œuvre.

Français

@safehell J'ai un fichier parquet trés volumineux. Je cherche à appeler un modele d'embeddings qui tournerait sur une colonne de ce parquet. Pour l'instant je convertis mon parquet en dataframe. Ca marche sur des subsets mais ttop lents pour des gros fichiers (8 millions de lignes)

Français