Stephan

1.4K posts

Stephan

@Stephan_Talk

后端技术专家 | Learn to build with AI | 热爱开源精神 | 分享最前沿AI资讯,以及我的深度思考和实践

借@Pandatalk8 的的帖子,展开说一说Zlibrary。 Zlibrary有个Z-Points计划,就是大家可以将不用的书,免费寄送到Z-Points站点。 我是北京站的Z-Points,至今已服务了两年。 最开始,我其实对这个计划存疑。不用的书,很多人直接当废品卖掉了。很少有人愿意花邮费将书籍寄送到Z-Points来。 但事实上,过去两年,我差不多收到了两百多本书,全国各地的快递都有收到过。非常感谢大家对Z-Points的支持。 另外也想替Zlibrary多说两句。如果大家有不看的书,或者不需要的书籍,可以寄送给我,我会上传到Zlibrary网站上面去,供全球的读者阅读。 我觉得这是一个非常幸福的工作,完全义务服务。当然,我也愿意继续为Zlibrary服务下去。

Figma 正式推出了官方的远程 MCP 服务器,现在不需要安装 Figma 客户端 只需要在支持的软件比如 Cursor、Cluade code 里面添加,并在打开的网页里面完成账户授权就行 而且现在设计组件和前端组件的映射信息也可以通过 MCP 获取到,如果你的团队有设计系统的话,然后你的设计稿组件采用程度高 前端可以一键用 AI 生成全部的前端代码,而且保证高还原度,设计师和前端协作会到一个新的时代

一个暴论:以后会有越来越多的零基础人,成为程序员或者设计师,而现在已经是这个职业的人,不应该成为他们的拦路虎,而应该成为引路人

太惊喜了,在罗永浩和周鸿祎的对谈中,发现了我自己被提到。约等于上罗老师的节目了! 网上有一个人,叫 马东锡 NLP , 你可以交一下这个朋友! 开心!

notebooklm的API开放了。是个机会。 NotebookLM api - Create a notebook - Retrieve a notebook - List recently viewed notebooks - Delete notebooks in batch - Share a notebook - Add data sources to a notebook - Delete data sources from a notebook 信息源:👇

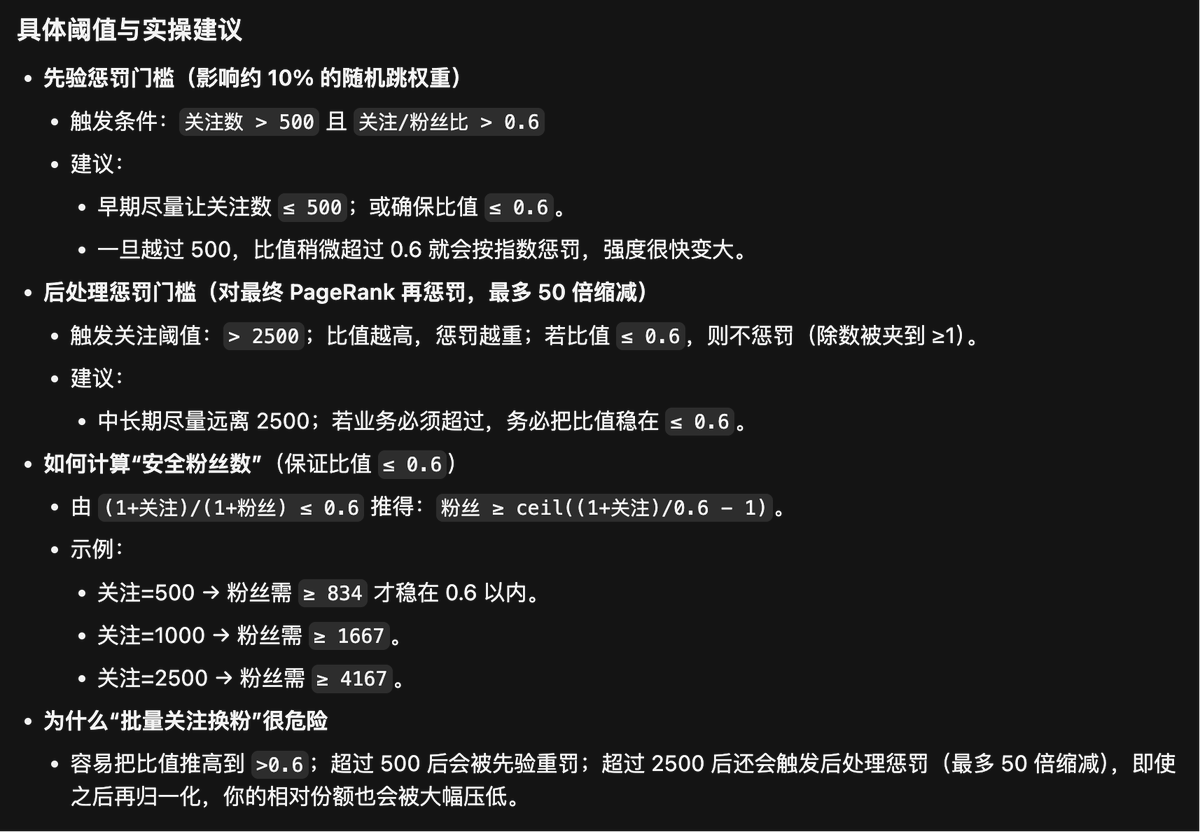

X开源了他们的推荐算法,以下是会影响你的账号影响力排名的因素: 1.优先让“高质量账号”关注你 被更多高质量账号关注,权重值更大,且对方"出边"数越少,你得到的份额越足 "出边"指的是每个账号对其他账号的关注及互动强度,可以理解为每个账号是一个图节点,账号之间的关注及互动是节点之间的边 建议:深耕垂直领域,主动合作/互动头部或中腰部优质作者,参与高质量话题与空间 2.争取来自优质账号的“强互动” 被转推/回复/提及时的权重更高;多元互动可拉升你在对方出边上的占比 建议:做可被引用/讨论的内容,发起问答/共创;在热点中输出被引用的“原始资料/观点” 3.控制“关注/粉丝”比,避免触发惩罚阈值 平台对“高关注、低粉丝”的账号会有严重降权,早期尽量让关注数 ≤ 500;中长期尽量远离 2500 上限 建议:维持关注/粉丝比 < 0.6;避免“批量关注换粉” 4.提升账号“先验质量” 蓝V认证能够拿到稳定的10%先验权重,能稳定抬高“随机跳”部分,帮助冷启动与整体稳定性 其他提升先验的手段:绑定有效设备;保持账号安全不受限;平稳运营超过 30 天 5.结构优先于数量 一百个普通新号关注,不如 3–5 个“高质量、低出边”的账号关注更有效 6.内容与节奏 - 聚焦“可被引用/二次传播”的内容形式(数据图解、清单、教程、观点源头) - 固定发布节奏与系列化主题,降低对方关注门槛、提高复访与外链引用概率 避坑清单: 1. 不要大量“先关注后取关”或扫粉;极易触发先验与后处理惩罚 2. 新号前 30 天预期偏低属正常;平稳积累与“精准高质量关注”比短期爆量更有效 3. 若你发现互动很强但排名无明显提升,可能当前作业是“仅关注边、未加权”;这时“被谁关注”更关键 --- 如果你想深入了解X的整体推荐算法原理,以及对内容创作者的最佳实践建议,可以点赞+转发我这条推文,我会私发你一份《X推荐算法深度解析:机制、权重与创作者策略》的1万字DeepResearch报告