AI-YuRi @ Local LLM

57 posts

AI-YuRi @ Local LLM

@YuRi_LLM

ミニPCでローカルLLMを始めました。 ========== LMDE 7 - Cinnamon AMD Ryzen 7 7735HS with Radeon 680M iGPU 64GB RAM Local LLM | LM Studio | Open WebUI | Open Notebook

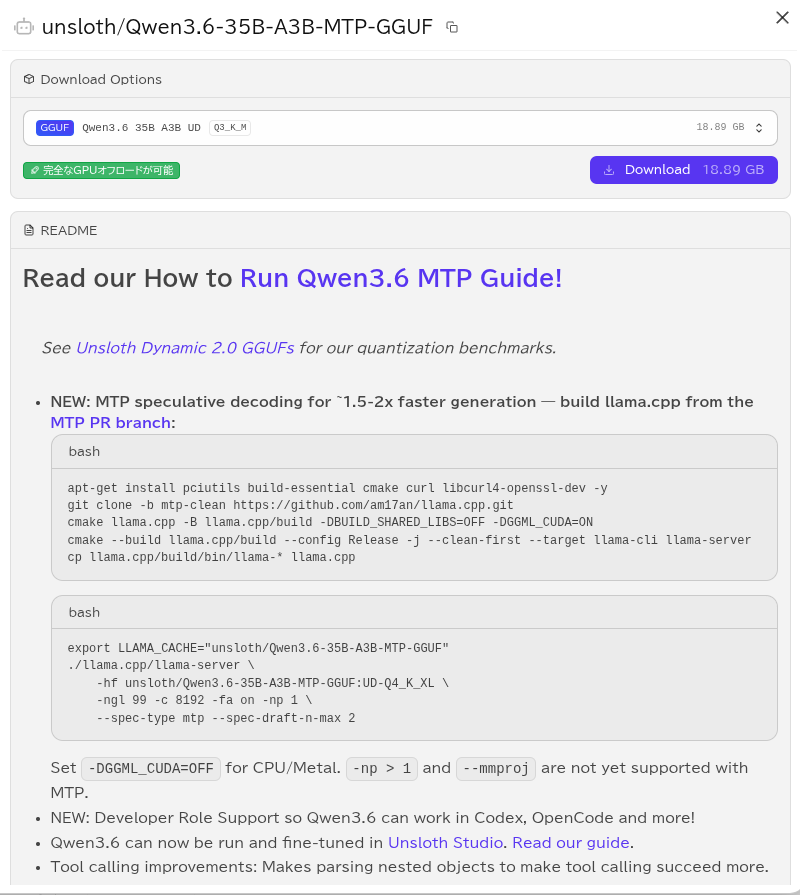

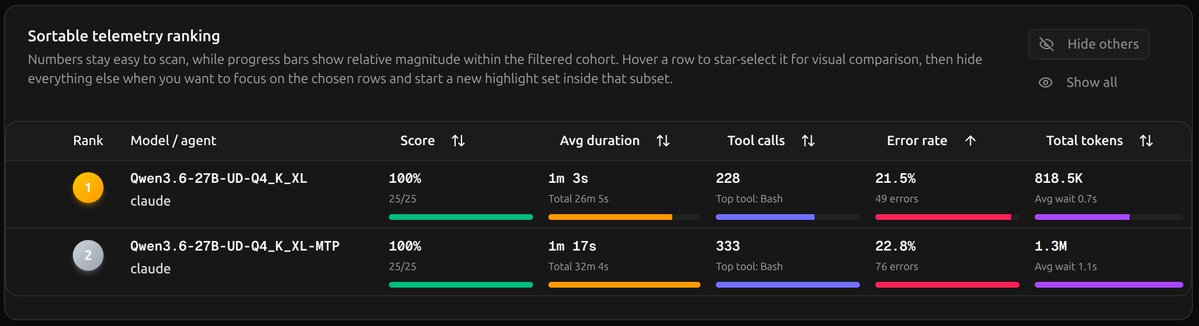

MTP works with quantized models, but the speedup is much smaller than with the original BF16 model. That’s expected: quantized models are already faster, and quantization changes the output distribution, making future tokens harder for the MTP layers to predict.

MTP:手元のPCでの検証結果まとめ(decoding速度) ①27B ・RTX 5090:+20%程度 ・Mac(M2 Ultra):ほぼ変化なし ②35B-A3B ・RTX 5090:-30%程度 まだ最適化されてない可能性もあるが、実際に自分の環境で使ってみて採用するか否か検討したほうが良さそう。ちなみにMTPは必要なVRAMも増える

ガチで神。 たった30MBのアプリで、Adobe Acrobatでやってる作業がほぼ全部できる無料PDFエディター「RevPDF」が海外で話題です。 ・テキストや画像の編集 ・電子署名、墨消し、圧縮 ・Word変換(ベータ)、フォーム作成 ・ページの分割・結合・並び替え しかも100%オフライン。アカウント登録もサブスクも一切なし👇

Gemma 4 is a highly-capable model in Japanese! Amazing to see great results for it on the latest Swallow Leaderboard v2 results. ✨ Excited to see what’s next in the open model space!

Computer use with any model Hermes Agent × @trycua