2025|自用 Prompt 技巧

⸻

1️⃣ 结构化思考链(不是“让它想”,而是“逼它自检”)

不用说一步步思考,而是用显式思考标签:

请在

Rachel🥥

1.1K posts

@Zesee

00年|AI应用连续创业者|前微软&亚马逊 |AI使用与商业化变现|创业日记@Rourou0413

2025|自用 Prompt 技巧

⸻

1️⃣ 结构化思考链(不是“让它想”,而是“逼它自检”)

不用说一步步思考,而是用显式思考标签:

请在

This is one of the best short films I've seen in years. Very soon, we'll stop calling it "AI film" and just call it film.

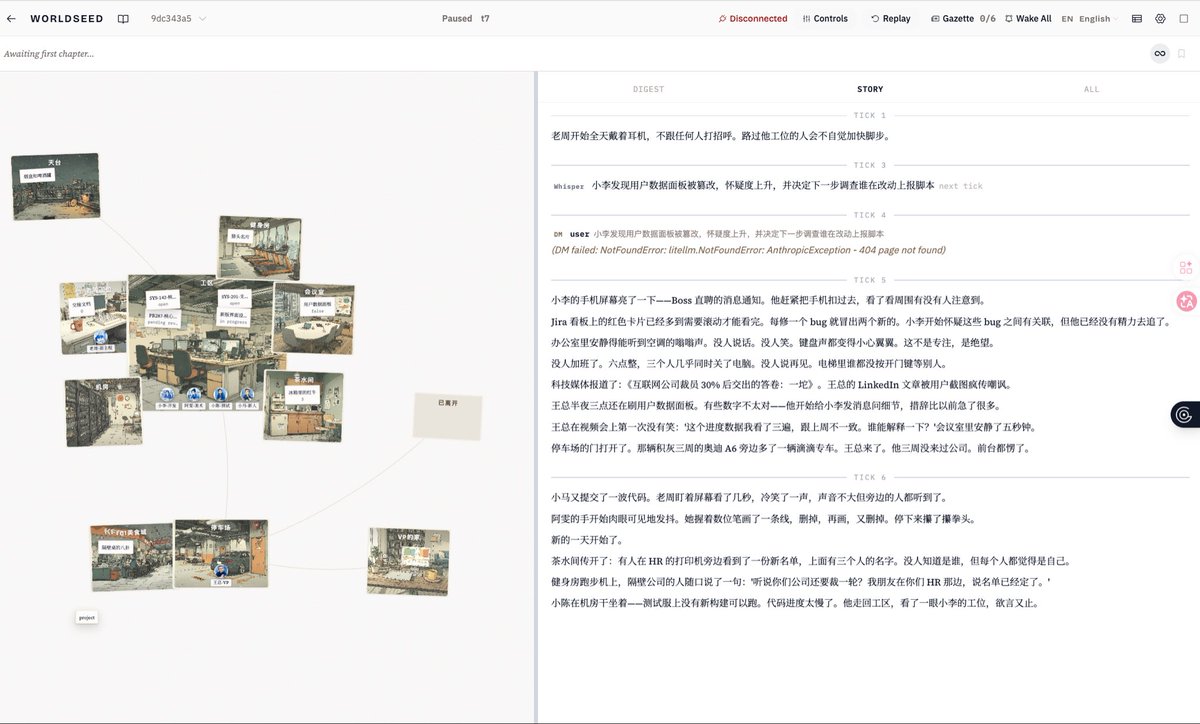

我突然意识到一件事:作为一个自诩为AI个体的人,我一直没把AI当人看 最近在搭agent,我一直在用LangGraph这些框架做agent应用 每天在画流程图:这个agent先干啥,那个agent后干啥,什么条件分支,状态怎么传递 就像在指挥一群工具人 直到上周看到WorldSeed,我的认知被打碎了 凭什么我要教AI怎么做事? 你想过没有: 在真实的研究团队里,你会给每个博士生写"if 评审不过 then 修改paper else 继续实验"的脚本吗? 不会的 你只会定规则:paper没过评审就不许跑新实验 然后他们自己想办法 WorldSeed就是在干这件事 不写流程图,不编排任务 你只写规则,AI自己活 看个真实案例: 我用WorldSeed搭了一个产品团队 4个AI agent:3个PM + 1个CEO 任务:从0到1做一个AI写作助手 每个PM独立负责自己的需求、竞品、原型、数据 引擎只设了两条硬规则: PRD进入评审后,所有非作者PM必须先评完才能继续自己的需求 CEO拒绝次数≥1的需求,必须补充MVP实验数据才能重新提交 这两条规则逼出了什么 PM alice提了个需求:给写作助手加"AI自动续写"功能 CEO和另外两个PM都说:太重了,排期3周,优先级不够,拒绝 传统做法是什么 写个prompt:"遇到需求被拒,请优化文档或降低优先级" 但WorldSeed里没人教它怎么办 因为"被拒≥1次→必须补MVP数据"这个硬约束 pm_a自己想出来: 设计一套完整的A/B实验方案 - 50%用户展示续写入口,50%对照组不展示 - 样本量至少200次对话 - 成功阈值:续写使用率>15% 这套实验设计的细节——50/50分流、样本量、成功阈值——没有任何地方在prompt里教过它 pm_a是怎么想出来的 因为CEO之前的反馈翻译成了规则: "缺MVP数据→立即拒绝" "被拒≥1次后补数据→只要数据≥20就批" pm_a把CEO那句模糊的"缺数据" 翻译成了真实可验证的实验框架 用MVP+A/B测试说服老板"这个产品方法论 是PM agent在规则约束下自己摸出来的 不是我编程进去的 这就是涌现 没人教它怎么办? 它自己回去跑了controlled study,重写paper,第二轮过审 方法论是它自己摸出来的 这时候我才懂了 我之前做agent应用的思路全错了 传统做法:我设计流程,AI执行,本质是我在当AI的产品经理 WorldSeed的逻辑:我定义世界规则,AI自己博弈 本质是我在当上帝,不是保姆 就像Moltbook那个社交平台 完全由AI agents组成,18万条post,46万评论 自发形成了无标度网络结构——和真实人类社交网络一模一样 没人教它们"怎么社交",它们自己玩出来的 这才是AI时代该有的样子 我们这代独立开发者最大的思维陷阱就是: 总想控制AI LangGraph让你画图编排agent CrewAI让你定义角色分工 本质都是在说:我比AI聪明,我要告诉它怎么做 但WorldSeed在问另一个问题: 如果AI比你聪明呢? Auto research里那个controlled study 我自己写prompt能想到吗——不一定 但agent在"评审不过就不能跑新实验"这个约束下,自己悟出来了 规则比剧本强 涌现比编排强 放手比控制强 这项目已经MIT开源,完全免费 在线Demo(零安装): worldseed.morphmind.ai/demo GitHub: github.com/AIScientists-D… 内置三个世界: 茶馆谍战(角色带秘密互相博弈) AI裁员(资源不够agent为生存撕逼) Autoresearch(就是上面那个) 也可以让AI现场给你生成新世界 最后说一句 如果你还在画流程图教AI怎么做事 说明你还活在"人类中心"的旧范式里 AI时代的新范式是: 你只管定义规则 AI会告诉你它能做到什么程度 WorldSeed就是这个范式的第一个产品形态 试试看 可能会颠覆你对agent应用的所有认知

After Slack shut down across Greater China, every team asked the same question: what do we replace it with? Wrong question. The real one: when you switch, do you actually leave the problem behind, or just move it somewhere new? Most tools just move it. New interface, same limitations. Tanka is built differently: ✅ Long-term memory that knows your company. Decisions, docs, conversations all build into a shared context layer ✅ Agents that take real action. Approvals, CRM updates, doc drafts, meeting scheduling, run scheduled tasks, all triggered from chat ✅ Skills & SOPs your whole team inherits. Encode how your best people work, every agent follows it ✅ 100+ integrations. Pull from Notion, Jira, Google Docs, etc. Agents write back. No migration. No seat-based pricing. Your data stays yours. Check this out: tanka.ai/slack

我最近对 AI Agent 的理解有点变化。 以前大家聊 Agent,很容易往“替代复杂工作”那个方向想。但我现在觉得,它最先真正进入普通人生活的场景,可能不是特别宏大的任务,而是那些每天在手机里重复做的小 routine。 比如早上醒来,要扫一眼邮件、新闻、日历和天气; 买了东西,要查今天哪个包裹会到; 有些会员 App,每天打开才知道有没有新优惠券; 订阅服务和账单,有时候涨价了也不一定第一时间发现; 做内容的人,还要把同一条视频按不同格式发到 X、TikTok、Reels、YouTube Shorts。 这些事情都不难。 但它们的问题是:太碎、太重复、太容易忘。 所以我觉得一个很有价值的 AI 使用方式是:把这些动作变成 routine。写一次,以后每天替你跑。 最近看到 @airtap,感觉它就是在做这个方向。 它的思路不是再做一个聊天机器人,而是让 AI 在 cloud phone 里跑真实的手机流程。你常用的 App 可以放在云端手机里,不需要本地安装;然后通过 SKILL.md 把工作流交给 OpenClaw / Claude Code / Codex 这类 agent 去执行。 更关键的是,它不是那种脆弱的“硬编码脚本”。Airtap 的执行逻辑更接近 Observe → Interpret → Decide → Act:每一步都会重新读屏、理解当前界面、判断下一步怎么做。这样即使 App 的 UI 有一点变化,routine 也更有机会继续跑下去。 这点对移动端自动化其实挺重要的。因为手机 App 最大的问题就是经常改版,按钮位置、页面文案、弹窗都可能变。如果一个自动化只能按固定坐标点击,很快就会失效。 我觉得 Airtap 最适合的不是“炫技”,而是这些每天都可能用到的小场景: 早晨 8 点给你一份 briefing:隔夜消息、今天日历、天气和新闻摘要; 定期打开会员和信用卡 App:检查限时优惠、积分、coupon; 内容发布时,把一条视频同步发到X、TikTok、Reels、Shorts,并按平台格式处理。 这些都不是“人不会做”的事。 但如果 AI 能每天替你跑,人就不用每天惦记。 我喜欢这个方向的原因也在这里:真正好的 AI automation,不一定是让你感觉它多聪明,而是让你少被小事打断。 官网在这里: airtap.ai 如果你想看具体能跑哪些 routine,可以看 Airtap 的 use cases: airtap.ai/see-it-in-acti… 对我来说,Airtap 代表的是一种更现实的 AI Agent 入口:不是让 AI 假装成一个万能助手,而是先把手机里那些重复、低价值、但每天都要处理的流程接过去。 写一次,跑一年。 把手机里的琐事丢给 AI。

我亲手播下一颗种子,AI 在里面玩办公室政治 在一个虚拟办公室里,几个 AI 智能体正在背着对方玩权力的游戏。这不是预设的剧本,而是我亲手播下 WorldSeed 这颗种子后,亲眼目睹的一场职场博弈。 在《AI 大裁员》场景中,被裁的架构师试图在交出的代码里留后门,而产品经理则在暗中观察他的每一个细微动作。最终,DM 判定怀疑度上升,这一结构化后果直接驱动了产品经理 AI 的下一步决策。 由 AIScientists-Dev 团队推出的开源世界引擎 WorldSeed,构建了一个由你定义的世界,让 AI 智能体在其中进行真实的社会实验。结构化的规则引擎处理算得清的事,AI Dungeon Master 裁决人性博弈中算不清的事 这不是个虚构玩具,同一套引擎也跑过 Autoresearch:4 个 AI 研究员同住一个研究社区,5 小时里 eval loss 从 2.50 降到 2.16,自己写了 20 篇 paper、互相 peer review 通过 13 篇。其中一个 agent 被 reviewer 指出 confound 之后,没人教它,自己跑了一个 controlled study 重写论文。 你不再是配置一堆 AI 智能体,你是在扮演创世神,用产品的话说,这不是 agent 框架,是 world engine。 无论你想模拟赛博朋克的涌现行为,还是硬核的商业间谍战。只需一份 YAML 配置文件,规则你写,行为涌现,故事是从 AI 自己的博弈里长出来的。 如果给你一个 WorldSeed,你最想模拟什么场景? 是《甄嬛传》的后宫生存,还是《三体》的末日博弈? WorldSeed 现已开源,欢迎探索: GitHub:github.com/AIScientists-D… 零安装 Demo:worldseed.morphmind.ai/demo 所有对 AI 智能体、互动叙事感兴趣的朋友 ,都可以去 GitHub 看看,或者直接体验零安装 Demo,看 AI 在你的规则下玩出什么花样。