加浓🧊美式

5.4K posts

加浓🧊美式 retweetledi

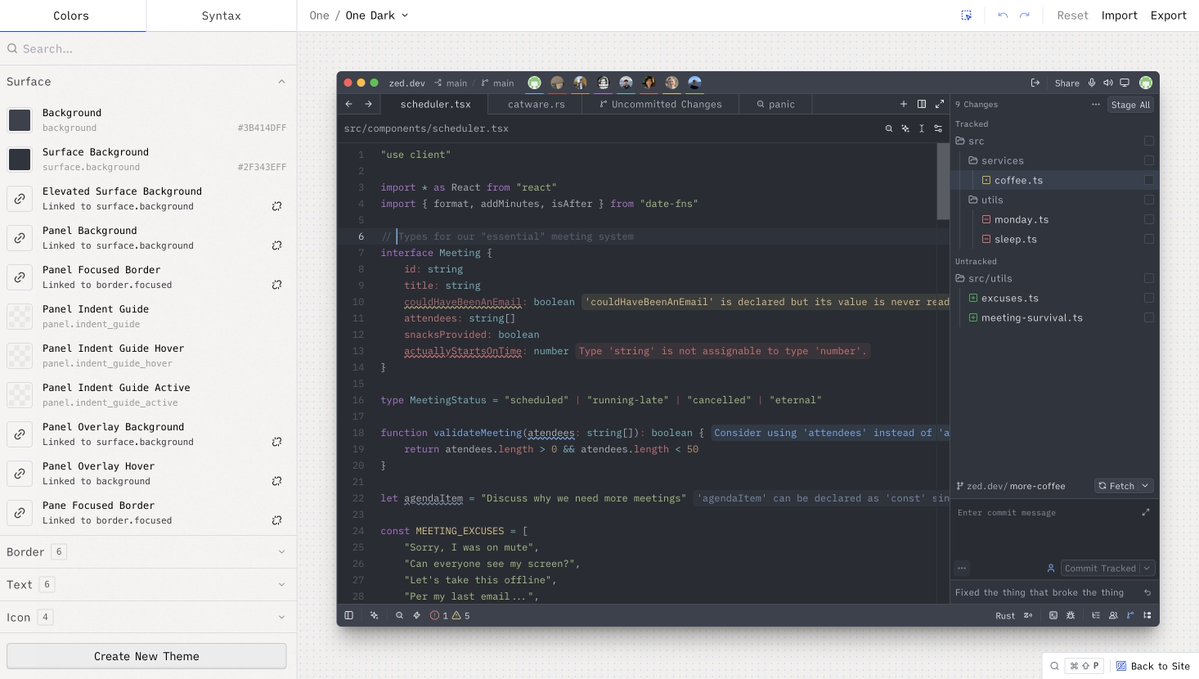

zed 这个主题编辑器好漂亮啊,zed.dev/theme-builder 可以快速编辑和了解 Zed 主题的设计思路。

还是很喜欢整个 zed 的设计风格的,复古克制又漂亮,算是,用的字体是 IBM Plex Serif Var 和 iA Writer Quattro S 也很好看。

中文

Codex grew programmatic policies with no neural nets: max score on Breakout, and SOTA-level scores on MuJoCo.

Maybe heuristics were not too weak. Maybe they were just too expensive to maintain. Maybe it's the next paradigm.

trinkle23897.github.io/learning-beyon…

English

IMHO, this verbatim C-to-Rust translation is a mistake; it should be approached from the perspective of the program's topology, which, unfortunately, is often incomplete or even incorrect.

Kiran@kirancodes

Little shoutout to my classic blog post on this very question: kirancodes.me/posts/log-sins…

English

Interesting! Gemini is more friendly toward Chinese than others, especially Anthropic.

Aran Komatsuzaki@arankomatsuzaki

Follow-up on non-English token-inefficiency with more model-language pairs: - Chinese is cheaper than English on major Chinese models - Gemini and Qwen provide least non-English tax - Anthropic has the highest tax by far; Kimi is next - Hindi is the worst-covered language here, despite its massive speaker base

English

加浓🧊美式 retweetledi

Dario is wrong.

He knows absolutely nothing about the effects of technological revolutions on the labor market.

Don't listen to him, Sam, Yoshua, Geoff, or me on this topic.

Listen to economists who have spent their career studying this, like @Ph_Aghion , @erikbryn , @DAcemogluMIT , @amcafee , @davidautor

TFTC@TFTC21

Anthropic CEO Dario Amodei: “50% of all tech jobs, entry-level lawyers, consultants, and finance professionals will be completely wiped out within 1–5 years.”

English

加浓🧊美式 retweetledi