redfox🛡️🛰️

352 posts

X에 올린 머니플로우 조회수 1.5만에 좋아요 237개, 댓글 35개 토스에 올린 머니플로우 조회수 1만도 안되는데 좋아요 226개, 댓글 78개. 난 여태까지 X가 내 본진이라고 생각했었는데 ㅋㅋ 댓글과 좋아요 화력 차이가 이렇게 나는건 좀 실망스럽네 ㅋㅋ

와... 미친 11년 잠긴 비트코인 400k 클로드 Ai로 비번 7조 번을 돌리고 복구해버림 대학 때 만취해서 바꿔놓고 11년간 잊어버린 비트코인 비번이 'lol420fuckthePOLICE!*:)' 였대요 ㅋㅋㅋ 옛날 대학 컴퓨터 폴더 통째로 Claude한테 던지니까 지갑 파일 찾아내고 복구 도구 버그까지 고쳐서 풀어냄 "다 줄 테니 알아서 찾아내" goal 쓴건가? 어떻게 했누..

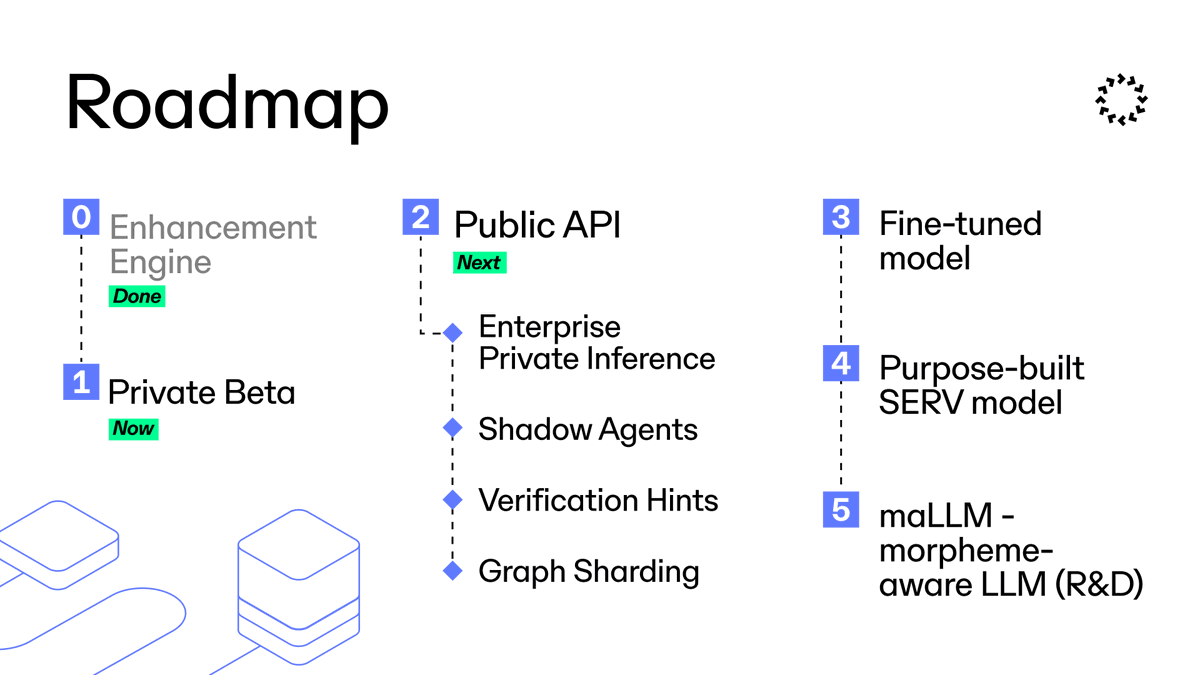

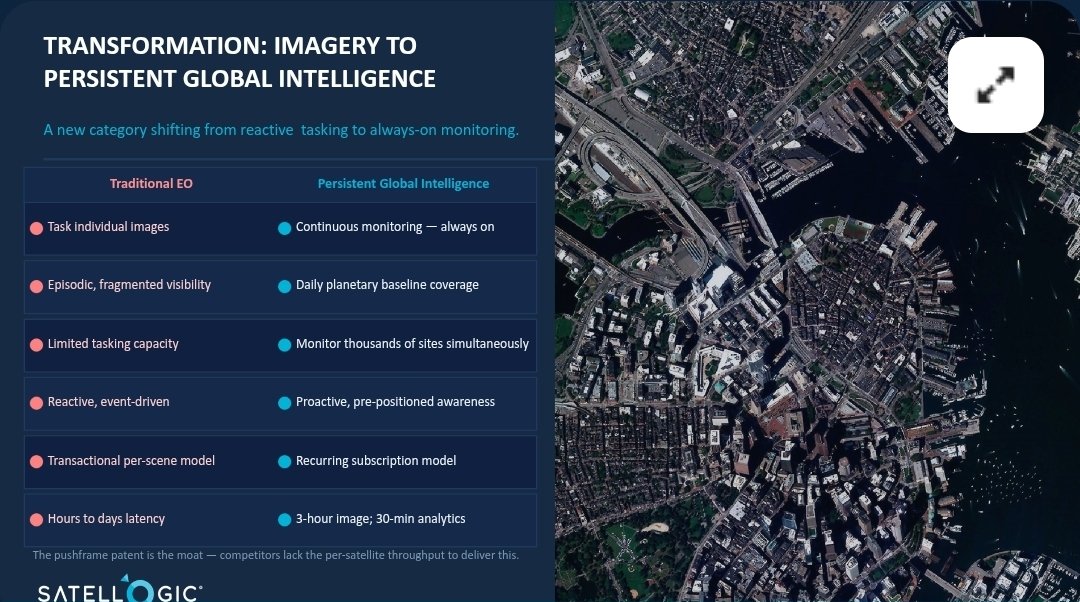

These are real numbers in production with an enterprise client during our first week of the SERV Reasoning Private Beta. For those who are new, SERV Reasoning is a proprietary AI reasoning API that solves the biggest issue in AI Agents today: > their ability to produce reliable results, consistently at an economically feasible price point. It is the largest bottleneck in AI adoption across startups, enterprise, and governments. The product is currently in private beta, and has already been deployed across 10+ enterprises, the UAE Government, and multiple startups in prediction markets, compliance, DeFi, private AI, banking and more. > How does it work? Instead of asking a model to think step by step in open prose, SERV Reasoning binds the model to execute a custom reasoning graph expressed in machine-native code (Mermaid flowchart syntax, for the technical readers). The core graph mechanic splits the problem into two phases: 1. A high-capacity model generates the reasoning graph. Branches, validation checkpoints, decision nodes, all laid out explicitly as a plan. 2. A smaller model executes the graph at inference time, node by node. It follows the plan. It doesn't improvise. And now, with a simple one-line code change, any production AI Agent system can benefit from this reasoning engine. We're already seeing insane results in production with our enterprise users, see quoted tweet below. This is all backed by a full academic research paper we published in December, co-authored by an NVIDIA AI researcher. It is currently undergoing peer review. And this is all just the beginning. We've got a stacked roadmap for this product with: > Shadow agents > Sharding Graphs > Morpheme-aware LLMs > Our own fully custom built models 100x improvements in performance-per-$ in production with our first enterprise users is literally just the start. SERV.

Greg Ivanov joins SERV as key advisor. ex-Head of Partnerships at Google, GP at 227 - early backers of Pendle, Bittensor, RNDR. He grew Google Play into one of the largest developer ecosystems on the planet - now working with us to scale SERV Reasoning across large enterprises.

Greg Ivanov joins SERV as key advisor. ex-Head of Partnerships at Google, GP at 227 - early backers of Pendle, Bittensor, RNDR. He grew Google Play into one of the largest developer ecosystems on the planet - now working with us to scale SERV Reasoning across large enterprises.

$SERV 벤치자료에서 중요하게 봐야할껀 -압도적으로 저렴한 비용 -정확도 nano 83.3, 3_layer 98.1 -api 실패 0, false allow 0 -ThoughtProof(검증 전문 기업)의 PLV (Plan-Level Verification) 정확도에서 3 layer라는 nano가 필터링하고 불확실할 경우 좀더 심화된 모델로 넘어가서 검증을 한듯 한데 무슨 모델인진 안나왔지만 정확도가 미쳤다 98.1% 이미 기존 AI들에서 99%도 있는 마당에 뭐가 대수인가 하겠지만 여기서 가장 중요한 포인트가 나온다 바로 벤치를 돌린 프로젝트가 뭔지이다 -ThoughtProof 에서 시행한 PLV AI 에이전트가 실제 은행·의료·블록체인 정산 같은 고위험 환경에서 배포되려면 검증(verification)이 필수인데, SERV Reasoning이 신뢰성·안정성이 압도적이라는 의미 특히 false ALLOW가 0이라는 점과 API 실패가 전혀 없다는 점은 기업의 입장에서 서비스의 질이고 경쟁력이라 상당히 중요한 부분 단순한 질문과 답변에 대한 AI 정확도 개념으로 접근하면 @openserv 에서 왜 120개 밖에 안되는 샘플인 이 벤치를 내놨는지 이해가 안갈수 밖에 없다 실 산업에서 규제와 컴플라이언스 환경 이라는 복잡한 영역을 위해 PLV (Plan-Level Verification)라는 AI가 실전에서 사람·돈·법을 위험에 빠뜨리지 않을지 테스트하는 엄격하고 현실적인 검증이라는걸 상당히 강조해서 봐야할 부분이라는 의견이다