陈成

1.6K posts

陈成

@chenchengpro

engineering @antgroup, created umijs, dvajs, mako and neovate code, now working on helm.

浙江, 中华人民共和国 Katılım Haziran 2008

682 Takip Edilen9.9K Takipçiler

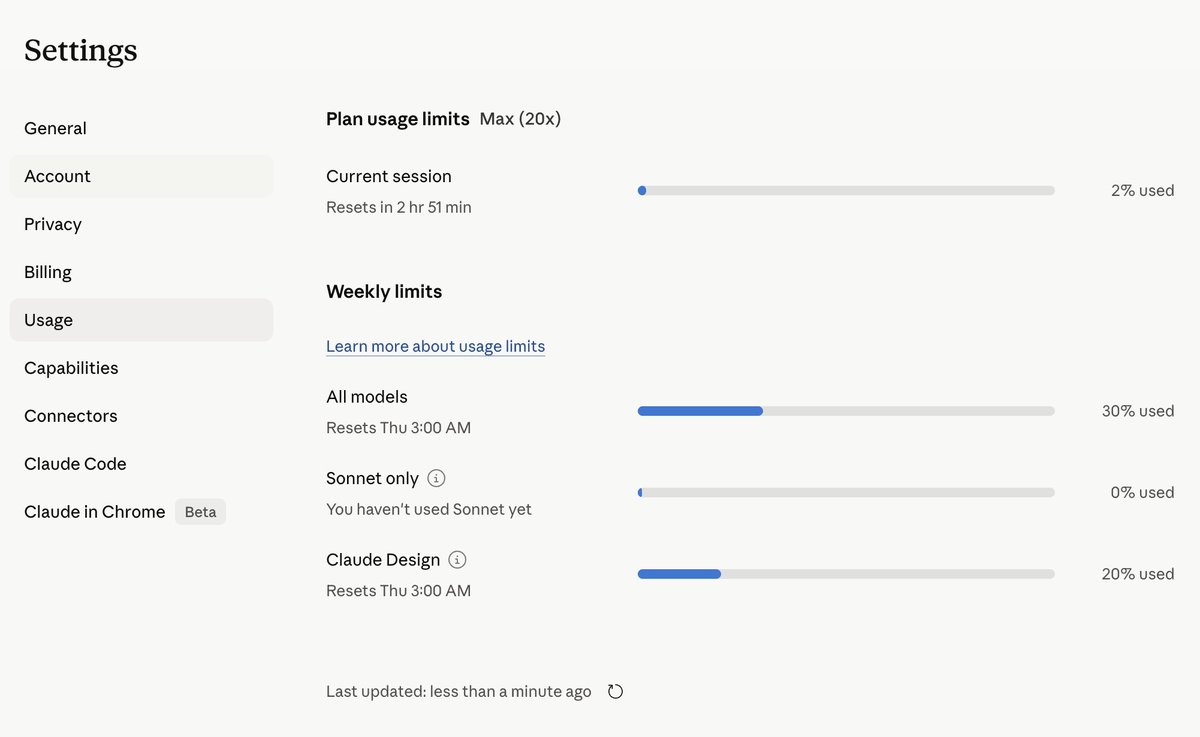

Anthropic 又调订阅策略了。这次盯上的是程序化调用。

6 月 15 日起,Claude Agent SDK、claude -p(命令行管道模式)、Claude Code GitHub Actions、以及所有基于 Agent SDK 的第三方工具(OpenClaw、Conductor、T3 Code 等),全部从订阅限额中剥离,改用独立的「程序化调用 credit」。额度按 API 价格折算,Pro $20/月、Max 5x $100/月、Max 20x $200/月、Team 标准席位 $20/人、高级席位 $100/人。不累积不滚存,用完要么开 extra usage 按 API 价续命,要么停到下个月。

不受影响的,终端和 IDE 里手敲的交互式 Claude Code、Claude Cowork、网页/桌面/手机端聊天,继续走原来的订阅限额。

这个 credit 看着像新福利,算一笔账就知道是怎么回事了,Pro 的 $20 按 Sonnet API 价($3/M 输入、$15/M 输出)大约够六七百万 token 输入或一百多万 token 输出,几轮密集的 agent 循环就见底。VentureBeat 报道过,单个 OpenClaw agent 跑一天能烧 $1000–$5000 的 API 成本。$20 的 credit 可能连一小时都撑不过。Max 20x 用户每月付 $200 订阅费,拿到的 SDK credit 也正好 $200,听起来「翻倍」了,但之前这些用户通过 SDK 实际跑出的 API 价值远超这个数。Matt Pocock 的评价拿了 1800+ 赞,"This is a 10X cut to claude -p disguised as a monthly bonus. It's time to try Codex."

回顾一下时间线就清楚了,2 月 Anthropic 明确禁止第三方工具接入 Claude 订阅;4 月 4 日正式切断 OpenClaw 等工具,理由是「这些工具绕过了 Prompt Cache 优化,对算力造成不成比例的压力」;5 月 6 日 5 小时窗口翻倍但周限额不动;5 月 13 日程序化调用被按美元封顶。每一刀都包装成好消息,但方向一致,收紧、收紧、再收紧。

我自己的看法,Anthropic 从头到尾要解决的就是一个问题,不让第三方拿着他的订阅额度去做 harness 和自动化。OpenClaw 们其实就是拿 $20–$200 的订阅价跑出了数千美元的 API 消耗,这个套利窗口 Anthropic 容忍了几个月,现在彻底关上了。4 月那波禁令太粗暴引起了反弹,所以 5 月换了个姿势,不禁了,给你一个 credit,但按 API 价格打表。名义上恢复了第三方接入,实际上补贴没了,第三方工具在订阅体系下就只能跑个 demo 级别的量。想跑生产?去 Developer Platform 买 API key,按量付费。Anthropic 帮助文档原话也挑明了,订阅套餐「不是为这个场景设计的」。

Anthropic 要的就是交互式 Claude Code 做留存钩子,agent 和自动化做利润中心。编码助手的补贴留住,自动化的补贴收回。6/8 发邮件领 credit,6/15 生效。

ClaudeDevs@ClaudeDevs

Starting June 15, paid Claude plans can claim a dedicated monthly credit for programmatic usage. The credit covers usage of: - Claude Agent SDK - claude -p - Claude Code GitHub Actions - Third-party apps built on the Agent SDK

中文

把 AI 当聊天窗口打开问完关掉,那叫干扰管理;把 AI 当常驻系统跑,才叫生产力。Khairallah 给了一份用 Claude Cowork 自动化一整天的具体 playbook,搭一次 1-2 天,长期每天省 1-3 小时。

一天切成三个 Cowork 任务,全部直接读写本地文件。

早 7 点自动跑 Morning Briefing:扫 Gmail/Calendar/Slack 三个 connector,邮件按四级紧急度分类(Tier 1 九点前回 / Tier 2 今日内 / Tier 3 本周 / Tier 4 仅信息),常规邮件起草回复、点出三封必须本人处理的,给当天每场会议写一份准备文档,最后合成单页 markdown 放桌面,5 分钟读完即知重点。

午间手动触发 Midday Production Block,扔进重活:文档处理(一堆 PDF/合同子代理并行抽取,20 个文档从小时压到分钟)、数据汇编(跨表合并出报告)、内容批量、加 Web Search 权限的研究汇编。和普通 Claude Chat 的本质差别就一句:它直接创建文档、更新表格、保存到正确路径,不是给你文本让你粘。

下午 5 点自动 End-of-Day Wrap-Up:回顾今天发出收到的邮件、开过的会、改过的文件、未完事项,跟早间简报交叉对照找出"早上说要做但没做完的",写进 carry forward 段落——明天早间简报会把这段当种子上下文读进去,跨天连续认知就这么形成。

复利来自每周五 15 分钟仪式回答三个问题:简报漏了什么我自己额外发现的(加进 prompt)、Cowork 输出了什么我又重做了(修模板)、这周新出现什么循环任务(建新模板)。

核心心智:Cowork 不是工具,是基础设施。多数人的一天还从查 45 分钟邮件开始,搭好系统的人开局就知道什么重要、什么已被处理。

Khairallah AL-Awady@eng_khairallah1

中文

TinyFish 出了个挺香的小工具:两条命令把 Claude Code 的 WebSearch / WebFetch 整体提速 3x+,评论区实测 1 分 52 秒降到 35 秒。

npm install -g @tiny-fish/cli@latest

tinyfish config-claude

跑完 config-claude 就把 Claude Code 原生 web 工具透明替换成 TinyFish 托管版(大概率走 MCP 注册或 hooks 拦截原生调用),不用改 prompt。Search 和 Fetch 在免费额度内不消耗 credits,只有 Agent 和 Browser 才计费。

提速不是黑魔法,是基础设施换了:Search API 在真实 stealth Chromium 里实时渲染搜索结果页返回结构化 JSON,能抓到传统缓存型搜索引擎拿不到的动态/最新内容(财报实时监控、新闻类查询特别明显);Fetch API 把任意 URL 服务端清洗成 markdown/JSON/HTML 直出,剥离广告导航脚本,模型不用再啃满是噪音的 HTML 也省 token;底层 Chromium 池常驻、亚 250ms 冷启动,请求直接打到 TinyFish 的 fleet 不再受 Anthropic 自带 web 工具的速率/排队限制。端到端体感快好几倍。

不止 Claude Code——还提供 MCP server 和 Skill 两种形态,可以接到 Cursor、OpenCode、openclaw、Hermes 等任何 MCP 兼容客户端。同一个 API key 同一个 credit 池打通 Search / Fetch / Agent / Browser 四件套,Agent API 在 Mind2Web 基准上声称 89.9% 准确率。

和 browser-use 这种"只给 agent + 浏览器"的方案相比,TinyFish 把搜索、抓取、agent、浏览器整套托管掉,使用者不用自己维护反爬、代理池、渲染基础设施。

注意几点:替换原生 WebSearch / WebFetch 意味着请求出口换成 TinyFish 服务器,敏感查询要评估隐私边界;3x 是官方表述,实际倍数取决于查询类型和目标站点渲染成本,最好自己跑一组对照。重度跑 web research 的人切一下试试,升级成本两条命令收益直接体现在每次 web 调用的等待时间。

TinyFish@Tiny_Fish

We just made Claude Code's web search and fetch at least 3x faster. Two commands and you can too! Swap your Claude Code's native search and fetch to TinyFish free search and fetch: npm install -g @tiny-fish/cli@latest tinyfish config-claude Watch below 👇

中文

David Sinclair 这期播客最颠覆的一点:衰老不是端粒缩短或自由基,而是表观遗传层面的信息丢失。DNA 是光盘,epigenome 是被刮花的读盘机器,细胞忘了自己该是谁,于是开始老化。

可执行的抗衰工具集,按 ROI 排序:

1)间歇性禁食。他本人 22/2 进食窗口,新手从 16/8 起步,3 周适应再推进。机制是同时压低胰岛素、激活自噬、抑制 mTOR。最便宜也最有效。

2)力量训练 + 冷暴露。轻度压力(hormesis)是长寿燃料,比一直舒服更抗衰。他不天天冰浴,但常年穿少一点睡凉一点。

3)补剂栈(仅他自己方案,不是处方):NMN 1g/天 + 白藜芦醇 1g/天,早晨空腹与橄榄油同服;二甲双胍早晨服,运动日跳过。逻辑是补 NAD、激活 sirtuins、模拟低能量。

4)盯三个指标:CRP(炎症)、铁蛋白(偏低更好,必要时献血)、生物年龄(用 InsideTracker 跟踪,目标逐年回拉)。

最关键的认知升级:衰老是可干预的疾病,不是必然规律。Sinclair 实验室已经用基因疗法让盲鼠复明,未来几年一颗"重置丸"做全身回调,人体试验先从治失明开始。

今天能做的最高 ROI 动作不是猛吃 NMN,而是把吃饭窗口先收到 16/8。

youtube.com/watch?v=n9Ixom…

YouTube

中文

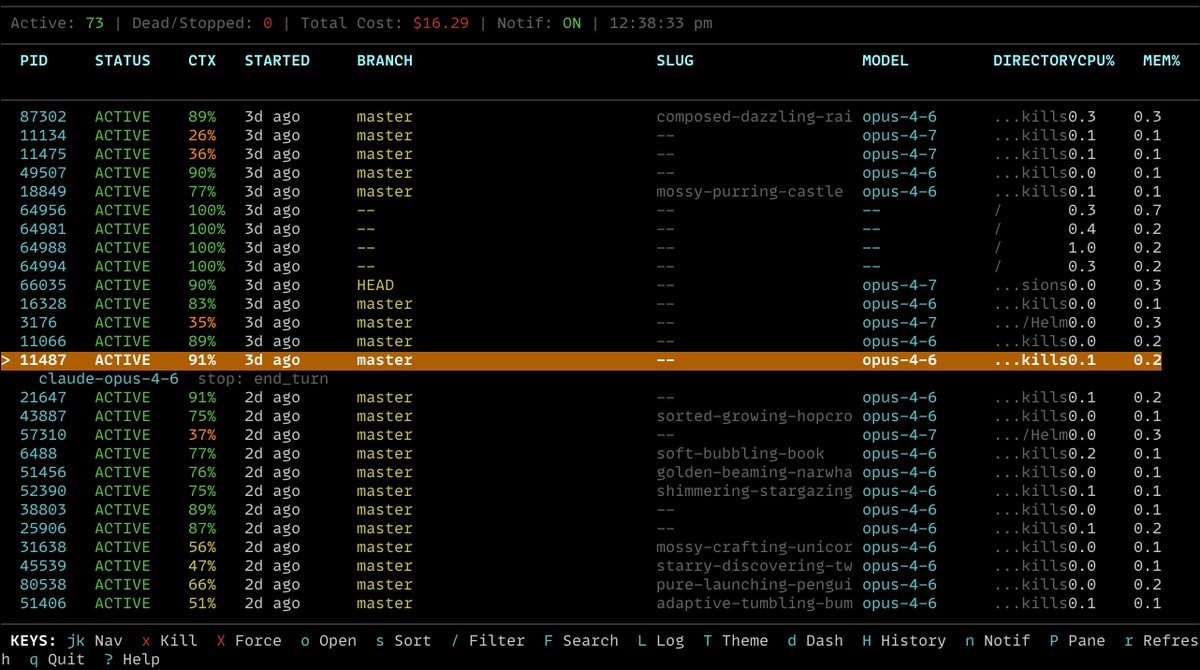

前面 claude code 作者说他的任务几乎都在手机上完成。我觉得是趋势。

我这两三天目前 400+ commits 了。上线并审核通过两个 jinshu 版本,一个小小作家版本审核通过。其实我做了什么:

第一天:起床开到长兴岛,8:15 和老罗开始到海边看鱼,骑行,喝咖啡,聊 agentic way,聊人生,回到家已经晚饭,散步半小时,睡了 12 小时。

第二天:吃饭,公园散步, 13:45 出门,接完儿子去训练,我再迪士尼骑行、逛公园、去小镇喝咖啡,训练到 18:00 左右去川沙吃饭,回来洗澡睡觉。

第三天:就是现在,早上送儿子去春游,回来补个觉,现在吃完午饭在公园散步,发 tweet。

几乎就是聊着聊着就全做出来的感觉。而人手一个全功能 “贴身 agent” 几乎是必然。

中文

Anthropic Claude Code 团队的 Thariq 公开承认自己几乎不用 Markdown 了——一个 HTML maximalist 的实践分享,理由比想象中硬。

观察一:超过 100 行的 Markdown 没人读,连他自己都读不下去;而 agent 现在动辄输出几百行 spec/计划/brainstorm,Markdown 这个曾经"简洁、便携、可编辑"的格式在新规模下三个核心优势全塌了——可读性塌方、可视化只能用 ASCII 画图甚至用 unicode 估算颜色、人也不再亲自编辑都是 prompt Claude 改。

为什么 HTML:表格、CSS 设计、SVG 插图、`