Daisuke OBA

66 posts

@dai0NLP

Postdoc at Science Tokyo / PhD from The University of Tokyo / NLP / LLMs / Safe-AI

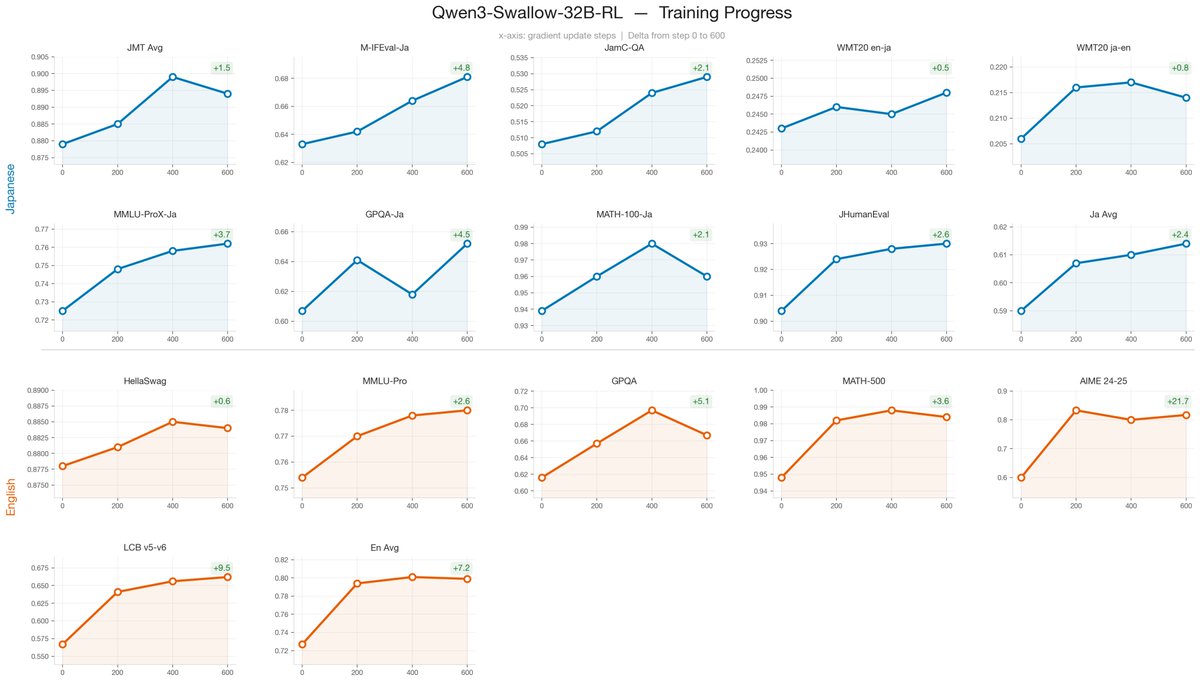

📢 GPT-OSS Swallow と Qwen3 Swallow をリリースしました。 継続事前学習+SFT+強化学習を全面刷新し、 日本語性能と推論能力を両立させたオープンなLLMを、 Apache 2.0ライセンスで利用できます。 Qwen3 Swallow: swallow-llm.github.io/qwen3-swallow.… GPT-OSS Swallow: swallow-llm.github.io/gptoss-swallow…

📢 GPT-OSS Swallow と Qwen3 Swallow をリリースしました。 継続事前学習+SFT+強化学習を全面刷新し、 日本語性能と推論能力を両立させたオープンなLLMを、 Apache 2.0ライセンスで利用できます。 Qwen3 Swallow: swallow-llm.github.io/qwen3-swallow.… GPT-OSS Swallow: swallow-llm.github.io/gptoss-swallow…

We’re releasing SwallowCode-v2 & SwallowMath-v2 — two high-quality, Apache-2.0 licensed datasets for mid-stage pretraining. huggingface.co/datasets/tokyo… huggingface.co/datasets/tokyo… Details in the thread 🧵

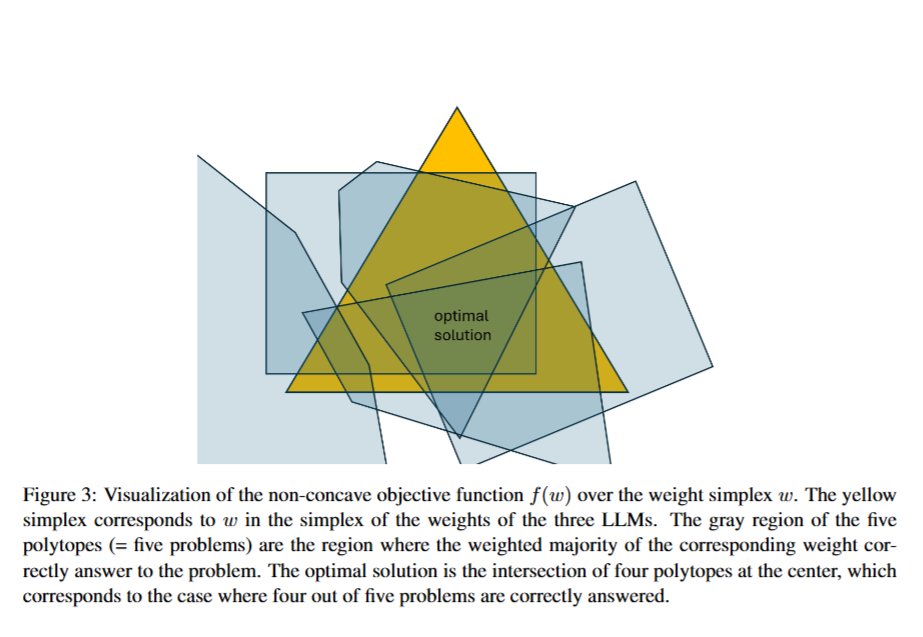

久しぶりに自分の論文を宣伝します。初のLLM論文です。 「Best-of-∞: Asymptotic Performance of Test-Time Compute」では、LLM における 多数決回答選択 (Best-of-N) を解答生成数N→∞の極限で考え、さらに有限計算予算下でも同等性能を目指す適応生成アルゴリズムを提案しています (1/3)

🌱特別企画セッション🌱 #YANS2025 では20回開催を記念して特別企画セッションを行います! テーマ 「これからの自然言語処理研究・技術の進化」 【登壇者(敬称略)】 石渡祥之佑(Mantra) 磯沼大(NII/東北大) 小林悟郎(PFN) 高瀬翔(サイバーエージェント) 徳久良子(愛工大/理研)

Llama 3.1 Swallow 8B v0.5を公開しました。Llama 3.3 Swallow 70BやGemma-2-Llama Swallowのレシピをさらに改良し、性能を向上させました。学習環境としてAWSのSageMaker HyperPod (H200) を利用しました。人気の8Bモデルの改良版を是非お試しください。 swallow-llm.github.io/llama3.1-swall…

Llama 3.1 Swallow 8B v0.5を公開しました。Llama 3.3 Swallow 70BやGemma-2-Llama Swallowのレシピをさらに改良し、性能を向上させました。学習環境としてAWSのSageMaker HyperPod (H200) を利用しました。人気の8Bモデルの改良版を是非お試しください。 swallow-llm.github.io/llama3.1-swall…