Sabitlenmiş Tweet

外行看热闹、内行看门道。

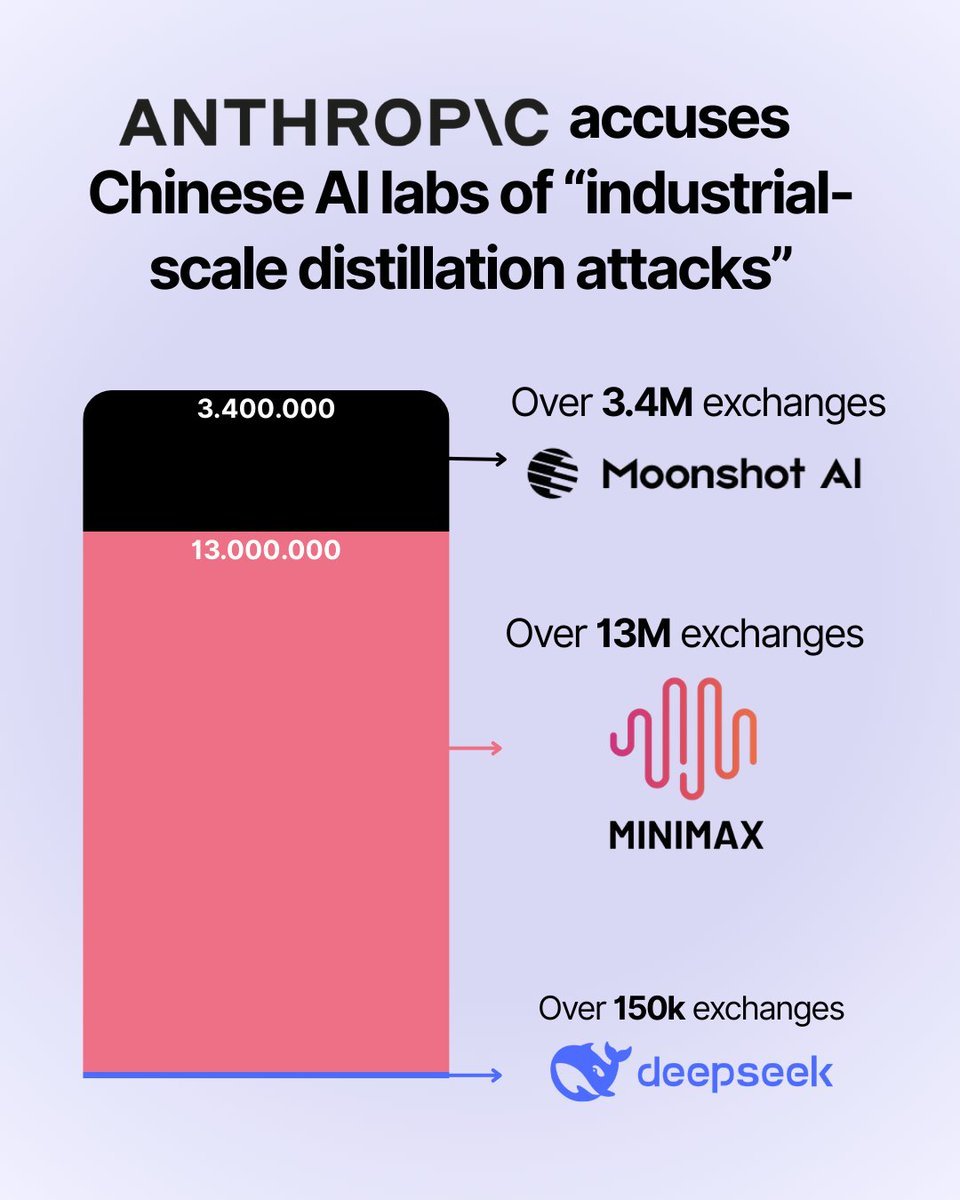

Anthropic 最新说国内的厂商都蒸馏攻击它,评论区都在喷 Anthropic 本身,马斯克也喷 Anthropic 的数据本身来自于人类代码,不过我其实并不关心这个谁对谁错。

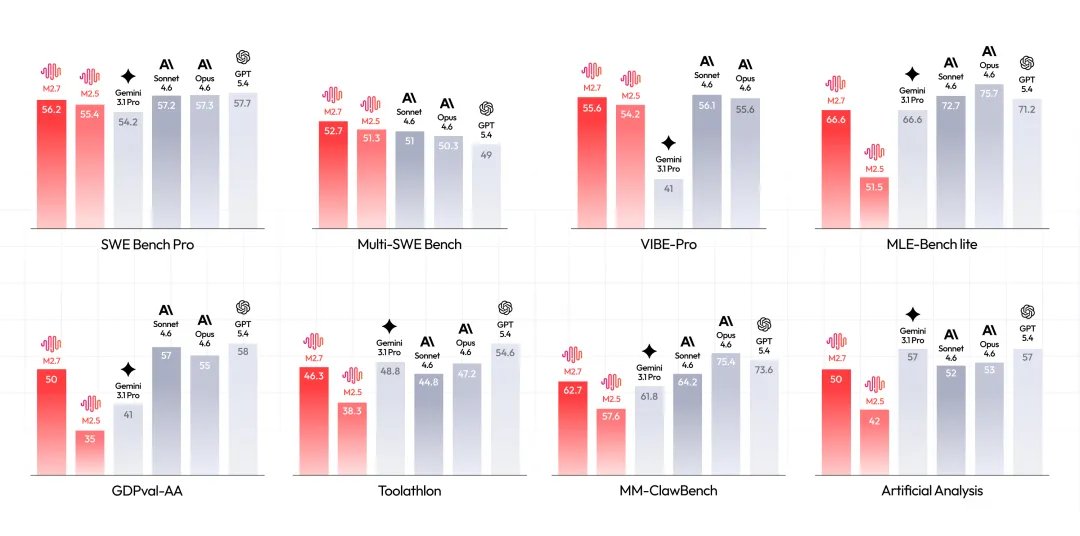

我们应该反向思考一下,谁蒸馏的最多,谁的平替效果应该更好。怪不得我试了一下 MiniMax M2.5,无论是在 cc 还是 openclaw 里,都感觉很像 Opus,它是官方认定的蒸馏最多的厂商,1300万次。

所以,如果你现在问我,应该买什么国产模型用来 Coding 或者玩 OpenClaw,那我推荐 MiniMax M2.5,因为他蒸馏了这么多 Claude 的数据,他应该最强。

现在买 MiniMax Coding Plan,用我这个邀请链接能享9折优惠:

platform.minimaxi.com/subscribe/codi…

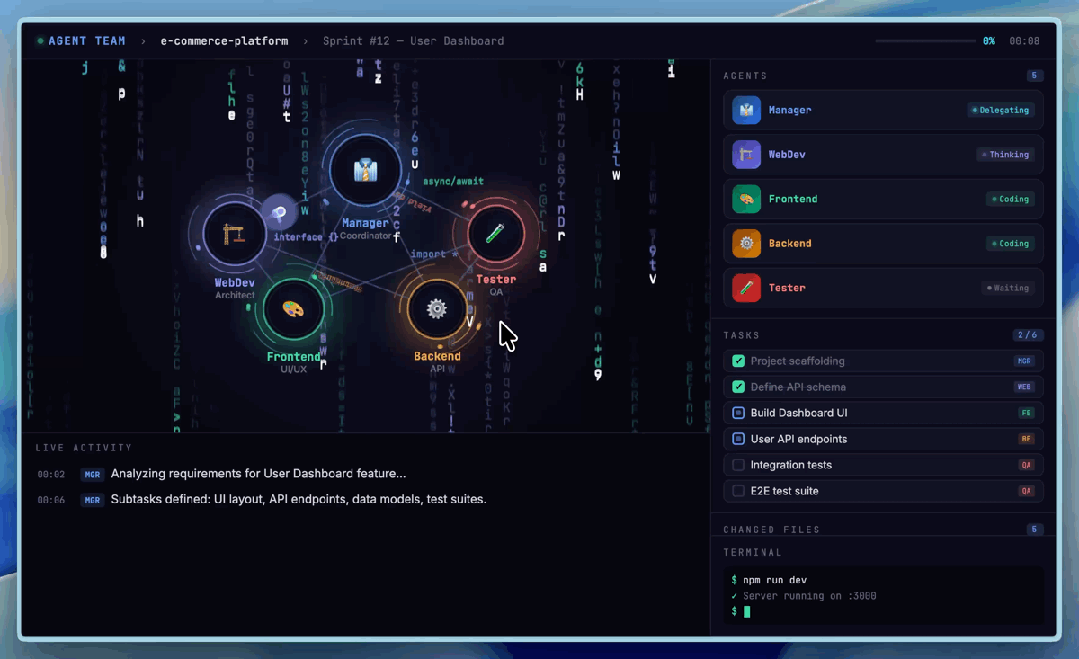

普通版的 M2.5 其实就已经很不错了。如果经济上有能力的话,推荐上极速版,我试了一下 OpenClaw 的回复速度在极速版的情况下,可以做到秒回。极速版就是加了一个2倍价格、速度更快的 MiniMax-M2.5-highspeed 模型,这个 OpenClaw 最新还不咋支持的好,可以参考我这个,手动这样配置一下:

"minimax-portal": {

"baseUrl": "api.minimaxi.com/anthropic",

"apiKey": "minimax-oauth",

"api": "anthropic-messages",

"models": [

{

"id": "MiniMax-M2.5-highspeed",

"name": "MiniMax M2.5-highspeed",

"reasoning": true,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 200000,

"maxTokens": 8192

},

------

"agents": {

"defaults": {

"model": {

"primary": "minimax-portal/MiniMax-M2.5-highspeed",

"fallbacks": []

},

"models": {

"openai-codex/gpt-5.3-codex": {

"alias": "GPT"

},

"anthropic/claude-opus-4-6": {

"alias": "OPUS"

},

"zai/glm-5": {

"alias": "GLM"

},

"minimax-portal/MiniMax-M2.5": {

"alias": "M2.5"

},

"minimax-portal/MiniMax-M2.5-highspeed": {

"alias": "M2.5-h"

}

},

----

中文