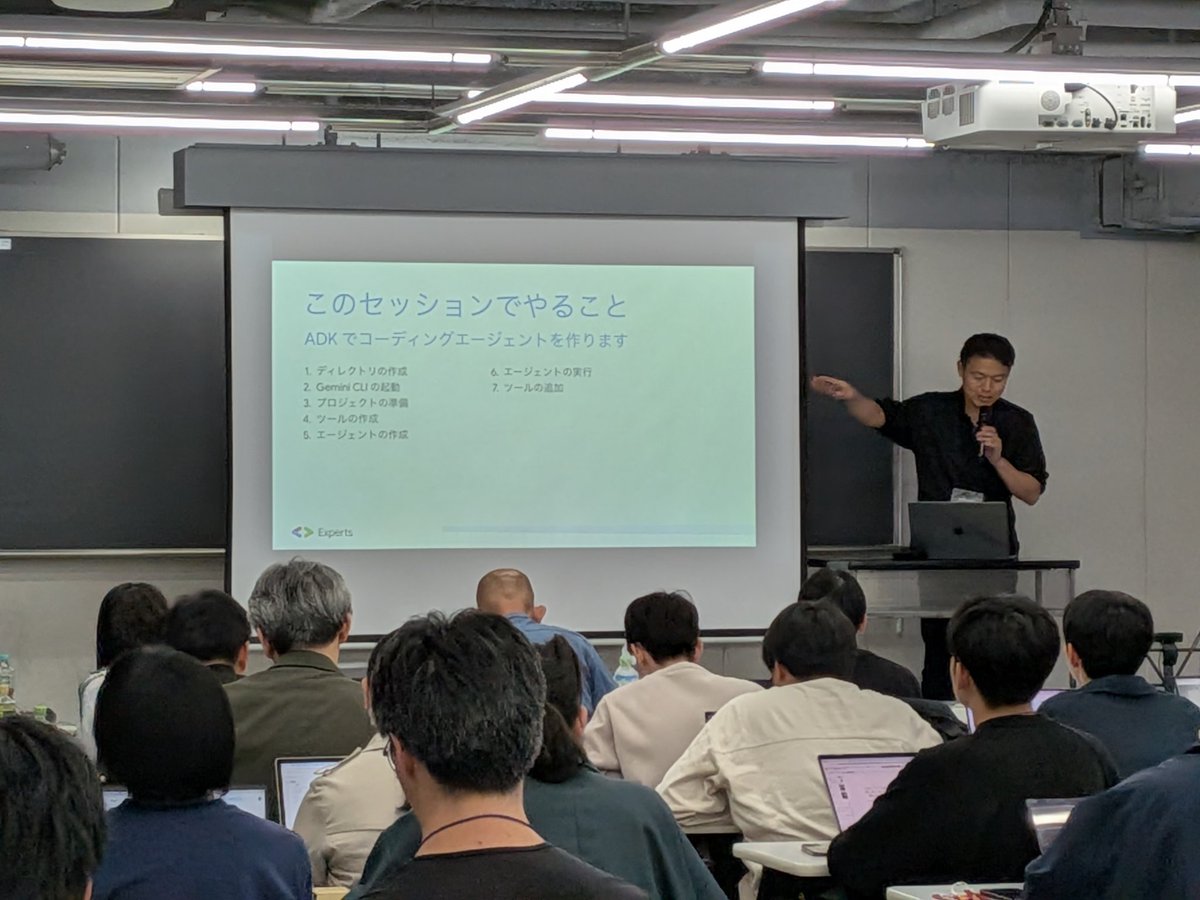

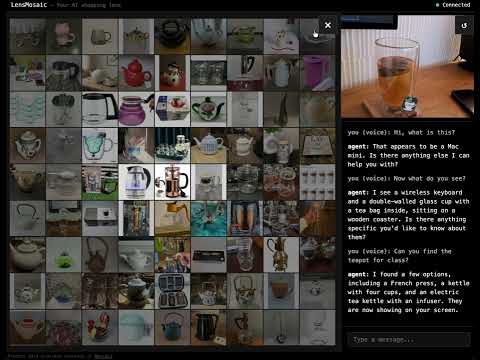

ベクトル検索の界隈をLLM以前から見ていると、起きてることはすごく単純。これまでの流れ:LLMすげえ→これからはベクトル検索だ!(根拠なし)→単純な類似検索やってみた→精度でねえ!面倒だからエージェントの推論任せでgrepしよう(←いまここ)。 俺が2年前に書いたような議論(単純な類似検索では検索品質低いし、IRのプロはみんな自前の推薦モデルを使う)は、RAG界隈では今だにほとんど見かけない。推薦モデル作る方法を今から学ぶより、"agentic"に済ませたほうが速いし結果がすぐ出るから。もちろんそれで済むデータ規模とレイテンシとコスト要件なら、最初からベクトル検索はいらない。 こういうLLM界隈の右往左往とは関係なく、大手各社は10年前も現在も何も惑わされずにベクトル検索でコンテンツ検索と推薦を数十億人規模に提供し、高い検索品質と大きな収益を上げている。 cloud.google.com/blog/products/…