CopenDeCamp

41 posts

@BIG3_PEAK_ADAPT ローカルLLMを自分でホストできるならSuperpowersプラグインいれてCodexはSpecとPlanの記述だけさせる

実際のコーディング出力はローカルLLMにやらせる

とトークン出力を節約できます

Planの中に仕様を満たすコードがほとんど出力されてるからCodex単体でやると損

日本語

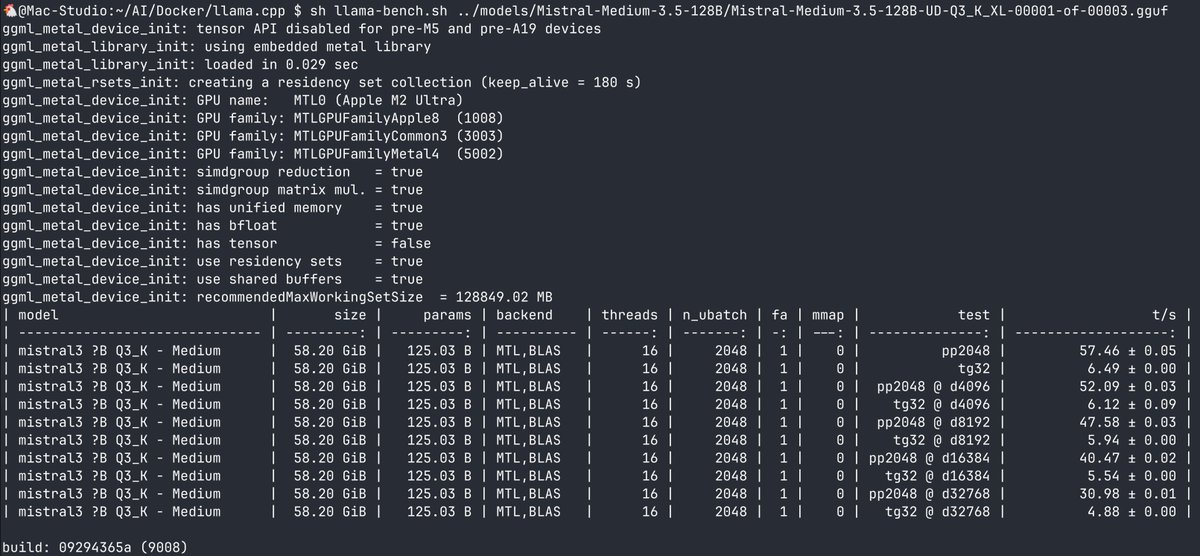

Mistral-Medium-3.5-128Bの推論速度をllama-benchで測定@ Mac Studio(M2 Ultra)

・prefill:〜57.5tps

・decode速度は〜6.5 tps

この時点でts-benchの評価をするには遅すぎるので断念

コンテキストサイズも128kはいけたが、200kだとOOMでハングしてしまった

やはり128B-denseモデルはローカルで動かすものではなさそう

金のニワトリ@gosrum

お!Mistral-Medium-3.5-128BのGGUFのウェイトがずっと消されてたけど、今見たらアップロードされている huggingface.co/unsloth/Mistra…

日本語

@gosrum AMD的にはCUDA資産に対抗するつもりはないように思える

ROCmをOSSにしたら有志が勝手にある程度やってくれるだろ?&GPUのIO叩く部分だけは非公開コードあるからLinuxで協力すんぜ

ってスタンスな気が

日本語

>ROCmのCUDA互換性やその開発速度が劇的に上がらなかった

これ本当にそのとおりで、AMDがこのチャンスを活かしてもっと頑張っていればここまで差が開かなかったと思う。成長性を感じさせてほしかった

posi_posi@posi_posi8

EVO-X2は、GPT-OSSが公開された当初は、画期的なデバイスだったと思う。 同等のモデルを動かすためにRTX Pro6000Blackwellや、Mac Studioが必要であり、それがローカルで25万円で購入できる唯一の選択肢だった。 ただ個人的に唯一誤算だったのは、生成AI恩恵も受けたのに、ROCmのCUDA互換性やその開発速度が劇的に上がらなかったこと。

日本語

CPU、GPU性能向上はわずかで大きな変更点はメモリを192GBにできるようになったことか

EVO-X2買ったは良いのだが、AI性能はNVIDIA GPUやMacに劣るのでローカルAI用途としては使っていない。そういう意味でメモリ増やしても使いみちあるのかな?200BのLLMがローカルで動いた!(2tpsで)とかになりそう

ギャズログ | Gaz:Log@gazlog_blog

Ryzen AI Max+ 495のベンチマークが登場 CPU性能はMax+ 395から10%増もGPU性能は同等 一方でメモリの最大サポート容量は128GBから192GBへ大幅拡大 AI向け用途を想定 gazlog.jp/entry/ryzen-ai…

日本語

EVO-X2は、GPT-OSSが公開された当初は、画期的なデバイスだったと思う。

同等のモデルを動かすためにRTX Pro6000Blackwellや、Mac Studioが必要であり、それがローカルで25万円で購入できる唯一の選択肢だった。

ただ個人的に唯一誤算だったのは、生成AI恩恵も受けたのに、ROCmのCUDA互換性やその開発速度が劇的に上がらなかったこと。

金のニワトリ@gosrum

CPU、GPU性能向上はわずかで大きな変更点はメモリを192GBにできるようになったことか EVO-X2買ったは良いのだが、AI性能はNVIDIA GPUやMacに劣るのでローカルAI用途としては使っていない。そういう意味でメモリ増やしても使いみちあるのかな?200BのLLMがローカルで動いた!(2tpsで)とかになりそう

日本語

@LottoLabs 投機しない推論の場合、Qwen3.6 27Bでも、

今現在新品で買えるコンシューマーGPUという選択肢だと、5090ぐらいしか実用的なtps超えられないから厳しくないかな?そりゃDenseが賢いのは分かるけど

日本語

@shirasu_sann @whitesikarud 実はそんな変わらんです

最新OSSだとハードウェアを使いこなせてないだけってことが結構判明してきてます

まあ雑にやっても早いのは3090ですけどね

日本語

@lvlinf @whitesikarud メモリ帯域幅が640gb/sでrtx3090の2/3程度なので、

メモリ速度に準速になりがちな、LLM推論においては、やはり3090に軍杯が上がりますね….

日本語

@leftcurvedev_ CMOEでもCPUがそこそこいいのだったら23tpsは出せるよん

RyzenAIMax+でCMOEしたら32スレッドが頑張ってMoEルーティングしてくれてそれぐらいだった

日本語

Two friends asked for help with their setups

One with an RTX 3070 Ti (8GB)

One with an RTX 5070 (12GB)

A lot of people are stuck in this annoying 8-12GB VRAM range. If you want full GPU offload, the only real option is Qwen3.5 9B… but let’s be honest, I can’t do that to my bros.

So we’ll be trying to squeeze Qwen3.6 35B A3B with CPU offload on both cards + playing with the --ncmoe llama.cpp flag. Will also test other forks to push performance as much as possible. Curious to see what we can do with an RTX 3070 Ti

I’ll report back the numbers with the server flags 👍

English

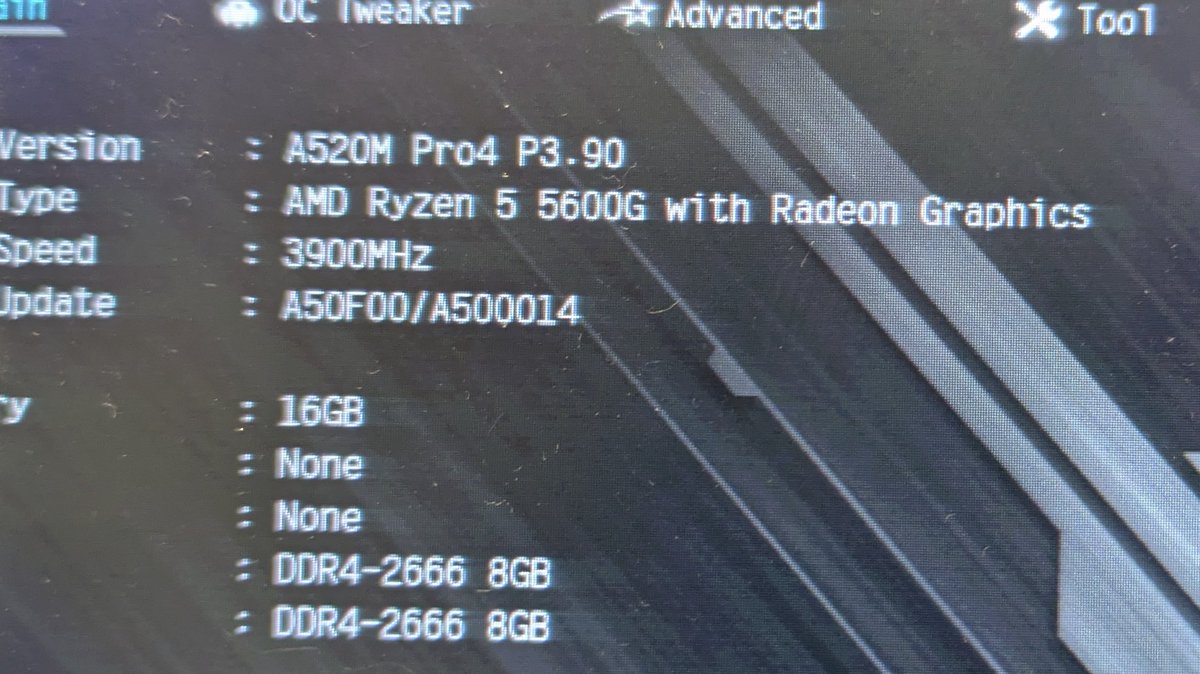

@ren_bocchi3 なんかメモリスロットの片側だけに挿してない?

ASRockだと思うけど確かデュアルチャンネルだとNone8GNone8Gになってたような...

日本語

@mmkikeru @lvlinf @hikaruganji 西日本には関関同立を上回る私立の総合大学が無いので「その地域での上位◯校」という視点なら「関西の早慶上智」とも言える

レベルではMARCHあたりでしょうが

日本語

今の平均的な陰キャ大学生のSNS事情

・Discord→必須

・Twitter→6割くらいやってる。無くても耐え

・LINE→必須だがディスコで事足りる。親しい人以外はあまり交換しない

・Instagram→垢持ってるだけで投稿してない。推しを見るために使ってる人多数

・BeReal→やってる奴ガチで存在するの??

ぶる🐰@61ve_kkmn

今の平均的な大学生のSNS事情 ・Instagram→必須 ・BeReal→6割くらいやってる。無くても耐え ・LINE→必須だがインスタで事足りる。親しい人以外はあまり交換しない ・Twitter→# 春から○○大とかでしか使わない。推しを見るために使ってる人多数 ・TikTok→殆ど入れてる。よく見てる

日本語

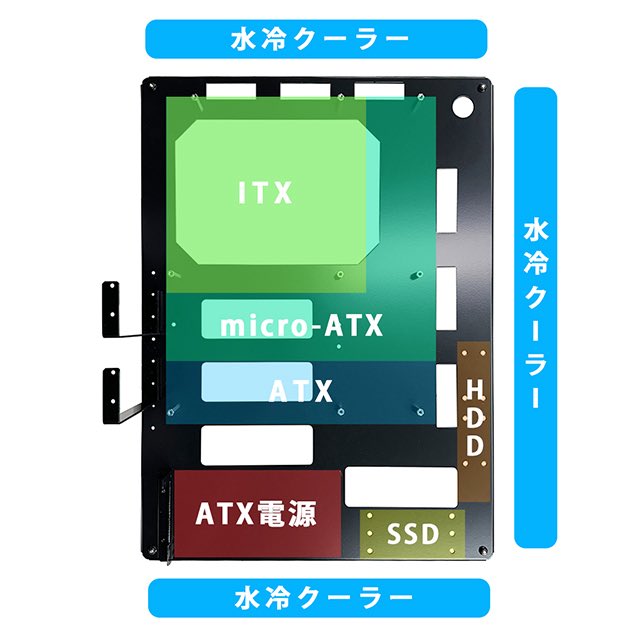

☆新商品発表☆

PC検証用ボード MANAITA【直販限定】

amzn.asia/d/0gktm12p

様々なPCパーツを交換しながら試すことができるシンプルな

まな板型の検証台です。

【平置き/縦置き】の設置が選べます!

日本語

@pupposandro ついにプレフィルまで投機的になったか

でもこれ両方必要な技術だよね

ローカルLLMは、せめてミドルハイ9070や5070でまともに動かないと...

日本語