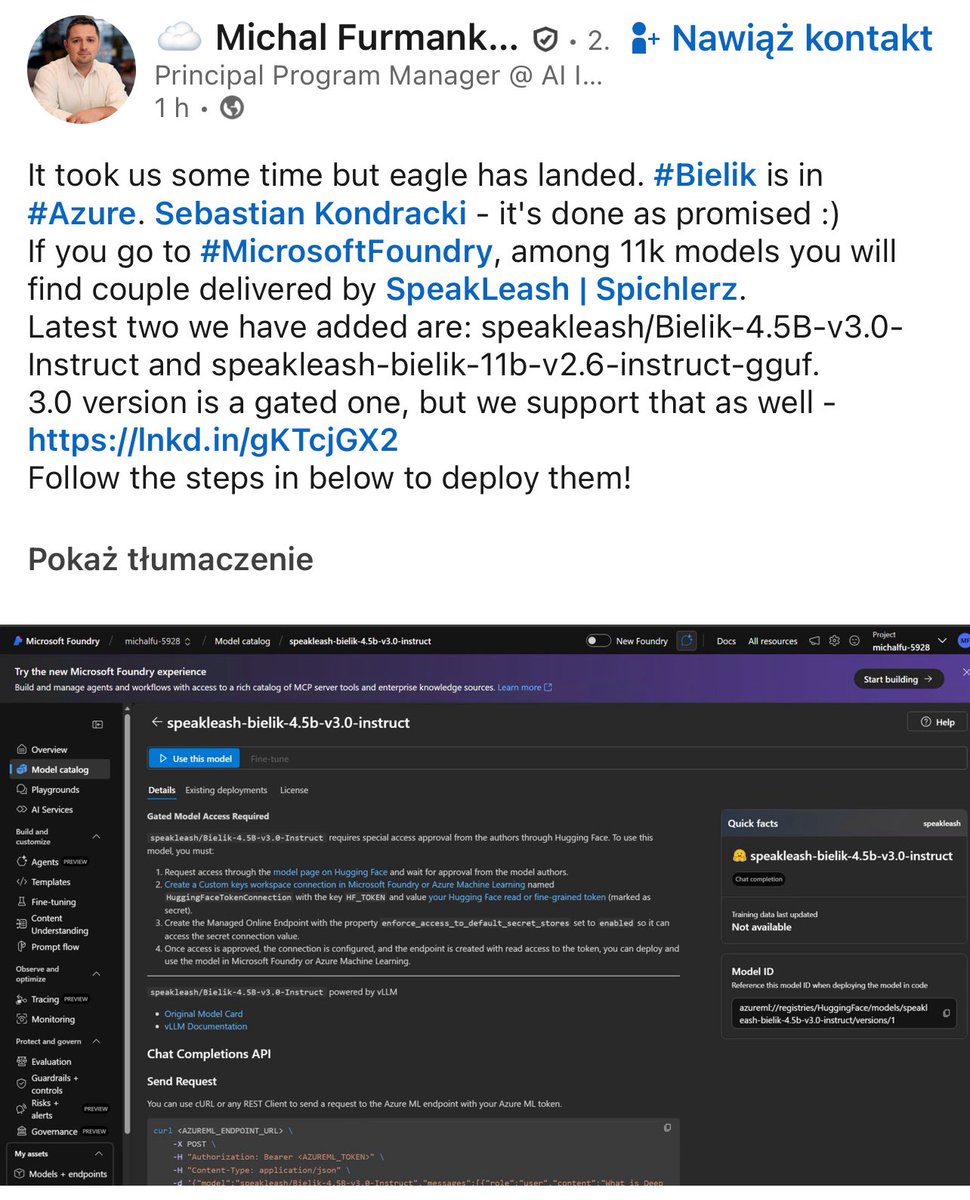

Michal Furmankiewicz (mifurm) retweetledi

Czy LLMy zapamiętują dane treningowe? Okazuje się że tak! Najnowsze badania pokazują że Claude może odtworzyć całego Harrego Pottera z 96% skutecznością!

Dlaczego to ma takie znaczenie? Przede wszystkim rzuca to nowe światło na trwającą debatę o prawie autorskim i bezpieczeństwie danych.

W publikacji zatytułowanej „Extracting books from production language models”, udostępnionej zaledwie 3 dni temu, autorzy pokazali, że modele takie jak Claude 3.7 Sonnet, GPT-4.1, Gemini 2.5 Pro oraz Grok 3, wciąż przechowują w swoich wagach ogromne ilości chronionych tekstów. Fakt, że model potrafi wygenerować niemal kompletną książkę, podważa argumentację wielu firm technologicznych, jakoby sztuczna inteligencja uczyła się jedynie abstrakcyjnych koncepcji, a nie kopiowała konkretne dane.

Polski