Supersocks@iamsupersocks

Depuis que je partage sur l'IA locale, une question revient en boucle : pourquoi le local plutôt que le cloud ?

Il y a quelques jours je posais le cadrage : les gros modèles frontier comme Claude Opus restent les meilleurs pour le raisonnement complexe et pour tous les usages. Mais l'agent local joue un autre match.

Le gros modèle écrit les instructions, le petit les exécute. Comme un développeur senior qui délègue à un junior.

Et j'ajoutais : regardez qui alimente cet écosystème. Les labos chinois privés. Ils n'ont pas accès au marché cloud américain, alors ils publient tout en open source. L'innovation par le bas.

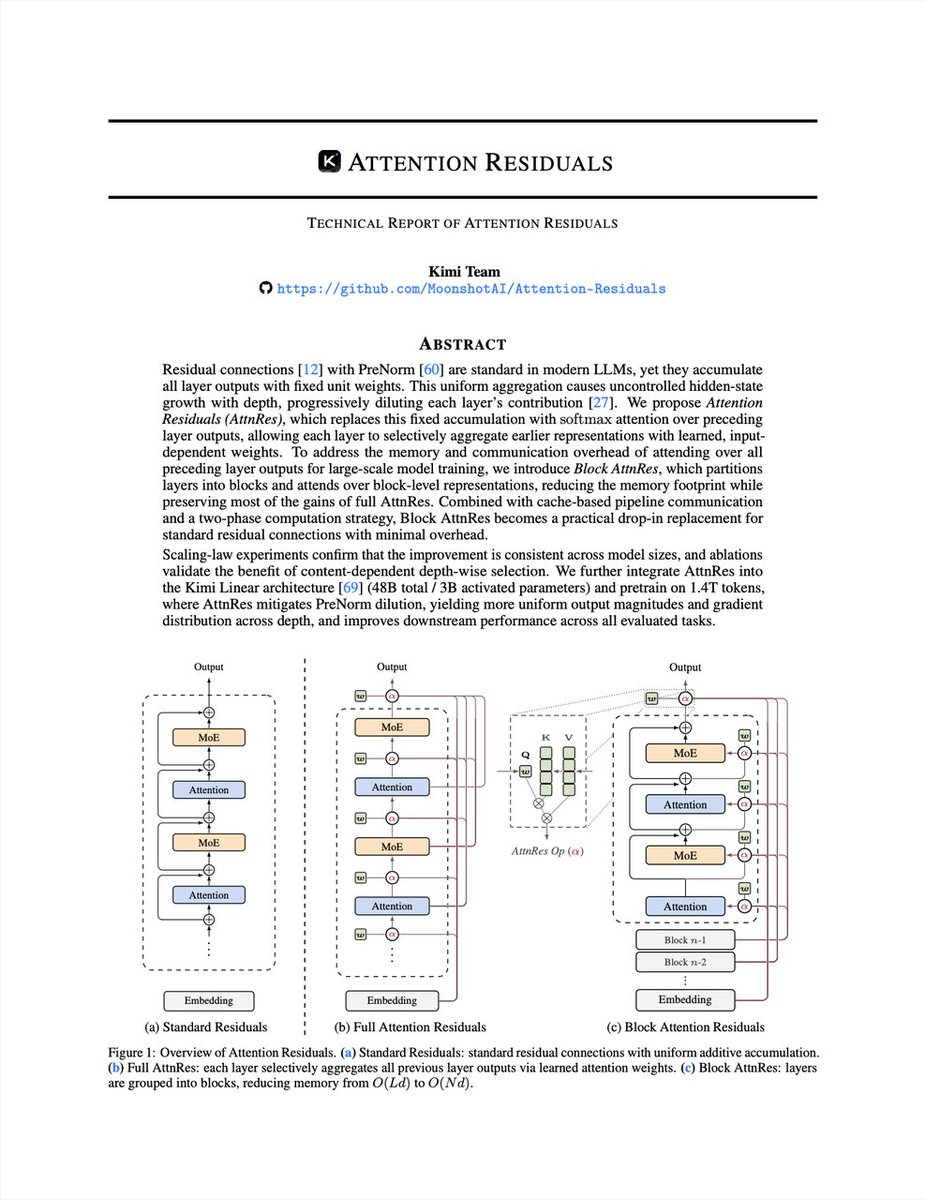

Moonshot AI (l'équipe derrière Kimi) vient de publier exactement ce genre de brique fondamentale (6h plus tôt).

Ça s'appelle Attention Residuals. C'est une amélioration de l'architecture même des modèles d'IA. Et c'est élégant. Décryptage.

Mais d'abord, pour comprendre pourquoi c'est important, il faut comprendre comment fonctionne un modèle de langage. Je vais essayer de rendre ça digeste: pour moi, pour vous.

Comment fonctionne un modèle de langage:

La base.

Tous les grands modèles actuels (GPT, Claude, Llama, Qwen, Kimi) reposent sur la même architecture : le Transformer. Inventé par Google en 2017, c'est devenu le standard universel.

Avant ça, on utilisait des réseaux récurrents (RNN). Imaginez un lecteur qui lit un livre mot par mot et essaie de se souvenir de tout dans un seul post-it. Au bout de 500 pages, les premières phrases sont oubliées. Et comme il lit dans l'ordre, impossible d'accélérer la lecture.

Le Transformer a changé la donne avec un mécanisme appelé "attention." Au lieu de lire mot par mot, le modèle regarde l'ensemble du texte d'un coup et décide quels mots sont importants pour comprendre chaque autre mot. C'est comme si au lieu de lire un livre page par page, vous aviez tous les mots étalés sur une table et pouviez tracer des lignes entre ceux qui ont un lien.

Comment ça marche : pour chaque mot, le modèle calcule trois choses.

1/Une question -> "qu'est-ce que je cherche comme contexte ?"

2/ une étiquette -> "voilà ce que je propose comme contexte"

3/ une information ("voilà ce que je porte comme contenu").

Le modèle compare chaque question à toutes les étiquettes, identifie les meilleures correspondances, et récupère les informations associées. Résultat : chaque mot obtient une représentation enrichie par le contexte de tout le texte.

Un Transformer empile des dizaines de couches de traitement. Chaque couche fait deux choses dans l'ordre :

1/ Un bloc d'attention : qui mélange l'information entre les mots. C'est la compréhension du contexte.

2/ Un bloc de calcul dense (appelé MLP) : qui transforme chaque mot indépendamment. C'est le "raisonnement" local, la digestion de l'information.

Entre chaque bloc, il y a un mécanisme simple mais crucial : la connexion résiduelle. On prend ce qui entre dans le bloc, on prend ce qui en sort, et on additionne les deux. C'est comme garder une copie de sauvegarde à chaque étape : si le bloc n'apporte rien d'utile, l'information d'origine passe quand même.

C'est ce mécanisme qui permet d'empiler beaucoup de couches sans que le signal se perde -> la colonne vertébrale de tous les modèles profonds depuis 2016.

Et c'est exactement ce mécanisme, vieux de presque 10 ans, que Moonshot vient de repenser.

Le problème caché des connexions résiduelles.

Ces connexions additionnent les sorties de chaque couche avec un poids fixe de 1. Toujours le même. À chaque couche, on empile tout avec le même coefficient.

Ça marche pour faire circuler les gradients (les signaux d'apprentissage). Mais ça crée un effet pervers.

Imaginez une conversation à 100 personnes où chacune parle au même volume. Au bout d'un moment, le bruit de fond est tel que la personne qui a parlé en premier est inaudible. C'est exactement ce qui se passe dans un réseau profond : la contribution des premières couches se noie dans l'accumulation de toutes les suivantes. C'est ce qu'on appelle le problème de dilution.

Conséquence : des chercheurs ont montré qu'on peut carrément supprimer des couches entières de certains modèles profonds sans perte significative. Ces couches ne contribuaient déjà plus vraiment au signal.

Et les couches profondes, pour se faire entendre dans ce brouhaha, doivent apprendre à "crier plus fort" -> produire des sorties de plus en plus grandes. Ce qui gaspille de la capacité et peut déstabiliser l'entraînement.

En résumé, trois problèmes concrets :

> Pas de tri sélectif. Toutes les couches reçoivent le même mélange, alors que certaines auraient besoin d'informations différentes.

> Perte irréversible. Une fois l'information mélangée dans le flux commun, impossible de la récupérer séparément plus tard.

> Course au volume. Les couches profondes compensent en produisant des signaux de plus en plus forts, ce qui fragilise le système.

L'analogie qui fait tout comprendre.

Et c'est là que l'idée de Moonshot est brillante.

-> Les réseaux récurrents (RNN) comprimaient toute une séquence de mots dans un seul vecteur, et ça posait problème. L'attention a résolu ça en permettant à chaque mot d'aller chercher directement dans tous les mots précédents.

Moonshot observe que les connexions résiduelles font exactement la même erreur mais sur un axe différent. Au lieu de comprimer une séquence de mots, elles compriment une séquence de couches dans un seul état. Même structure, même limitation.

L'attention a remplacé la compression séquentielle sur l'axe du temps (les mots).

Attention Residuals remplace la compression séquentielle sur l'axe de la profondeur (les couches).

Au lieu d'additionner aveuglément toutes les couches avec le même poids, AttnRes permet à chaque couche de choisir ce qui l'intéresse parmi toutes les couches précédentes, avec des poids appris qui dépendent du contenu.

Chaque couche dispose d'un petit vecteur appris (une sorte de "profil de recherche") qui lui sert à interroger les sorties des couches précédentes.

Les correspondances les plus pertinentes reçoivent un poids fort, les autres sont atténuées. Exactement comme l'attention fonctionne pour les mots, mais appliquée entre les couches du réseau

Et comme un réseau a typiquement quelques centaines de couches (contre des millions de mots pour une séquence longue), le coût de calcul de cette attention "en profondeur" est négligeable.

Ce que ça change concrètement.

Avant de nous faire part de ces résultats Moonshot a intégré AttnRes dans Kimi Linear, leur modèle à 48 milliards de paramètres au total dont 3 milliards activés par requête (c'est un modèle dit "à experts" -> seule une fraction du réseau s'active pour chaque tâche, ce qui le rend très efficace). Entraîné sur 1 400 milliards de mots.

Les résultats bougent sur trois axes :

1/ Le modèle apprend mieux. Sur les tests de mise à l'échelle (on entraîne des modèles de tailles croissantes et on mesure la progression), Block AttnRes (la version optimisée pour la production) atteint la même performance qu'un modèle classique entraîné avec 25% de puissance de calcul en plus. Autrement dit : pour le même budget de serveurs, le modèle est meilleur.

2/ Le signal reste propre. Dans le modèle classique, les couches profondes produisent des sorties 15 fois plus grosses que les premières: signe de la course au volume décrite plus haut. Avec AttnRes, les magnitudes restent bornées. Le système se régule. L'apprentissage se répartit mieux.

3/ Le modèle classique concentre les signaux d'apprentissage de façon disproportionnée dans les premières couches. AttnRes, grâce à la compétition entre sources (le mécanisme d'attention force les couches à se départager), distribue l'effort d'apprentissage de façon uniforme sur toute la profondeur.

Sur les tests de performance concrets (Kimi avec la vieille brique vs Kimi avec la nouvelle brique) :

> Raisonnement scientifique avancé (GPQA-Diamond, des questions niveau doctorat) : 36.9 → 44.4. C'est un bond de +7.5 points, énorme sur ce type de test. Mathématiques : 53.5 → 57.1.

> Génération de code (HumanEval) : 59.1 → 62.2.

> Connaissances générales (MMLU) : 73.5 → 74.6.

> Raisonnement logique (BBH) : 76.3 → 78.0.

Les gains les plus forts sont sur les tâches qui demandent de raisonner en plusieurs étapes logique, puisque c'est exactement là qu'un meilleur flux d'information entre couches fait la différence. Les couches profondes peuvent enfin aller chercher précisément ce dont elles ont besoin dans les couches intermédiaires, au lieu de recevoir une bouillie uniforme.

Comment ça tourne en pratique : Block AttnRes.

La version complète d'AttnRes (chaque couche regarde toutes les couches précédentes individuellement) est idéale en théorie mais pose un problème de mémoire à grande échelle : il faut stocker et transmettre les sorties de toutes les couches.

Block AttnRes résout ça de manière élégante. Les couches sont regroupées en blocs (environ 8 en pratique).

Dans chaque bloc, les sorties sont résumées en une seule représentation par addition classique. L'attention entre couches ne porte ensuite que sur ces 8 résumés, pas sur les centaines de couches individuelles.

-> C'est comme résumer un livre en 8 chapitres plutôt que de relire chaque phrase : vous perdez un peu de granularité, mais vous gardez l'essentiel, et c'est 8 choses à consulter au lieu de 128.

Le système de cache entre les étapes du calcul distribué élimine les transmissions redondantes. La stratégie de calcul en deux phases sépare ce qui peut être fait en parallèle (comparer les blocs entre eux) de ce qui doit être séquentiel (la progression à l'intérieur d'un bloc), puis fusionne les résultats proprement.

Résultat pratique : moins de 4% de surcoût à l'entraînement. Moins de 2% de latence supplémentaire quand le modèle répond. C'est un remplacement direct des connexions résiduelles classiques : on change juste cette brique, le reste de l'architecture ne bouge pas. Les seuls paramètres ajoutés : un petit vecteur par couche et une normalisation. Négligeable.

Moonshot vs DeepSeek : deux philosophies.

Impossible de parler d'AttnRes sans mentionner mHC de DeepSeek, publié en janvier. Les deux partent du même constat : les connexions résiduelles classiques sont un goulot d'étranglement. Mais les approches divergent.

DeepSeek (mHC) élargit le tuyau. Au lieu d'un seul flux résiduel, mHC en crée plusieurs en parallèle (typiquement 4) avec des règles mathématiques strictes pour que les signaux ne s'emballent pas en se mélangeant (des matrices dites "doublement stochastiques" en gros, le mélange conserve l'énergie totale, rien n'explose). Plus de bande passante informationnelle, avec des garde-fous de stabilité.

Moonshot (AttnRes) ne touche pas à la largeur du tuyau. Il donne à chaque couche une lorgnette pour aller chercher exactement ce dont elle a besoin dans les couches précédentes.

Élargir le tuyau vs donner des yeux. Deux philosophies.

Le papier de Moonshot unifie les deux dans un cadre mathématique commun et montre quelque chose d'intéressant : toutes les variantes existantes (résidus classiques, réseaux à portes, mHC de DeepSeek) font en réalité de l'attention "linéaire" sur l'axe de la profondeur -> une version simplifiée. AttnRes fait de l'attention complète (softmax). C'est exactement la même différence qui a fait passer les modèles de séquence des RNN aux Transformers.

Et sur l'efficacité : Block AttnRes obtient des performances comparables à mHC tout en consommant environ six fois moins de bande passante mémoire par couche. Parce qu'au lieu de maintenir 4 flux parallèles en permanence, il stocke juste 8 résumés de blocs et un petit vecteur par couche.

Les surprises des tests comparatifs.

Moonshot a testé plein de variantes pour comprendre ce qui marche et ce qui ne marche pas :

> Les poids fixes entre couches (comme dans DenseFormer, un travail antérieur) n'apportent rien. Zéro amélioration par rapport au système classique. C'est la capacité de s'adapter au contenu qui fait toute la différence.

> La fonction de normalisation compte. La version "compétitive" (softmax, où les poids somment à 1 ce qui force les couches à se départager) bat la version "indépendante" (sigmoid, où chaque poids est calculé isolément). Quand on alloue de l'attention, il faut un classement net, pas un "tout le monde a un peu."

> Découper l'attention par groupes de dimensions (comme on le fait pour l'attention sur les mots avec les "multi-têtes") dégrade les résultats sur l'axe de la profondeur. Quand une couche est pertinente, elle l'est en bloc, uniformément. Pas besoin de la découper en morceaux.

> Un vecteur de recherche qui dépend du contenu traité (au lieu d'un vecteur fixe appris) donne de meilleurs scores, mais le surcoût en calcul et la perte de parallélisme ne justifient pas le gain. Le vecteur fixe est le bon compromis.

Conséquence architecturale : avec AttnRes, les modèles optimaux sont plus profonds et plus étroits qu'avec des résidus classiques. AttnRes exploite mieux la profondeur : logique, puisque c'est exactement ce qu'il améliore.

Les poids appris par le modèle révèlent des choses intéressantes : chaque couche s'appuie surtout sur sa voisine immédiate (la localité reste le chemin principal), mais des "raccourcis" émergent naturellement vers des couches éloignées. Et le tout premier signal (l'encodage initial des mots) garde un poids significatif jusqu'aux dernières couches, surtout pour les blocs d'attention. Le réseau apprend tout seul à créer des ponts entre ses différents niveaux de traitement.

Pourquoi ça compte pour le local et l'open source.

Moonshot publie tout : le papier scientifique, le code, l'architecture. Comme DeepSeek. Comme Qwen (Alibaba).

Chaque brique d'architecture ouverte qui rend les modèles plus efficaces bénéficie directement à l'écosystème local. Un modèle qui exploite mieux sa profondeur, c'est un modèle qui fait plus avec moins de paramètres activés.

3 milliards de paramètres activés sur 48 milliards au total, avec AttnRes, qui bat le modèle classique sur tous les tests. C'est exactement le profil de modèle qui tourne sur une machine grand public avec une bonne compression des poids.

Les labos chinois n'ont pas accès au marché cloud américain. Alors ils publient les briques fondamentales que tout le monde peut utiliser. En Europe, le RGPD et le AI Act poussent les entreprises vers le traitement local des données. Les deux convergent.

C'est comme l'énergie : d'un côté le nucléaire centralisé, coût d'exploitation lourd mais pérenne à l'échelle. De l'autre le décentralisé qui répond à des cas précis, tout aussi compétitif dans sa niche.

Le cloud pour le raisonnement de pointe. Le local pour l'exécution spécialisée.

Et les briques comme Attention Residuals rendent le local de plus en plus compétitif, une publication à la fois.