arch rock

3.3K posts

看了五源资本合伙人孟醒最新的硅谷 AI 文章,好有意思: 硅谷共识是还要裁掉 80% 的人类? 马斯克的 xAI 为什么搞不成? 很多创业公司开始招 “AI builder” 的新角色? CEO 们都在“买比特币、建地堡、给家里装防弹玻璃”? “未来的情形可能是,10 个人干过去 100 个人的活,拿 20 份钱,然后 90 个人失业。” 当 AI 什么都能做的时候,人的价值正在从 “会做什么”,变成判断 “什么值得做、什么不该做” 的。 一些笔记: 1、整个 Meta 几万工程师,全员都在用 Claude Code,搞内部 token 消耗排行榜,末尾可能被裁员;Meta 裁员也最狠,已经裁了上万人,把人的成本换成了 token 成本,硅谷共识是科技公司应该需要裁掉 80% 的人 2、马斯克过去做 SpaceX、做特斯拉,本质上做的是系统工程:链路很长,涉及软件、硬件、供应链,每一块都有创新空间,但最终是一个端到端的工程问题。他擅长的是在这种长链条里,识别出关键杠杆点,然后极限压缩时间线来攻克。火箭发动机级联、复用着陆,都是这种思维的产物。xAI 的问题是没有全局规划,只有冲刺。 xAI 的一位 cofounder 去年就说有两件事他没想到:第一是竞争这么惨烈,第二是 AI 时代应用创新的机会这么少,都被模型吃掉了。 3、更激进一点想:今天所谓的 “AI native 组织”,听起来很 sexy——让每个部门梳理工作流、把能被 AI 介入的部分线上化、写成 skills。但本质上就是在人肉蒸馏自己:你把你的能力变成机器的 skill,公司拿到了你的 skill,实际上就已经完成 AI 化了,是否要由此裁员,那是一个道义的问题。今天 Meta 就是在干这件事。 4、整个硅谷都在盯着 Meta,如果它的实验成功了——营收没掉、效率真上去了,其他大厂会迅速跟进,裁员就从个案变成行业常态。而且裁员有一个残酷的自加速机制:一开始大家不敢裁,怕伤士气;一旦变成常态,就越裁越快、越裁越不心疼。 5、很多创业公司开始招一种叫 “AI builder” 的新角色——合并了产品经理、前端工程师、后端工程师于一身。还有一种是合并了数据科学家和机器学习工程师的复合岗,以及合并了写作、投放、运营的内容一体化操盘手。 6、这个看似分布式创新的世界,底层其实在极度中心化。这个中心就是英伟达。如果你今天能稳定地提供一个 API 服务,比如 Claude 的 API,做到 99 分位的稳定性,你可以卖官方 API 价格的两到三倍。 在 2028 年之前,没有任何一家 AI 公司能靠堆算力显著拉开差距。算力约束客观上在强化大模型市场的寡头格局——不是谁不努力,是物理世界的制造周期就是这么慢。背后的权力结构很清楚:谁有卡谁厉害,谁有卡由英伟达决定。今天上市的 CoreWeave、Lambda、Nebius,背后站的都是英伟达。 7、这次硅谷行,反复听到朋友们在认真讨论同一件事:买比特币、建地堡、给家里装防弹玻璃,他们都不是开玩笑的语气。为 CEO 提供住宅安防的企业,创下了 2003 年以来的最高增长水平。 全文: mp.weixin.qq.com/s/kwErGjX231e2…

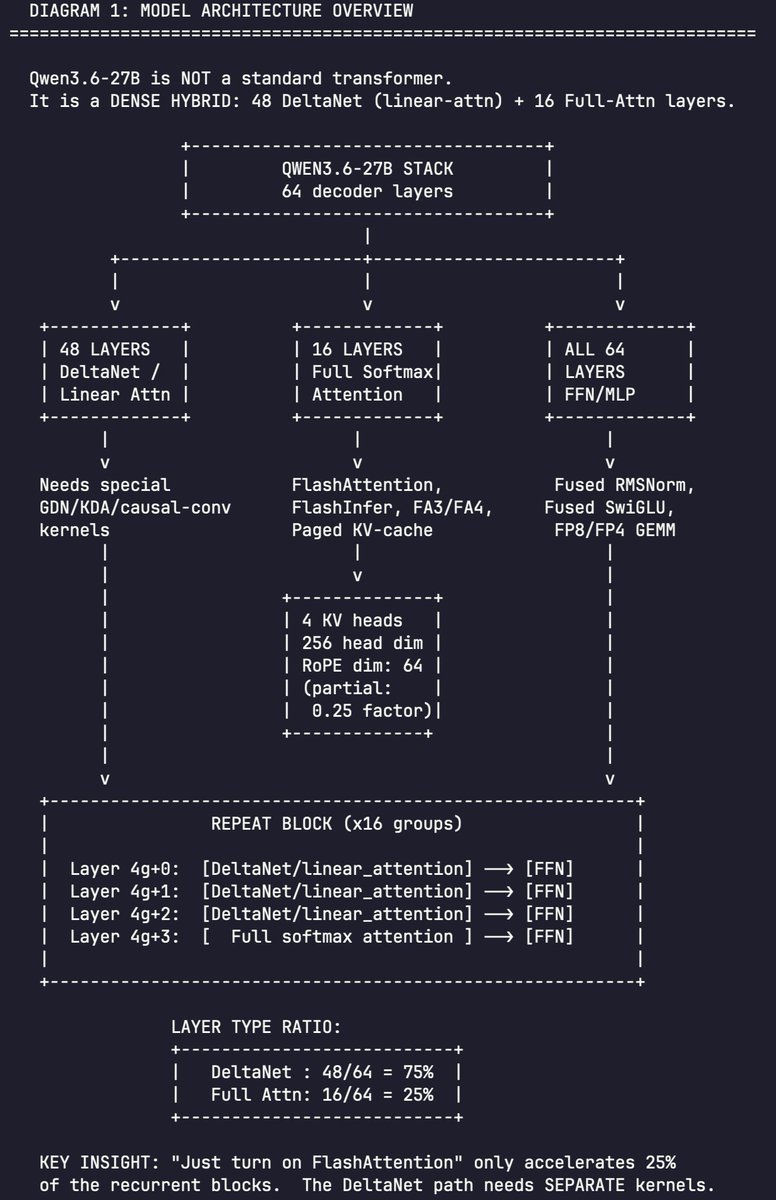

How to go about learning all of this? 1st: Start with the serving engine view - vLLM: PagedAttention, continuous batching, prefix caching, CUDA graphs - SGLang: RadixAttention/prefix reuse, speculative decoding, MoE, structured/agent workloads - TensorRT-LLM: NVIDIA peak stack, FP8/FP4, Wide-EP, disaggregated serving - FlashInfer: reusable kernel/operator library for attention/GEMM/MoE/sampling 2nd: Go down the stack - Triton tutorials → custom fused kernels - CUTLASS/CuTe → Tensor Core GEMM and Blackwell/Hopper details - FlashAttention papers → attention algorithm/kernel co-design - PagedAttention paper → KV-cache memory management - MoE docs → routing + grouped GEMM + all-to-all - Nsight profiling → stop guessing 3rd: Do this mini-project sequence 1. Implement RMSNorm in Triton; compare to PyTorch 2. Implement fused SiLU × gate 3. Implement simple FP16 matmul; compare to cuBLAS/rocBLAS 4. Implement paged KV lookup for decode attention 5. Add FP8 KV cache with per-block scales 6. Implement toy top-k sampling on GPU 7. Implement tiny MoE dispatch + grouped GEMM 8. Integrate one custom op into vLLM or SGLang and profile end-to-end

Kimi has dethroned DeepSeek

Now reading:

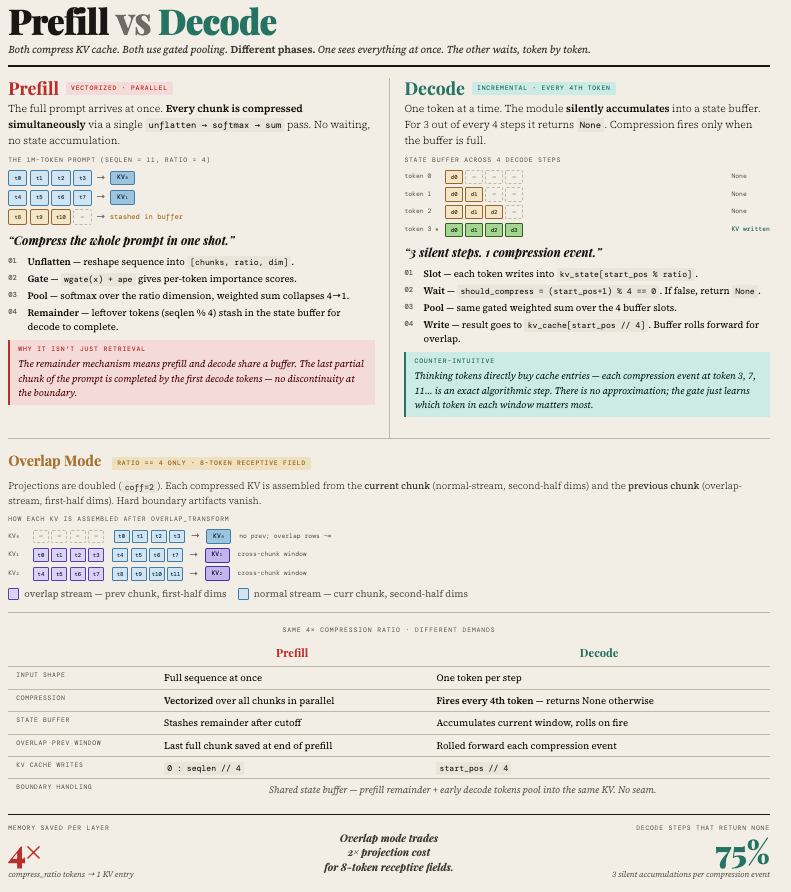

this is so amazing, CSA is a new attention arch close to deepseek NSA imo, but sequential instead of in parallel. NSA had this compression of KV, here it's the same, and then they do DSA, and sliding window to keep good local context (also in NSA)