szymonlukasik

48 posts

Sesja posterowa na konferencji ICLR 2026 … zrobimy coś takiego w Polsce? 🇵🇱 Piotr @piotrsankowski

Polski

@niedakhPL You really think gigachat is at gpt4 level? Have you seen some evaluations?

English

@KinasRemek Możecie/Mozemy się zgłosić na grant na LUMI. Problem jest w danych… Biliony (angielskie trilliony) czystych tokenów potrzebne…

Polski

@CKeruac Popieram, zresztą to nie nowy postulat - James Bezdek, 1994. Ale nie przejdzie w kulturze buzz word’ów

Polski

Zgadzam się z Horvitzem. Najwyższy czas przestać mówić o "Sztucznej Inteligencji", a zacząć o "Inteligencji obliczeniowej".

Słowo "sztuczna" nadało tym modelom aurę magii i sci-fi, przez co ludzie zaczęli w nich widzieć nowe formy życia.

Tymczasem "obliczeniowa" sprowadza rzecz na ziemię - do poziomu twardej matematyki i fizyki. To właśnie dlatego ludzie zawsze pozostaną na górze: bo maszyna może optymalizować obliczenia lepiej od nas, ale to nasz, ucieleśniony mózg nadaje im jakikolwiek cel.

Haider.@haider1

Microsoft Chief Scientific Officer Eric Horvitz: The term artificial intelligence is wrong; it should be computational intelligence because it applies to both biological and machine systems. Humans will stay on top, guiding with our values and goals, even as machines shape us

Polski

W @MNiSW_GOV__PL analizujemy, sprawdzamy, robimy symulacje. Raz jeszcze sprawdziliśmy uwagi do rozporządzenia, przeanalizowaliśmy wraz z uwagami z dyskusji po publikacjach medialnych (dziękuję @KatMokrzycka @AlicjaGardulska @ForumAkad za opisanie szczegółowo spraw dotyczących czasopism i ewaluacji) i postanowiliśmy wrócić do poprzedniej oceny konferencji IT, gdzie najważniejsze z nich mają miarę 200 punktów.

Polski

szymonlukasik retweetledi

@szymonluk @AliceInWeights Nie optymalizujemy pod benchmarki! Mamy stosunek negatywny ;-) @kwrobel_eth bardzo tego pilnuje

Polski

Bielik v3 w benchmarkach EuroEval

🧱 Model bazowy - 4. miejsce w zadaniach wielojęzycznych.

💬 Model instrukcyjny - 32. miejsce w zadaniach wielojęzycznych. Top 10 to giganci i modele wielokrotnie większe niż nasze 11B. A mimo to wyprzedzamy Nemotron 30B, OLMo 32B i Llama 3.1 8B. Polski open source. Społeczność. Wynik. 🇵🇱

Brawo! @KinasRemek @ChrisOciepa @kwrobel_eth Adrian Łukasz i @Cyfronet. @CYFRA_GOV_PL takie wyniki aż proszą się o symboliczne docenienie zespołu trenującego 🙂 choćby order, dyplom albo kawa ☕️

Polski

@InfZakladowy Większość LLMow ma filtry jakości scrapowanych danych - z polskiego podwórka ma je i PLLuM i Bielik…

Polski

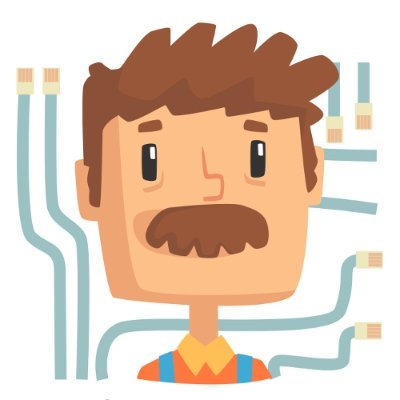

Mój serwis Monitor SLPS (slps.pl) odnotował dziesięć milionów odsłon w ciągu jednego tygodnia. Jak to możliwe? Ano, firmy produkujące LLM-y ignorują polecenia pliku robots.txt i pożerają wszystko bez opamiętania. Na przykład 15 milionów raportów z losowań, hej!

Polski

@AliceInWeights @SebKondracki A Bielik optymalizował się pod ten benchmark?

Może model mniejszy ale ile danych widział…

Polski

@SebKondracki Skuteczność porównywalna do mniejszej gemma-3n-E4B-it, która nie optymalizowała się pod ten benchmark.

Polski

@JurekLookas @SebKondracki @bielikllm Nie całkiem. Chińczycy też gromadzą co się da. Bez tego trudno wyjść powyżej > 1T tokenów - żeby zrobić dobry model, nawet mały…

Polski

AI Act w praktyce wygląda tak, że w @bielikllm sprawdzamy dla każdej strony plik robots.txt, tagi TDM (Text and Data Mining) oraz regulamin - czy nie ma opt-out. Reszta świata pobiera wszystko, "bo może się przyda". No i jak w takich warunkach robić dobre modele?

Informatyk Zakładowy@InfZakladowy

Mój serwis Monitor SLPS (slps.pl) odnotował dziesięć milionów odsłon w ciągu jednego tygodnia. Jak to możliwe? Ano, firmy produkujące LLM-y ignorują polecenia pliku robots.txt i pożerają wszystko bez opamiętania. Na przykład 15 milionów raportów z losowań, hej!

Polski

Polski językiem AI? Jeśli ktoś z Was natrafił na ten chwytliwy tytuł to polecam tekst w którym staram się przebić ten mocno napompowany balonik.

@"Polski językiem AI? "linkedin.com/pulse/polski-j… on @LinkedIn

Polski

@sjanus_pl Cloudferro już od dawna oferuje i Bielika i PLLuMa po API…

Polski

Dobra wiadomości.

Beyond - operator "serwerowni", należący do Kulczyka, zapowiedział właśnie stworzenie Fabryki AI, opartej na polskim modelu Bielik.

Będą oferowali możliwość korzystania z Bielika w swoich projektach, na bazie "hostingu" przez Beyond.

Ma być ~40% taniej niż u zagranicznej konkurencji.

To bardzo dobra informacja, zgodna z tym co kiedyś postulowałem ;) Bielik musi mieć wsparcie dla firm w integracji i supporcie i to się właśnie dzieje. Gdzieś mi też mignęło, że powstała firma twórców Bielika, oferująca właśnie usługi w integracji.

Coraz lepsze perspektywy przed Bielikiem. Czekam jeszcze na @InPostPL i @RBrzoska z ogłoszeniem współpracy z Bielikiem ;)

GIF

Polski

@m_b_lewkowicz @TrajektoriaAI @UODOgov_pl Zaczyna się to o czym intensywnie ostrzegaliśmy przy okazji każdego wystąpienia o deep fake’ach w ramach działalności Ośrodka Badań nad Bezpieczeństwem @NASK_pl. To bodaj nastraszniejsze społecznie użycie technologii deep fake

Polski

🚫 @UODOgov_pl zawiadomił policję ws. uczniów podstawówki, którzy wygenerowali deepnude koleżanki poniżej 15 r.ż. i zachęcali na Instagramie do szerowania. To podpada pod kk ws. pornografii dziecięcej! Przypominam mój tekst z radami dla ofiar deepnude, ich rodziców, przyjaciół ⤵️

Polski

@eugrafmarmelada @NASK_pl @perspektywy_s @PLLuM_pl @COIgovPL @CYFRA_GOV_PL @si_org_pl @Bielik_AI @a_karlinska @JowaJowita @digital_uni Polinka albo Lubaszka. To rodzina modeli.

Polski

@szymonluk @NASK_pl @perspektywy_s @PLLuM_pl @COIgovPL @CYFRA_GOV_PL @si_org_pl @Bielik_AI @a_karlinska @JowaJowita @digital_uni Czy to śliwka węgierka?

Polski

Karolina Seweryn, ekspertka NASK na #WomenInTech @perspektywy_s: Staramy się, aby w polskich modelach, takich jak @PLLuM_pl, były obecne feminatywy. Język polski jest dużym wyzwaniem dla #AI. Pokazały to badania: jeżeli modelom anglocentrycznym zadamy pytanie w języku angielskim, to modele odpowiedzą niestereotypwo. Natomiast to samo pytanie zadane w języku polskim jest już nacechowane stereotypowo.

Polski

@NASK_pl @perspektywy_s @PLLuM_pl @COIgovPL @CYFRA_GOV_PL @si_org_pl @Bielik_AI @a_karlinska @JowaJowita @digital_uni Ja wiem, że lubimy jak świat jest czarno-biały i można wszystko sobie na te dwa kolory pomalować ale apeluję o krztynę powściągliwości. Prace nad @PLLuM_pl prowadzone są w konsorcjum 8 jednostek. Klu przytoczonej wypowiedzi są problemy z językiem polskim przy budowie LLMów [1/2]

Polski

@TomaszRychter Ech, odsyłam do artykułu na temat konsekwencji wychowania modeli:

pllum.org.pl/blog/posts/ogr….

Polski

@GosiaFraser @LeszBuk @CYFRA_GOV_PL @IDEAS_NCBR @MNiSW_GOV__PL @TrajektoriaAI Nie róbmy z tego dramatu. Callów na dofinansowanie na projekty o podobnym budżecie jest więcej. Startujemy w tych konkursach, jesteśmy obecni w ALT-EDIC i jak @KinasRemek zauważył wcale nie odstajemy jeśli chodzi o budowę modeli u siebie…

Polski

Dużo mówi się ostatnio o modelu Deepseek, pojawiły się oskarżenia, że za jego sukces częściowo odpowiada destylacja modeli innych firm. Wszystkim zainteresowanych tym tematem polecam ciekawy wpis na blogu technicznym projektu PLLuM

pllum.org.pl/blog/posts/two…

Polski

@piotrsankowski @JakubNorkiewicz @piotrsankowski wbrew pozorom nie chodzi o jaskrawozielonego kumpla Pi - ośmioletni syn mi to ostatnio wyjaśnił :P

Polski