Sabitlenmiş Tweet

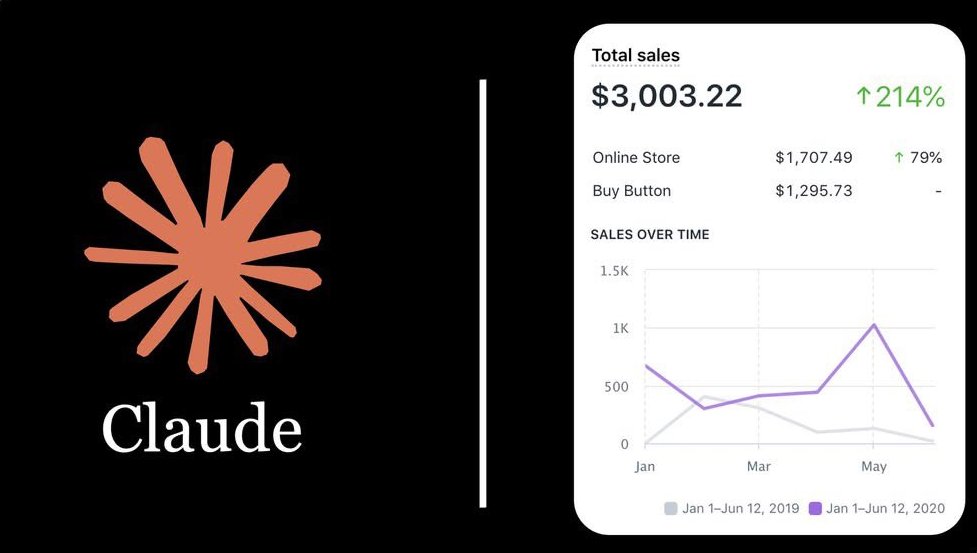

2026 年 Agent 的“记忆账单”终于有人算清楚了。

Manthan Gupta 那篇文章标题里的 Fixes What OpenClaw Got Wrong 给我感觉,又要站队龙虾了!

很多人对 Agent 记忆的理解还停留在“有一个大口袋,把什么都往里塞”。

结果就是:系统提示词越来越臃肿,模型注意力被噪音稀释,Prompt Cache 根本对不齐,成本和延迟一起上天。

Hermes 这一波之所以被拿来对比,是因为它提供了一个极度克制、Cache-aware(缓存感知) 的记忆样本。

它把“记忆”这层窗户纸捅破了:记忆不是一个功能,而是分层的运行时资产。

整理了几条硬核取舍,分享给在做 Agent Harness 的朋友:🧵⬇️

中文